CVPR 2026世界模型论文综述 生成与建模技术演进解析

近年来,视频生成技术的演进速度令人瞩目。从扩散模型到大规模视频基础模型,生成内容的视觉质量已日益接近真实世界。然而,当我们深入审视这些模型时,一个更根本的问题逐渐浮现:它们究竟是在“理解世界”,还是在“拟合像素分布”?

传统方法大多建立在二维图像空间之上,通过逐帧建模来合成动态内容。这种范式虽然在短时生成和视觉表现上取得了不错的效果,但其局限性也日益凸显:相机运动难以精确控制,多物体交互缺乏一致性,长时间生成容易出现结构漂移,甚至在复杂场景中违背基本物理规律。这些问题的共同根源,或许在于模型缺乏对“世界本身”的建模能力。

正是在这一背景下,“世界模型”逐渐成为视觉生成与人工智能研究的前沿方向。与传统方法不同,世界模型致力于构建一个能够统一描述空间结构、时间演化乃至物理规律的内部表示。其目标不仅是生成逼真的视觉内容,更在于进行推理、预测,甚至支持智能决策。某种意义上,这标志着研究目标正从“生成看起来真实的结果”,迈向“建模一个本质上合理的世界”。

这一范式的演进是多维度的:在表示层面,从2D像素走向3D/4D几何结构;在建模目标上,从单纯的内容生成扩展到因果关系理解、物理一致性与场景交互性;在学习方式上,从依赖大量标注数据转向从真实世界视频中提取可迁移知识;而在评估体系上,也逐渐从单一的视觉质量指标,转向对“世界建模能力”的多维度综合衡量。

CVPR 2026会议中的一系列研究工作,集中体现了这一发展趋势。这些研究在技术路径上各有侧重——有的强调4D几何建模,有的关注物理对齐与因果推理,有的探索如何从真实视频中学习世界知识,还有的致力于构建统一的评测基准。更重要的是,它们共同指向一个核心目标:推动模型从“视觉生成工具”演化为真正的“世界模拟器”。

接下来,我们将从几个关键角度,系统梳理这些代表性工作,尝试回答一个更深层的问题:当我们致力于“生成世界”时,我们究竟在建模什么?

世界在模型里到底长什么样?

要让AI模型理解世界,首先需要解决“如何表示世界”这一根本问题。传统的2D像素表示显然已不足以胜任,研究者们开始将目光投向更高维的几何结构表示。

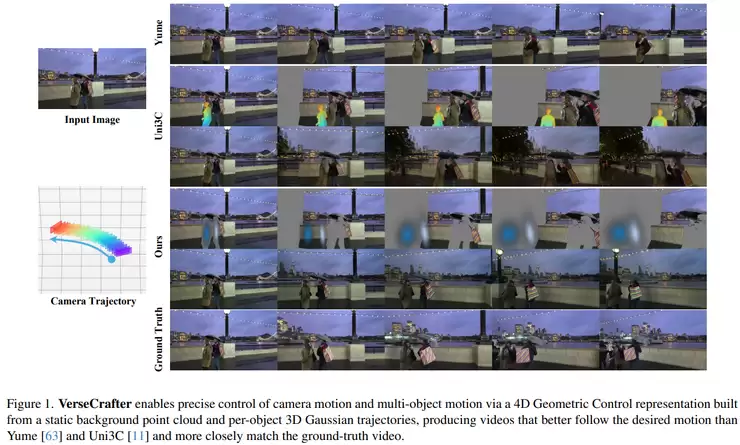

复旦大学、香港大学与腾讯ARC团队提出的《VerseCrafter: Dynamic Realistic Video World Model with 4D Geometric Control》,直指当前视频生成的核心痛点:现有方法多在2D图像空间中建模,导致相机与多物体运动难以统一控制,且生成稳定性不足。他们的解决方案是,将视频表示为“3D空间+时间”的统一世界状态,而非简单的逐帧像素堆叠。其核心是一种“4D几何控制”表示:使用静态背景点云描述场景结构,用带时间信息的3D高斯轨迹描述动态物体,从而构建出统一的4D世界模型。在此基础上,再将几何信息转化为控制信号,输入到视频扩散模型中进行生成。这样一来,生成的视频便能严格遵循设定的相机路径和物体运动轨迹。这项工作的意义在于,它实现了从“基于像素的合成”到“基于结构的生成”的范式转变,在可控性和时序稳定性上取得了显著提升。

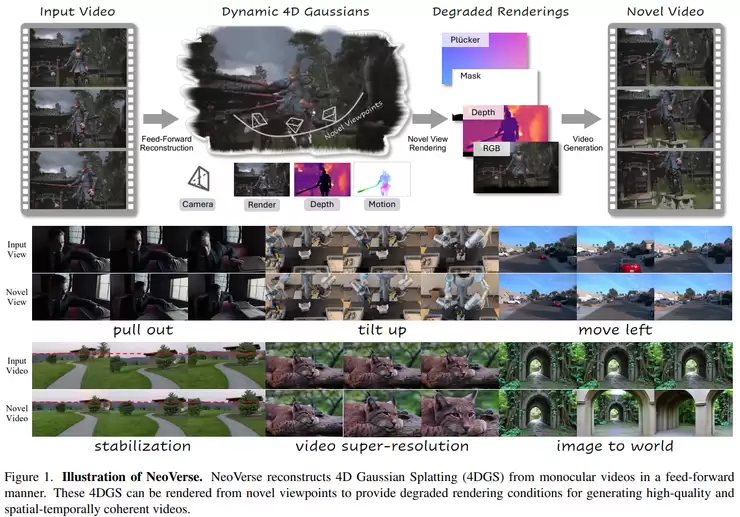

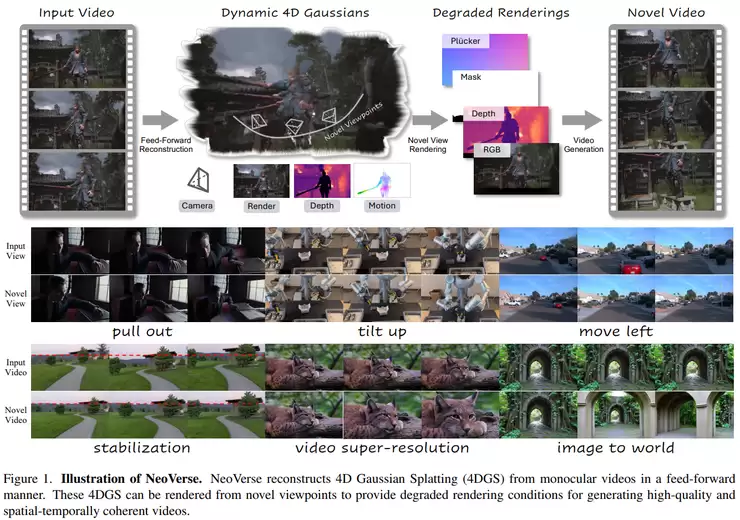

然而,构建4D世界模型通常依赖多视角数据或复杂的预处理流程,这严重限制了其可扩展性。中国科学院自动化所与CreateAI的《NeoVerse: Enhancing 4D World Model with in-the-wild Monocular Videos》试图打破这一瓶颈。其核心思路是,直接利用“野外采集”的普通单目视频来构建4D世界模型。该框架能够从日常视频中恢复场景的3D结构,并建模动态信息,形成完整的4D场景表示。它不仅支持4D重建,还能生成新视角视频,并应用于多种下游任务。这意味着,4D建模可以从依赖昂贵的数据采集,转向利用大规模、易获得的真实世界视频数据,实用性大大增强。

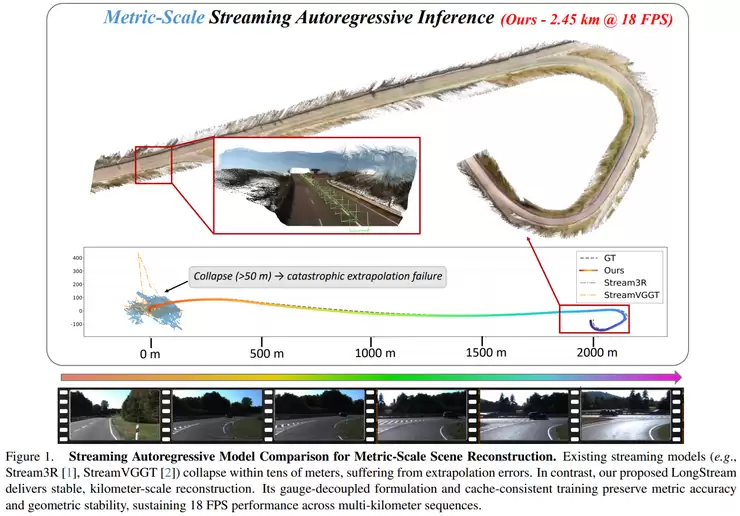

当视角拉长,另一个挑战随之而来:长序列3D重建。现有方法在短序列或离线场景下尚可应对,但面对上千帧的长视频,往往会出现注意力衰减、尺度漂移和误差累积等问题。香港科技大学(广州)、地平线机器人等团队的《LongStream: Long-Sequence Streaming Autoregressive Visual Geometry》提出了一个流式、规范解耦的视觉几何框架。它不再将所有帧锚定到第一帧,而是通过“关键帧相对建模”的方式,让局部序列独立建模,再统一到全局结构中。同时,它将尺度学习与几何预测解耦,并通过周期性刷新缓存等机制,实现了在严格在线(看不到未来帧)条件下,稳定处理上千帧数据的能力。这为自动驾驶、AR/VR等需要持续环境感知与建模的应用场景,提供了新的可能性。

模型有没有学到可以迁移的世界规律?

拥有了世界的表示,下一步是让模型理解世界中运行的客观规律。这要求模型不仅能“看见”表象,还要能“思考”本质,能从观察中提炼出可迁移的通用知识。

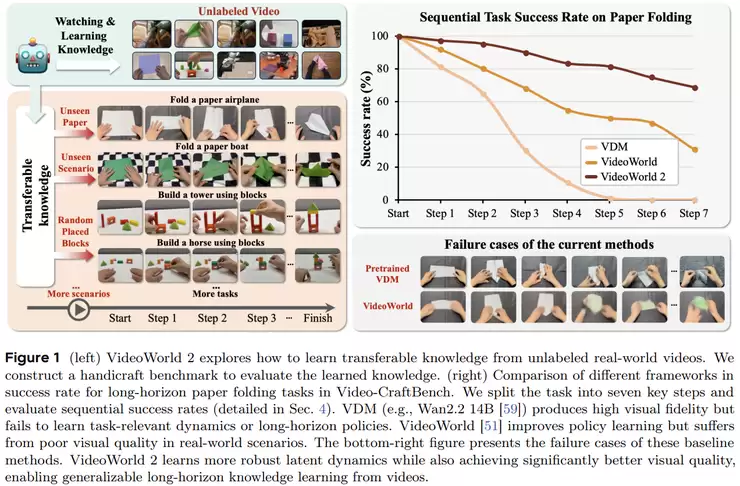

北京交通大学与字节跳动团队的《VideoWorld 2: Learning Transferable Knowledge from Real-world Videos》便将重点放在了“知识学习”上。该研究指出,现有视频生成模型虽然画面逼真,却普遍缺乏对物体运动规律、交互关系的深层理解,难以在新场景中有效泛化。VideoWorld 2框架的核心,是从大规模无标注的真实视频中,自主学习物理规律和时序结构,并将这些知识编码为可复用的表示。这使得模型从“会生成”向“会理解”迈进了一步,更贴近人类从观察中学习世界运作原理的方式。

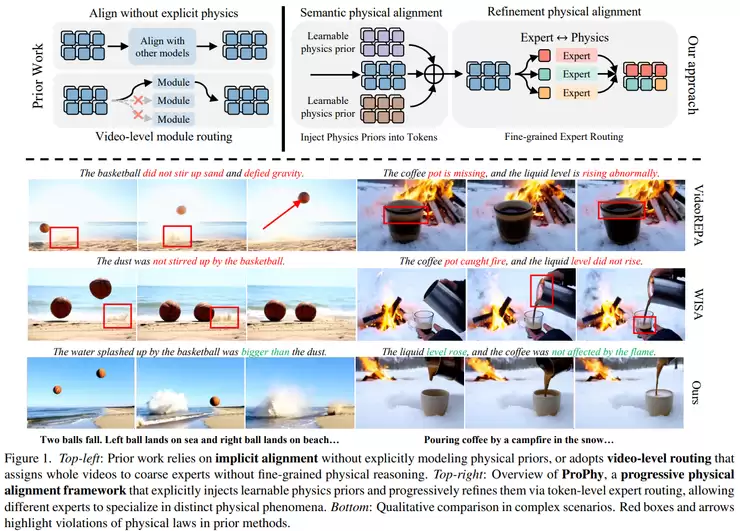

理解规律,尤其是物理规律,是构建可信世界模型的关键。中山大学、鹏城实验室等团队的《ProPhy: Progressive Physical Alignment for Dynamic World Simulation》显式地引入了物理约束。其“渐进式物理对齐机制”分为两步:首先在语义层面提取文本描述中的物理规律(如运动类型),再将这些规律精确对齐到视频中的具体区域和时间过程。模型还采用了“物理专家混合机制”,让不同模块分别学习不同类型的物理规律。通过引入视觉语言模型的推理能力,该框架使生成的动态场景不仅视觉逼真,更符合真实的物理规律。

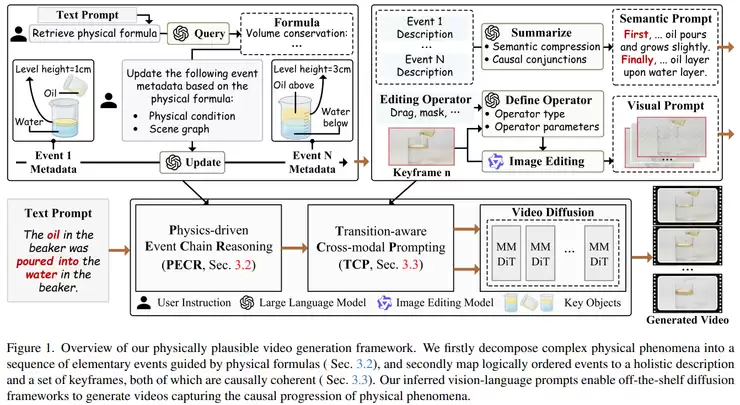

将物理一致性推向极致的,是四川大学、香港理工大学等团队的《Chain of Event-Centric Causal Thought for Physically Plausible Video Generation》。该工作认为,许多物理过程本质是一系列按因果顺序发展的事件链。因此,它提出了一个以“事件为中心”的生成框架:先将复杂物理过程拆解为多个有因果关系的子事件,并引入物理公式作为约束;再将这些事件转化为时间对齐的文本和视觉提示,以引导视频生成在不同事件间平滑过渡。这种方法让视频生成从“生成一个静态结果”变为“生成一个符合物理规律的动态过程”,在因果一致性上表现更优。

能不能精确控制生成的世界?

理解了世界,还要能操控世界。对生成过程的精确控制,是将世界模型应用于实际场景的前提。

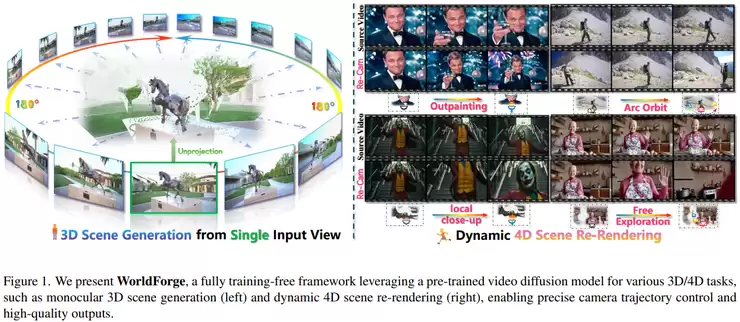

西湖大学与南洋理工大学的《Taming Video Models for 3D and 4D Generation via Zero-Shot Camera Control》关注的是控制本身。现有视频扩散模型虽有强大的“世界先验”,却难以精确控制相机运动,且时空一致性较差。该研究提出的WorldForge框架,其巧妙之处在于完全无需重新训练模型,仅在推理阶段进行增强。它通过在扩散去噪过程中加入递归优化来贴合目标相机轨迹;利用光流区分“运动”与“外观”,只控制运动部分;并通过双路径对比机制自动修正偏差。这种“即插即用”的方式,以极低成本实现了对相机轨迹的精确控制,并保持了高视觉质量。

模型不仅表示世界,还要「用世界做事」

终极目标,是让世界模型不仅能模拟世界,还能基于模拟进行决策和交互,真正成为智能体的“数字孪生”环境。

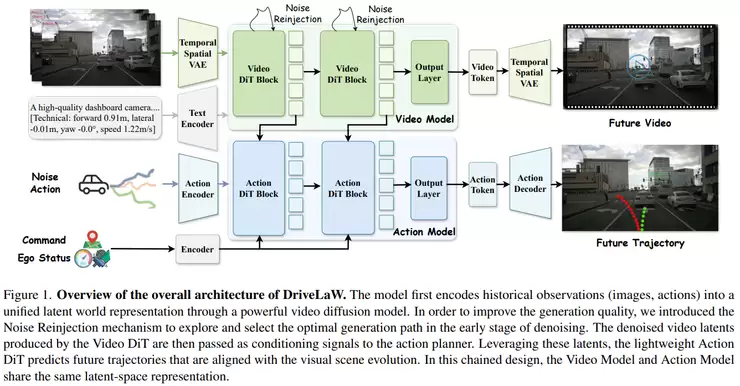

华中科技大学与小米EV团队的《DriveLaW: Unifying Planning and Video Generation in a Latent Driving World》便致力于此。传统自动驾驶系统将“预测未来场景”和“路径规划”分开处理,容易导致误差累积。DriveLaW框架则将二者统一在一个“潜在驾驶世界”中。模型在潜在空间学习场景动态演化规律,并直接在此空间中进行决策推理,无需先生成完整视频。这打破了预测与决策的壁垒,使世界模型真正参与到决策闭环中,提升了在复杂场景中的效率和鲁棒性。

在机器人操作领域,物理一致性至关重要。AMAP CV Lab的《ABot-PhysWorld: Interactive World Foundation Model for Robotic Manipulation with Physics Alignment》构建了一个具备物理对齐能力的交互式世界模型。该模型基于扩散Transformer架构,在生成视频的同时引入物理约束,确保机器人操作过程既真实又合理。它还支持根据输入指令控制交互过程,并通过物理感知训练机制,让模型更关注“物理合理性”而非单纯视觉质量。这使世界模型从生成工具,发展为能用于机器人决策模拟的基础模型。

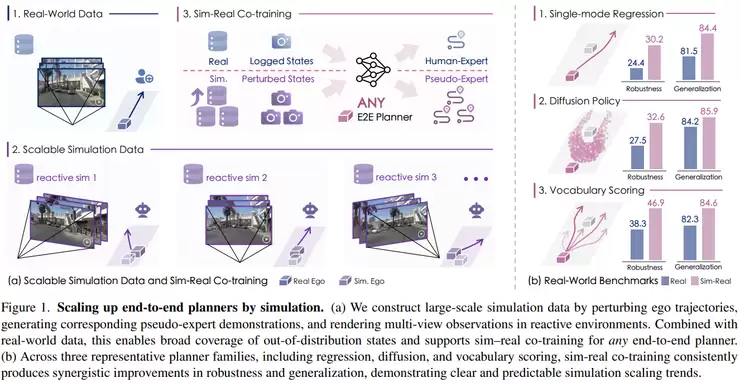

然而,无论是自动驾驶还是机器人,都面临一个共同难题:真实世界中的关键危险场景或长尾情况数据稀缺。中科院自动化所、香港大学OpenDriveLab与小米EV团队的《SimScale: Learning to Drive via Real-World Simulation at Scale》提供了一种思路。该框架利用真实数据构建仿真环境,并在此基础上自动生成大量新的驾驶场景,尤其是那些罕见的长尾场景。通过联合训练真实数据与仿真数据,有效缩小了仿真与现实间的差距,让模型在安全性和泛化能力上得到增强。这是一种以数据驱动的方式,规模化解决关键场景覆盖问题的有效路径。

如何知道一个模型真的在「建模世界」?

随着世界模型能力日益复杂,如何系统、全面地评估其“世界建模能力”,成为一个基础且关键的问题。

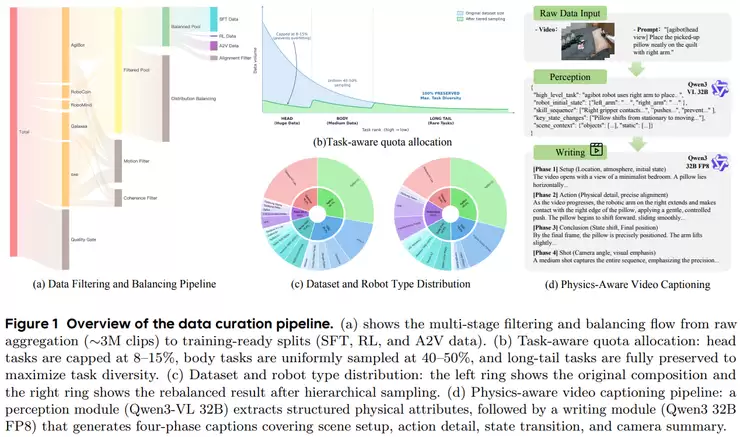

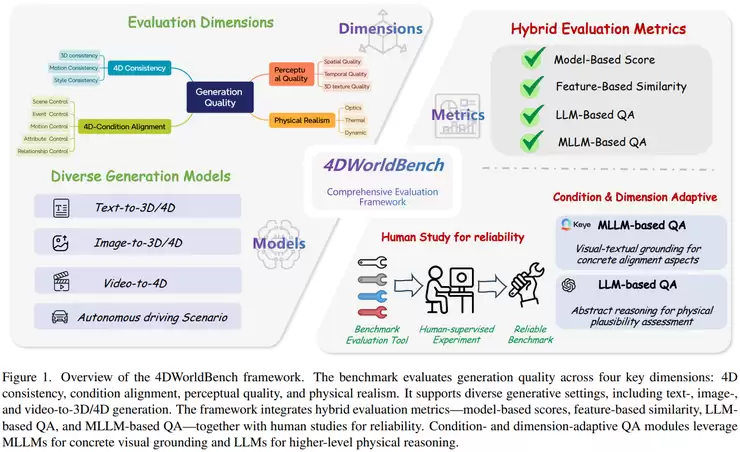

中国科学技术大学、浙江大学等机构的《4DWorldBench: A Comprehensive Evaluation Framework for 3D/4D World Generation Models》旨在建立统一标准。该框架从视觉感知质量、条件与4D对齐能力、物理真实感、时空一致性等多个维度综合评价模型。它支持多种输入模态(文本、图像、视频),并通过统一机制将不同模型映射到同一评测空间进行比较,甚至引入大语言模型参与判断,使评估更接近人类主观认知。这推动研究重点从单纯的生成效果,转向对世界建模能力的全面衡量。

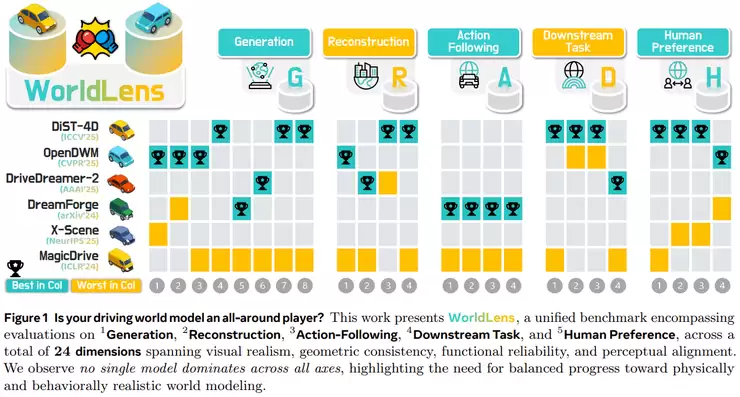

WorldBench Team的《WorldLens: Full-Spectrum Evaluations of Driving World Models in Real World》则更专注于自动驾驶领域。该框架从生成、重建、动作跟随及下游任务表现等多个角度,系统评估世界模型的综合能力,并结合人类偏好进行评价。它构建了大规模数据集并引入自动评估模型,实现了规模化、可解释的评测。这项研究也揭示了当前模型在不同能力间存在的权衡,为未来研究指明了方向。

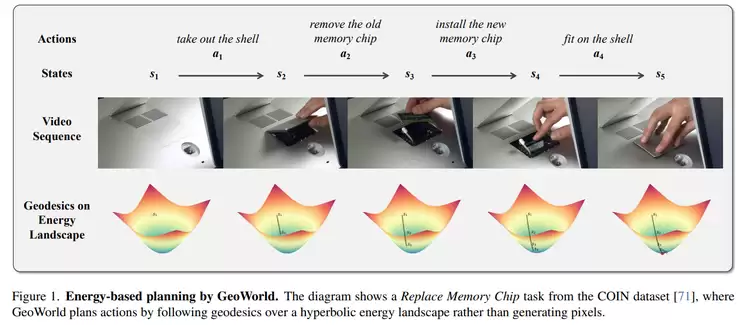

除了评估,模型自身的表示结构也决定了其理解和规划能力。ANU和MBZUAI团队的《GeoWorld:Geometric World Models》提出了一个新颖的观点:将世界模型从欧几里得空间,扩展到具有层级结构的几何空间(如双曲空间)中。在这种几何能量模型中,状态间的复杂关系得以更自然地表达。进行预测或规划时,模型沿“测地线”推理,而非逐步生成状态,这有效缓解了长时预测中的误差累积问题,为基于世界模型的决策规划提供了新思路。

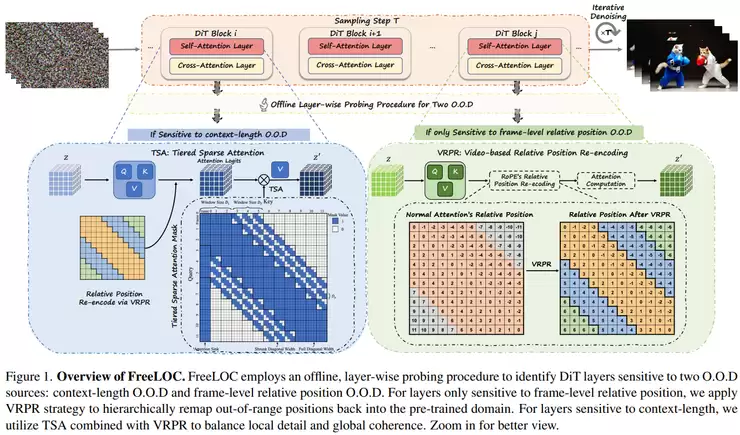

最后,一个实用性问题是如何让现有模型更好地工作。西湖大学的《Free-Lunch Long Video Generation via Layer-Adaptive O.O.D Correction》发现,用短视频训练的扩散模型直接生成长视频时,会出现质量下降,其根源在于帧间相对位置和上下文长度超出了训练分布(O.O.D.)。他们提出的FreeLOC框架,无需重新训练模型,仅在推理阶段通过“视频相对位置重编码”和“分层稀疏注意力”等机制进行修正,并自适应地针对敏感层进行调整,从而显著提升了长视频生成的稳定性和质量。这是一种低成本提升模型实用性的有效方法。

回过头看,从精确的4D几何控制,到对物理规律和因果关系的理解,再到用于决策规划与系统评估,世界模型的研究正在一条从“表示”到“理解”再到“应用”的路径上快速演进。中国科学院自动化所等团队的《Neoverse: Unposed 4D World Modeling from Monocular Video》可视为一个注脚,它通过前馈式重建与生成联合训练,让模型能直接利用海量单目视频,正是这条路径走向大规模实用化的重要一步。

这些工作共同描绘出一个清晰的趋势:视频生成技术正从追求视觉逼真的“像素合成”,迈向构建内在合理的“世界模拟”。未来的AI模型,或许将不再只是一个内容生成工具,而是一个能够理解物理规则、进行因果推理、并支持复杂决策的数字世界基底。这不仅是技术的演进,更是我们对机器如何认知世界这一根本问题的一次深入探索。

相关攻略

近年来,视频生成技术的演进速度令人瞩目。从扩散模型到大规模视频基础模型,生成内容的视觉质量已日益接近真实世界。然而,当我们深入审视这些模型时,一个更根本的问题逐渐浮现:它们究竟是在“理解世界”,还是在“拟合像素分布”? 传统方法大多建立在二维图像空间之上,通过逐帧建模来合成动态内容。这种范式虽然在短

全球具身智能的焦点,正汇聚于硅谷。一家来自中国的机器人公司,选择在这里向世界展示其前沿的硬科技实力。 中国机器人企业的创新浪潮,影响力早已跨越国界。近期,一家深耕具身智能领域的公司,将其全球新品发布会的舞台直接设在了硅谷的核心腹地,彰显了进军全球市场的雄心。 美西时间4月28日,魔法原子(Magic

机器人行业正迎来关键转折点:从炫技的“展示时代”迈入务实的“交付时代”。 过去两年,人形机器人凭借空翻、舞蹈、端咖啡等高光表演,频繁登上春晚、展会等舞台,成功向世界证明了其技术潜力。这些视觉冲击力极强的演示,有效塑造了公众认知,让人们相信机器人正走出实验室。 然而,进入2026年,市场与资本的拷问变

世界模型,无疑是当前人工智能领域最受瞩目的前沿方向。其终极目标,是构建一个能够像人类一样感知、理解、交互并预测真实世界的统一智能系统。然而,理想与现实之间往往存在鸿沟。当前的研究现状是:视频生成、3D建模、具身控制、多模态推理等方向各自为战,接口标准不一,推理流程相互割裂,系统耦合度高。研究人员不得

世界模型成为科技巨头竞争焦点,其核心是让AI理解物理规则。魔芯科技创始人陈天润从3D打印转向空间智能,发现该领域同样存在数据规模效应。团队基于国产算力开发出高效、可终端部署的世界模型,并凭借消费电子领域的成本控制与工程化经验,推动技术在具身智能、自动驾驶等场景商业。

热门专题

热门推荐

潮汐守望者梅丽珊卓的出装策略,核心在于极致放大她的爆发伤害与控制能力,同时构建必要的生存保障。以下这套经过版本与实战验证的装备组合,将帮助她主宰峡谷战场,成为团队不可或缺的法术核心。 核心装备 卢登的回声通常是无可争议的首件神话装备。它提供的法术强度与技能急速完美优化了梅丽珊卓的技能循环,而其被动“

4月29日,阶跃星辰正式发布新一代图像编辑生成模型Step Image Edit 2。这款AI图像模型主打“小身材、大能力、快响应”,参数量仅3 5B,却在轻量级图像编辑评测基准KRIS-Bench中斩获综合排名第一。它全面支持文生图、中英文渲染、局部编辑、视觉推理、主体一致性及风格迁移等多种AI图

2026年的AI圈,时钟仿佛被拨快了。技术迭代的浪潮一波未平,一波又起。 尤其是进入四月以来,整个行业像是踩下了油门。Meta携Muse Spark高调回归,ChatGPT Images 2 0的生成效果在社交媒体上持续刷屏,而GPT-5 5的发布,再次将技术天花板向上推升了一个量级。视线转回国内,

从DeepMind到阿里、腾讯,各路顶尖玩家正涌入“世界模型”这个新战场。但大家争夺的,远不止是算力与资源,更核心的较量在于:究竟什么样的架构,才能真正构建起对物理世界的理解? 过去一年半,世界模型已然成为AI领域竞争最密集的焦点。参与者名单几乎涵盖了所有前沿方向:全球科技巨头、视频生成公司、机器人

柴犬币自低点反弹约30%,正尝试复苏。当前面临0 0000076美元附近的200日移动均线关键阻力,若能突破可能上涨约21%,但该位置存在解套抛压。价格需放量突破0 0000064美元以确认短期上涨趋势,下一目标0 0000072美元,下方关键支撑位于0 000006美元附近。