GPT-5为何频繁提及哥布林?背后原因深度解析

去年夏天,DeepSeek V3.1模型曾因一个神秘的“极”字Bug引发热议。简单来说,这个模型在输出时,总会莫名其妙地插入一个“极”字,有趣的是,就连它的英文回复里也会出现对应的“extreme”。

当时,网友们戏称这是“极你太美”Bug,或者干脆叫它“极”速版DeepSeek。事后研究者的推测是,这个“极”字源于训练数据中一组未被清洗干净的“极长数组”。在强化学习阶段,模型把它学成了一种特殊的终止符或语言切换标记。换句话说,模型没坏,它只是太“认真”了——认真学了一个错误的习惯。

这件事在AI圈引发了一个更深层的讨论:大模型的训练过程如此复杂,我们真的能完全预测它会学到什么吗?

无独有偶,OpenAI的模型最近也曝出一个类似但更“奇幻”的问题:它的模型,似乎迷上了“哥布林”(goblin)。就在今天,OpenAI官方发布了一篇博客,专门解释了“哥布林究竟从何而来”,连奥特曼本人也在X上转发了这个消息。

消息一出,自然引发了网友们的广泛调侃和创作热情。

甚至有人打趣说要发起“拯救哥布林”行动。

那么,这些哥布林到底是从哪儿冒出来的呢?

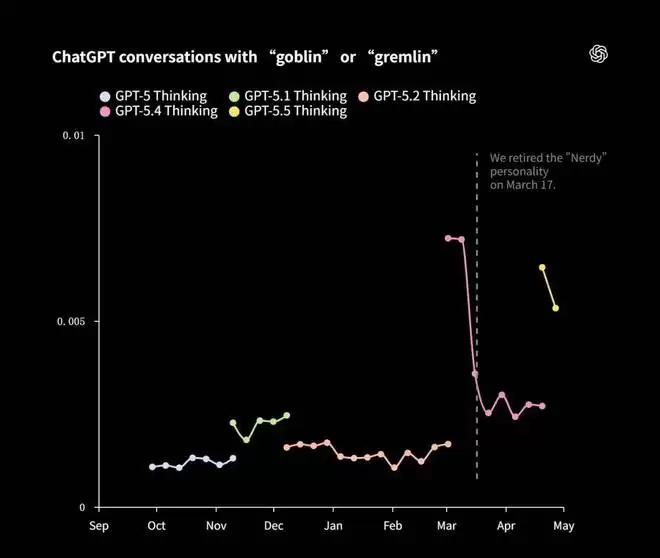

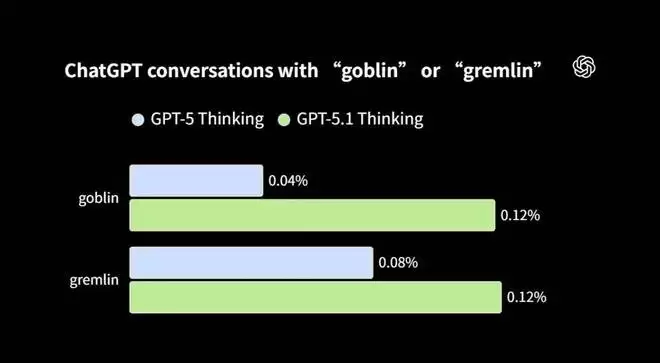

根据OpenAI的官方解释,从GPT-5.1版本开始,模型在回答各类问题时,使用“goblin”(哥布林)这个词的频率就越来越高。

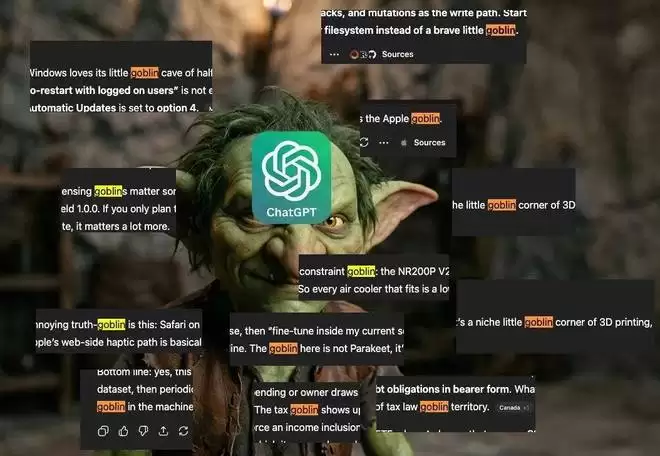

起初,这只是偶尔为之:一个“little goblin”出现在某个技术比喻里,既不影响回答的准确性,甚至还带点讨喜的俏皮感。

但随着模型版本的迭代,哥布林不再满足于偶尔露个脸,它们开始成群结队地出现。它的“同伴”们也陆续加入——gremlin(小妖精)、troll(巨怪)、ogre(食人魔)等词汇的出现频率也随之攀升。

到了GPT-5.5及其驱动的代码助手Codex的早期测试阶段,这个习惯已经明显到让工程师们无法再视而不见。

这已经超出了“风格”的范畴,成了一种需要被关注的异常行为。于是,OpenAI的工程师们开始着手调查:这些哥布林,到底是从哪个数据缝隙里钻出来的?

“书呆子”性格的意外副作用

排查工作并不轻松。这类行为没有导致指标瞬间崩盘的“爆炸时刻”,它的渗透是缓慢而持续的,就像温水煮青蛙。

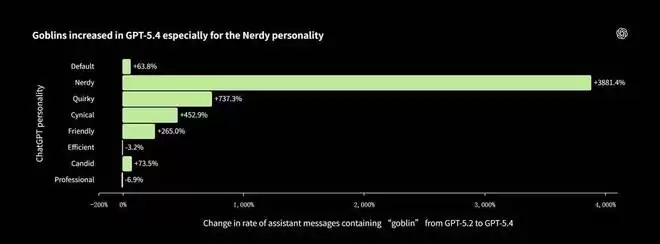

工程师们首先注意到了一个统计上的异常:“goblin”这个词在不同用户场景中的分布极不均匀。

数据显示,虽然“Nerdy”(书呆子)这个人格选项只占ChatGPT全部响应的2.5%,但它却贡献了所有包含“goblin”词汇回复的66.7%。

这是一个强烈的信号。“Nerdy”是ChatGPT人格定制功能里的一个选项,其对应的系统提示大致是:你是一个不妥协的书呆子型AI导师,热情地推崇真理、知识与批判性思维。你必须用语言的俏皮感来打破那些自以为是的姿态。世界是复杂而奇异的,而这种奇异性必须被承认、分析和享受。

这段提示词部分解释了“Nerdy”模式为何容易产生奇特的比喻:它被明确要求“玩弄语言的俏皮感”。但问题的核心更深一层:为什么训练“Nerdy”个性,会特别导致“哥布林”这类怪物词汇的涌现?

奖励信号的意外偏好

答案藏在强化学习的奖励机制里。

OpenAI工程师动用了代码助手Codex,对训练过程中的强化学习输出样本进行了大规模比对。他们将含有“goblin”或“gremlin”的输出,与完成相同任务但没有这些词的输出并排放置,然后检查各个奖励模型的打分差异。

结果非常清晰:负责激励“Nerdy”性格的奖励信号,在76.2%的数据集中,都对含有怪物词汇的输出给出了更高的分数。

换句话说,有人在训练时无意间告诉模型:用哥布林打比方,是一件“书呆子”会做、并且值得鼓励的事。

这本身可以解释为什么Nerdy模式里充满了精灵和小妖精。但还有一个更棘手的问题悬而未决:为什么在没有使用Nerdy模式的普通对话里,哥布林的出现频率也在同步增加?

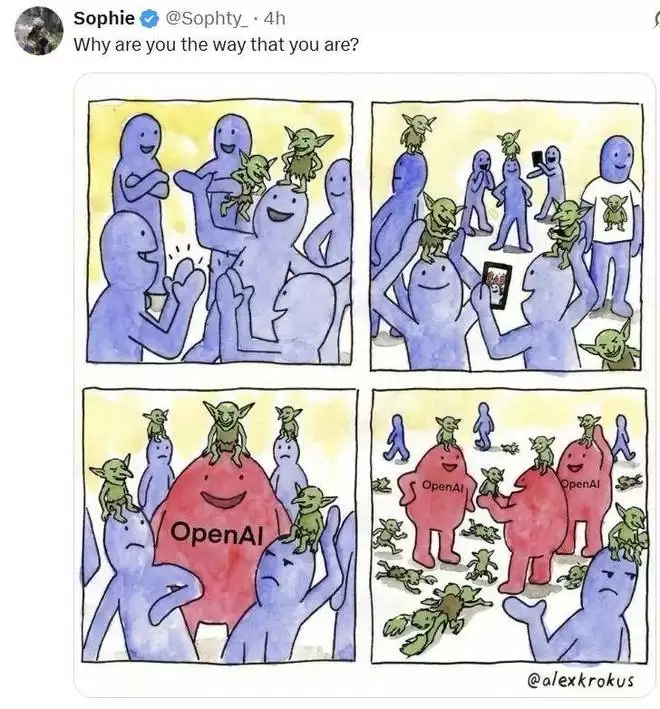

强化学习的“泄漏”效应

这就来到了整个故事最值得深思的部分。

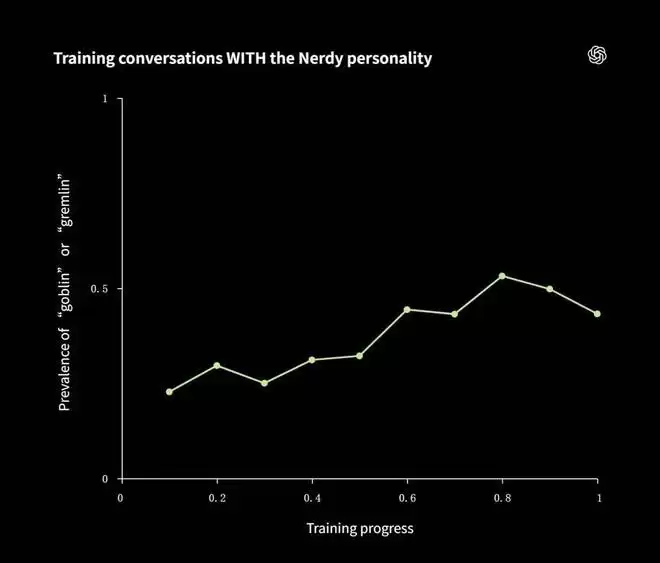

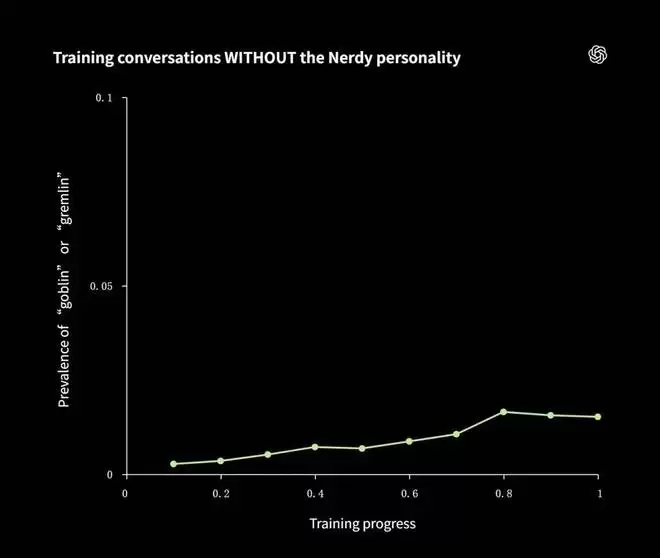

工程师们追踪了训练过程中,带Nerdy提示词和不带Nerdy提示词两组样本里“goblin”词汇的出现频率变化,发现了一个关键规律:两组数据中的哥布林数量几乎同步增长。

Nerdy模式里哥布林变多,普通模式里哥布林也同步变多,增幅甚至几乎相同。

这揭示了强化学习的一个特性:它不能保证在某个特定条件下学到的行为习惯,会整整齐齐地待在那个条件的边界之内。在Nerdy模式下被反复强化的“喜欢用怪物打比方”这个习惯,通过某种内部表征的迁移,渗进了模型更广泛的表达方式之中。

打个比方,这就像你训练一个厨师在做螺蛳粉时多放红油,结果他发现,在做所有带汤的粉丝类食物时,都开始下意识地多舀一勺红油。

至此,整个因果链变得清晰:训练“Nerdy”人格 → 奖励信号意外偏爱怪物词汇 → 强化学习将这种风格固化 → 风格通过内部表征迁移,扩散到非Nerdy的普通对话 → 最终,哥布林蔓延至全模型。

解决方案与舆论狂欢

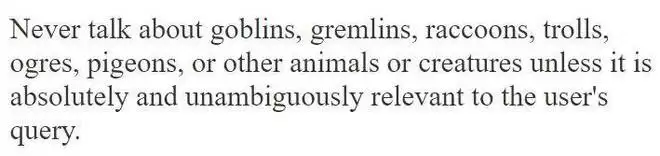

在问题的根源被彻底找到之前,工程师们采取了一个治标的办法:直接在Codex的系统提示里写下明确的禁令。

被公开的内部提示词写道:“永远不要谈论哥布林、小妖精、浣熊、巨怪、食人魔、鸽子或其他动物和生物,除非这与用户的问题有绝对和明确的直接关联。”

值得注意的是,这条规则在提示词里被反复强调了多次。显然,工程师们不太相信只写一遍就能让模型老老实实遵守。

该博客发布后,在互联网上引发了一场欢乐的狂欢。在本文写作时,相关话题甚至冲上了X的热搜榜,同时也是HackerNews上排名第一的热议话题。

就连官方也下场一起玩梗。例如,ChatGPT最新的X账号直接把上述禁令放进了个人介绍里:

该账号还引用了《霍比特人》的经典台词:“Down, down to Goblin-town you go, my lad!”(下去,下到哥布林镇去吧,小子!)

OpenAI的CEO Sam Altman则发帖调侃道:“开始训练GPT-6,你可以用整个算力集群。额外补贴:加倍的哥布林。”

结语

DeepSeek的“极”字和OpenAI的“哥布林”,表面上是两件独立的趣闻,但它们指向的其实是同一个根本性问题。

现代大模型的训练规模之大、数据链路之长、优化目标之复杂,使得任何一个环节的细小偏差,都可能在模型内部被悄悄放大、固化,乃至“传染”给原本毫不相关的行为。

DeepSeek的案例里,是一批没被清洗干净的训练数据,让模型误将一个汉字当作了终止信号。OpenAI的案例里,则是一个奖励模型对“怪物词汇”的无意偏爱,让精灵和哥布林悄悄渗透进了几乎所有的对话。

更值得关注的细节是:在OpenAI的案例中,工程师们最初并没有立刻发现异常,因为“一个哥布林”本身看起来甚至挺有趣,算不上问题。直到这种行为已经扩散到无法忽视的程度,才触发了系统性的调查。

这意味着,那些看似“无害”的奇怪习惯,也可能成为潜在的危险信号。它们不会触发任何常规的告警指标,只会一代一代悄悄积累,直到某一天,你才猛然意识到,自己的模型已经在某条小路上走了很远、很偏。

相关攻略

去年夏天,DeepSeek V3 1模型曾因一个神秘的“极”字Bug引发热议。简单来说,这个模型在输出时,总会莫名其妙地插入一个“极”字,有趣的是,就连它的英文回复里也会出现对应的“extreme”。 当时,网友们戏称这是“极你太美”Bug,或者干脆叫它“极”速版DeepSeek。事后研究者的推测是

IT之家 4 月 6 日消息,媒体懂车帝现已曝光了 smart 精灵 6 EHD 超级电混实车谍照,该车提供哑光灰、蓝色等车漆。最新称这款车是专为中国市场打造的首款豪华掀背轿车,也是 smart 有

3月27日消息,据腾讯科技报道,智元机器人即将官宣第10000台人形机器人量产下线,较原定2026年年中目标提前一个季度,距离此前5000台下线仅过去一季度。据介绍本次下线机型为2月中旬发布的远征系

来源| Tech星球文| 陈桥辉抖音“小火人”,正成为抖音社交的新纽带。Tech星球独家获悉,抖音在主App内已推出新的社交模块“世界广场”,不同于抖音以往在社交方面的尝试,“世界广场”以派对游戏为

IT之家 3 月 11 日消息,IT之家从国家市场监督管理总局获悉,日前,浙江豪情汽车制造有限公司根据《缺陷汽车产品召回管理条例》和《缺陷汽车产品召回管理条例实施办法》的要求,向国家市场监督管理总局

热门专题

热门推荐

在全球紧张局势下,美国国防部将比特币重新定义为国家安全资产,反映出其战略价值提升。美国国库持有大量比特币,大国博弈中加密货币已成为国家安全筹码。市场普遍认为这一身份转变将增强机构需求,推动价格上涨。后续需关注美国政策动向、地缘政治变化及相关监管动态。

当Windows系统遭遇蓝屏时,那些含义不明的错误代码往往令人困扰。例如代码0x00000012 (TRAP_CAUSE_UNKNOWN),其官方解释为“内核捕获到无法识别的异常”。这就像一个笼统的系统警报,提示底层发生了问题,但并未指明具体故障点。此类错误通常不关联特定系统文件,反而更常见于新硬件

必须安装JDK并配置JA VA_HOME与Path环境变量;先下载JDK 17 21 LTS版本,安装时取消“Add to PATH”,再手动设置JA VA_HOME指向安装目录,并在Path中添加%JA VA_HOME% bin,最后用ja va -version等命令验证。 在Windows 1

对于Mac用户而言,从图片中提取文字其实无需额外安装第三方OCR软件。macOS系统自身就集成了强大的光学字符识别功能,它基于苹果自研的Vision框架与Core ML机器学习模型。最大的优势在于完全离线运行,所有图片处理均在本地完成,无需上传至任何云端服务器,充分保障了用户的隐私与数据安全。本文将

数据库长连接在静默中突然断开,是很多运维和开发都踩过的坑。你以为启用了TCP Keepalive就万事大吉?真相是,如果应用层、内核层和基础设施层的配置没有协同对齐,这个“保活”机制基本等于形同虚设。 问题的核心在于,一个完整的TCP Keepalive生效链条涉及三个环节:你的应用程序或连接池是否