生成式语言模型原理与应用详解

在人工智能技术飞速发展的今天,生成式语言模型已成为自然语言处理(NLP)领域的核心驱动力。与传统的文本分类或理解模型不同,生成式AI的核心能力在于“创造”。它通过深度学习海量语料,掌握语言的深层规律与模式,从而能够根据用户输入的提示或上下文,自主生成逻辑通顺、语义连贯且富有创造性的全新文本内容。

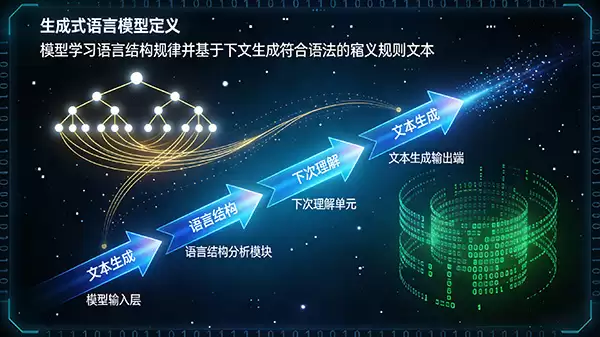

一、生成式语言模型的定义

究竟什么是生成式语言模型?简单来说,它是一种专门用于生成自然语言文本的人工智能模型。其核心定义在于,它不仅能够理解语言,更能基于对语法、语义和语境的综合把握,进行原创性的文本“创作”。这不同于简单的信息检索或模板填充,而是模型在深刻理解语言内在结构(包括词法、句法和篇章逻辑)后,像一位拥有渊博知识的智能写手,根据特定指令产出符合风格与主题要求的文章、对话或代码。

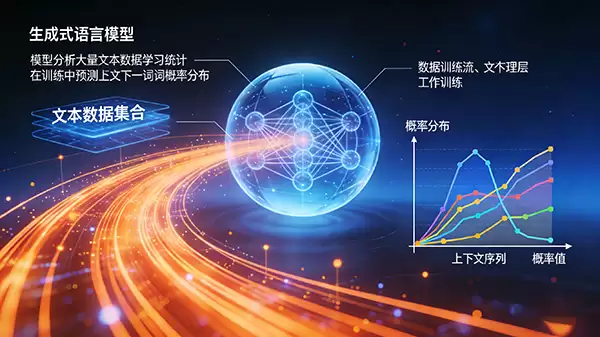

二、生成式语言模型的工作原理

生成式语言模型的强大能力源于其底层的工作原理,本质上是基于大规模数据的统计规律学习与预测。

在模型训练阶段,系统会输入数以亿计的文本数据进行学习。其核心训练任务是进行“下一个词预测”:即根据已出现的上文(上下文),计算出下一个最可能出现的词语的概率分布。通过海量数据的反复迭代,模型逐渐内化了词汇间的搭配关系、句子的常见结构以及不同场景下的语言表达习惯,构建起一个复杂的语言概率模型。

当模型投入应用时,它便能基于学习到的知识进行推理。用户给出一个开头或提示(Prompt),模型便依据内部的概率网络,自回归地逐个生成后续最可能的词语序列,从而形成一段完整、流畅的新文本。因此,其生成的内容既继承了训练数据的风格与知识,又是全新的、独一无二的组合。

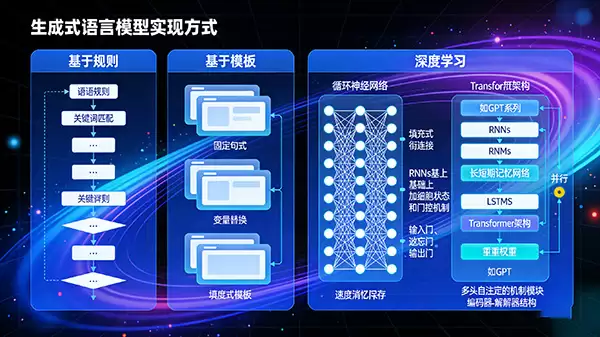

三、生成式语言模型的实现方式

实现文本生成的技术路径经历了显著的演进。早期基于规则或模板的方法灵活性差,效果有限。真正的变革始于深度学习,尤其是神经网络架构的突破。

当前主流的生成式语言模型实现,几乎都建立在深度神经网络之上。其发展脉络清晰:从处理序列数据的循环神经网络(RNN),到改进长程依赖问题的长短期记忆网络(LSTM),再到如今占据统治地位的Transformer架构。以GPT系列为代表的Transformer模型,凭借其革命性的“自注意力机制”,能够并行处理文本并精准捕捉全局词语关系,从而在文本生成的质量、一致性和效率上实现了跨越式提升,奠定了大语言模型(LLM)时代的技术基础。

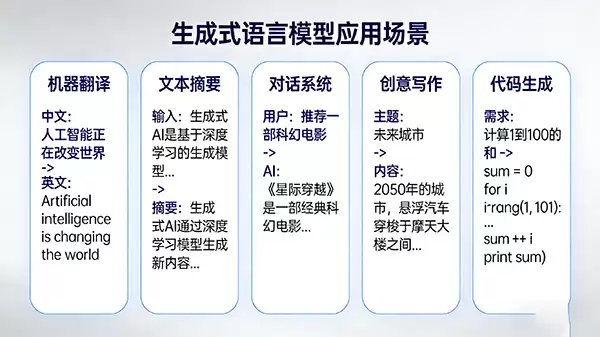

四、生成式语言模型的应用场景

生成式语言模型的应用场景极为广泛,正在重塑众多行业的工作方式与内容生产流程。

其典型应用包括:实现高质量跨语言沟通的机器翻译、自动生成文章摘要的文本总结、充当24小时在线客服的智能对话系统、辅助创作者进行小说与剧本的创意写作,乃至根据自然语言描述自动生成编程代码。所有这些应用都共享同一个核心:将用户的意图或输入信息,转化为合理、自然且有用的文本输出。

当然,我们必须清醒地认识到,现有的生成式AI模型仍存在局限性。它们可能产生“幻觉”,即生成看似合理但实则错误或虚构的信息,尤其在需要严谨事实核查和深度逻辑推理的复杂任务中。因此,在当前的实际部署中,往往需要结合知识图谱、事实校验模块或其他专项AI工具进行辅助,并在关键应用环节设置人工审核机制,以保障生成内容的准确性与可靠性。克服这些挑战,正是推动生成式语言模型迈向更成熟、更可信阶段的关键方向。

相关攻略

大语言模型(LLM)已成为人工智能领域的热点,但你真的清楚它们具备哪些核心能力吗?本文将系统解析大语言模型的七大关键能力,帮助你深入理解它们如何“思考”、理解与创造。 文本生成能力 这是大语言模型最突出的能力之一。通过学习海量文本数据,模型能够生成语法准确、逻辑连贯且贴合上下文的自然语言内容。无论是

在人工智能技术飞速发展的今天,生成式语言模型已成为自然语言处理(NLP)领域的核心驱动力。与传统的文本分类或理解模型不同,生成式AI的核心能力在于“创造”。它通过深度学习海量语料,掌握语言的深层规律与模式,从而能够根据用户输入的提示或上下文,自主生成逻辑通顺、语义连贯且富有创造性的全新文本内容。 一

回望大语言模型走过的路,你会发现它并非一蹴而就,而是一段清晰可辨、层层递进的演进史。粗略来看,这段历程可以划分为三个关键阶段,每个阶段都代表着一次技术上的质变和应用疆域的拓展。 一、基础模型阶段 时间大概在2017年到2021年之间。这个阶段的核心任务,是打好地基。 一切的起点,是2017年那篇里程

近年来,人工智能领域最具突破性的进展之一,当属大语言模型的飞速发展与广泛应用。它从一个前沿研究概念,迅速演变为驱动自然语言处理技术革新和产业智能化转型的核心引擎。这一变革的背后,是算法架构的突破、海量数据的积累与强大算力支撑共同作用的结果。本文将系统性地解析大语言模型的崛起背景、核心技术、应用实践以

自然语言处理领域近年来迎来了一项革命性技术——大语言模型。随着深度学习技术的持续演进,这类模型通过海量文本数据训练,不仅能生成和理解自然语言,更在文本摘要、机器翻译、情感分析等复杂任务中展现出惊人潜力。本文将深入探讨其核心技术、应用场景以及可能带来的社会影响。 揭秘大语言模型的“黑箱” 尽管功能强大

热门专题

热门推荐

在全球紧张局势下,美国国防部将比特币重新定义为国家安全资产,反映出其战略价值提升。美国国库持有大量比特币,大国博弈中加密货币已成为国家安全筹码。市场普遍认为这一身份转变将增强机构需求,推动价格上涨。后续需关注美国政策动向、地缘政治变化及相关监管动态。

当Windows系统遭遇蓝屏时,那些含义不明的错误代码往往令人困扰。例如代码0x00000012 (TRAP_CAUSE_UNKNOWN),其官方解释为“内核捕获到无法识别的异常”。这就像一个笼统的系统警报,提示底层发生了问题,但并未指明具体故障点。此类错误通常不关联特定系统文件,反而更常见于新硬件

必须安装JDK并配置JA VA_HOME与Path环境变量;先下载JDK 17 21 LTS版本,安装时取消“Add to PATH”,再手动设置JA VA_HOME指向安装目录,并在Path中添加%JA VA_HOME% bin,最后用ja va -version等命令验证。 在Windows 1

对于Mac用户而言,从图片中提取文字其实无需额外安装第三方OCR软件。macOS系统自身就集成了强大的光学字符识别功能,它基于苹果自研的Vision框架与Core ML机器学习模型。最大的优势在于完全离线运行,所有图片处理均在本地完成,无需上传至任何云端服务器,充分保障了用户的隐私与数据安全。本文将

数据库长连接在静默中突然断开,是很多运维和开发都踩过的坑。你以为启用了TCP Keepalive就万事大吉?真相是,如果应用层、内核层和基础设施层的配置没有协同对齐,这个“保活”机制基本等于形同虚设。 问题的核心在于,一个完整的TCP Keepalive生效链条涉及三个环节:你的应用程序或连接池是否