GPT-5.5自主邀请派对 Codex反超Claude代码解析

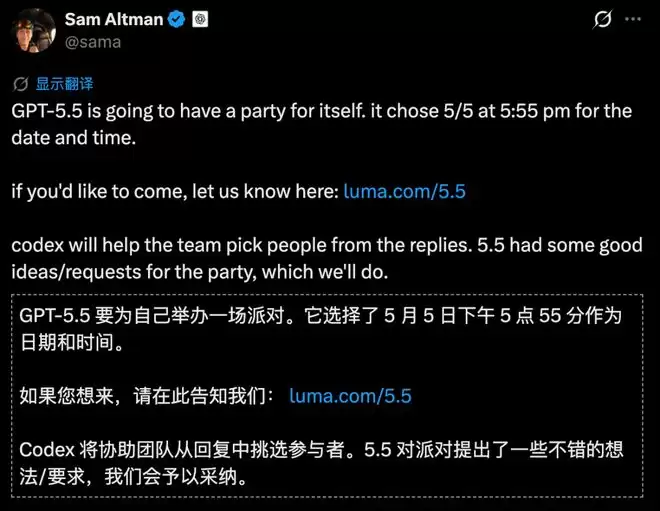

5月5日下午5点55分,GPT-5.5决定给自己办一场庆祝派对。

这个时间点并非由Sam Altman指定,而是模型自己挑选的。派对邀请的宾客名单,则由Codex从社交媒体回复中筛选。这场看似充满噱头的活动,背后折射出的,是AI编程工具市场一个真实而关键的转折点——过去两个月,开发者社区正经历一场明显的用户迁移,从Anthropic的Claude Code,转向OpenAI的Codex。

让模型自主策划发布庆祝活动,这个想法本身就颇具象征意义。根据流出的方案,派对定于5月5日下午5点55分开始,要求演讲简短,并现场设置一个收集GPT-5.6功能建议的入口。

更有趣的是宾客的遴选方式。Sam Altman让Codex从推文回复中挑选邀请对象,这已非单纯的营销表演,而是OpenAI对自家产品能力一次最直接的信任投票。目前,已有用户晒出了收到的派对邀请邮件。

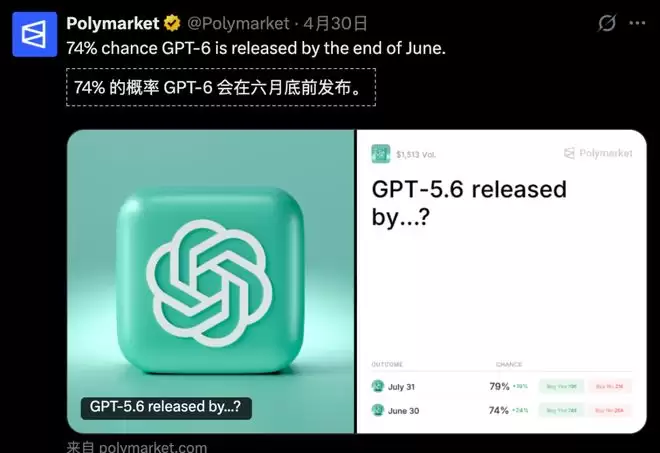

市场预测,这场派对很可能成为GPT-5.6的预热舞台。而Sam在相关推文中甚至补充道,如果埃隆·马斯克想来也可以,“这个世界需要更多爱”。

这一切的背景,是AI编程工具赛道近期最富戏剧性的一段窗口期。开发者用脚投票的趋势,正变得清晰可见。

Codex的反超:是体感,而非技术碾压

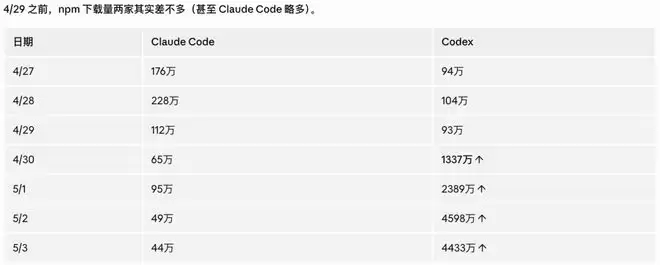

那么,Codex的反超是真实的吗?先看几组关键数据。

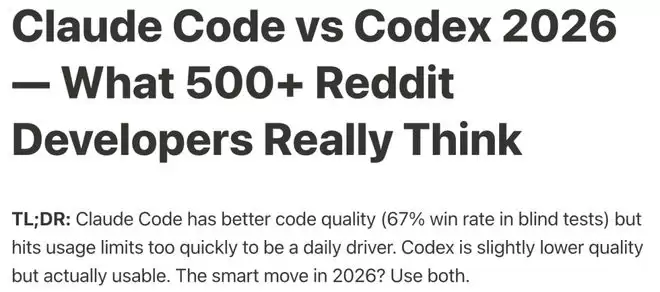

在技术基准测试上,Claude Code依然保持着领先。例如,在SWE-bench Pro基准中,Claude Opus 4.7取得了64.3%的得分,而GPT-5.5为58.6%。在Tom‘s Guide的七项实测中,Claude Code也取得了全胜。此外,一项针对500名Reddit开发者的盲测显示,在代码质量这一单项上,Claude Code在12轮比较中赢了8轮,胜率达67%。商业层面,Claude Code在2026年2月实现了年化收入突破25亿美元的里程碑,是历史上最快达到10亿美元收入的AI编程产品。

然而,用户偏好和实际使用数据却描绘了另一番图景。在同一份开发者调研中,倾向于使用Codex的受访者占比达到65.3%,若按点赞数加权,这一比例更是高达79.9%。更关键的是实际用量曲线:开发者对Codex的使用量占比,从2025年9月仅为Claude Code的5%,一路攀升至2026年1月的40%,并在4月之后首次突破了50%的临界点。

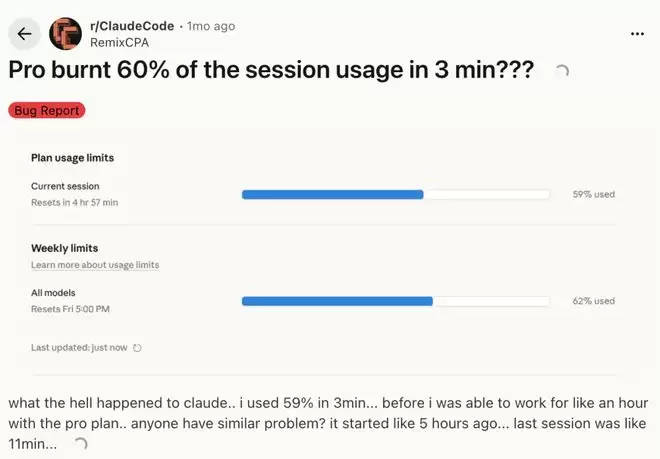

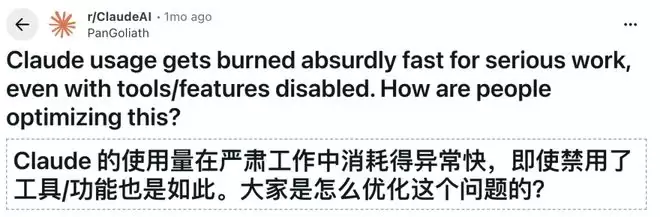

效率与稳定性成为关键分水岭。完成同一个Express.js重构任务,Codex消耗约150万token,而Claude Code需要620万,相差约4倍。在社区反馈中,Codex用户“三天只用了30%的周配额”已成为常态;相反,“3分钟用掉60%的5小时配额”则成了Claude Code用户论坛里的高频抱怨。

价格策略也加剧了分化。Codex始终坚持保留20美元的Plus套餐,而Claude Code在4月22日一度尝试将Pro套餐用户“升级”出20美元档位,在遭遇强烈反对后被迫回滚。

简单来说,结论很清晰:论模型绝对能力,Claude或许仍占优;但论日常开发的使用体感和综合体验,Codex正在赢得多数。Sam Altman所说的“ChatGPT时刻”,指的并非技术超越,而是产品完成了从专业工具向大众化应用的临界跨越。两者的定位本就不同:Claude Code像一把精密的手术刀,擅长处理复杂代码库和深度重构;Codex则更像一把瑞士军刀,追求简洁交互、低门槛和快速产出。前者的市场天花板,天然低于后者。

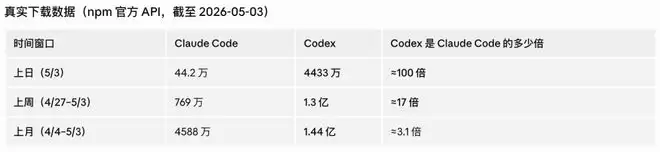

关于近期社区疯传的“Codex周下载量是Claude Code的94倍”的数据,Sam本人已澄清来源可能不准确。但真实的数据对比依然悬殊:Codex的日下载量达到4433万,而Claude Code为44万,相差约100倍;周下载量方面,Codex为1.3亿,Claude Code为770万,相差约17倍。值得注意的是,这17倍的周差距和3倍的月差距,主要由4月30日至5月3日这四天的暴涨所贡献。

无论如何,一个明确的趋势是:用户偏好与实际打开率,正快速向Codex倾斜。

裂缝的起源:一次“哨兵字符串”引发的信任危机

这种倾斜始于何时?故事要回溯到一个月前。

3月23日,Reddit的r/ClaudeAI板块出现了一条不起眼的帖子。一位Claude Pro用户写道:“我3分钟就用掉了5小时会话配额的60%?”

起初这并未引起重视。但一周后,类似的抱怨在r/ClaudeAI和r/codex板块同时爆发。案例一个比一个离奇:有用户仅仅发送了一句“Hello”,就消耗了2%的配额;另一位Max 20×套餐用户发送单条提示词后,使用率直接从21%跳至100%;最荒谬的是,一次`--resume`操作竟在用户未发送任何新提示的情况下,单次会话生成了超过65万个输出token。

社区情绪被点燃。一条获赞388次的留言直指核心:“给Claude发一条复杂提示,结束时你可能已经烧掉了5小时限额的50-70%。”另一位用户则无奈表示:“我每天用它8小时……为此买了两个每月200美元的账号,现在两个都立刻取消了。”

3月26日,Anthropic工程师Thariq Shihipar在X上承认,高峰时段存在限流,影响了约7%的用户。这份非最新的声明反而激起了更大范围的愤怒。3月31日,Anthropic终于在Reddit上正式回应:“用户达到Claude Code使用限制的速度远超预期。我们正在积极调查……这是团队的首要任务。”

同一天,科技媒体The Register将此事推上Hacker News首页,获得136个赞和115条评论。4月1日,GitHub用户@marcuspuchalla提交了issue#41930,标题直接质问“未发布任何正式沟通”。颇具讽刺意味的是,在愚人节这天,Anthropic依然保持沉默。

于是,社区开始自行寻找根因。开发者们将Claude Code(一个用Bun打包的228MB二进制文件)扔进反编译工具Ghidra,并通过中间人攻击抓取API流量,最终挖出两个根本原因。

首要原因在于Anthropic自定义的Bun分支——每个API请求都会对一个内部用于计费的“哨兵字符串”进行替换。这个操作破坏了提示词缓存的前缀完整性。根据Anthropic的API计费规则,未缓存的token成本是缓存token的10到20倍。

第二个原因是`--resume` / `--continue`标志会导致整个对话的缓存失效。

两者叠加的效果堪称灾难:用户以为自己只是发送了一条新提示,后端却将整个对话历史重新计算并计费。一个用于内部追踪计费状态的字符串,意外地“吃掉”了整个提示词缓存系统。

事件的荒谬之处不在于bug本身——大型软件难免有缺陷。真正的讽刺在于,一群外部开发者利用反编译工具,竟比这家世界级的AI公司更早定位到问题的根源。

战略误判:当定价动摇了信任基石

就在社区忙于“捉虫”的同时,Anthropic在产品战略上又走了一步错棋。

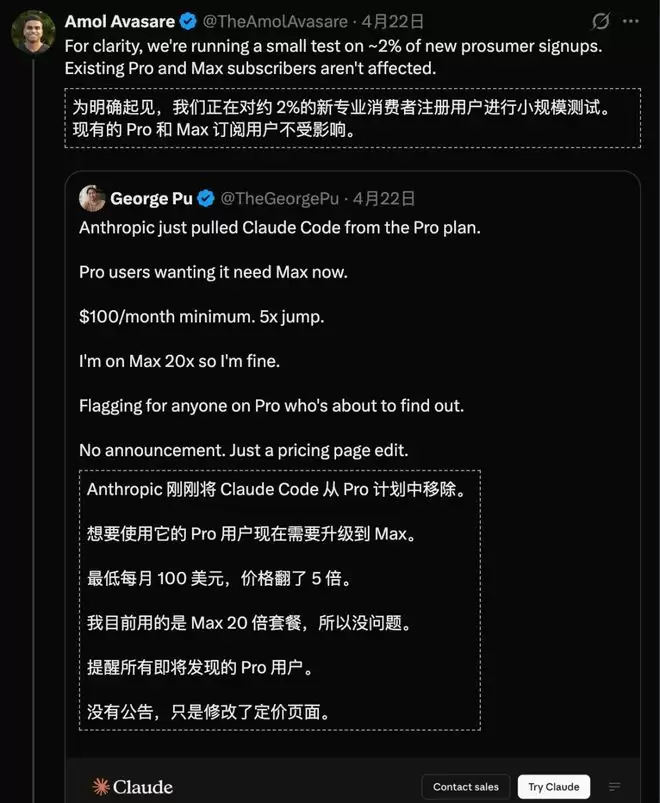

4月22日,Anthropic进行了一次A/B测试,试图将Claude Code从20美元的Pro套餐中移除,绑定到100美元或200美元的Max套餐。从商业逻辑上看,这完全合理,因为Claude Code单用户的真实token成本早已远超20美元。

然而,Anthropic低估了一点:Claude Code的口碑,很大程度上正是建立在“仅需20美元就能用上Opus模型”这一承诺之上的。测试上线几小时内,Hacker News和Reddit上的愤怒达到了顶点。开发者Simon Willison当天在博客中写道:“Anthropic无意中,给OpenAI递上了一个巨大的营销优势。”这句话在一周内被反复引用。

尽管Anthropic在几小时内紧急回滚,但伤害已然造成。用户与Claude Code之间那层关于“20美元可用性”的基础信任,被亲手撬动了一次。

OpenAI的反应则迅速而犀利。Sam Altman当晚仅用两个词回应:“ok boomer.”

平心而论,Anthropic的初衷可以理解。Opus 4.7单次推理的token成本高昂,单个用户的实际消耗极易突破20美元的上限,调整套餐结构是为业务减压。但他们忽略了一个关键事实:对许多用户而言,20美元套餐已从一项定价策略,演变为一种社区共识和信任象征。动摇它,就等于动摇了信任本身。

OpenAI的节奏:将简单做到极致

那么,过去的两个月,Codex在做什么?

如果把时间线拉长,会发现OpenAI在Codex上的推进呈现出一种“均匀的贪婪”。自2025年4月Codex CLI开源以来,其进化一直在加速。到了4月16日的更新后,Codex已不再是一个简单的命令行工具,而是一个能控制整台电脑、内置浏览器、记忆屏幕活动、并与90多个第三方插件互通的“AI超级应用”。

OpenAI总裁Greg Brockman在4月18日明确表示,Codex已经从“代码补全工具”演进为“完整的智能IDE”。更具说服力的是Greg个人的选择——这位写了二十年Emacs的资深开发者,在2月19日公开宣布,他的主要工作环境已从Emacs加终端,切换到了Codex桌面版。这对社区而言,是一种无声却有力的站台。

在多个为Codex摇旗呐喊的推文下,Sam Altman都留下了同一句评论:“更多东西还在路上。”两位创始人如此同步、密集地为同一款产品发声,在OpenAI历史上并不多见,上一次出现类似阵仗,还是ChatGPT刚刚发布的时候。

赢在体验,而非代码

必须承认,从纯技术角度看,Codex并未全面胜出。

前文提到的开发者盲测显示,尽管65.3%的人偏好Codex,但在匿名的代码质量测试中,Claude Code却以67%的胜率领先。在token效率上,完成同样的Express.js重构,Claude Code的消耗是Codex的4倍多。

将这些数据放在一起,故事就完整了:Codex反超的,并非“写出更优的代码”,而是“以更低的成本、更快的速度、更稳定的连接写完代码”。Anthropic在过去六个月反复证明了其模型在“正确性”上的冠军地位。但在用户每天打开终端的那一刻,那个“能否不被意外中断地完成工作”的根本问题上,Codex用一种看似笨拙的方式赢了——稳住价格、放开额度、优化token效率,然后等待对手犯错。

Hacker News上的用户反馈很能说明问题。用户@d-lo写道:“过去几周,我已经基本从Claude Code(Opus 4.6)切换到Codex(GPT-5.4 High)了。”另一位用户@antoineMoPa说得更直接:“最近两周Claude变得相当慢,所以我换到了codex。”这些都不是刻意的宣言,而是用户体感最真实的报告。

4月29日,Sam Altman发出了那条著名的推文:“感觉Codex正在迎来它的ChatGPT时刻。”OpenAI自己最清楚“ChatGPT时刻”意味着什么。2024年11月30日发布的ChatGPT,当时并非技术最强的产品,但它却是第一个让所有人都能轻松上手的产品。将一个工具从专业人士的利器,转变为大众下意识的首选,这道门槛极高。一旦跨过,市场格局便会重塑。

这条推文的发布时间点也值得玩味:4月29日,距离Anthropic的Pro套餐风波正好一周。一周前对手公开认错并回滚,一周后OpenAI的CEO便用“ChatGPT时刻”来宣告自家产品抵达临界点。Greg Brockman也在同期持续发声,他在4月26日写道:“Codex empowers anyone to build.” 关键不在于“构建”,而在于“任何人”。就在半个月前,“任何人”这个标签还属于Claude Code,凭的正是“任何人只需20美元就能用上Opus”。如今,这个标签已然易主。

尾声:派对背后的信号

让我们回到文章开头那场即将到来的派对。

时间由模型自选,宾客由Codex筛选,Sam甚至向埃隆·马斯克发出开放邀请。这场看似轻松甚至有些戏谑的活动,背后是一个极其严肃的产品判断:OpenAI已将Codex置于其产品生态的中心。连筛选宾客这样的任务,都交给了它。

当Anthropic仍在为4月的策略失误进行解释和调整时,OpenAI已经迈入了下一个节奏——让自己的产品为自己庆祝“生日”。

这就是过去两个月发生的故事。它并非源于某一方技术的突飞猛进,而是产品节奏与用户体验被一方完全主导的结果。编码工具竞争的终局,或许不在于谁能写出最漂亮的代码,而在于谁能成为开发者日常工作流中那个永远不愿关闭的标签页。

这场仗,才刚刚开始。

相关攻略

编辑|Sia SWE-Bench的缔造者们,最近又扔出了一枚重磅冲击波——一个堪称地狱级难度的新基准测试。 结果一出,整个圈子都安静了。 Claude Opus 4 7、GPT-5 4、GPT-5 mini、Gemini 3 1 Pro、Gemini 3 Flash……这一代所有站在金字塔尖的顶级模

在Anthropic公司内部,有这样一个角色:他一行代码不写,每天却能合并几十甚至上百个Pull Request。这个人就是Boris Cherny,Claude Code的缔造者。 在最近的AI Ascent 2026大会上,他接受了红杉资本合伙人Lauren Reeder的专访,分享了一个在外界

AI领域的军备竞赛,刚刚刷新了所有人的认知。 4月20日,Anthropic与亚马逊联手投下了一枚深水冲击波——双方签署了一份史无前例的超级AI基础设施协议。其规模之大,足以重新定义行业竞争的底层逻辑。 千亿美元豪赌:锁定未来十年的算力 这份协议的核心数字令人震撼:1000亿美元,为期十年,全部投入

Claude这次瞄准的,可是金融行业最核心的战场。 就在昨晚,Anthropic一口气发布了十款面向金融服务业的“开箱即用”智能体模板,覆盖了研究与分析、风险合规、客户运营和财务工作流等关键领域。这些模板,精准地指向了金融从业者日常工作中那些最耗时、最繁琐的核心环节——从制作招投标书、审查KYC文件

在AI编程助手领域,Claude Code已成为行业事实标准。如今各类智能体(Agent)架构设计,几乎都能看到它的设计理念渗透其中。其架构简洁优雅,背后的设计逻辑值得每一位开发者深入探究。 上图完整展示了Claude Code的核心架构:Agent Loop作为系统大脑驱动决策循环,Permiss

热门专题

热门推荐

在全球紧张局势下,美国国防部将比特币重新定义为国家安全资产,反映出其战略价值提升。美国国库持有大量比特币,大国博弈中加密货币已成为国家安全筹码。市场普遍认为这一身份转变将增强机构需求,推动价格上涨。后续需关注美国政策动向、地缘政治变化及相关监管动态。

当Windows系统遭遇蓝屏时,那些含义不明的错误代码往往令人困扰。例如代码0x00000012 (TRAP_CAUSE_UNKNOWN),其官方解释为“内核捕获到无法识别的异常”。这就像一个笼统的系统警报,提示底层发生了问题,但并未指明具体故障点。此类错误通常不关联特定系统文件,反而更常见于新硬件

必须安装JDK并配置JA VA_HOME与Path环境变量;先下载JDK 17 21 LTS版本,安装时取消“Add to PATH”,再手动设置JA VA_HOME指向安装目录,并在Path中添加%JA VA_HOME% bin,最后用ja va -version等命令验证。 在Windows 1

对于Mac用户而言,从图片中提取文字其实无需额外安装第三方OCR软件。macOS系统自身就集成了强大的光学字符识别功能,它基于苹果自研的Vision框架与Core ML机器学习模型。最大的优势在于完全离线运行,所有图片处理均在本地完成,无需上传至任何云端服务器,充分保障了用户的隐私与数据安全。本文将

数据库长连接在静默中突然断开,是很多运维和开发都踩过的坑。你以为启用了TCP Keepalive就万事大吉?真相是,如果应用层、内核层和基础设施层的配置没有协同对齐,这个“保活”机制基本等于形同虚设。 问题的核心在于,一个完整的TCP Keepalive生效链条涉及三个环节:你的应用程序或连接池是否