StarRocks 源码级排错与架构优化实战指南

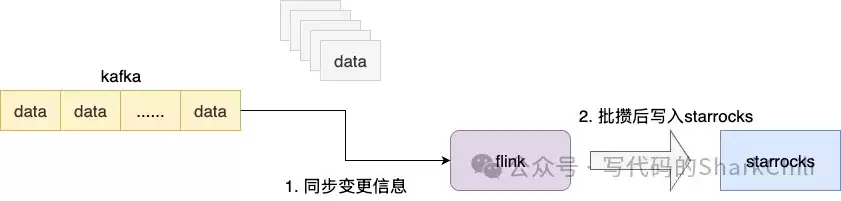

在构建一个处理海量交易数据实时聚合分析与报表查询的核心平台时,为了在保障查询性能的同时维护核心数据库的稳定性,团队在架构设计之初就引入了StarRocks作为专业的分析型数据库,并通过Flink实时监听MySQL的变更日志来完成数据同步。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

技术架构的演进是一个持续的过程。即使在人工智能技术日新月异的当下,重新审视并复盘那些经典的性能优化案例,仍然具有深刻的现实意义。这不仅涉及具体的技术实现,更关乎面对复杂系统性问题时,如何系统性地拆解、逻辑推理、做出决策并稳步推进的完整方法论。本文分享的案例,便是一次从线上异常告警入手,逐层深入剖析,最终实现架构调优与版本升级的全过程实践。

1. 项目背景与问题浮现

如前所述,该平台的核心目标是应对海量交易流水的实时聚合分析与多维度报表查询。为确保分析查询的高效性,并避免复杂的OLAP查询对核心交易数据库产生性能压力,团队选用了StarRocks作为独立的分析引擎。数据同步链路采用了业界成熟的“Canal监听MySQL binlog -> Kafka消息队列 -> Flink流处理 -> 写入StarRocks”的模式。

随着业务体量的稳步扩张,交易流水数据持续增长,报表查询业务开始间歇性地出现一个错误提示:The tablet write operation update metadata take a long time。此错误直接导致查询页面加载失败,严重影响了业务人员的数据获取体验与决策效率。

2. 问题排查与系统性优化

面对这一首次出现的性能问题,排查过程遵循了标准的“诊断-治疗”路径,从缓解症状到根治病因,逐步推进。

2.1 根因分析与应急处理

报错信息本身较为笼统,难以直接定位问题根源。因此,第一步是借助开源社区寻找线索。在StarRocks官方社区搜索相关错误后,结合团队内部Grafana监控面板上的关键指标(如写入QPS、FE负载等)进行交叉分析,初步判断问题与近期显著增长的数据写入频率密切相关。

核心推断如下:频繁的数据写入操作,导致StarRocks内部表的元数据版本更新异常活跃。当FE(前端节点)为查询请求生成执行计划时,需要获取一个全局一致的数据版本快照。如果在计划生成期间,恰好遭遇了数据写入引发的元数据变更,那么本次计划的版本校验就会失败,从而触发系统内置的重试机制。当重试次数达到上限后,便会抛出上述错误。

在明确大致方向后,首要任务是“快速止血”,以最小风险和最快速度恢复业务可用性。我们协调了相关服务负责人,制定了以下临时应对方案:

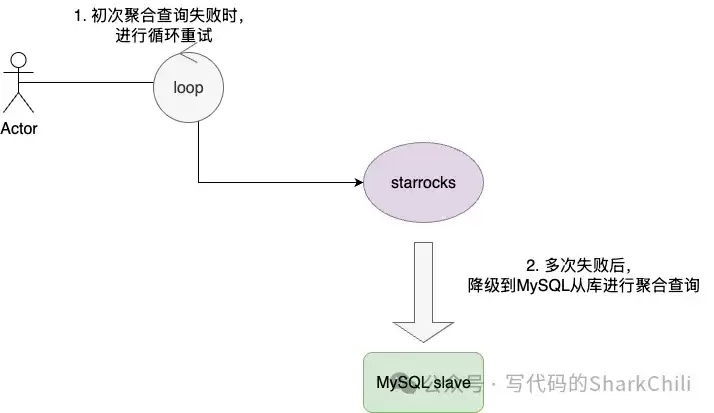

- 接口层自动重试:在所有报表查询接口中统一捕获该特定异常,并自动进行一次重试查询。

- 查询降级兜底:若自动重试后依然失败,则将查询请求降级路由至MySQL从库执行。尽管查询性能有所下降,但能确保报表数据始终可查,保障了业务连续性。

业务方在三天内完成了代码改造并上线。同时,我们在监控体系中新增了该异常的重试次数统计以及降级至MySQL的查询比例监控,用于实时评估问题严重程度并动态调整策略。

2.2 源码深度剖析与参数调优

临时方案稳定了业务,但并未触及问题本质。为了彻底根治,必须深入理解其内部运行机制。结合ELK日志系统中的详细错误堆栈,我们研读了StarRocks官方文档并分析了对应版本的源代码,最终厘清了完整逻辑。

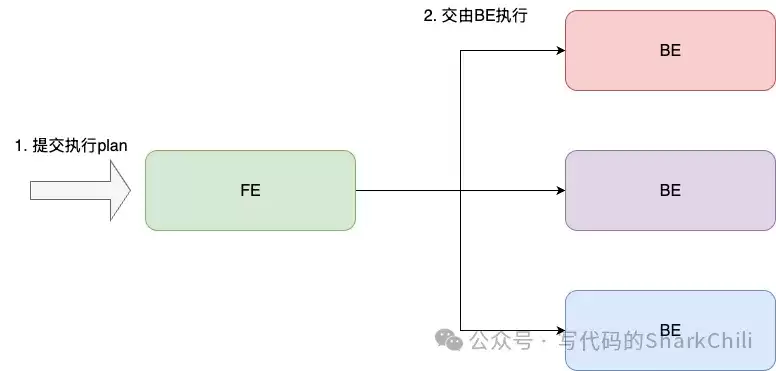

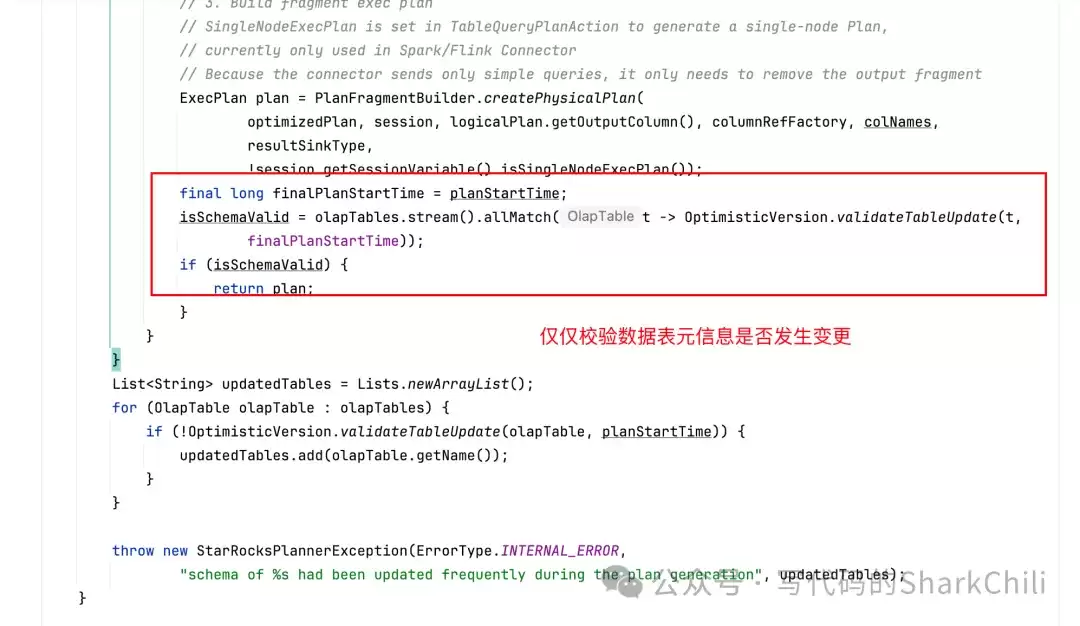

在StarRocks的分布式架构中,FE负责SQL解析、查询计划生成与集群元数据管理,BE则负责数据存储与计算执行。查询请求抵达后,FE会校验生成的执行计划,其中一个关键校验点是:计划构建期间,相关表的Schema或数据版本是否发生了变更。

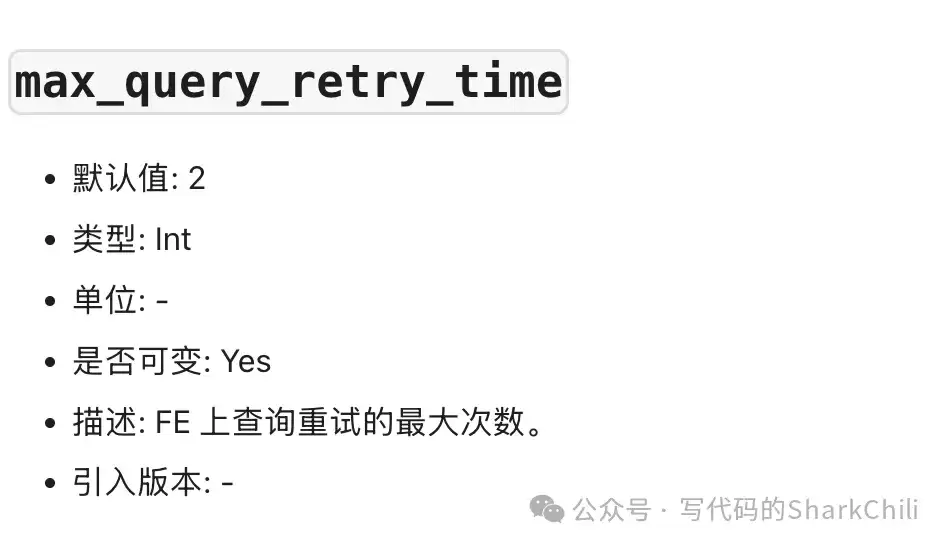

在StatementPlanner.createQueryPlanWithReTry方法中,我们找到了核心逻辑。该方法会根据系统参数max_query_retry_time(默认值为2)在计划校验失败后进行重试。每次重试前,如果检测到有数据表正处于更新状态,线程会休眠10毫秒(对应publish_version_interval_ms配置)。若重试次数耗尽仍未获得有效的计划快照,则抛出我们观察到的错误。

// StatementPlanner 核心逻辑

// 1. 执行计划重试循环,默认最多重试2次(由 max_query_retry_time 控制)

for (int i = 0; i < Config.max_query_retry_time; ++i) {

long planStartTime = OptimisticVersion.generate();

// ... 生成逻辑计划、物理计划、执行计划

// 5. 关键校验:检查计划生成期间表的 Schema 是否发生变化

isSchemaValid = olapTables.stream().noneMatch(t -> t.lastSchemaUpdateTime.get() > planStartTime);

// 6. 二次校验:检查表的版本更新是否在计划构建期间完成

isSchemaValid = isSchemaValid && olapTables.stream().allMatch(t ->

t.lastVersionUpdateEndTime.get() < buildFragmentStartTime &&

t.lastVersionUpdateEndTime.get() >= t.lastVersionUpdateStartTime.get());

if (isSchemaValid) {

return plan; // 校验通过,返回执行计划

}

// 7. 如果检测到有表正在更新中,等待10ms后重试

if (olapTables.stream().anyMatch(t -> t.lastVersionUpdateStartTime.get() > t.lastVersionUpdateEndTime.get())) {

Thread.sleep(10);

}

}

// 重试次数耗尽,抛出异常 → 页面崩溃

Preconditions.checkState(false, "The tablet write operation update metadata " +

"take a long time");通过查看max_query_retry_time参数的元注解@ConfField(mutable = true),确认其支持动态修改。结合前期埋点的监控数据分析,我们发现多数失败的查询在重试大约4次后能够成功。因此,我们将该参数从默认值2动态调整为5,显著提升了在高并发写入场景下查询计划的成功率。

2.3 架构级优化:从数据写入源头治理

参数调优虽然有效,但重试本身意味着额外的查询延迟和系统开销。为了追求更稳定、更高效的准实时分析体验,我们需要从问题的源头——数据写入频率上进行根本性治理。

我们的数据写入链路是:Canal监听MySQL -> Kafka -> Flink攒批后写入StarRocks。Flink任务配置了攒批大小(例如15000条),理论上,每分钟约10万条的写入量,触发写入StarRocks的次数应在10次左右。但监控数据显示实际写入频率高达每分钟50次左右。

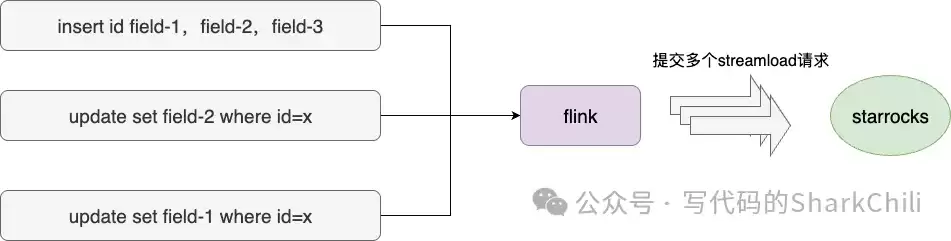

经过深入分析,发现问题根源在于数据同步时的“列对齐”要求。StarRocks的Stream Load接口要求单次写入请求中的所有数据行必须包含完全相同的列集合。而我们的业务表字段较多,不同的业务操作可能只更新其中部分字段。当Flink攒批的15000条数据中,混杂了针对不同字段集合的更新操作时,就必须按照字段集合拆分成多个独立的Stream Load请求分别写入。

更深层的原因是,运维部门出于稳定性考虑,将MySQL的binlog格式设置为STATEMENT模式,而常见的同步组件通常只同步发生变更的列(而非整行数据),这进一步加剧了列集合的分散程度。

解决方案是:在binlog同步阶段进行“全列补齐”。我们调整了数据同步逻辑,确保每一条变更记录都携带数据行的所有列信息(可通过监听ROW格式的binlog或在后处理阶段补齐实现)。这样一来,Flink攒批的数据列集合始终保持一致,单次攒批只需发起一个Stream Load请求即可完成写入。

此项优化效果立竿见影。写入StarRocks的频率从每分钟50次大幅下降。随后,我们逐步将max_query_retry_time参数从5回调至3,线上报错仅偶发出现数次,达到了业务可接受的范围。同时,由于写入请求的合并,数据同步的整体延迟也得到了显著降低。

2.4 终极解决方案:版本升级

为了彻底解决偶发的重试问题,我们将目光投向社区新版本。在StarRocks 3.2及以上版本中,社区修复了相关问题,优化了查询计划生成阶段的版本校验逻辑,使其在频繁写入场景下更加健壮。

我们采取了稳健的升级策略:首先搭建一个基于新版本的备库,通过灰度方式将部分查询流量切换至新集群,进行充分的兼容性与性能测试。在确认新版本运行稳定且仅存在少量SQL语法需要适配后,规划了深夜停机窗口,通过“全量数据同步 + 离线数据补全 + 调整Flink消费偏移量”的组合方案,完成了生产环境的平滑升级与数据一致性订正。

3. 线上效果验证

经过为期一个月的持续监控与观察,优化效果符合甚至超出预期:

- 问题根治:报表查询服务未再出现因Plan版本校验失败而导致的页面崩溃错误。

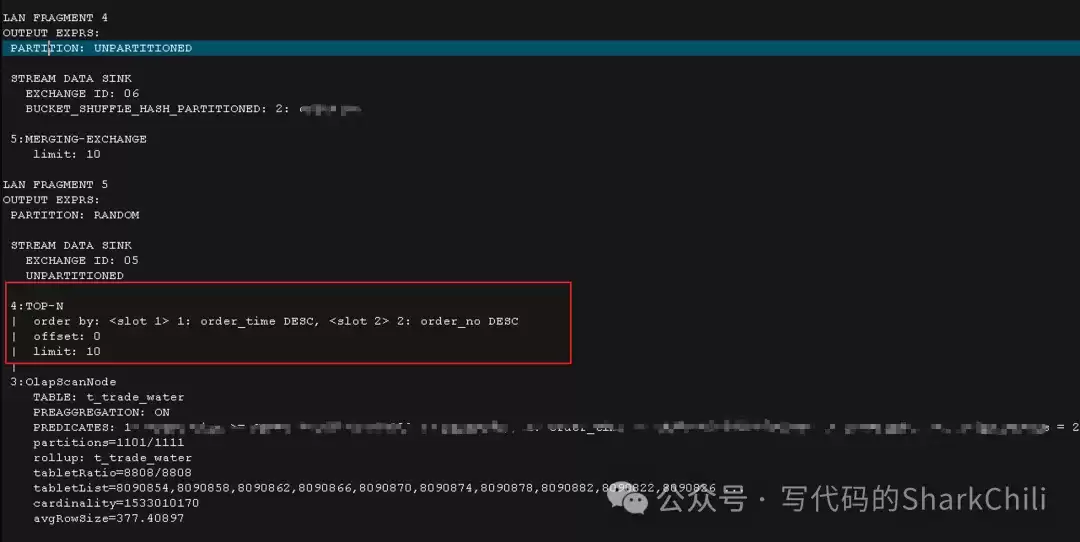

- 性能提升:升级至新版本后,部分复杂查询性能得到额外优化。例如,新优化器对包含

LIMIT的查询进行了智能优化,支持先获取LIMIT结果再进行表关联,避免了全量关联带来的巨大计算开销。

-- 示例:关联查询后取前10条

SELECT t.column_list

FROM t_trade_detail t

LEFT JOIN t_pay_config pp ON t.order_no = pp.order_no

AND pp.created_time >= '20260106000000'

AND pp.created_time <= '20260106235959'

LEFT JOIN t_customer_info s ON t.cust_id = s.cust_id

WHERE t.trade_time >= '20260106000000'

AND t.trade_time <= '20260106235959'

AND t.status IN ('2')

ORDER BY t.trade_time DESC, t.order_no DESC

LIMIT 10

4. 常见问题解答 (FAQ)

Q1: StarRocks的FE和BE分别负责什么?查询执行计划在哪个节点生成?

A: FE(Frontend,前端节点)负责SQL解析、查询计划生成、元数据管理与集群协调;BE(Backend,后端节点)负责数据存储和查询计算执行。查询执行计划在FE节点生成。

Q2: 为什么数据写入会干扰查询计划生成?底层机制是什么?

A: StarRocks通过“发布版本”机制实现数据写入,每次成功写入都会更新对应Tablet的元数据版本。FE生成查询计划时需要获取一个全局一致的版本快照。如果数据写入过于频繁,版本持续快速迭代,可能导致计划生成期间无法捕获到稳定的快照,从而校验失败并触发重试。

Q3: 你们的StarRocks生产环境部署架构是怎样的?

A: 我们采用3个FE节点(1个Leader + 2个Follower)和3个BE节点的集群架构。FE负责查询计划和元数据服务,BE负责数据存储与分布式计算。

Q4: 升级到StarRocks 3.x版本有没有遇到兼容性问题?

A: 系统层面的升级过程平稳。主要遇到的是新版优化器对SQL语法检查更为严格,导致部分历史遗留的SQL语句需要微调。这些问题在准生产环境的灰度测试阶段均已发现并完成适配。

Q5: 除了调整重试参数,StarRocks还有哪些常用的查询性能优化手段?

A: 常见的优化手段包括:创建物化视图进行预聚合、使用Colocate Group(协同定位组)减少数据Shuffle网络开销、利用分区和分桶裁剪减少数据扫描量、启用Bucket Shuffle Join优化关联查询、以及合理的索引设计等。

5. 项目复盘与经验总结

回顾这次完整的性能优化历程,其价值远不止于解决了一个具体的StarRocks报错。它完整地展示了一个典型线上技术问题的标准化处理范式:

- 应急响应与业务止血:快速评估问题影响范围,制定风险最小的临时方案,优先保障核心业务的连续性。

- 深度根因分析:不满足于表面解决,结合系统日志、监控指标、社区经验,并深入源码理解内部运行机制,定位问题本质。

- 分层递进优化:从参数调优(快速缓解),到架构梳理(解决根本),再到版本升级(彻底根治),层层递进,每一步都充分评估了收益与潜在风险。

- 效果闭环与长期验证:通过监控数据量化优化效果,通过灰度测试验证新方案的稳定性,最终实现平滑上线与长期效果观测。

具体的技术细节会随着版本迭代而更新,但这种面对复杂系统性问题时,结构化拆解、步步为营、追求根治的解决思路,是更具普适性和长期价值的经验。希望这个案例的完整推演过程,能为各位工程师处理类似的数据库性能优化与架构调优问题,提供一个可参考的实战框架。

相关攻略

在构建一个处理海量交易数据实时聚合分析与报表查询的核心平台时,为了在保障查询性能的同时维护核心数据库的稳定性,团队在架构设计之初就引入了StarRocks作为专业的分析型数据库,并通过Flink实时监听MySQL的变更日志来完成数据同步。 技术架构的演进是一个持续的过程。即使在人工智能技术日新月异的

多台 OpenClaw 互联:构建你的分布式智能体集群 想让多台机器协同工作,发挥出“1+1>2”的效能吗?OpenClaw 的集群互联功能,正是为此而生。其核心架构非常清晰:一个 Gateway(主节点 中心) 加上 N 个 Node(工作节点),各司其职,共同构成一个高效的分布式系统。 Gate

阿里组织架构调整!升级通义大模型事业部 CTO集结成团 就在今天,阿里巴巴集团CEO吴泳铭的一封内部信,透露了公司新一轮的组织架构调整。核心指向非常明确:集中火力,加速在AI领域的战略布局。 根据这封内部通知,此次调整的关键动作,是在集团层面新设了一个技术委员会。这个委员会的“班长”由吴泳铭亲自担任

Docker 跨平台镜像迁移:从理论到实战的完整指南 在云原生和混合架构日益普及的今天,Docker 镜像迁移——尤其是跨平台迁移——已成为一项常见却颇为关键的运维操作。无论是为了提升国内访问速度,还是为了将公共镜像纳入私有化资产管理,你都需要一套可靠且高效的迁移方案。今天,我们就来深入聊聊,如何将

OpenClaw中为每个Agent配置独立工作区的最佳实践 在大模型智能体协作平台上,实现多个Agent之间的文件隔离是确保项目管理井然有序的关键需求。如果您正在使用OpenClaw平台,为不同角色的智能体分配专属工作空间可以有效避免文件冲突、权限混乱等问题。本指南将详细介绍在OpenClaw中为每

热门专题

热门推荐

这项由清华大学、美团、香港大学等多家顶尖机构联合开展的研究,于2026年3月以预印本论文(arXiv:2603 25823v1)的形式发布。它直指当前AI视觉生成领域一个被长期忽视的核心问题:这些能画出“神作”的模型,到底有多“聪明”?研究团队为此构建了一套全新的测试基准——ViGoR-Bench,

人工智能的浪潮席卷了各个领域,机器在诸多任务上已展现出超越人类的能力。然而,有一个看似寻常却异常复杂的领域,始终是AI研究者们渴望攻克的堡垒——让机器像真正的学者那样,撰写出一篇结构严谨、逻辑自洽、图文并茂的完整科学论文。这远比下棋或识图要困难得多。 2026年3月,一项由中科院AgentAlpha

这项由法国Hornetsecurity公司与里尔大学、法国国家信息与自动化研究院(Inria)、法国国家科学研究中心(CNRS)以及里尔中央理工学院联合开展的研究,发表于2026年3月31日的计算机科学期刊,论文编号为arXiv:2603 29497v1。 在信息爆炸的今天,我们每天都在网上留下数字

当你满怀期待地拆开一台全新的智能设备,最令人困扰的往往不是如何使用它,而是如何让它真正“理解”指令并智能地执行任务。如今,一个更为优雅的解决方案可能已经出现。来自清华大学深圳国际研究生院与哈尔滨工业大学(深圳)的联合研究团队,近期取得了一项极具前瞻性的突破:他们成功训练人工智能自主“撰写”并精准理解

2026年3月,来自华盛顿大学、艾伦人工智能研究所和北卡罗来纳大学教堂山分校的研究团队,在图像智能矢量化领域取得了一项突破性进展。这项研究(论文编号:arXiv:2603 24575v1)开发了一个名为VFig的AI系统,它能够将静态的栅格图像智能地转换为可自由编辑的矢量图形,如同一位“图形考古学家