面壁曾国洋专访:千次模型试炼打造高效性能小钢炮

2024年2月1日,成立仅一年的面壁智能,在AI领域投下了两颗重磅成果——面壁MiniCPM 2B旗舰端侧大语言模型与面壁OmniLMM多模态大模型,引发了业界广泛关注。

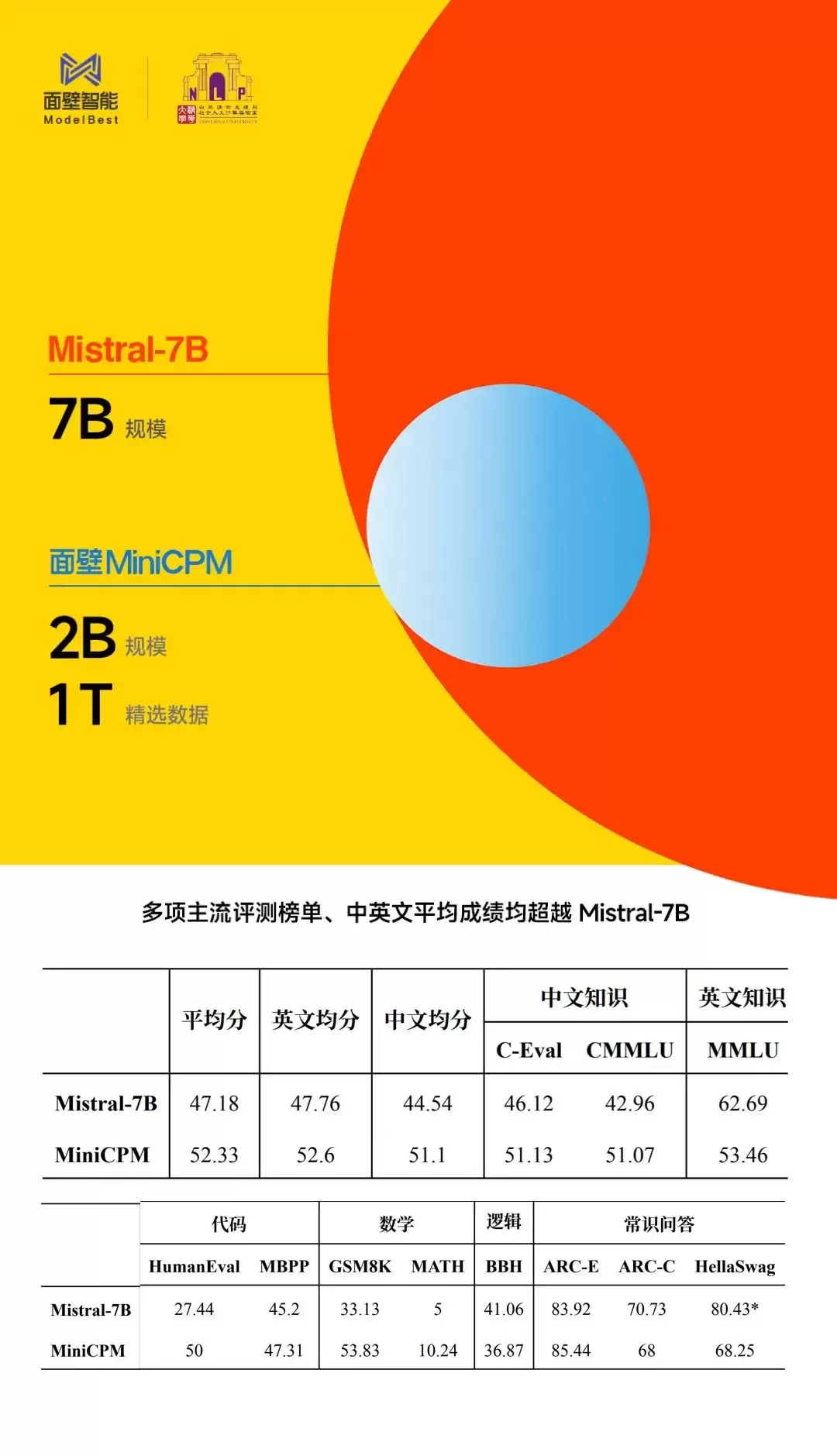

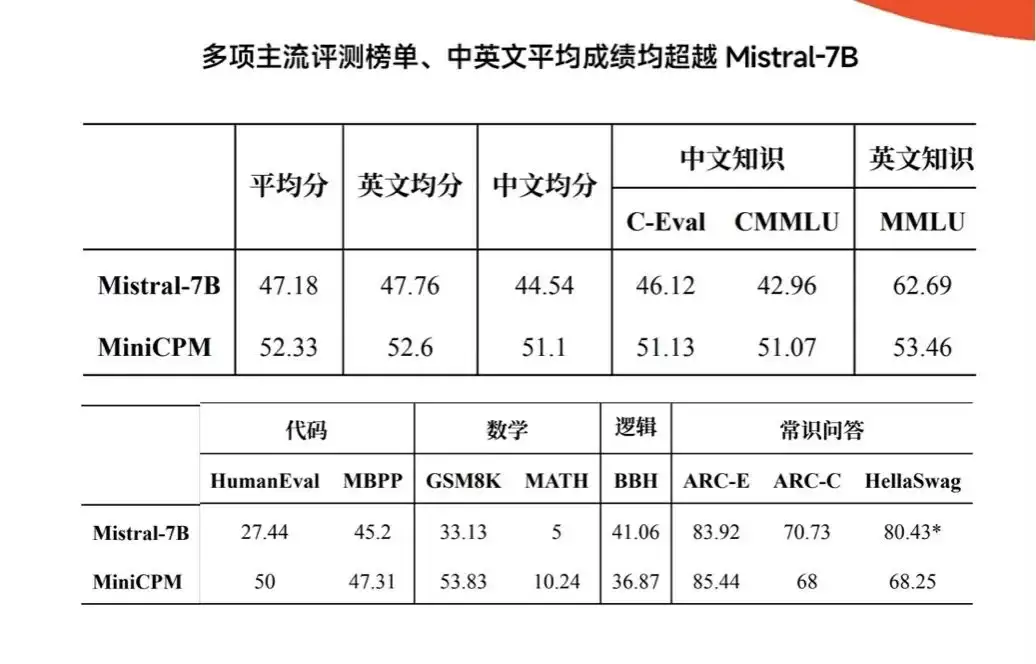

其中,MiniCPM 2B凭借其卓越表现,被冠以“小钢炮”的美誉。其惊人之处在于,仅以20亿参数规模与1万亿tokens的精选训练数据,便在多项权威的中英文评测基准中,平均成绩超越了参数量达70亿、被誉为“欧洲最佳大模型”的Mistral-7B,实现了显著的效率突破。

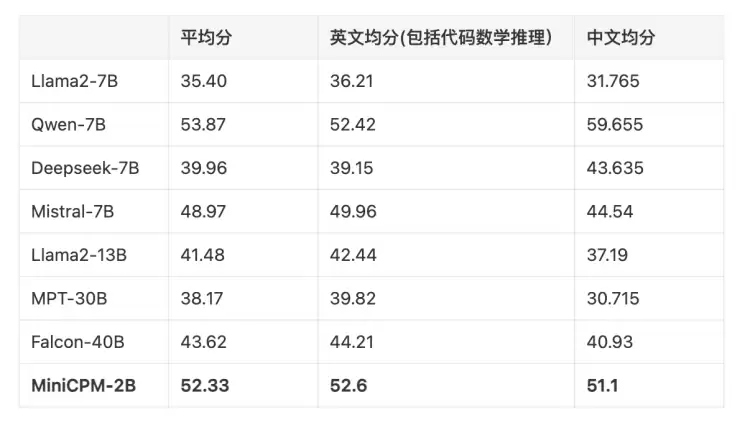

横向对比同量级模型,面壁MiniCPM 2B的性能优势依然明显,大幅领先于Llama2-7B、Mistral-7B、Gemini Nano、Qwen-1.8B等知名模型。更令人瞩目的是,它甚至能够越级挑战参数量远超自身的Llama2-13B、Falcon-40B和Cohere-54B等大模型,展现了非凡的“以小搏大”能力。

可以说,这颗“2B小钢炮”的发布,其影响力不亚于当年Mistral-7B的问世,为端侧大语言模型的商业化落地与普及打开了全新的想象空间。

“用最小的规模,做最强的AI”

端侧部署、极致高效、以小搏大——这是面壁智能CTO曾国洋为本次发布总结的核心关键词。

其中,“高效”理念已深入这家公司的技术基因。这不仅体现在训练与推理速度上,更体现在极致的参数效率上——用更小的模型体量,达成更优的性能表现。此前,Mistral-7B曾以7B参数超越13B模型,而面壁团队则将这一极限进一步推进,“为了充分展示我们的效率优势,我们实现了用2B模型性能超越Llama的13B模型,高下立判。”

辉煌成绩的背后是海量的技术实验与调优。在过去数月里,研发团队进行了上千次实验与模型沙盒测试,不断搜索最优的训练技巧与超参数组合。最终,他们锁定了一组“黄金参数”,并以此训练出2B的MiniCPM进行验证。结果证明这条技术路径是成功的,在涵盖11项的主流综合测评中,其平均成绩确实超越了Mistral-7B。

在与国内外同尺寸模型的性能对比雷达图中,MiniCPM-2B的综合评分同样处于全面领先地位。

“小钢炮”是如何炼成的?

面壁智能能在小模型赛道实现“以小博大”,首先得益于其全流程高效的基础设施(Infra)。其全栈优化工具平台“面壁ModelForce”,整合了训练框架BMTrain、推理框架BMINF、压缩框架BMCook和微调框架BMTune,宣称可降低90%的训练成本,并实现10倍的推理加速。

其次,是独特的“模型沙盒”迭代机制。该机制在大模型与小模型之间形成了高效的协同训练与性能预测循环。小模型可以预测大模型的性能趋势,大小模型共享超参数方案,从而实现接近Cerebras-GPT的超参稳定性,并精准定位最优的批次大小与学习率。同时,固定模型倍增上限的设计,使得训练可以随时中断,都能获得当前计算资源下的最优模型。

在数据层面,团队构建了从数据治理、清洗到多维评测的完整闭环,驱动模型版本快速迭代,堪称一个现代化的“数据工厂”。

不止于语言:全面的能力与端侧落地

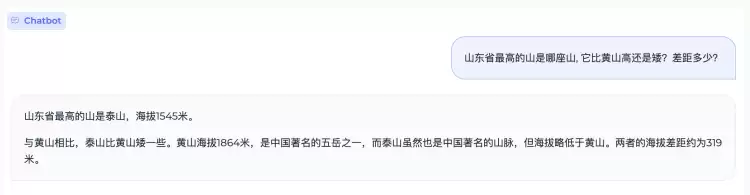

在实际能力上,面壁MiniCPM在语言理解、代码生成及多模态感知上均表现优异。它具备更全面的通用能力与中文优化,其对话模型响应流畅,在贴近人类偏好的MT-Bench评测中获得高分。编程能力上,它甚至能自主编写代码,表现超越了Mistral。此外,它还创新性地实现了多模态能力在手机端的首批部署,拥有当前同量级模型中最强的图文理解与交互表现。

发布会现场,面壁智能CEO李大海实时演示了MiniCPM-2B的具体能力。在对话响应速度上,它与真人反应几乎同步;而在模型普遍面临的复杂逻辑推理问题上,它也能给出准确、结构化的解答。

“小钢炮”的性能突破,其意义远不止于榜单排名的提升。它使得普通消费级终端设备也能本地化部署强大模型,极大地拓展了大模型的应用边界与落地场景。

在大模型时代,AI原生(AI native)是必然趋势。面壁智能在实现MiniCPM-2B的卓越性能后,坚定选择了“用最小的规模,做最强的AI”这条技术路径。更重要的是,端侧模型蕴含着巨大的商业价值。它让在终端设备上开发AI应用从构想变为现实,智能终端全天候在线的特性,也让许多离线、实时、隐私敏感的应用场景变得更加可行。

成本优势与双引擎战略

除了性能强悍,“极致成本”也是小钢炮的核心优势。它能够以极低的资源消耗支持CPU推理,1元成本即可处理约170万tokens。团队内部甚至用“废卡拯救计划”来形容他们对计算资源的极致利用——仅用1张显卡就能完成全参数微调,让消费级显卡也能训练大模型。

面壁MiniCPM的量化版本,在模型体积上压缩了高达75%,但性能基本无损,并且成功适配了国际主流手机与终端设备的CPU芯片,即便是发布多年的老机型也能流畅运行。

基于足够强大的模型性能,面壁智能同步推出了“大模型+智能体(Agent)”的双引擎战略。目前,团队已经在智能体技术上进行了一系列前沿探索,如XAgent、ChatDev和AgentVerse等项目,正积极推动智能体技术走向更广泛的实际应用。

先踩1000次坑,而后以小搏大

“在技术上,我们并非追赶者,而一直是领先者。”面壁智能联合创始人、清华大学长聘副教授刘知远在发布会上自信地表示。这份底气,源于团队深厚且持续的技术积淀。

面壁的科研团队由刘知远教授带领,其技术方向经历了四次关键演进,且均经过了时间与实践的检验:从深度学习、BERT预训练模型、大语言模型到智能体(Agent)。团队源自清华大学自然语言处理实验室(THUNLP),早在2018年BERT问世后便深耕预训练模型研究,2019年推出了全球首个知识增强的预训练模型“ERNIE”。2020年GPT-3发布后,他们也是国内首批全面投入大模型研究的团队之一。

2020年,团队深度参与智源“悟道”大模型项目,负责其中的“文源”中文大模型,先后推出了CPM 1.0与千亿参数的CPM 2.0。2022年,团队将高性能计算与大模型训练深度融合的方法发表于《Nature Communications》,是国内最早在大模型训练中系统引入分布式加速算法的团队之一。

尽管公司成立时间不长,但核心成员可谓身经百战。从CPM 1、2、3到CPM-Ant、CPM-Bee、CPM-Cricket,再到如今的MiniCPM,团队核心成员全程主导。事实上,MiniCPM可被视为CPM-D系列中的一个关键中间实验版本。

曾国洋透露,除了成功发布的模型,背后也曾“训崩”过许多模型。“大模型训练极度依赖经验积累。那些难以用技术语言精确描述的‘手感’和‘经验’,比如训练过程中对各类异常的处理、对数据质量和训练动态的深刻认知,才是成功的关键。”团队积累下来的异常处理经验、数据选择的直觉——这些看不见的“内功”,构成了他们坚实的技术壁垒。

正如团队中被戏称为“模型料理三星主厨”的胡声鼎所言:即使将训练大模型的步骤详尽记录,其他团队也未必能完全复现,这其中更多是一种融合了直觉与经验的艺术。好比拿到了米其林三星主厨的精确菜谱,也不一定能烹制出同等水准的菜肴。

除了经验,团队也开创了独有的新技术,例如其自主研发的WSD学习率调度器,相较于常见的cosine调度器就展现出一定优势。团队已经探索出如何将全局最优与局部最优的训练阶段进行区分,从而在局部最优阶段让模型吸收更有效的知识信息。

对团队而言,研发千亿大模型与二十亿小模型在核心方法论上并无本质区别,无非是启动“1000亿”和“20亿”参数规模的区别。这次发布的2B模型,正是“模型沙盒”机制下成千上万次实验结晶的产物。相比于主流方案,他们在超参调整、训练策略等方面做了大量创新性改进,使得无需在超大模型上反复耗费资源调优,就能获得优秀结果。正是靠着“踩过无数坑并系统总结”的坚韧,团队打磨出了独特的技术能力。

在大模型起步的早期,曾国洋曾连续数月高强度工作而不知疲倦,“因为我深信AGI(通用人工智能)终将实现”。整个面壁团队对AGI怀有宏大的愿景,刘知远教授也表示:“实现AGI需要我们去攻克什么,我们就去做什么。”

对话面壁智能CTO曾国洋:效率、边界与未来

问:“高效”是面壁团队的基因或核心追求吗?

曾国洋:是的,我们始终将“极致效率”作为核心追求。较早时期我们就投入了大量基础设施(Infra)的研发工作,正是这一理念的体现。国内大模型发展曾经历过盲目追求参数规模的阶段。但行业后来意识到,当参数规模大到一定程度后,若无法高效落地应用,其实际意义有限。对于落地而言,效率是关键,需要通过成本控制来达成更优效果,从而扩展应用边界。大模型的应用价值,可以理解为它创造的总价值减去其总成本。我们追求效率,本质上就是为了降低成本、提升价值,从而不断拓宽其应用边界。

问:为什么选择让MiniCPM最初就瞄准端侧应用场景?

曾国洋:一方面是希望用小规模模型来验证我们通过“模型沙盒”得到的最优参数方案的有效性;另一方面,近期端侧模型确实备受产业关注。我们发现2B这个规模的模型恰好能够流畅运行在各种主流终端设备上。它本身是对我们整体训练技术的一次重要验证,证明了现有技术栈确实能训练出高性能的小模型。同时赶上这个时间节点,我们就思考,能否真正让大模型在手机上跑起来,从而催生一些新颖、有趣的原生应用。

问:如果2B模型已经能满足很多需求,是否没有必要研发更大参数的模型了?

曾国洋:我们的策略是“两端发力”。一端是极致的小规模模型,它能以更低的成本、更快的速度进行技术验证与迭代。另一端是探索更大规模的模型,我们会将效率优化做到极致,即在可控的成本范围内,探索当参数量继续扩大后,模型性能的理论上限。这是一个兼顾探索与落地的双线方案。

问:“以小搏大”会成为未来大模型研究的主流趋势吗?

曾国洋:实际上,行业内各家都在朝这个方向努力。只是我们在这方面的投入和成果更为突出,所以效果显得格外明显。换句话说,效率优化——即用更小的规模、更低的成本达到同等甚至更好的效果——已成为共识。在这条赛道上,我们和其他优秀同行都会持续深耕。

这次的2B模型成果告诉我们,大模型技术仍有巨大潜力有待挖掘,2B模型的性能极限也远未触及。也许未来一到两年,我们就有机会看到能在终端设备上本地运行、性能对标当前GPT-3.5 Turbo水平的模型。我们通过大量实验发现,可探索的技术点非常多,每向前探索一步,模型的效果和效率都在提升。同时,各大手机与硬件厂商也开始高度重视端侧大模型。未来一两年,模型侧技术将持续突破,硬件算力也会同步迭代,我对此持乐观态度。

问:这些待挖掘的潜力具体体现在哪些方面?

曾国洋:训练了众多模型后,一个直观的感受是,即使模型规模保持不变,其效果也在飞速进步。例如2020年底我们训练的第一个CPM-1模型,参数量和今天的MiniCPM相近,但在实际使用体验上,MiniCPM有了质的提升。

在训练技术侧持续深挖,还有非常大的提升空间。比如我们做Int4量化,发现从16比特降到4比特,模型效果几乎无损,这说明模型内部还存在“冗余”或未充分激活的能力。无论是预训练技术、架构设计还是数据工程,都还有广阔的潜力可以挖掘。

问:您遇到过哪些印象深刻的非技术类挑战?

曾国洋>模型训练中最常见的问题是损失(loss)不收敛,训练过程中突然“发散”。很多人遇到loss发散会去反思并积累经验。但我们因为经历过太多次训练失败,发现往往不是单一原因导致的,可能是多种不同的意外情况或潜在缺陷,最终导致了同样的失败表象。很难用一种固定的手段去修复,因为根源多种多样。

必须逐一排查,找到根本原因,才能彻底解决。但从公开的经验分享看,大家遇到这类问题,通常笼统地建议“跳过一段数据”或“调整学习率”等。更根本的解决方法,依赖于持续、大量的实践积累。就像走路摔跤,原因可能是鞋带松了、路面有坑,或者踩到了香蕉皮。只有都经历过,才知道有这么多不同的方式会导致失败。

问:作为一款端侧大模型,MiniCPM有什么独特的竞争优势?

曾国洋:模型能力越强,其创造的价值就越高。我们在2B模型上实现了媲美Mistral-7B的效果,这本身就极大地扩展了其应用边界。像Mistral-7B这样的模型,以往必须在GPU服务器或云端运行,这限制了它的应用范围,因为并非所有用户都拥有GPU资源。

而2B模型则没有这些限制,甚至可以直接在手机上运行。未来它可能直接内嵌在手机系统或封装进独立应用,以更轻便的方式部署在各种设备上,开发者无需考虑用户端是否有GPU。这让大模型有了更广阔的实际应用空间。

以前我用Mistral-7B开发应用,需要自己部署服务器,用户才能连接使用。现在我可以把2B模型直接打包进APP,发布到用户手机,用户离线也能使用。这大大降低了开发者的部署与运维成本,也让模型能在更多场景下使用,比如手机、汽车、智能音箱等,让万物在低功耗芯片上拥有本地智能。这也契合了“智能体互联网”(Internet of Agents)的愿景,能发挥群体协作与更强大的涌现智能。

问:为什么面壁如此重视并投入智能体(Agent)技术?

曾国洋:我们的核心认知是,一方面我们通过MiniCPM等项目在持续降低大模型的使用成本,另一方面也在不断扩展其能力边界与应用价值。Agent技术正是能让模型创造更多价值的关键技术,因此我们非常看重。

大模型如同人的大脑,具备智能的决策、认知与判断能力。但仅有大脑,能做的事情是有限的。Agent技术相当于为它接上了“双手”和“感官”,让它能够调用外部工具、访问实时知识、与环境交互。我们认为,未来Agent技术还将持续进化,让模型能像人一样真正进行思考、接受反馈、自我演进,甚至实现智能体间的高效协作。这是我们对其未来的展望,坚信这是一条极具前景的技术路线,因此投入了大量资源进行探索和研究。

当然,Agent作为新兴技术,目前尚未有非常清晰、固定的发展蓝图,或者说没有人能笃定它一定能以某种形态成功。但我们相信,朝着这个方向深入探索是正确的选择。

问:面壁的产品线涵盖了AI基础设施、大模型、Agent及上层应用,公司是否有明确的侧重点?

曾国洋:虽然看起来是几条不同的产品线,但在我心中这是一条高度协同的技术主线。Infra支撑我们的模型能够更快、更好、更省地训练;强大的模型能力又为Agent技术提供了坚实底座,而Agent就像模型能力的“放大器”,释放其更大潜能;同时,高效的Infra又能让模型以更低成本运行在更多设备上,拓展其应用空间。所以它们是一条紧密相连的链条。这也贯穿了我们对“高效”的终极追求——实现全链路高效,整个技术体系的优化目标都是为了提升效率,最终拓宽大模型的应用空间与商业价值。

相关攻略

近日,在北京市石景山区人民政府、北京市经济和信息化局、北京市科学技术委员会中关村科技园区管理委员会联合主办的服贸会分论坛——“通用人工智能算力论坛”(AGICF)上,面壁智能正式发布了千亿参数多模态大模型“露卡”(Luca),并开启了其2 0版本的全民公测。 “露卡”之名,源于地球生命始祖的英文缩写

过去几年,大模型行业的注意力更多集中在云端,关注参数规模、推理速度或者能力榜单,而如今,客户关心的不是模型能不能更“强”,而是能不能在真实算力条件下跑起来,能不能稳定服务用户,能不能把成本压到一个可

近日,面壁智能完成马年春节之后首轮融资,迎来新春“开门红”。 本轮融资规模数亿元,由中国电信领投、中信金石、中信私募跟投。其中,中国电信作为战略投资方,将与面壁智能展开深度业务协同。中国电信将发挥

2月28日,面壁智能官宣2026年首轮数亿元融资。本轮融资由中国电信领投,中信金石、中信私募跟投。本轮融资显示了资本行业对面壁在“端侧大模型”赛道领先地位以及高密度技术创新的认可。具体来看,中国电信

来源:环球网【环球网科技综合报道】2月28日消息,近日,面壁智能宣布完成新一轮数亿元融资,由中国电信领投,中信金石、中信私募跟投。在行业步入‘中场战事’、商业化落地成为核心命题的当下,面壁智能在春节

热门专题

热门推荐

华硕在ROGDAY2026上发布了枪神10X整机,首次搭载三颗可联动显示的全息光显风扇,外观极具未来感。其核心配置顶级,采用AMD锐龙99950X3D2处理器、ROGRTX5080显卡、64GB内存及4TBSSD,并配备高效三区独立散热系统,定价69999元。

智能门锁领域迎来重磅新品。知名品牌鹿客近期于京东平台正式发售其旗舰型号V3 Max智能门锁,该产品凭借创新的隔空无线充电技术与先进的AI视觉识别系统引发市场关注。官方定价为3572元,在部分参与促销活动的地区,消费者可享受补贴,最终入手价有望低至2799元,性价比优势显著。 鹿客V3 Max在视觉安

在备受瞩目的ROG DAY 2026广州站活动中,华硕重磅发布了其新一代高性能游戏笔记本电脑——ROG魔霸10系列。该系列包含16英寸的魔霸10与屏幕更大的18英寸魔霸10 Plus两款机型,旨在为硬核玩家带来顶级的游戏体验。 ROG魔霸10系列的硬件配置堪称顶级。处理器方面,用户最高可选择搭载AM

5月15日,小米官方正式公布了小米手环10 Pro的完整配置信息。作为新一代旗舰手环,它在健康监测精准度、运动功能专业度以及佩戴舒适度上均实现了显著突破,为用户带来了更全面的智能穿戴体验。 小米手环10 Pro 健康监测:精度与维度的双重跃升 本次升级的核心在于健康监测能力的全面进化。小米手环10

金士顿扩展其可超频的ECCRDIMM内存系列,新增高达7600MT s型号。其中高速型号采用全新铝制散热马甲,提升散热效率以保障高负载下的稳定运行。该系列同时支持ECC校验与超频,兼顾性能与数据完整性,适用于AI计算、工程仿真等高要求专业场景。