AI比你更理性吗 它其实存在偏见

当“AI决策”成为流行语,我们是否过于轻信其客观性?中欧国际工商学院金融学教授余方在近期演讲中揭示:AI并非绝对理性,它可能悄然“继承”并“放大”人类固有的认知偏见。本文基于余方教授演讲内容,深入探讨AI决策的潜在偏差与应对策略。

今年以来,AI技术以前所未有的深度渗透各行各业,引发了一种普遍的隐忧:AI将如何重塑我们的决策模式?从行为金融学的视角切入,这一问题显得尤为关键。

要理解AI决策的局限性,首先需要回顾行为金融学的核心思想。

经济学领域长期存在两大理论阵营:以理性人假设为核心的芝加哥学派,与强调市场非理性、主张政府干预的凯恩斯学派。这一对立延伸至金融学,便形成了有效市场假说与行为金融学的分野。

2013年诺贝尔经济学奖颇具象征意义,同时颁给了观点相左的两位学者:尤金·法玛(Eugene Fama)因有效市场理论获奖,他认为资产价格已充分反映所有可用信息;而罗伯特·席勒(Robert Shiller)则因揭示市场非有效性及投资者行为偏差而获奖。另一位关键人物理查德·塞勒(Richard Thaler),在《助推》一书中系统阐述了人类决策中的认知偏差,并于2017年荣获诺奖。

由此可见,行为金融学的立论基础在于:人类决策存在系统性、可预测的偏差。这正是我们审视AI决策时需要关注的核心。

人类常见的决策偏差,AI是否同样存在?

近五六年,大语言模型呈现爆发式增长,AI助手已成为许多人决策时的首选咨询对象。那么,人类的认知偏见在AI辅助下是被削弱了,还是被强化了呢?

偏差一:锚定效应(Anchoring Effect)

丹尼尔·卡尼曼(Daniel Kahneman)曾进行一项经典实验:参与者先观看一个随机数字(10或65),随后被问及联合国中非洲国家的比例。结果令人深思:看到数字10的组,平均估计值为25%;看到数字65的组,平均估计值跃升至45%。尽管参与者明知初始数字是随机的,但这个“锚点”仍在潜意识中影响了他们的判断。商业场景中,主播常用的“原价1000元,今日直播间仅需100元”的话术,正是利用了锚定效应。

那么AI的表现如何?在对12个主流大语言模型的测试中发现:GPT和Gemini表现出较强的理性,几乎不受锚定值影响;Claude受到轻微影响;而LLaMA则展现出与人类相似的锚定效应。这表明,AI是否会产生偏差,很大程度上取决于其模型架构与训练方式。

偏差二:过度自信(Overconfidence)

人类往往高估自身知识的准确性与判断能力。例如,在要求专业投资人以90%的把握预测沪深300指数未来一个月的波动区间时,他们给出的区间通常过于狭窄,实际命中率可能仅50%左右。这也部分解释了为何多数主动型基金长期难以持续跑赢市场指数。

将类似测试应用于AI模型:Claude通常能给出较为宽泛、谨慎的预测区间,显得更具“自知之明”;GPT表现较为均衡;而Gemini等模型则在多数测试中给出极窄的区间,表现出显著的过度自信倾向。

偏差三:损失厌恶(Loss Aversion)

设想一个抛硬币游戏:正面赢120元,反面输100元。你会参与吗?多数人选择拒绝。卡尼曼的研究指出,损失带来的心理痛苦感,大约是等量收益带来快乐感的2.25倍,这被称为损失厌恶。

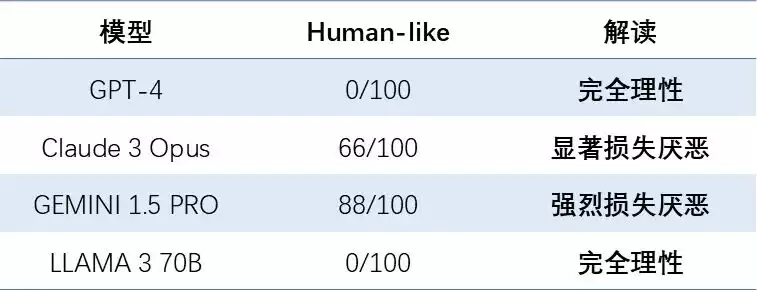

AI是否具备类似的“情绪化”反应?实验结果显示:GPT表现得如同理性经济人,完全基于期望值进行决策;Claude在约三分之二的情况下表现出损失厌恶;而Gemini在100次决策中有88次表现出强烈的损失厌恶,其程度甚至超越了人类平均水平。

偏差四:框架效应(Framing Effect)

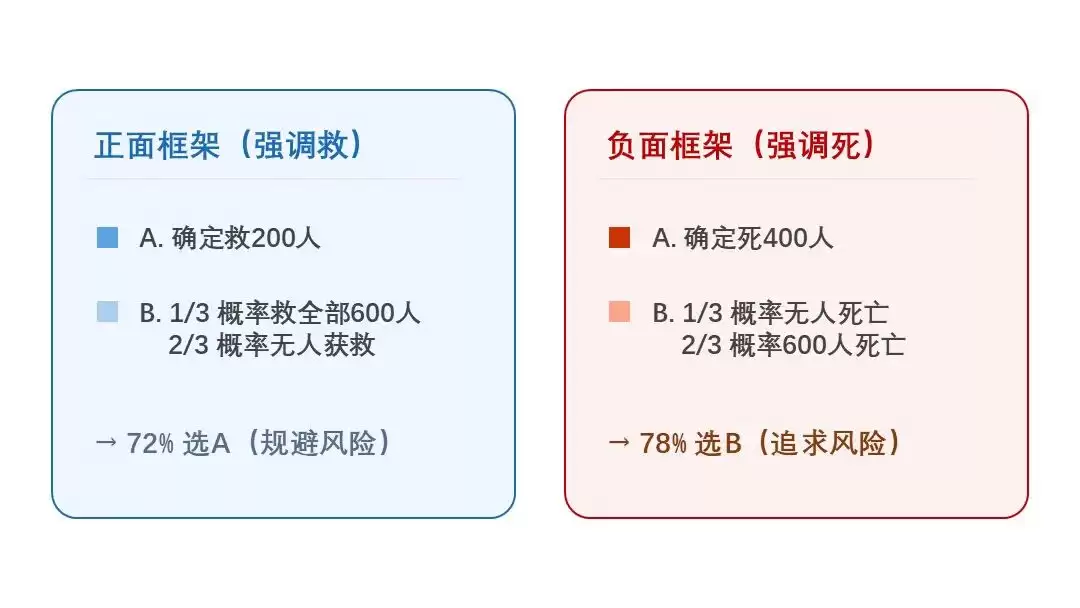

同一信息的不同表述方式,会显著影响人们的决策选择,这就是框架效应。一个经典决策实验如下:某种流行病暴发,预计导致600人死亡,现有两套救治方案:

当方案表述为“确定救活200人” vs “有1/3概率救活全部600人,2/3概率无人获救”时,72%的人选择前者。但当表述转换为“确定死亡400人” vs “有1/3概率无人死亡,2/3概率全部死亡”时,78%的人转而选择后者。两套方案在数学上完全等价,仅因描述框架从“收益”转为“损失”,决策结果便发生逆转。

测试发现,几乎所有大语言模型都比人类更容易受到提问框架的影响。这恰恰解释了为何“提示词工程”变得至关重要。大模型对语言语境高度敏感,提问角度与措辞的细微差别,可能导致答案倾向截然不同。

偏差五:羊群效应(Herd Effect)

人类具有从众心理,例如倾向于选择排队较长的餐厅。AI虽无社交意识,但其“算法共振”可能引发更剧烈的协同行为。由于许多AI模型的底层算法与训练数据源高度相似,在突发事件中,它们可能在极短时间内得出趋同结论,导致系统采取方向一致的行动,有时甚至引发市场波动或系统拥堵。例如,导航App可能将大量车辆同时引导至同一条“捷径”,反而导致该路线瘫痪。

AI模型升级后,决策偏差会减少吗?

人们通常期待,模型迭代会使其更“聪明”、偏差更小。研究人员将决策偏差分为两类进行对比测试,结果却呈现分化。

第一类是统计推理类偏差:涉及基础概率、贝叶斯更新等纯逻辑任务。随着模型迭代,这类偏差确实显著减少。

第二类是偏好类偏差:涉及风险态度、情感反应与价值判断,如损失厌恶、框架效应等。令人担忧的是,随着大模型不断升级,这类偏差并未减弱,反而有加剧趋势。

为何技术越先进,AI在某些方面反而越“不理性”?核心机制在于RLHF(基于人类反馈的强化学习)。AI通过人类反馈进行学习,而人类的历史文本与反馈本身蕴含大量情绪、矛盾与偏见。大模型在学习“人类语言模式”的同时,也不可避免地继承并放大了这些认知偏差。

此外,“偏好崩塌”现象同样值得警惕:在微调过程中,模型倾向于强化主流反馈模式,而少数派或独特观点则逐渐被边缘化,导致输出趋同。

如何善用AI辅助决策?四大实用策略

基于以上洞察,在日常工作与投资决策中,我们应如何与AI有效协作?以下提供四条实操建议。

第一,切勿视AI为完全理性的决策顾问。无论模型在智力测试中表现多优异,都不代表其在涉及情感与偏好的决策中绝对中立。建议对任务进行严格区分:纯逻辑计算类任务可高度信赖AI;但涉及风险权衡、价值判断的决策,需保持审慎,进行必要的人工复核与校准。

第二,将AI作为“行为模拟器”加以利用。AI能够高度模拟人类的各类决策偏差,这在商业应用中具有巨大价值。企业可用其模拟不同客户群体对营销话术、定价策略或产品设计的反应,将其作为市场测试与策略优化的“数字沙盘”。

第三,警惕AI放大自身偏见。AI设计上存在“谄媚倾向”,当你流露出某种偏好时,它可能倾向于附和“这是个好主意”。因此,在关键决策中,务必引入交叉验证机制。同时咨询多个不同架构、不同训练背景的模型,对比其反馈差异,可有效降低因单一模型偏差导致的决策风险。

第四,在提示词中主动嵌入“理性框架”。既然AI对提问框架敏感,我们便可主动设计提问方式。在寻求AI决策建议时,避免直接询问答案,而是明确指令:“请运用行为经济学原理,分析此决策可能面临的五种认知偏差,并从反对者视角对我的初步方案进行批判性评估。”通过这样的机制设计,可引导AI输出更理性、更具深度的分析。

分享这些研究发现,并非为了制造焦虑,而是希望在未来与AI协同工作时,我们能保持清醒的认知,深刻理解技术的机理与边界。工具越强大,使用者越需明晰其内在局限,方能真正驾驭其潜力。

相关攻略

一名网友将莫奈《睡莲》标注为“AI生成”后引发大量批评,众人指责其构图、色彩与“灵魂”缺失,直到真相揭晓。这场实验揭示了标签如何主导判断,如同“廉价红酒实验”中的认知偏差。当前网络对AI内容的过度怀疑甚至误伤人类创作者,反映出标签化思维正侵蚀艺术鉴赏与社会信任的基础。

当“AI决策”成为流行语,我们是否过于轻信其客观性?中欧国际工商学院金融学教授余方在近期演讲中揭示:AI并非绝对理性,它可能悄然“继承”并“放大”人类固有的认知偏见。本文基于余方教授演讲内容,深入探讨AI决策的潜在偏差与应对策略。 今年以来,AI技术以前所未有的深度渗透各行各业,引发了一种普遍的隐忧

深度伪造技术正严重威胁企业安全,使传统依赖声音、面孔的信任机制失效,已渗透支付审批、高管沟通等环节,造成巨额诈骗风险。企业须将合成媒体纳入威胁模型,以零信任原则审视内容,建立自动化检测与应急预案,并通过独立验证渠道分离沟通与授权,使信任成为可验证的流程而非默认。

这项由慕尼黑大学CompVis实验室、慕尼黑机器学习中心与苹果公司联合开展的研究,以预编本形式发布于2026年4月,论文编号为arXiv:2604 11737。 当前,视频AI技术面临一个核心的效率瓶颈:现有方法在预测物体运动时,总是将“视觉外观”与“运动轨迹”这两个维度的信息捆绑处理。这好比学习舞

想象一下,一台高性能电脑生成一段文字,背后究竟要经历什么?很多人可能下意识地认为,AI说话就像打字,一个字一个字地蹦出来。但有一类新兴的AI文字生成技术,走的是一条截然不同的路:它不像打字员,更像一个反复修改草稿的作者——先把整篇文章“涂黑”,然后一遍又一遍地把涂黑的部分猜出来,直到整篇文章清晰成形

热门专题

热门推荐

领克首款GT概念跑车亮相北京车展,由中欧团队联合打造。新车采用经典GT比例与低趴宽体设计,配备液态金属蓝涂装与2+2座舱,设有高性能模式按键可激活空气动力学套件。车辆采用后驱布局与AI智能运动控制系统,百公里加速约2秒,设计融合瑞典极简美学并参考全球用户反馈。

英伟达推出12GB显存版RTX5070移动GPU,与8GB版同步上市。两者均基于Blackwell架构,核心规格相同,仅显存容量不同。此举旨在缓解GDDR7芯片供应压力,为OEM提供灵活配置,加速笔记本产品布局,更大显存可更好满足游戏与AI应用需求。

微星将于5月15日推出两款26 5英寸雾面WOLED显示器MAG276QRY28和276QRDY54,售价分别为2499元和6299元。均采用第四代WOLED面板,具备QHD分辨率、VESADisplayHDRTrueBlack500认证、1500尼特峰值亮度及99 5%DCI-P3色域覆盖。276QRY28刷新率为280Hz,高阶款276QRDY54支持4

中芯国际2026年第一季度营收176 17亿元,同比增长8 1%;净利润13 61亿元,同比增长0 4%。公司预计第二季度收入环比增长14%至16%,毛利率指引上调至20%至22%。这反映出公司在行业复苏中展现出财务韧性,并通过运营优化增强了短期增长势头。

手机修图、相机降噪、视频去雾……这些我们日常使用的图像处理功能,其背后都离不开人工智能(AI)技术的驱动。通常,AI模型的训练逻辑是:向模型展示大量“低质图像”与“优质图像”的配对数据,让它学习如何将前者转化为后者。然而,天津大学计算机视觉团队近期发表的一项研究(arXiv:2604 08172)揭