FlinkSpec 需求智能化实践 BP Claw 破解 AI 编码输入瓶颈

本文是 FlinkSpec 系列的开篇,也是这场工程化变革的序章。BP Claw 所立足的,仅仅是整个链路的起点。而 FlinkSpec 的愿景,是借助 AI 的力量,将实时数仓从需求落地到验收上线的全过程,锻造为一套精密自洽、生生不息的智能工程体系。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

在深入探讨之前,不妨先用一张表快速了解 BP Claw 的核心价值。

如果你的团队也正被以下问题困扰,那么这篇文章值得一读:AI 编码效果时好时坏,同样的框架,面对不同需求时产出天差地别;需求沟通来回拉锯,一个指标口径要反复确认好几轮;PRD 质量参差不齐,开发阶段频繁踩坑、返工延期。BP Claw 给出的答案是:问题的根源在于输入,解法必须回到源头。

一、FlinkSpec:实时数仓的 AI 工程化底座

要理解 BP Claw,首先得看清它所在的更大图景——FlinkSpec。这是实时数仓团队打造的 AI 工程化开发框架,其核心理念是“需求驱动、制品为锚”。它将一条实时数据链路的生命周期拆解为四个阶段,每个阶段都设有严格的门控评估,以确保最终的交付质量。

FlinkSpec 全景架构

图片

图片

BP Claw 在 FlinkSpec 中的定位

在 FlinkSpec 的四个阶段中,需求澄清是一切的起点。而这个阶段的质量,高度依赖于一个关键输入——PRD 文档。一份质量不达标的 PRD,会让后续所有环节都变成空中楼阁:需求定义模糊,会导致 Intake 门控反复打回,Define 阶段耗时翻倍;技术口径缺失,会让 Flink-SQL Agent 无法启动编码,频繁触发阻塞协议;验收标准不清,则会在 Review 阶段暴露问题,不得不回退到 Define 阶段重来。

图片

图片

BP Claw 正是为了解决这个“源头问题”而生的。它站在 FlinkSpec 的上游,确保流入 Define 阶段的 PRD 文档,其质量足以支撑后续的 AI 自动化编码。

BP Claw 解决实际问题案例

来看一个具体案例。在商业化广告投放链路中,一次广告曝光往往由多个商家共同参与竞价。这种一对多的流量-主体映射关系,在指标聚合时会产生一个结构性的歧义:当以“商家”为维度进行下钻分析时,同一次流量事件会被多个商家各自计入,导致商家侧明细加总后,与平台侧的总量对不上。

这并非数据质量问题,而是两套在各自语义下都正确的口径,共存于同一张宽表却没有被显式区分。例如,impression_cnt(平台侧)去重到流量维度,一次曝光计为1;而impression_cnt(商家侧)展开到主体维度,N个商家参与就计为N。当下游消费方使用同一个字段名、却按不同语义聚合时,CTR、CVR、ROI等衍生指标就会系统性失真。

为什么这类问题难以在开发阶段被发现?实时数仓的指标开发通常以 FlinkSQL 为载体,开发人员看到的输入是 Kafka 事件流和维度表,字段语义的边界在数据建模时已经隐式确定。问题在于,FlinkSQL 层面的 GROUP BY 逻辑无法自动感知上游指标应该以哪个粒度聚合。如果流量事件中同时携带了 advertiser_id 列表,不同的展开方式对应完全不同的业务语义,而在代码层面,这可能只是一行 UNNEST 或一个 JOIN 的差异。常规的 Code Review 能发现 SQL 逻辑错误,却很难揪出“SQL 逻辑正确,但口径选择与业务预期不符”这类问题——因为两种写法都能跑通,数据差异在没有对比基准的情况下也不会报错。

BP Claw 的介入点正在于此。它作为需求到编码之间的中间层,其核心能力是在指标定义阶段完成口径的显式化,而非在开发完成后做数据校验。

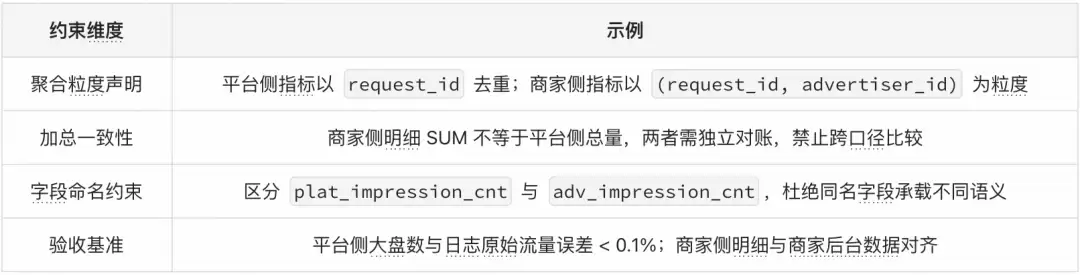

具体做法是,结合 OpenViking 知识库(包含团队历史建模文档、字段定义及踩坑记录)进行语义召回,识别当前需求涉及的指标是否存在多粒度歧义。在需求进入 FlinkSpec 之前,BP Claw 会将以下约束显式写入需求文档:

这套约束作为 FlinkSpec 的输入,使得 AI Coding 在生成 DDL 和 INSERT 逻辑时,能够直接基于已经对齐的语义边界,而不是从模糊的描述中自行推断。

这与通用 AI Coding 工具有何不同?通用工具在给定输入后,往往会选择一种“看起来合理”的实现。对于多商家指标,它可能倾向于展开商家维度(因为需求里写了“按商家查看”),但不会主动判断这是否会导致平台侧口径膨胀。

BP Claw 的差异在于其知识来源:它依赖的不是通用语言模型对业务逻辑的推断,而是团队在同类建模问题上积累的历史决策和约束条件。对于“多商家指标是否需要分口径建模”这个问题,OpenViking 里已有明确结论,BP Claw 将其召回并作为强约束注入当前需求,而不是重新推断一次。

二、产品设计:从痛点出发的解决方案

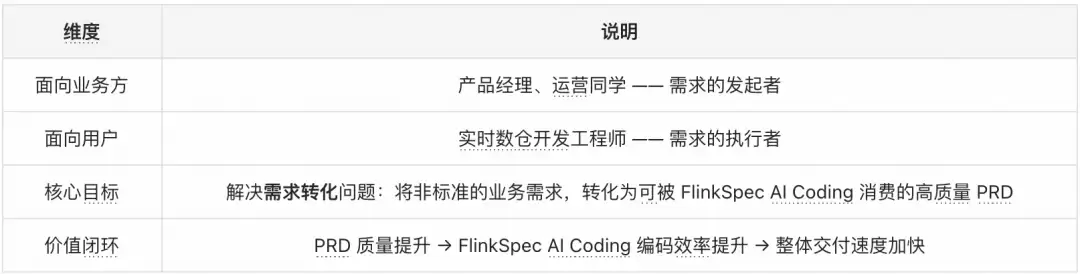

面向谁?解决什么?

设计哲学:贴合工作流,而非改造工作流

BP Claw 的设计遵循三条核心原则:

原则一:嵌入现有场景。 用户无需打开新页面或学习新工具,直接在飞书群聊中 @ 机器人即可触发,这与日常“拉群评审”的行为完全一致。

原则二:产品经理零感知提效。 产品经理只需提交原始 PRD 文档,BP Claw 自动完成规范化转换。产品经理收到的是结构化的高质量评审群,而非一堆格式要求,整个过程无需他们额外操心格式问题。

原则三:不硬卡点,做参照系。 PRD 评分是“参照”,而非“阻塞”。其目的是帮助团队建立质量意识,而不是制造流程摩擦;是逐步提升 PRD 质量基线,而非一刀切。

三、核心能力层

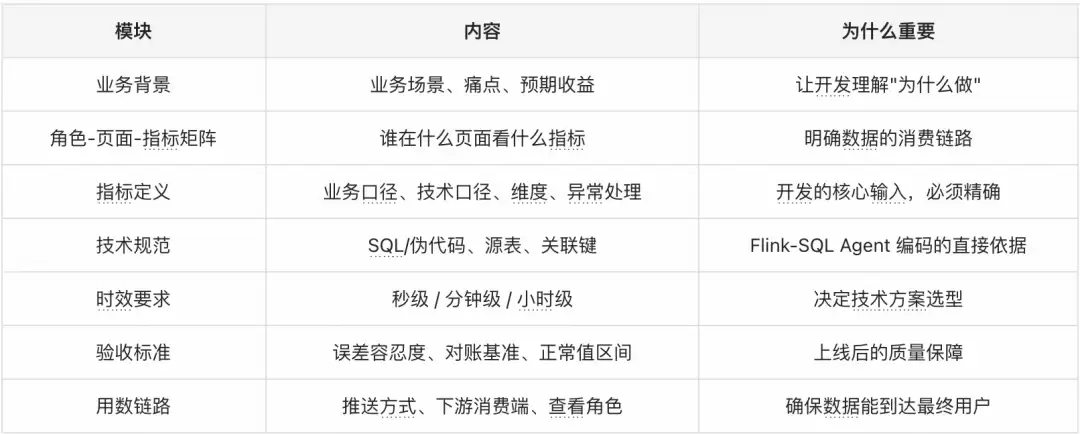

对实时数仓而言,一份好的 PRD 应该是什么样的?

在深入技术实现之前,有必要先回答一个根本性问题:实时数仓对 PRD 文档究竟有何要求?一份优秀的实时数仓 PRD,需要覆盖以下七大模块:

然而现实中,产品经理提交的文档往往只覆盖了其中的2-3个模块,且格式五花八门。这正是 BP Claw 要解决的核心痛点——智能需求转化。

能力一:智能需求转化(核心能力)

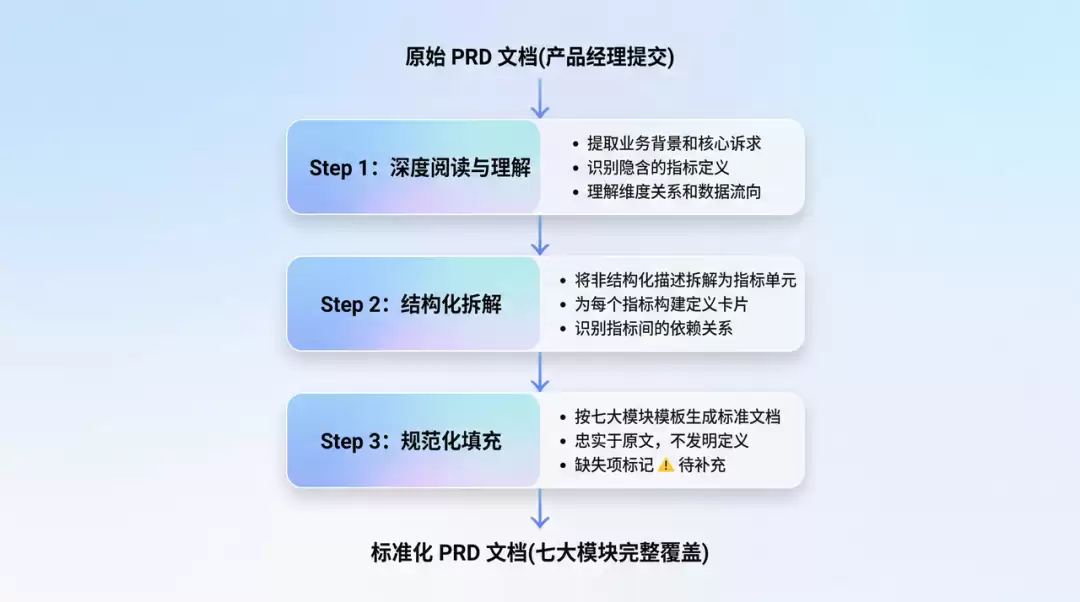

这是 BP Claw 最核心、技术含量最高的能力。它所做的事情,本质上是模拟一位经验丰富的数据 BP(业务伙伴)的工作过程。

转化过程详解

图片

图片

转化的技术难点

如何处理常见的业务需求类型?我们总结了实时数仓中最常见的几类需求模式:

图片

图片

转化的核心原则:忠实于原文

原文已有的信息,进行结构化提取并按模板填充;原文没有的信息,标记为“待补充”,绝不凭空捏造;原文存在歧义的信息,保留原始表述,同时标注歧义点;原文中划删除线的内容,标注为“本期不纳入,暂缓”。

能力二:PRD 质量评分(参照能力)

在完成需求转化后,BP Claw 会对标准化文档进行多维度质量评估,并生成诊断报告。

五大评分维度

三条核心评分规则

规则一:技术口径一票否决。 如果技术口径得分低于15分(满分25),即使总分≥90,也标注为“不可执行”。原因很简单:没有清晰的技术口径,FlinkSpec 的 Flink-SQL Agent 完全无法启动编码。

规则二:验收标准缺失扣分。 验收标准完全缺失,总分直接扣除20分;严重不足(≤5分),扣除10分。原因在于:没有验收标准的需求,上线即意味着风险。

规则三:溢出得分机制。 某个维度表现特别优秀,得分可以超出该维度满分,但总分上限仍为100分。此举旨在鼓励在关键维度上做到极致。

需要再次强调的是,PRD 评分不是硬性卡点或流程阻塞。它更像一面镜子,帮助团队看清当前 PRD 的质量水平,从而逐步建立起质量意识。

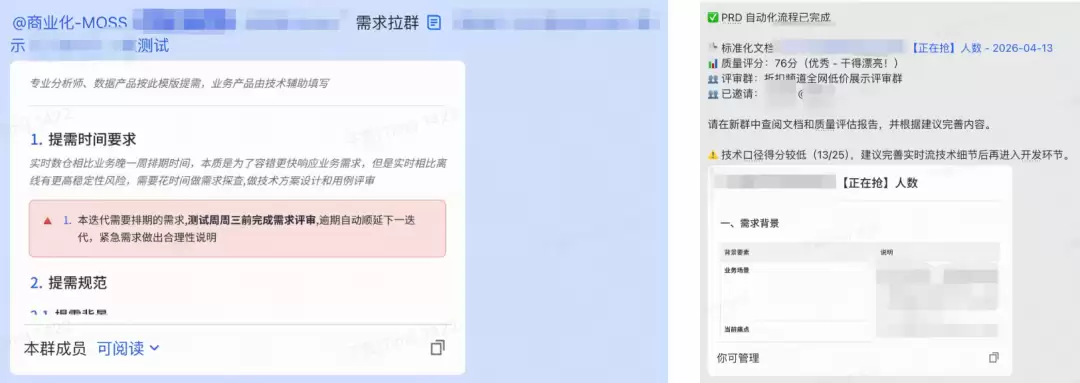

能力三:自动拉群(工作流融合能力)

自动拉群功能看似简单,却承载着重要的产品设计意图——最大限度地降低落地阻碍。为什么要做自动拉群?试想,如果 BP Claw 只能生成文档,用户仍需手动拉群、@相关人员、转发文档,那么整个使用体验将是割裂的。

自动拉群让整个流程变成了“一步触发、全程自动”:用户只需在飞书群里 @ 机器人、@ 评审人,并附上文档链接。BP Claw 便会自动完成后续所有步骤:读取文档 → 生成标准化文档 → 质量评估 → 创建评审群 → 邀请成员 → 发送文档和诊断报告。评审人在新群里直接看到结构化的文档和质量报告,即可开始评审。这正是“贴合现有工作流”的具体体现——用户的行为没有改变,但背后的效率却提升了数十倍。

四、技术难点与解决方案

省 Token 的技巧

在 AI 应用中,Token 消耗直接关系到成本和响应速度。BP Claw 在这方面做了多项优化。

技巧一:分段生成策略。 对于包含10个以上指标的大文档,我们不会一次性生成完整内容(这可能导致上下文溢出),而是采用分段生成:先创建文档骨架(业务背景 + 角色-页面-指标矩阵),然后逐个追加指标定义模块,每追加5个指标发送一次进度反馈,最后追加验收标准和用数链路。这本质上是将“一次大事务”拆分为“多次小提交”,即使中途失败也保留了已写入内容,无需从头再来。同时,每段写入后向群聊发送进度消息(如“已生成5/12个指标”),让用户感知到进度,避免误以为机器人卡死。收益是双重的:既避免了单次 API 调用超时,又减少了重复传递上下文的 Token 消耗。

技巧二:分层调用架构。 BP Claw 采用编排者模式,将核心逻辑拆分到三个独立的 Skill 中:

每个 Skill 独立运行、独立管理上下文,避免了将所有逻辑堆叠在同一个上下文中导致的 Token 膨胀问题。

技巧三:模板化 Prompt 设计。 标准化文档的七大模块,每个都有严格定义的模板结构。通过模板约束 AI 的输出格式,可以有效避免冗余输出:明确指定输出字段,不多不少;使用 Markdown 表格约束结构;通过 Few-Shot 示例引导输出风格。

稳定性保障:如何避免幻觉?

这是 BP Claw 面临的最重要的技术挑战。AI 生成的文档如果出现“幻觉”(即编造不存在的业务口径),其后果比不生成文档更为严重。

策略一:严格的忠实性约束。 在 Skill 的核心 Prompt 中,我们设置了多层约束:核心规则是忠实于源材料。原文有的,就做结构化提取;原文没有的,必须标记为“⚠️ 待补充”;绝不凭空发明业务定义;绝不猜测技术口径。

策略二:标记机制取代猜测。 当 AI 遇到无法确定的信息时,不允许它“猜测后继续”,而是必须:明确标记为待补充;说明缺失的具体内容;给出建议补充的方向。这样做的好处是,用户最终看到的文档中,每一条确定的信息都是可信的。

策略三:质量评分的交叉验证。 prd-quality-scorer 作为独立的评分 Skill,会对生成的文档进行“第二遍”审查。如果文档中存在明显的逻辑矛盾或不合理之处,评分报告中会直接指出。

策略四:参数校验与重试机制。 调用飞书 API 前,强制校验所有必填参数;文档生成失败时,最多重试3次(采用间隔2秒→5秒→10秒的指数退避策略);3次均失败则终止流程,并发送明确的错误消息;绝不降级生成“简化版”文档(不完整的文档不如不生成)。

打磨 Skill 的技巧与难点

难点一:如何让 AI 理解“实时数仓”的领域语义? 普通的 LLM 并不理解“去重视图”、“Lookup Join”、“sink.properties.columns”这些领域概念。我们通过以下方式解决:在 Skill 定义中嵌入实时数仓的核心概念解释(领域知识注入);通过模板结构限定输出范围,减少 AI 的“自由发挥空间”(模板驱动);提供真实的标准化 PRD 样例作为参考(Few-Shot 示例)。

难点二:如何处理超长文档? 有些 PRD 文档超过10000字符、包含15个以上指标,直接处理会导致 API 超时(默认60秒不够用)、Token 超限、输出截断。解决方案包括:显式设置超时时间为1200秒(20分钟);采用分段生成策略,每次只处理3-5个指标;实时反馈进度,让用户知道系统仍在工作。

难点三:如何协调多个 Skill 的执行顺序? BP Claw 作为“指挥家”或“编排者”,需要严格控制四个步骤的执行顺序和依赖关系:规则是严格串行,前序步骤成功才执行后续步骤。STEP 1 成功 → STEP 2;STEP 2 成功 → STEP 3;STEP 3 成功或失败 → STEP 4(评分失败不阻塞流程);STEP 4 成功 → 完成。任一关键步骤失败 → 立即终止,并通知用户。为什么 STEP 3 失败不阻塞?因为质量评分是“参照”而非“卡点”。即使评分失败,生成的标准化文档和评审群依然具有价值。

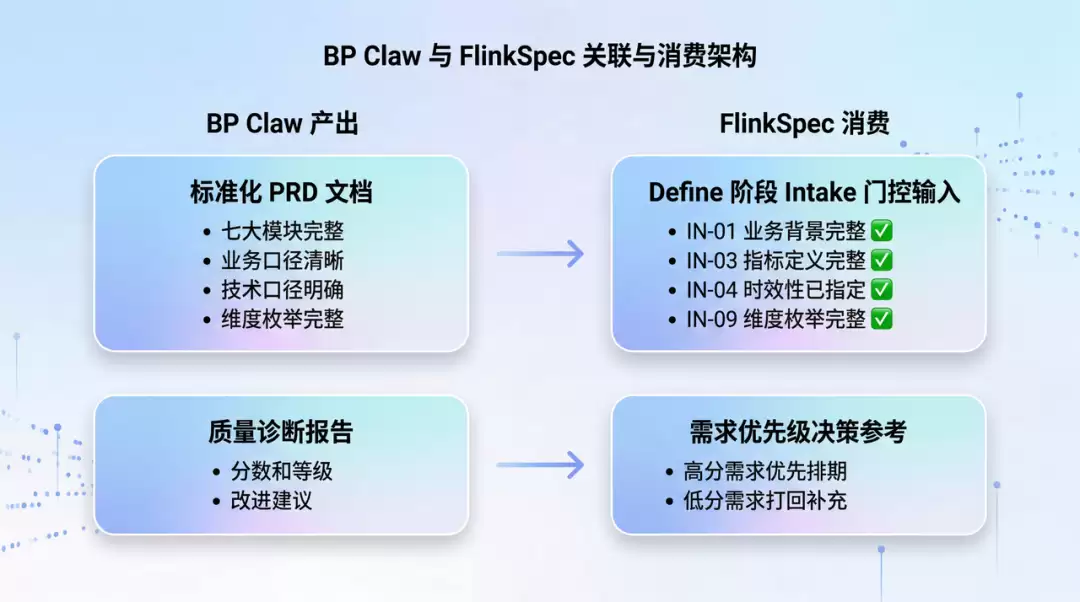

五、与 FlinkSpec 的联动:全链路赋能

BP Claw → FlinkSpec 的价值传递

图片

图片

体验效果:PRD 质量提升对 AI Coding 的赋能

场景一:技术口径完整的 PRD。 BP Claw 评分 ≥ 90 分。FlinkSpec Define 阶段一次通过,无 BLOCK。Flink-SQL Agent 可直接编码,无需人工干预。整体交付周期缩短至天级。

场景二:技术口径缺失的 PRD。 BP Claw 评分 < 60 分,触发技术口径一票否决。FlinkSpec Define 阶段频繁触发阻塞协议。Flink-SQL Agent 无法编码,需要反复沟通。整体交付周期拉长至周级。

结论是显而易见的:BP Claw 每将 PRD 质量提升10分,FlinkSpec 在编码阶段的效率大约能提升30%。

六、落地运营:产品 + 运营 = 真正的落地

一个好的产品工具,如果没有配套的运营手段,往往难以真正落地。BP Claw 在推广过程中,采用了产品能力与运营能力双轮驱动的策略。

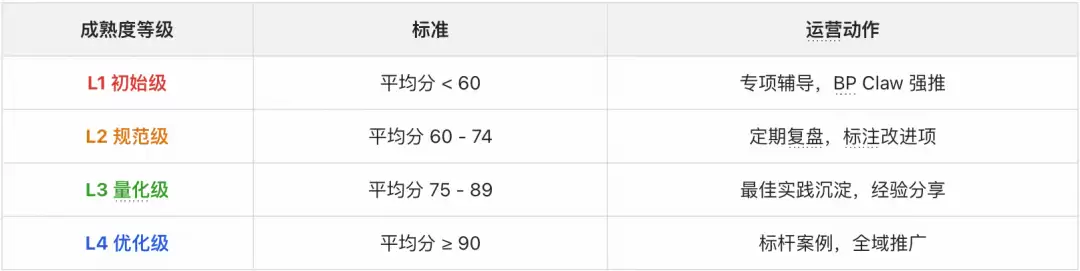

运营手段一:成熟度评分体系

我们建立了域级 PRD 成熟度评分机制,通过持续追踪各业务域的 PRD 质量水平,推动整体提升:

运营手段二:质量趋势追踪

通过持续收集每次 PRD 评分数据,建立质量趋势看板:按业务域维度追踪质量变化;识别高频缺失项,进行定向改进;开展月度质量复盘,表彰优秀案例。

运营手段三:最佳实践沉淀

将高分 PRD 案例沉淀为模板,形成可复用的知识资产:建立优秀案例库(≥ 90 分的 PRD 自动入库);制定改进指南(针对常见扣分项提供标准化的补充模板);用于新人培训(通过 BP Claw 评分报告帮助新人快速上手 PRD 编写规范)。

七、快速上手

使用方法

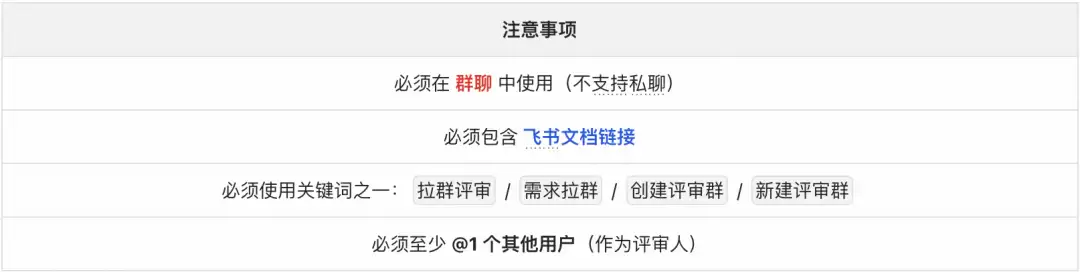

只需一步:在飞书群聊中发送一条消息:

@商业化MOSS @评审人1 @评审人2 @评审人N.... 需求拉群 飞书PRD文档链接

然后等待1-5分钟,你将在新的评审群中看到:标准化 PRD 文档、质量诊断报告、改进建议清单。

注意事项

八、展望后续

本文作为 FlinkSpec 系列的开篇,描绘了这场工程化变革的序章。BP Claw 所立足的,不过是漫长链路的源头。FlinkSpec 的真正图景,是以 AI 之力,将实时数仓从需求落地到验收上线的全流程工序,熔铸为一套精密自洽、生生不息的智能工程体系。这仅仅是个开始。

相关攻略

本文是 FlinkSpec 系列的开篇,也是这场工程化变革的序章。BP Claw 所立足的,仅仅是整个链路的起点。而 FlinkSpec 的愿景,是借助 AI 的力量,将实时数仓从需求落地到验收上线的全过程,锻造为一套精密自洽、生生不息的智能工程体系。 在深入探讨之前,不妨先用一张表快速了解 BP

月之暗面公司申请注册“KimiClaw”商标,覆盖科学仪器、网站服务等类别,引发业界对其可能涉足硬件领域的猜测。该公司以长文本处理能力闻名,近期传闻正进行高额融资,估值或超200亿美元,显示出构建更庞大AI生态的意图。

C盘空间告急,系统响应也跟着“卡壳”?这背后,临时文件的无序堆积往往是罪魁祸首。要高效解决,不妨试试这五招:从系统自带的磁盘清理,到手动清空关键目录,再到停服清理更新缓存、启用自动清理,乃至一键批处理脚本,总有一款适合你。 电脑用久了,C盘空间莫名其妙就红了,系统也感觉越来越“黏滞”?别急着怪硬件,

HeiMaClaw是什么 提起企业级AI Agent平台,你脑海里浮现的是什么?是简单的API调用,还是脆弱的演示Demo?今天我们要聊的HeiMaClaw,或许会刷新你的认知。这是黑马程序员推出的一个生产级平台,它的特别之处在于,其构建基石是业界公认的2026年前沿理念——Harness Engi

ToClaw自动化浏览失效?四步排查法帮你搞定 想用ToClaw实现自动化浏览,却遇到了插件没反应、中继连不上或者标签页不受控制的情况?别急,这通常是因为Chrome扩展没装对、中继服务没跑起来,或者权限配置没到位。下面这套四步排查法,能帮你快速定位并解决问题。 第一步:搞定ToClaw Chrom

热门专题

热门推荐

进入2026年,加密货币市场的格局与安全标准已悄然进化。对于投资者而言,选择一个安全可靠的交易平台,其重要性丝毫不亚于挑选资产本身。毕竟,资产增值的前提,是它们得安然无恙地躺在你的账户里。今天,我们就来盘一盘当前市场上主流的虚拟资产交易所,从风控能力、资产储备与市场口碑等多个维度,做一次深入的“避雷

本文梳理了2026年备受关注的数字资产交易平台,从安全性、功能特色与用户体验等维度进行分析。重点探讨了主流合规平台在资产托管、交易深度上的优势,以及新兴聚合器在提升交易效率方面的创新。同时,也指出了选择平台时需关注的风险控制与合规性,为不同需求的用户提供参考方向。

本文汇总了2026年主流的数字资产交易平台,从安全性、功能特色、用户体验及合规性等维度进行分析。内容涵盖适合新手的综合性应用、面向专业交易者的工具型软件,以及注重资产安全的托管方案,旨在为用户选择合适平台提供客观参考,并提醒注意市场风险与自我资产保护。

本文梳理了2026年主流的数字资产交易平台,从安全性、交易体验、功能特色等维度进行分析。重点介绍了综合型头部平台、专注创新的新兴应用以及面向特定需求的专业工具,旨在为用户提供客观参考,帮助其根据自身情况选择合适的软件进行下载与使用。

本文探讨了2026年数字货币交易软件的选择标准,并列举了十款主流应用。内容涵盖安全性、交易对、用户体验及费用等核心考量维度,分析了不同平台在现货、合约及DeFi集成等方面的特色,旨在为不同层级的用户提供实用参考,帮助其根据自身需求做出合适选择。