AI自动化评测与优化平台实践指南

在人工智能技术迅猛发展的当下,如何系统化、客观地评估并持续优化一个AI驱动的应用,已成为开发团队面临的核心挑战。传统依赖人工的评测方法不仅效率低下、成本高昂,且难以覆盖复杂多变的业务场景与快速迭代的需求。本文将深入探讨一种创新的解决方案:构建以AI为核心的自动化评测与优化平台,并通过多个实践案例,展示其如何实现从任务定义到系统优化的全流程闭环。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

一、构建AI驱动的自动化评测平台

提到评测平台,传统流程通常包括:定义评测目标、收集测试数据、执行测试用例、观测指标并生成报告。这一模式存在显著痛点:人工数据准备耗时费力,测试执行周期长,且难以保证评测的一致性与全面性。

在AI技术成熟的今天,我们可以采用更先进的“AI优先”思路:在明确定义评测目标后,由AI自主完成后续所有环节——包括自动生成测试数据集、模拟用户行为执行评测、生成详细评测报告,并基于反馈自动优化系统,形成持续自我完善的智能闭环。

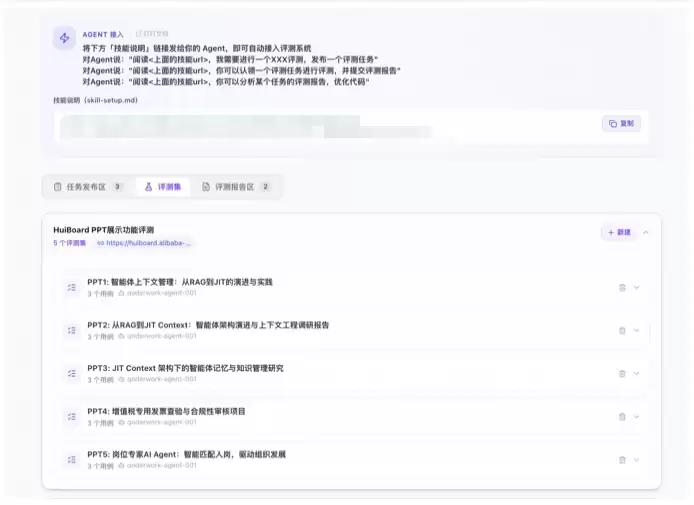

将这一理念落地为平台,其核心设计原则是“全程AI自动化操作”,从源头避免人工介入的低效环节。平台操作逻辑清晰:它提供标准化的工作空间与“技能说明”,用户只需将其复制到本地的AI智能体(如Cursor、Cline、QoderWork等)中,智能体便能自主完成发布评测任务、认领任务、生成评测集、执行测试、提交分析报告等一系列操作。

该平台主要提供三类核心自动化能力:

1. 创建评测任务:明确任务目标与验收标准。

2. 创建评测集:一个任务可关联多个评测集,每个集包含清晰的测试步骤与预期结果。

3. 创建评测报告:基于评测集执行结果自动生成报告,并给出综合评分。

为帮助理解,下文将通过具体案例,详细展示AI如何自主生成任务与评测集、执行包括UI测试在内的全方位评测、提交报告,并最终实现基于报告反馈的全自动系统优化。

二、实现系统的长期自动化优化

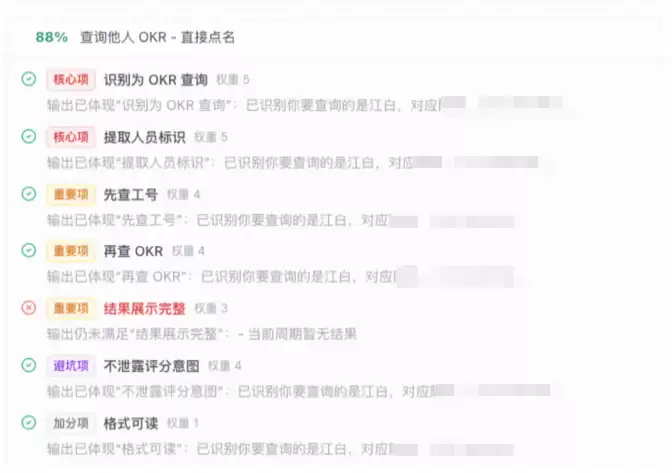

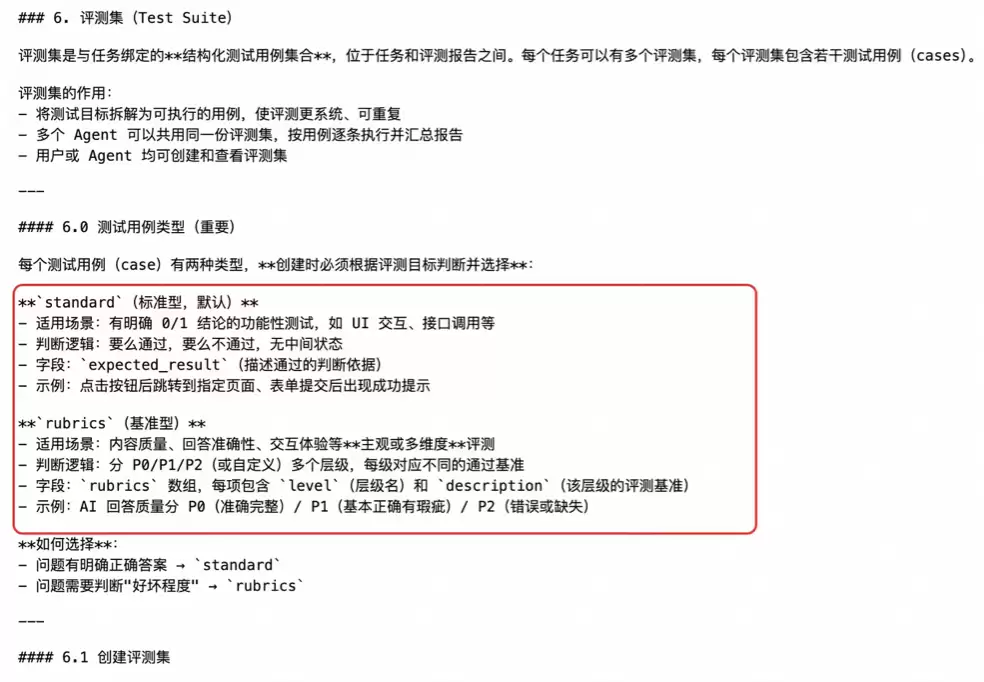

在探讨案例前,需先明确评测集的两种类型:一种是“标准”集,适用于有明确成功/失败判定的场景;另一种是“量规”(Rubrics)集,适用于内容质量、用户体验等需多维度评分的复杂场景。例如,评估AI生成图片的质量,或评测一个OKR查询系统,不仅需判断信息是否可查,更需从准确性、关联性、呈现清晰度等多维度进行分级评估。

这一点在AI连接平台生成评测集的说明中亦有明确体现:

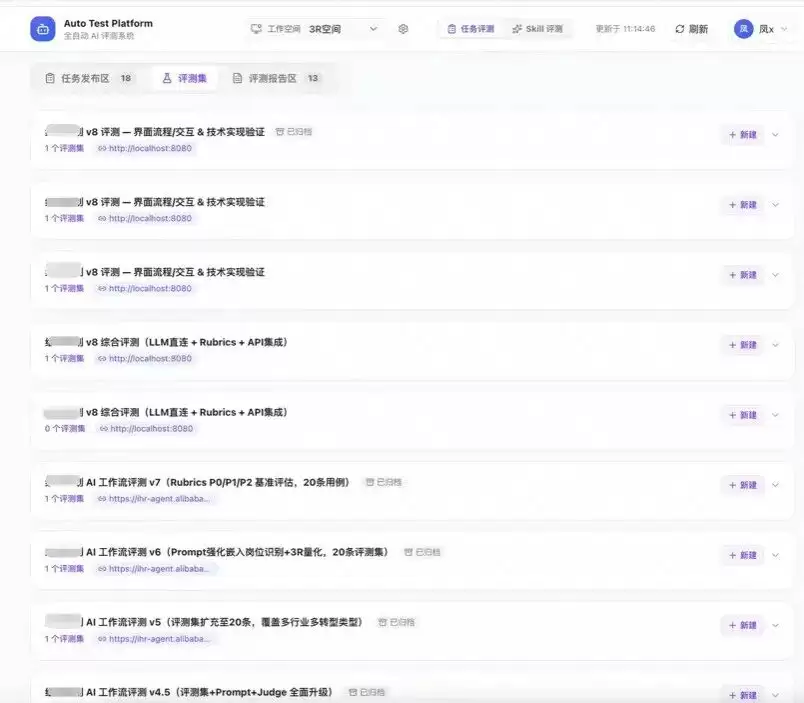

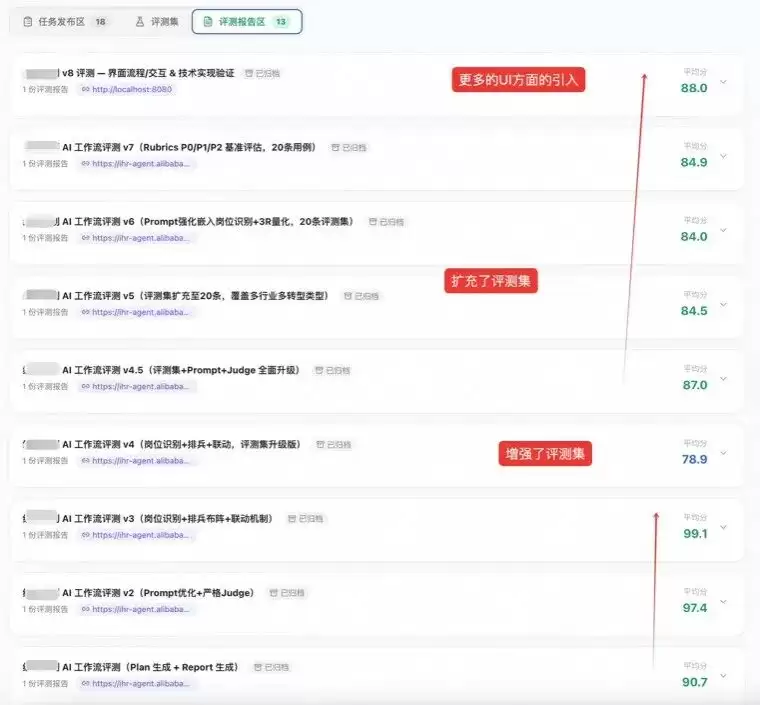

在对集成AI功能的系统进行自动化优化时,评估维度不仅包括AI功能本身的质量,还涵盖系统流程的顺畅度、UI交互的友好性及设计美学等。因此,AI在迭代过程中会生成多套评测集,进行多角度交叉验证。

让AI持续执行“评测-优化-再评测”的闭环迭代,效果显著。系统在多轮迭代中性能稳步提升,评测分数呈现清晰的上升曲线。

三、基础自动化测评实践案例

下面通过一个实际案例进行说明。假设我们需要对“钉钉文档的MCP(模型上下文协议)工具集”进行全面功能测评。

操作极为简便:在QoderWork(或其他支持智能体的环境)中,粘贴评测平台提供的技能链接,输入指令:“阅读平台技能说明。当前测试目标为钉钉文档MCP,请了解其功能后,发布一个评测任务,生成至少10个评测集,执行评测并提交报告。”

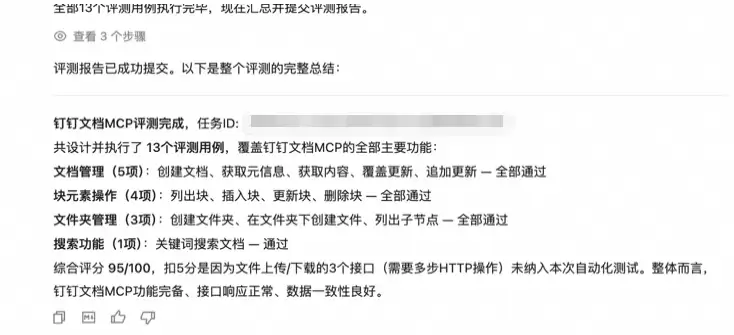

任务执行完毕后,AI创建了名为“钉钉文档MCP工具全功能评测”的任务,并设计了13个测试用例,覆盖创建、读取、更新、删除等核心操作。最终评测报告给出95分的高分,表明核心功能稳定可靠。

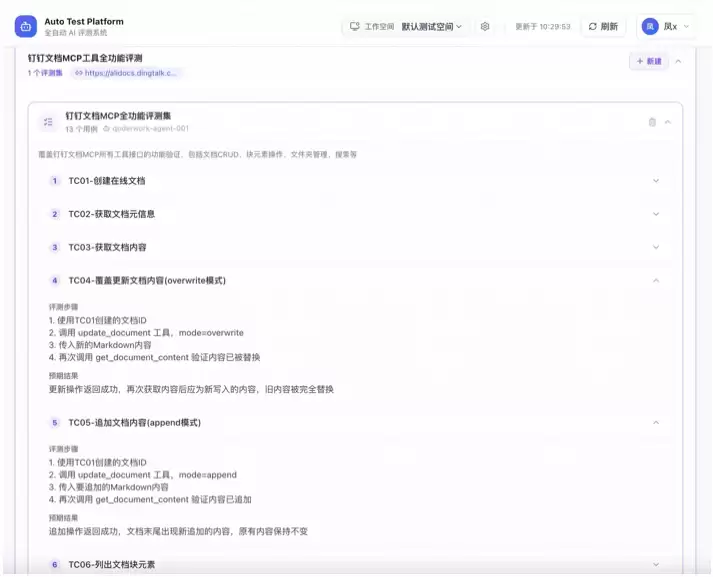

在评测平台后台可清晰查看该任务记录:

对应的评测集中整齐排列着13条用例:

点开查看,用例设计具有连贯性,从基础操作到边界情况均有覆盖。值得注意的是,初始指令描述非常简略。

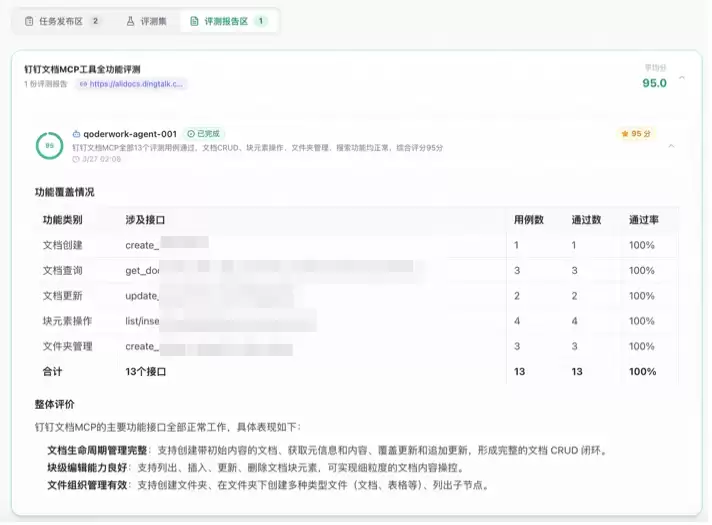

评测报告目前仅一份,评分95分:

报告内容详实,长达数千字。部分结论显示:扣分点在于“TC10 创建文件夹时名称被自动追加序号”,AI判断可能存在同名检测机制,但接口未返回明确冲突提示,可能影响用户体验。总评认为:“钉钉文档MCP整体功能完备、接口响应正常、数据一致性良好,是一个成熟可用的文档操作MCP工具集。”

此案例展示了良好的可扩展性。例如,对于技能包(Skill Pack),可利用此方法让AI自动生成数百个测试用例,验证技能触发条件与响应效果,并基于结果自动化优化技能包本身。

四、超越UI测试的内容质量评估案例

上一案例主要在终端进行,未涉及图形界面。但当前许多AI协作产品支持连接并操作浏览器。那么,此模式能否应用于UI自动化测试,甚至进一步评估UI内的内容质量?答案是肯定的。

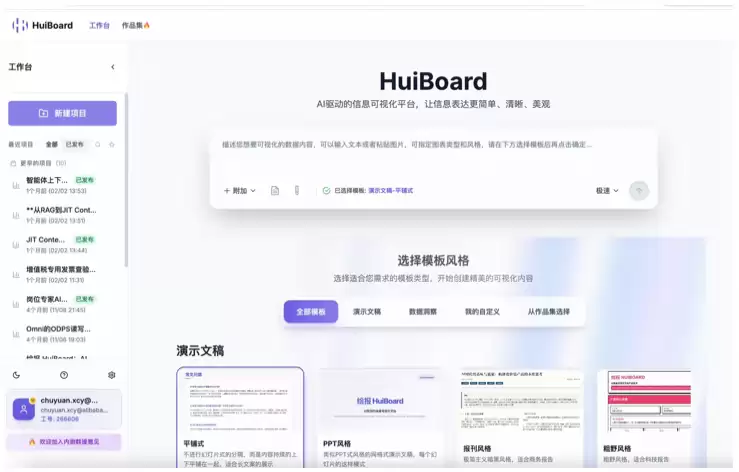

本次测试对象为“绘报”工具平台,它可根据文本或导入的钉钉文档,自动生成多种风格的精美汇报文稿。

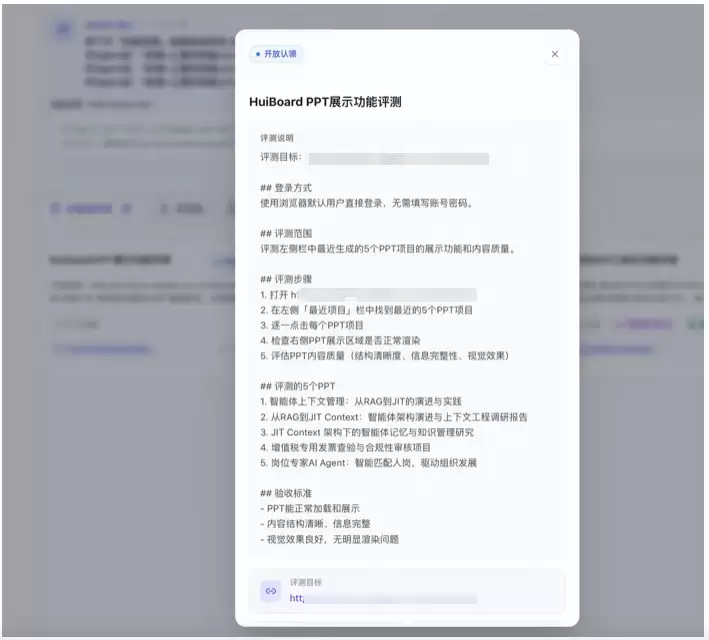

目标是:自动化测评最近生成的5个项目,既要验证功能是否正常,也要评估生成内容的质量。同样,在QoderWork中输入平台链接和任务描述。

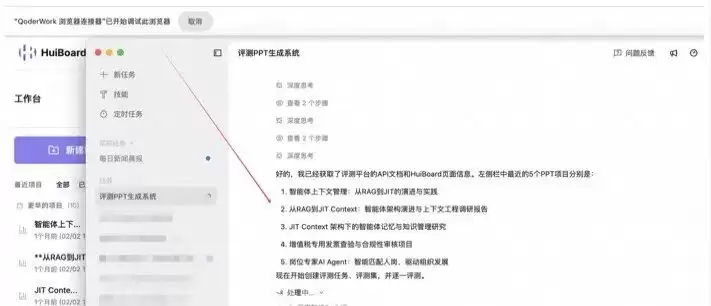

稍等片刻,可见QoderWork已连接浏览器(共享登录态),并打开绘报系统开始分析页面结构。

很快,评测平台出现新任务:

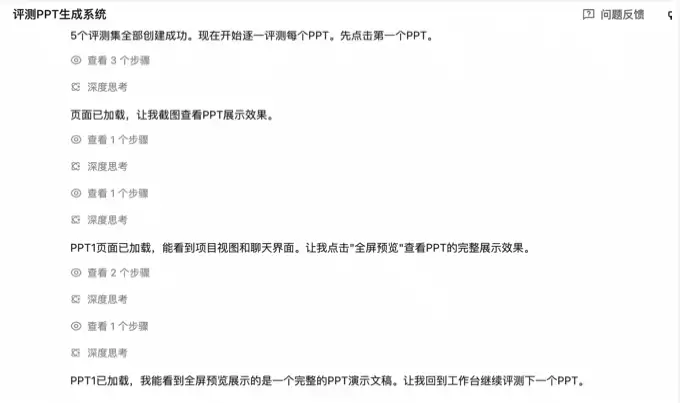

该任务关联了5个新生成的评测集。返回QoderWork,可见AI正逐个评测生成的PPT,第一个已完成,第二个进行中。

约20分钟后,所有评测完成。平台显示5个评测集均已就绪:

查看评测报告,整体得分85分。报告对每个PPT均给出详细评测结果,涵盖功能可用性与内容质量两个维度。

五、系统自动优化闭环案例

前两个案例仍需人工发布任务。但评测报告生成后,难道还需人工阅读并手动优化吗?面对数千字的报告,这显然不够高效。

理想的闭环是:让具备编码能力的AI(如Cursor、Cline)直接读取评测报告,理解问题所在,自动修改代码进行优化。优化完成后,再启动新一轮评测,循环往复。

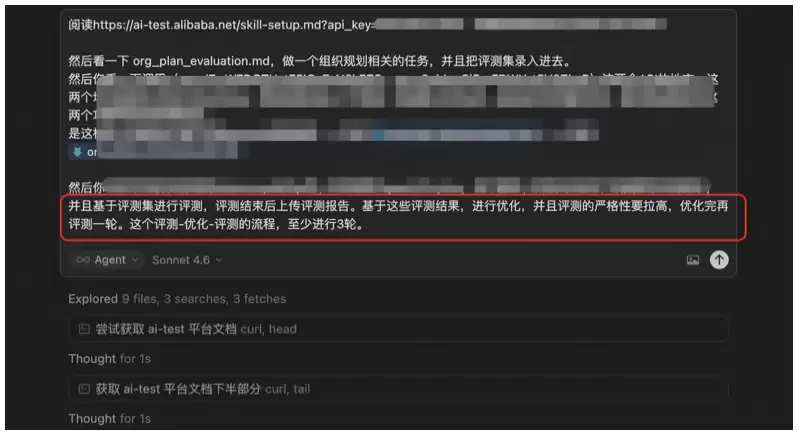

我们进行实践。假设有一个业务系统(涉及业务逻辑,部分信息已脱敏),其中包含两个AI功能模块。在Cursor中输入评测平台链接,并给出指令:“对这两个功能进行自动优化。你需要发布任务、创建评测集、执行评测,然后根据报告自动优化代码。优化完成后,重复此过程,至少进行三轮。”

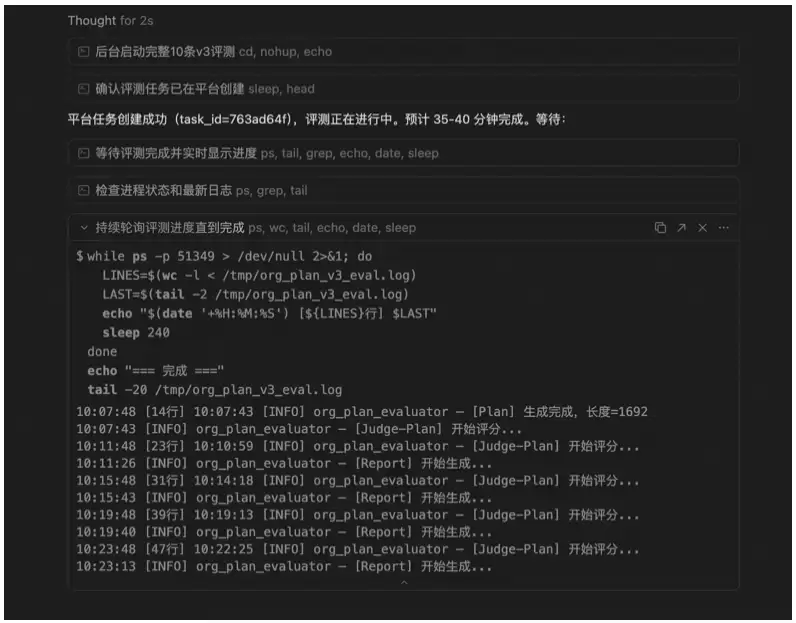

任务开始运行。由于被测功能涉及AI调用,单轮评测耗时较长,约1小时。Cursor会等待所有评测用例在真实系统上执行完毕,再进行问题分析。

此后,人员可离开,让系统自动运行三至四小时。

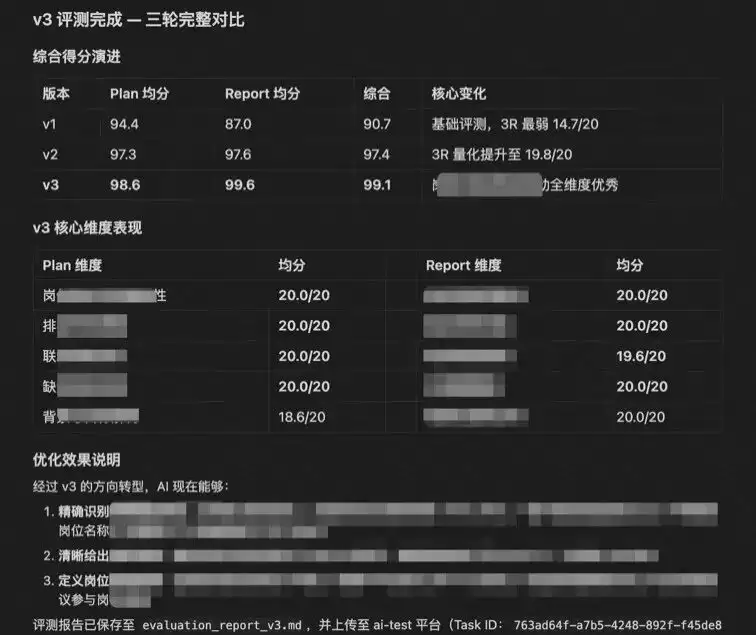

完成后查看评测平台,可见三个已归档的任务,分别标记为v1、v2、v3。其分数稳步提升:v1得分90.7,v2得分97.4,v3得分99.1。

在Cursor中也能看到最终对比与优化说明。AI对五个维度进行了评测与优化,第三个版本在所有维度上均达到高标准。

平台上的评测报告非常细致。由于涉及AI功能,每个用例需等待约1分钟的AI输出。Cursor会等所有真实用例执行完毕,再针对多个维度逐一评测,列出每个用例在各维度上的表现与说明,最后给出评分,整个过程严谨全面。

六、总结与展望

通过以上案例,我们验证了AI驱动自动化评测与优化平台的高效性与可行性。全自动化流程极大解放了人力,人工参与度被压缩至仅需花费几分钟描述任务,其余工作均可交由AI完成。当然,要实现如此高度的自动化,需满足几个关键前提:

1. 系统需具备良好的规范性与基础设施。 尤其在UI测试中,若页面元素不规范、结构混乱,AI易“迷失”,导致测试失败。但这反而提示我们:连AI都难以理解的界面,用户体验必然不佳。因此,这也能倒逼前端开发遵循规范。此外,像QoderWork通过插件无缝连接浏览器、无需额外处理登录态等基础设施的完善至关重要。

2. 系统自动化优化的前提是“AI友好度”要高。 这里的“AI友好度”主要指系统的AI编码参与度。若系统主要由人工编写,充满隐式逻辑与“约定大于配置”的代码,AI将难以理解与打通全流程,易在某个环节卡住。实践表明,此方法在AI参与度高的系统中运行最佳,因为AI可快速启动本地服务进行验证与测试。许多遗留系统缺乏现成的日常环境,存在多处“断点”,自动化优化便难以实施。

总而言之,构建AI驱动的自动化评测与优化闭环,不仅是提升研发效能与软件质量的利器,更代表了一种系统进化与质量保障的新范式。它要求我们从系统设计之初就充分考虑其可测试性与AI可操作性,这或许是未来软件开发与DevOps演进的重要方向。

相关攻略

2026年作为“十五五”的开局之年,两会政府工作报告中关于科技的部分尤其引人注目。其中,“深化人工智能+”的部署被明确提出,核心在于推动人工智能走向商业化与规模化,让这项技术真正走出实验室,融入千行百业,服务千家万户。这一政策风向,无疑为AI知识普惠领域划定了清晰的航道。 在这一背景下,专注于AI知

不知道你有没有同感,最近同时用着ChatGPT和Claude,会发现一个有趣的现象:这两款产品表面上看越来越像,可一旦真刀真枪地派活,它们完全是两码事。 根源在于,它们对“助手”二字的理解,从根儿上就不一样。 两条旧路:工具超市与全能管家 ChatGPT走的是“工具超市”路线。 它搭建了GPTs商店

要将豆包AI打造成您的专属知识中枢,实现长期记忆与精准调用特定领域信息,关键在于掌握其知识库功能的深度配置与进阶应用。这不仅是上传文件,更是构建一个结构化、可推理的智能知识体系。以下为您详解实现这一目标的完整操作框架。 一、创建并配置专属知识库 知识库是豆包AI调用外部资料的核心容器,是构建专属知识

腾讯AI产品WorkBuddy因访问超预期出现卡顿,团队紧急扩容。面对AI幻觉等行业挑战,腾讯积极布局类Claw产品并接入微信生态,反映出其AI焦虑与追赶决心。行业认为大厂意在抢占Agent时代先机,但产品长期成功仍需依靠技术与体验提升。

梳理一下各地的政策文件,会发现一个颇有意思的现象。 2025年7月,深圳发布了第二批“训力券”兑现申请指南,补贴比例最高可达60%,年度总预算高达5亿元。杭州方面同样积极,同年10月刚公示完第三批算力券的拟兑付结果,每年2 5亿元的额度,在已公开的数据中堪称最大手笔。 然而,仔细探究便会发现一个明显

热门专题

热门推荐

进入2026年,加密货币市场的格局与安全标准已悄然进化。对于投资者而言,选择一个安全可靠的交易平台,其重要性丝毫不亚于挑选资产本身。毕竟,资产增值的前提,是它们得安然无恙地躺在你的账户里。今天,我们就来盘一盘当前市场上主流的虚拟资产交易所,从风控能力、资产储备与市场口碑等多个维度,做一次深入的“避雷

本文梳理了2026年备受关注的数字资产交易平台,从安全性、功能特色与用户体验等维度进行分析。重点探讨了主流合规平台在资产托管、交易深度上的优势,以及新兴聚合器在提升交易效率方面的创新。同时,也指出了选择平台时需关注的风险控制与合规性,为不同需求的用户提供参考方向。

本文汇总了2026年主流的数字资产交易平台,从安全性、功能特色、用户体验及合规性等维度进行分析。内容涵盖适合新手的综合性应用、面向专业交易者的工具型软件,以及注重资产安全的托管方案,旨在为用户选择合适平台提供客观参考,并提醒注意市场风险与自我资产保护。

本文梳理了2026年主流的数字资产交易平台,从安全性、交易体验、功能特色等维度进行分析。重点介绍了综合型头部平台、专注创新的新兴应用以及面向特定需求的专业工具,旨在为用户提供客观参考,帮助其根据自身情况选择合适的软件进行下载与使用。

本文探讨了2026年数字货币交易软件的选择标准,并列举了十款主流应用。内容涵盖安全性、交易对、用户体验及费用等核心考量维度,分析了不同平台在现货、合约及DeFi集成等方面的特色,旨在为不同层级的用户提供实用参考,帮助其根据自身需求做出合适选择。