英伟达MIT华人团队开源技术大幅降低大模型推理内存消耗

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

仅凭一张家用RTX 4090显卡的24GB显存,就能流畅运行一个拥有320亿参数的AI大模型,一口气读完6份长文档并自动生成周报?这并非极客魔改,而是来自MIT、英伟达与浙江大学研究者的最新突破。

这项名为TriAttention的技术,精准瞄准了大模型推理中的核心瓶颈——KV缓存显存占用。其核心思路巧妙:在预旋转位置编码(pre-RoPE)的空间内,利用查询(Q)与键(K)向量的三角集中度,动态评估每个键值(KV)对的重要性,从而智能地选择性保留最关键的部分。

形象地说,传统的KV缓存压缩如同将行李箱内所有物品(无论蓬松羽绒服还是沉重砖块)全部塞入压缩袋。而TriAttention的做法,则是先开箱仔细甄别,果断舍弃“砖块”,只精心打包真正有价值的“羽绒服”。这种基于重要性的KV缓存选择性保留策略,实现了内存占用的数量级下降。

实测性能:数据揭示显著提升

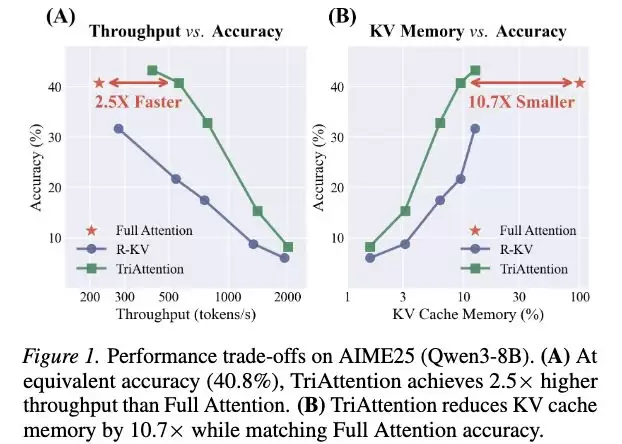

在AIME25数学推理基准测试中,TriAttention在完全保持全注意力机制(Full Attention)40.8%准确率的同时,将推理吞吐量提升了2.5倍。更重要的是,它将KV缓存的内存占用直接降低了10.7倍,大幅缓解了显存压力。

需要明确的是,此项技术主要优化的是KV缓存的内存,而非整个模型的参数量。但在处理长文本、多轮对话等长序列任务时,持续增长的KV缓存正是导致显存溢出的关键。解决此问题,直接决定了模型能否在有限资源下成功运行。

主要实验基于Qwen3-8B模型,覆盖了AIME24、AIME25、MATH500等多个评测任务。在生成长度达32K token的苛刻条件下,TriAttention几乎未损失任何模型精度,同时显著提升了推理效率。

从论文到应用:单卡流畅运行320亿参数智能体任务

该技术的实用潜力在论文附录的真实部署案例中得以验证。场景为OpenClaw多轮智能体工作流,任务要求读取6份Markdown格式长文档,并自动生成汇总周报。

部署模型为经过AWQ INT4量化的Qwen3-32B,硬件仅为单张RTX 4090(24GB显存)消费级显卡。若不进行KV缓存压缩,冗长的系统提示和多轮文档读取将导致KV缓存急剧膨胀,显存瞬间耗尽。而启用TriAttention后,智能体顺利完成了全部文档阅读并输出了完整报告。

虽然此案例基于量化模型与特定智能体流程,但它有力证明:一个完整、具备实际生产价值的AI智能体任务,已可在消费级硬件上成功部署与运行。

工程化落地:vLLM插件与MLX实验性支持

TriAttention已走出学术论文,迈向工程实践。研究团队已在GitHub提供了与vLLM推理引擎的集成插件,详细说明了如何通过OpenAI兼容的API或Python API进行调用,并包含接入OpenClaw的指引。

这意味着,开发者无需修改模型架构或重新训练,只需像安装插件一样将其接入现有vLLM推理管线,即可即刻获得KV缓存压缩带来的性能收益,实现高效的大模型本地部署。

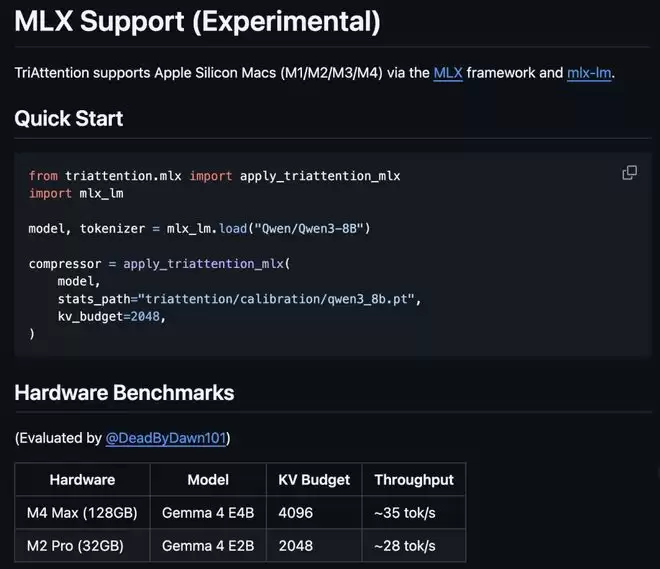

此外,针对Apple Silicon生态用户,仓库也提供了实验性支持文档,覆盖M1至M4全系芯片。该方案基于MLX框架与mlx-lm库运行,附带了示例代码与硬件基准测试,为大模型在Mac上的本地运行提供了新思路。

文档明确标注“实验性”,表明这仍是早期探索,距离成熟的Mac本地部署方案尚有距离,但技术方向已然清晰。

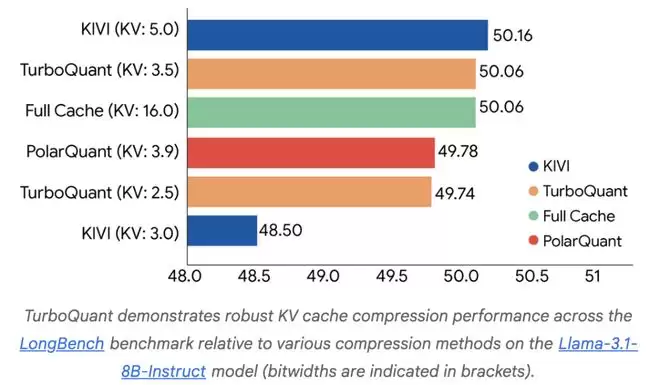

KV缓存压缩技术的两大路径

当前,KV缓存优化主要沿两大技术路线演进。

一是“量化派”,核心思路是降低数据表示精度。例如,Google Research近期推出的TurboQuant方案,旨在将KV缓存与向量搜索的比特数压缩至极低水平,同时宣称保持零精度损失。

另一条则是“选择性保留派”,TriAttention正是此路径的最新代表。它不改变数据精度,而是通过智能算法判断,直接丢弃不重要的KV token,从根本上减少需存储的数据量。

两者终极目标一致:让大模型能在消费级硬件上流畅运行,避免显存溢出,保持精度稳定。但方法论迥异:前者是为每件行李“瘦身”,后者则是直接减少行李“件数”。理论上,两种策略可结合使用,潜力巨大。

目前社区尚缺在相同模型、硬件与任务下的严格对比,因此孰优孰劣尚无定论。但可以肯定,这两条技术路线都在加速向消费级部署场景推进。

回想一年前,“本地运行大模型”仍带实验色彩,运行70亿参数模型都需一番周折。如今,320亿参数模型在单张消费级显卡上完成复杂智能体任务,Apple Silicon上的MLX生态每周更新,vLLM插件让KV压缩变得“即插即用”。KV缓存压缩这项关键技术,正迅速从论文中的消融实验,转变为每位开发者触手可及的工程现实,推动着大模型本地部署的普及。

相关攻略

当我们探讨超大模型(或称大语言模型)的强大能力时,其背后对用户隐私与数据安全的特殊要求不容忽视。尤其是在处理个人敏感信息时,这一问题变得尤为复杂和关键。这主要源于模型复杂的算法结构及其处理海量数据的特性。那么,在AI模型的应用中,具体有哪些隐私与数据安全的关键环节需要企业和技术团队重点关注呢? 一、

探讨大模型技术时,其多语言处理能力始终是一个核心议题。这项能力如同一把双刃剑,既开启了前所未有的应用场景,也伴随着一系列复杂的深层挑战。本文将深入剖析大模型多语言能力的应用价值与潜在难题。 应用:跨越语言边界的可能性 大模型的多语言特性,正在全球范围内驱动多个行业的实质性变革与效率提升。 机器翻译与

5月13日最新行业观察显示,“天下没有免费的午餐”这一准则,正在人工智能大模型领域加速应验。当前,面向普通用户开放的各类AI服务,其背后的开发厂商正稳步推进商业化付费模式。这标志着行业告别野蛮生长,步入追求可持续健康发展的成熟阶段,付费实为产业走向正规化的必然趋势。 事实上,在探索商业化落地的道路上

当人们谈论大模型时,文本生成与智能对话往往是第一印象。然而,其在图像与视频处理领域的强大能力,同样值得高度关注。依托先进的深度学习架构,大模型正在重塑多媒体内容的分析与生成方式,为企业带来前所未有的技术赋能。那么,它究竟能解决哪些实际问题?又是如何驱动业务增长的呢?我们可以从以下几个核心应用场景深入

要让大语言模型真正掌握并流畅生成跨语言、跨文化的文本内容,是一项复杂而系统的工程。这需要从数据源头到模型架构,再到评估优化的全链路精细设计,融合多种策略与技术方案。接下来,我们将深入剖析实现这一目标的核心方法与关键技术路径。 一、数据预处理:构建多语言理解的坚实基础 模型性能的优劣,首先取决于训练数

热门专题

热门推荐

本文梳理了2026年主流数字资产交易平台的特点与选择策略。重点从安全性、资产丰富度、交易体验、创新功能及合规性等维度进行分析,旨在帮助用户根据自身需求,在众多平台中做出明智选择,而非简单罗列排名。选择平台需综合考量资金安全、操作习惯与长期发展愿景。

本文梳理了2026年现货交易所的竞争格局,从交易深度与流动性、资产安全与合规性、用户体验与产品创新三个维度进行深度分析。文章指出,头部平台在合规与技术创新上持续领跑,新兴交易所在细分市场寻求突破,行业整体呈现出专业化、合规化与用户体验并重的发展趋势,为不同需求的用户提供了多元选择。

本文梳理了2026年主要数字资产交易平台的综合表现,从安全性、资产多样性、用户体验及创新服务等维度进行分析。榜单反映了行业向合规与专业化发展的趋势,头部平台在技术架构与风控体系上持续投入,新兴平台则凭借细分领域创新获得关注。投资者需结合自身需求,理性评估平台特点与风险。

今年四月,AI网络初创公司Aria Networks携1 25亿美元融资高调登场,并向业界抛出了一个直指核心的判断:下一阶段AI基础设施的竞争,焦点已不仅仅是堆砌更多的GPU,而在于能否构建一个能充分释放这些算力潜能的“神经网络”。 这家由前Arista和Juniper高管创立、总部位于帕洛阿尔托的

仅凭一张家用RTX 4090显卡的24GB显存,就能流畅运行一个拥有320亿参数的AI大模型,一口气读完6份长文档并自动生成周报?这并非极客魔改,而是来自MIT、英伟达与浙江大学研究者的最新突破。 这项名为TriAttention的技术,精准瞄准了大模型推理中的核心瓶颈——KV缓存显存占用。其核心思