高性能架构演进之路从单线程到协程的五次关键升级

从最早的“来一个请求开一个进程”,到今天的协程,每一次架构升级都是被现实逼出来的。理解这个演进过程,你就真正理解了高性能服务器的本质。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

经常有人问:Redis为什么单线程能跑出10万QPS?Nginx为什么比Apache快那么多?

这些问题的答案,其实就藏在服务器架构三十年的演进史里。每一次技术变迁,背后都对应着一个亟待解决的核心矛盾。我们从头说起。

一、单线程模型:能跑,但只能同时接一个人

最原始的服务器模型简单得惊人,大概长这样:

int server_fd = create_listen_socket(8080);

while (1) {

int client_fd = accept(server_fd, NULL, NULL);

handle_request(client_fd); // 处理完才能接下一个

close(client_fd);

}逻辑清晰,代码也简单,但有个致命的缺陷:handle_request是阻塞的。想象一下,一个客户端在慢悠悠地传文件,后面999个连接只能干等着。这种模型的并发数等于1,与其说是服务器,不如说是个单人窗口的排号机。

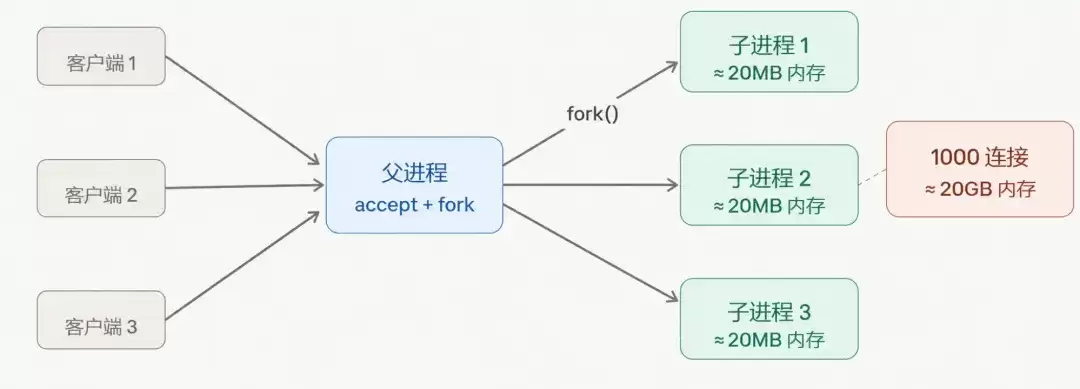

二、多进程模型:来一个客户,fork一个儿子

为了解决并发问题,最直观的思路就是:来一个连接,就开一个进程去处理它。Apache早期的prefork模型,走的就是这条路。

while (1) {

int client_fd = accept(server_fd, NULL, NULL);

if (fork() == 0) {

// 子进程:处理这个连接

close(server_fd);

handle_request(client_fd);

exit(0);

}

// 父进程:继续等下一个连接

close(client_fd);

}并发问题看似解决了,但新的麻烦接踵而至:进程太重了。每个进程都有自己独立的地址空间、文件描述符表、页表……光是fork一次的开销就不小。1000个并发意味着1000个进程,内存和CPU上下文切换的代价,会随着并发数线性膨胀。这,正是著名的C10K问题的根源之一——想靠进程模型撑住一万个并发连接,几乎是不可能的任务。

三、多线程模型:同一屋檐下,共享内存

既然进程太重,那换成线程怎么样?线程共享同一个进程的地址空间,创建和切换的成本比进程轻量得多。于是,“一连接一线程”的方案出现了,后来又演进成更高效的线程池——预先创建好一批线程,来了任务就往里塞。

// 线程池简化版

ThreadPool pool(100); // 预创建100个线程

while (1) {

int client_fd = accept(server_fd, NULL, NULL);

pool.submit([client_fd]() {

handle_request(client_fd);

});

}这比多进程模型好了不少,但本质问题依然存在:每个线程在等待I/O时仍然是阻塞的。1000个连接,哪怕其中990个都在等网络数据,也得占着990个线程傻等。线程数一多,内核调度的开销就上来了,而且每个线程默认还有几MB的栈空间,内存压力依然不小。多线程模型的瓶颈在于,它用昂贵的线程来承载“等待”这件事,实在太浪费了。

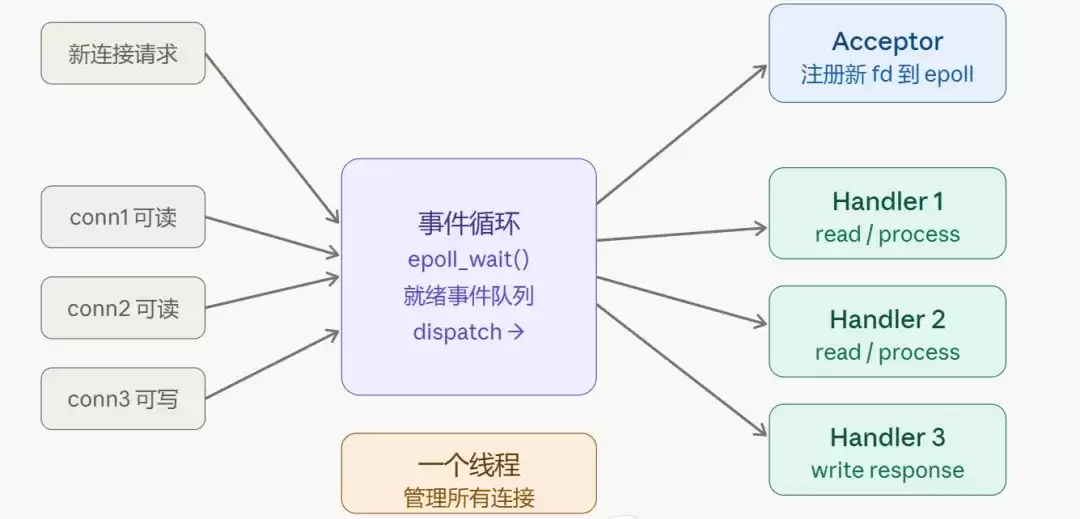

四、Reactor模型:只干活,不等待

这才是高性能服务器领域真正的革命。它的核心思想只有一句话:不要让线程去等I/O,让I/O就绪了再通知线程来处理。 这就是Reactor模式,也叫事件驱动模型。

整个模型由三个核心角色构成:事件分发器(Dispatcher,通常用epoll实现,负责监视所有文件描述符)、处理器(Handler,负责具体的业务逻辑)和接收器(Acceptor,专门处理新连接)。

它的核心骨架代码非常简洁:

// Reactor核心循环(伪代码)

while (1) {

int n = epoll_wait(epfd, events, 64, -1); // 等待事件发生

for (int i = 0; i < n; i++) {

int fd = events[i].data.fd;

if (fd == listen_fd)

acceptor_handle(fd); // 处理新连接

else

handler_dispatch(fd); // 处理读写事件

}

}Nginx就是这种架构的典范:一个worker进程跑一个事件循环,用epoll管理数以万计的连接。哪个连接有数据来了,才去处理它;其余时间,线程就在epoll_wait里“睡觉”——不占CPU,也不浪费线程资源。这正是Nginx性能能够吊打Apache传统模型的根本原因。

五、Multi-Reactor:多核时代的进化

单个Reactor再猛,也只能跑在一个CPU核上,无法利用多核优势。于是,Multi-Reactor(或称主从Reactor)模式应运而生:一个Main Reactor专门负责接受新连接,然后将连接分发给多个Sub-Reactor,每个Sub-Reactor独立运行一个事件循环来处理连接的读写。

这其实就是Nginx的多worker进程架构,以及Netty多EventLoop线程模型的本质。

Main Reactor(主线程)

└─ epoll 监听 listen_fd

└─ 新连接来了 → 分发给某个 Sub Reactor

Sub Reactor 0(线程0) Sub Reactor 1(线程1)

├─ conn1 ├─ conn3

├─ conn2 └─ conn4

└─ ... ...

通过负载均衡和多核并行,这种架构即使面对百万级别的连接数也能从容应对。

六、Reactor的隐痛:回调地狱

然而,Reactor模型有一个绕不开的痛点:业务逻辑会被打碎成一堆回调函数。想象一个简单的请求流程:读请求 → 查数据库 → 写响应。

在多线程模型里,代码是直来直去的:

// 多线程:直线逻辑,清晰

read(fd, buf);

result = db_query(buf);

write(fd, result);但在Reactor模型里,就变成了这样:

// Reactor:逻辑被拆散成回调

on_readable(fd, [](fd) {

read(fd, buf);

db_query_async(buf, [](result) {

write(fd, result);

// 还有更多嵌套...

});

});一旦业务复杂,嵌套层数增多,就会陷入臭名昭著的“回调地狱”——代码难以阅读和维护,调试更是如同噩梦。而解决这个问题的钥匙,就是协程。

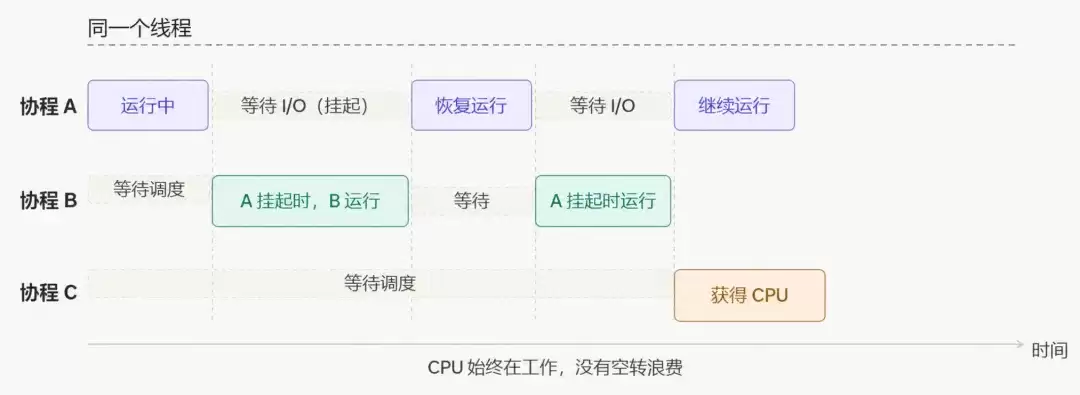

七、协程:鱼和熊掌都要

协程的终极目标非常明确:用同步的写法,达到异步的性能。

原理其实很直观:当遇到I/O等待时,不阻塞线程,而是“挂起”当前协程,把CPU让出去执行其他协程;等I/O就绪后,再“恢复”挂起的协程继续执行。关键在于,协程的挂起和恢复完全在用户态完成,不需要内核介入,开销极低。

用协程写服务器,业务代码能保持多线程时代的直线逻辑,但底层会自动进行协程切换:

// 协程风格:看起来是阻塞的,底层是非阻塞的

co_await read(fd, buf); // 挂起,让出CPU

result = co_await db_query(buf); // 挂起,让出CPU

co_await write(fd, result); // 挂起,让出CPU

// 代码像同步,性能像异步这就是为什么Go语言的goroutine能让开发者用同步的思维写出高并发程序——底层正是协程调度在发挥作用。微信的libco、腾讯的fiber库,也都是基于同样的原理。

八、五代架构终极对比

九、高频面试题精析

Q:Redis单线程为什么这么快?

Redis的网络层采用的就是单线程Reactor模型——一个事件循环用epoll管理所有连接。它快的根本原因有三点:第一,数据操作全在内存中完成,没有磁盘I/O瓶颈;第二,命令处理时间极短(微秒级),不会长期占用CPU;第三,单线程模型避免了多线程的锁竞争开销。单线程 + epoll + 内存操作,三者叠加,共同支撑起了10万QPS的惊人性能。(注:Redis 6.0引入了多线程来处理网络I/O,但核心的命令执行器仍然是单线程的。)

Q:Nginx为什么比Apache快?

本质是架构的差异。Apache传统上采用多进程或多线程模型(一连接一线程/进程),当并发数高时,进程/线程的切换开销和内存占用会急剧上升。而Nginx采用Multi-Reactor事件驱动架构,每个worker进程一个事件循环,一个worker就能轻松管理上万个连接,几乎没有上下文切换开销,内存占用极低。

Q:协程和线程的本质区别?

线程切换由内核调度,需要从用户态陷入内核态,保存和恢复完整的CPU上下文,开销在数微秒量级。协程切换在用户态完成,只需保存和恢复少量寄存器,开销在纳秒级。因此,一个线程可以运行成千上万个协程,协程在等待I/O时主动让出CPU,资源利用率接近100%。

Q:什么场景用多线程,什么场景用协程?

对于CPU密集型任务(如加密解密、数据压缩、音视频编解码),应使用多线程,以充分利用多核CPU的并行计算能力。对于I/O密集型任务(如网络请求、数据库查询、文件读写),协程是更优的选择,因为在等待I/O期间不会浪费CPU资源。事实上,绝大多数服务器业务都属于I/O密集型,这也是协程架构近年来大行其道的原因。

十、结语

回顾从单线程到协程的演进之路,每一次架构升级背后,都有一个核心矛盾在驱动:

- 多进程解决了“一次只能处理一个连接”的问题,但代价是内存和进程开销爆炸。

- 多线程减轻了内存压力,但线程切换的开销随着并发数线性增长。

- Reactor模型让线程彻底从“等待”中解放出来,一个线程就能管理上万连接。

- 协程则在Reactor高性能的基础上,一举消灭了“回调地狱”,让代码重新变得清晰可读。

这条路走下来,本质上就在做一件事:不断减少“等待”对系统资源的浪费。 理解了这一点,也就理解了所有高性能服务器背后的设计哲学。

相关攻略

从最早的“来一个请求开一个进程”,到今天的协程,每一次架构升级都是被现实逼出来的。理解这个演进过程,你就真正理解了高性能服务器的本质。 经常有人问:Redis为什么单线程能跑出10万QPS?Nginx为什么比Apache快那么多? 这些问题的答案,其实就藏在服务器架构三十年的演进史里。每一次技术变迁

在第十九届北京国际汽车展览会上,长城汽车超豪BG正式对外发布GF高性能架构,并宣布将于2027年推出中国首台符合国际赛事标准的GT3赛车,填补中国品牌在顶级场地赛事领域的技术空白。 发布会现场,长城汽车超豪BG CEO宋东先的宣言掷地有声:“长城将要造中国人自己的第一台GT3赛车。” 这不仅仅是一句

热门专题

热门推荐

韩国Upbit交易所宣布于5月14日上线Superform(UP2),并开放韩元、比特币及泰达币交易对。用户可在公告后一个半小时内开始充值准备。此举通常有助于管理新资产流动性,上线可能提升该代币的市场关注度与流动性,但加密货币波动大,投资前需独立研究并注意风险。

审计报告是审计工作的核心成果,但其编制过程往往涉及大量重复、繁琐的手工作业。如何实现审计报告生成的智能化与高效化?RPA(机器人流程自动化)技术驱动的审计报告自动生成机器人提供了完美解决方案。它通过模拟人工操作,将审计流程中标准化、重复性的任务全面自动化,从而释放审计人员精力,使其更专注于高价值的专

本文探讨了去中心化交易平台在2026年的发展格局,分析了其相较于中心化平台的核心优势,如资产自托管与抗审查性。重点盘点了以Uniswap为代表的自动做市商、以dYdX为代表的衍生品DEX,以及新兴的意图执行与跨链聚合协议等类别,并展望了账户抽象与零知识证明等技术对未来用户体验和隐私的深远影响。

人工智能(AI)已深度融入金融行业的核心业务流程,正在全面重塑从客户交互到风险管控的各个环节。它不仅带来了技术层面的革新,更驱动了一场关于运营效能与金融安全的深刻变革。那么,AI具体在哪些关键场景实现了落地应用?它又是如何为金融机构赋能增效、并筑牢安全防线的呢? 一、人工智能在金融行业中的应用现状

本文探讨了去中心化交易平台在2026年的发展格局,分析了其超越单纯交易功能、向综合金融基础设施演进的趋势。文章从底层技术革新、用户体验优化、资产与流动性扩展以及治理与合规挑战等维度,梳理了当前领先平台的特点与方向,为寻求中心化平台替代方案的用户提供了参考视角。