何恺明团队发布嵌入式语言流ELF新模型

「语言是离散的,但语言模型不一定是。」这句话,恰好点出了当前大语言模型研究的一个有趣分野。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

去年,一个名为LLaDA的项目在AI圈内激起了不小的波澜。它基于「掩码扩散」原理,宣称在多项基准测试中,其性能足以与同规模的自回归大模型(即GPT这类逐字生成的模型)相媲美。这一下子,让原本略显小众的扩散语言模型(Diffusion Language Model, DLM)研究,走到了更多人的聚光灯下。

问题在于,文字本质上是离散的token序列,而扩散模型最初是为处理连续数据(如图像)而设计的。这种「先天不合」,使得视觉生成领域的主流技术,很难直接套用在语言模型上。

LLaDA证明了扩散路径的可行性之后,各路研究团队纷纷跟进。大家逐渐形成一个共识:扩散模型在文本生成上潜力巨大。它天生支持并行解码,理论上生成速度可以远超逐字输出的自回归模型。同时,它也更容易实现「填空」、「双向修改」等对自回归模型来说颇为棘手的任务。

目前,研究者主要沿着两条技术路线探索:

- 离散扩散语言模型(Discrete DLM):直接在token的离散空间里定义扩散过程。例如,用MASK遮盖token再逐步还原,或者将token向均匀分布扩散再逐步修正。这条路近年来是主流,效果也相对更好。

- 连续扩散语言模型(Continuous DLM):先将token映射到连续的嵌入向量空间,在连续空间里完成去噪,最后再转换回token。这条路理论上更优雅,但实际效果长期落后于离散方法。

而最近,何恺明团队发表的一篇新论文,恰恰选择了那条更困难的后者路线。

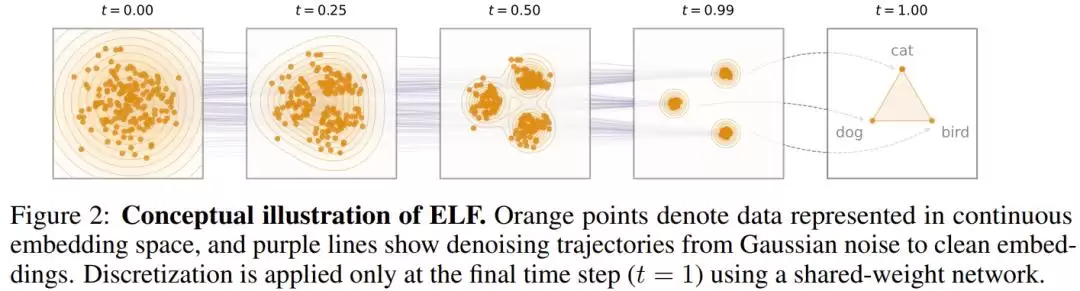

他们提出的模型名为ELF(Embedded Language Flows,嵌入式语言流),其核心思路可以用一句话概括:让扩散过程全程在连续的向量空间中进行,直到最后一步,才将结果「翻译」乘人类可读的词语。

论文共一作者Linlu Qiu在社交媒体上分享了这一成果。

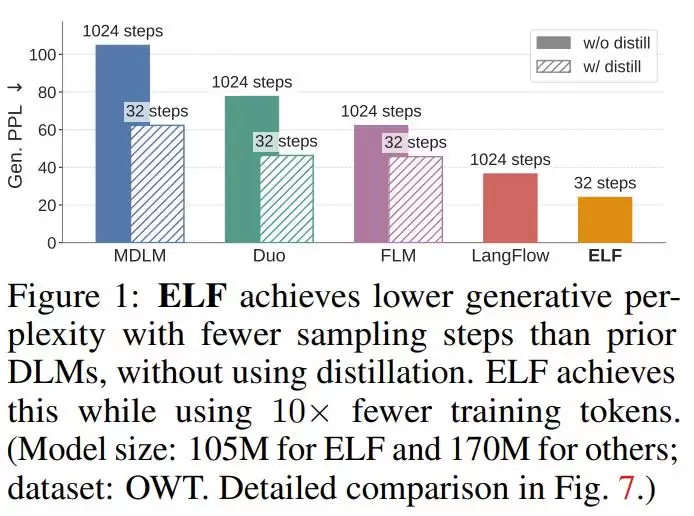

令人惊讶的是,实验结果显示,这个思路不仅可行,效果还出奇地好:仅用了不到其他方法十分之一的训练数据,其生成质量就已经实现了全面领先。

论文标题:ELF: Embedded Language Flows

何恺明的答案:只在最后一步变成词

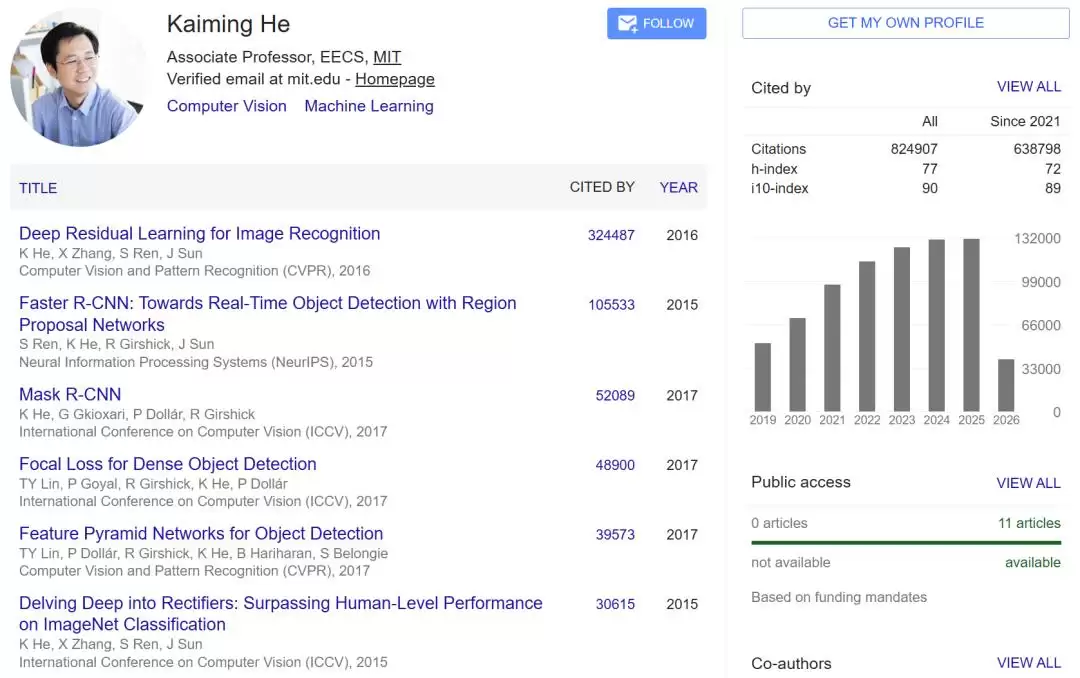

这篇论文来自MIT的一支八人团队,通讯作者是计算机视觉领域的标志性人物——何恺明。对于深度学习领域的研究者而言,这个名字意味着重量级的工作。2015年,他提出的残差网络(ResNet)解决了深层网络训练的梯度消失难题,其影响至今深远,残差连接的结构几乎渗透到所有现代AI系统中。2024年,他加入MIT后,开始系统性地探索生成模型的前沿。

业内对何恺明新工作的关注度一向很高。

而ELF,可以说是这支团队在语言生成方向上一次颇具巧思的尝试。他们的想法很直接:既然扩散模型最擅长在连续空间里工作,何不让它从头到尾都待在这个舒适区,直到终点才进行一次「转码」?

具体来说,ELF的工作流程分为三步:

首先,通过一个预训练好的编码器(论文中使用了T5编码器),将一句话中的每个词转换为包含上下文语义的「语境嵌入」向量。这一步,离散的文字被投射到了一个高维的连续空间。

接着,采用近年来在图像生成中表现优异的「流匹配」(Flow Matching)框架,在这些向量上进行去噪。模型从一团高斯噪声出发,沿着学习到的速度场,一步步将其「推」向目标嵌入向量。

最后,也是最关键的一步,模型才通过一个「反嵌入层」,将去噪后的连续向量映射回词汇表,输出具体的词语序列。

这与之前的连续扩散语言模型有本质区别。ELF在整个去噪过程中,坚决不中途将连续向量变回离散的token。这种设计保证了扩散动力学过程的完整性和流畅性。正因全程处于向量空间,图像扩散领域积累的诸多成熟技术,如「无分类器引导」(CFG),几乎可以无缝迁移过来,这无疑是一个巨大的优势。

一个网络,两种模式

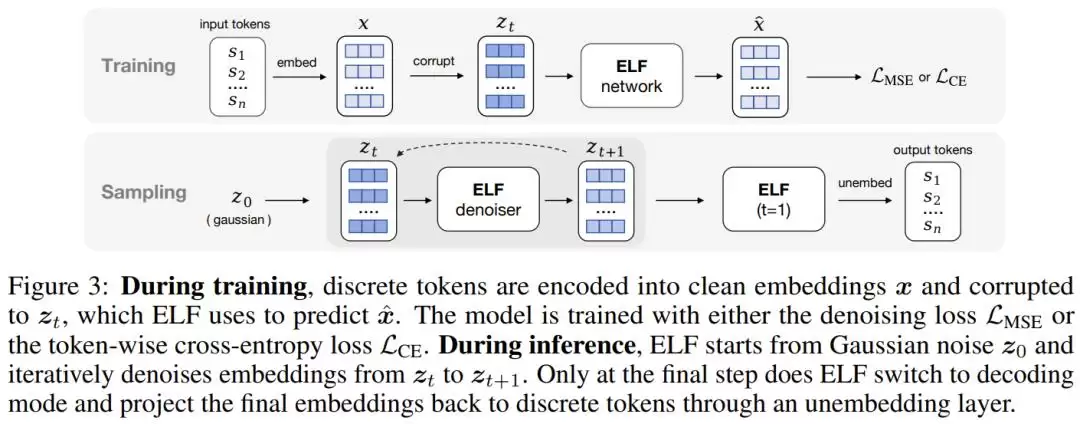

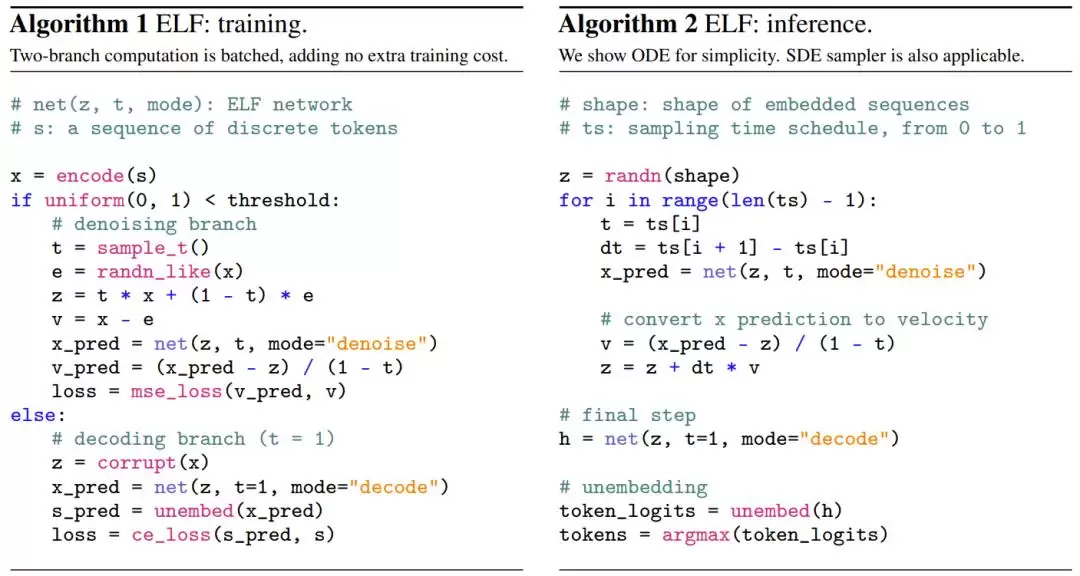

ELF在架构设计上还有一个巧思:它使用同一个神经网络来承担「去噪」和「解码」两项任务,通过一个特殊的「模式标记」(mode token)进行切换。

在训练阶段,这个网络80%的时间用于学习如何去除噪声(最小化均方误差损失),剩下20%的时间则学习如何将最终的干净嵌入向量准确映射回对应的词语(最小化交叉熵损失)。

到了推理生成的时候,在最终步骤之前,网络始终运行在去噪模式下;当去噪完成,只需切换标记,网络便进入解码模式,完成从向量到词语的翻译。这种设计避免了训练一个独立解码器的开销,使得整个流程非常简洁高效。

此外,ELF还引入了「自条件」(Self-Conditioning)机制。简单说,网络在每一步去噪时,可以参考自己上一步的预测结果,而不是每次都从头开始猜测。这不仅提升了生成质量,还为CFG等技术提供了现成的条件信号来源,且几乎没有增加额外的计算成本。

实验结果:用十分之一的训练量,碾压对手

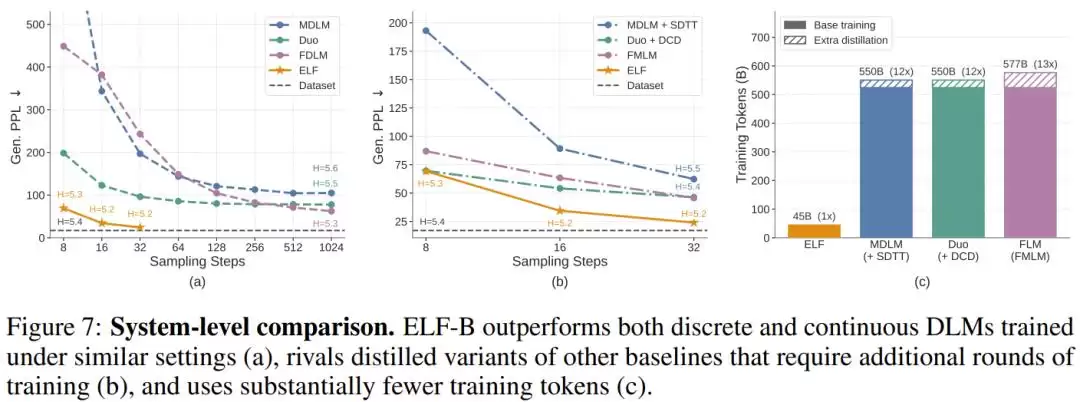

论文中的实验结果颇具说服力。研究团队在扩散语言模型领域通用的标准设定下进行了评估:使用OpenWebText语料库进行训练,并以生成困惑度(值越低越好,代表文本越流畅自然)和词汇熵(值越高越好,代表生成多样性越丰富)作为核心指标。

数据显示,ELF仅用320步采样,就达到了24的困惑度。相比之下,当前主流的离散扩散语言模型(如MDLM、Duo等),即便经过了专门的「蒸馏」训练以加速推理,在同等采样步数下的表现仍不及未经过蒸馏的ELF。

训练数据量的对比更为悬殊。根据论文统计,MDLM、Duo、FLM等主流方法通常使用了约5000亿个Token进行训练,而ELF仅用了大约450亿个Token——差不多只是前者的十分之一。

在更具实际应用价值的条件生成任务上,ELF同样表现突出。在WMT14德英机器翻译基准测试中,ELF取得了26.4的BLEU分数,超越了同等规模的自回归模型(25.2)以及MDLM(18.4)、CDCD(24.9)等竞争对手。在XSum新闻摘要任务上,ELF在ROUGE-1、ROUGE-2、ROUGE-L三项关键指标上也均位列第一。

写在最后

过去两年,扩散语言模型的研究进展几乎都集中在离散空间——研究者们不断优化掩码策略、提升解码效率、扩大训练规模。而连续扩散路线,因其与语言的「离散本质」之间存在理论上的张力,长期处于相对边缘的位置。

ELF的出现,提供了一个全新的视角和有力的证明:连续扩散非但不是语言建模的障碍,反而可能是一个尚未被充分挖掘的优势源泉。在连续空间里,信息流动更平滑,更容易借鉴图像生成领域已高度成熟的技术栈,也更容易实现精细的引导与控制。ELF在不同参数规模(从1亿到6.5亿)下表现出的良好扩展性也暗示,这条技术路径的上限可能还远未触及。

当然,ELF目前的评估仍主要基于中等规模的模型和学术基准。它能否在千亿乃至更大参数规模上,在更广泛、更复杂的实际任务中,与当前最强的自回归大模型形成真正有竞争力的对抗,还需要后续更多的工作来验证。

但无论如何,当下的结果已经清晰地回答了一个悬而未决的问题:连续扩散语言模型这条路,似乎终于找对了方向。

相关攻略

「语言是离散的,但语言模型不一定是。」这句话,恰好点出了当前大语言模型研究的一个有趣分野。 去年,一个名为LLaDA的项目在AI圈内激起了不小的波澜。它基于「掩码扩散」原理,宣称在多项基准测试中,其性能足以与同规模的自回归大模型(即GPT这类逐字生成的模型)相媲美。这一下子,让原本略显小众的扩散语言

全国大学生嵌入式芯片与系统设计竞赛,作为国内高校检验学生创新与实践能力的关键平台,始终聚焦于嵌入式技术与可编程逻辑器件的深度应用。它不仅考核技术功底,更全面评估解决复杂工程问题的综合能力与团队协作精神。今年,飞凌嵌入式作为协办单位,联合瑞芯微在应用赛道设立了专项赛题。我们深入剖析了部分国赛获奖项目的

关于嵌入式消毒柜的日常深度清洁,一个核心事实是:绝大多数情况下,用户完全无需拆机即可完成。按照规范流程自行操作,不仅能有效去除油污和水垢,还能延长设备使用寿命,这已成为行业共识与主流品牌的官方建议。 从森太、方太等知名品牌的官方保养指南,到专业家电服务机构的普遍反馈,都证实了这一点。日常清洁的核心在

为家中的嵌入式消毒柜进行一次全面深度清洁,看似简单实则大有门道。关键在于,仅凭双手难以彻底清洁,必须借助几件得力的专业工具。根据各大主流品牌的官方保养手册及行业维护标准,一次规范的深度清洁流程,离不开十字螺丝刀、软毛刷、无绒干布以及中性清洁剂这几样核心工具。例如集水盒、滑轨、碗架等部件,大多采用卡扣

为嵌入式消毒柜进行深度清洁,第一步并非寻找抹布,而是切断电源。这绝非小题大做,而是关乎使用安全与设备寿命的核心准则。无论是采用高温、紫外线还是臭氧杀菌的主流机型,依据方太、美的等品牌官方指南以及国家《GB 4706 1-2023》家用电器安全标准,任何涉及拆卸、内部清洁或维护的操作前,都必须执行彻底

热门专题

热门推荐

在《燕云十六声》凉州区域达成“天长地酒”成就,需依次前往清玉岸及后续两处指定地点完成饮酒互动。三步全部完成后即可领取奖励。

在《燕云十六声》皇宫区域达成“渡影者”成就,需先传送至崇元殿,并将时间调整至子时。找到NPC叶育延对话后,按指引寻至张扬。依次清理其左右两侧的石狮子,最后返回与张扬对话即可解锁成就。

在《燕云十六声》中,达成“俺们真的懂了”成就需完成升平楼区域的借书事件链。首先于戌时前往升平楼找到NPC陈看全接取任务,随后偷听吴清对话并取得其书籍。最后将时间调至白天,返回升平楼把书交还给陈看全,即可解锁成就并获得奖励。

Bun宣布用六天完成的Rust版本取代原有Zig实现,涉及96万行代码,旨在解决内存泄漏与稳定性问题,尤其是作为ClaudeCode运行时的性能瓶颈。重写主要由AI完成,虽快速通过测试,但引发社区对代码质量及大量unsafe调用的担忧。此举标志Bun转向Rust,也反映AI驱动大规模代码重写的趋势。

风险投资巨头a16z及其联合创始人在本届美国中期选举中已披露联邦捐款超1 15亿美元,成为已知最大捐助方。其捐款额远超索罗斯、马斯克等人,较上一选举周期大幅增加。选举次日,a16z即向加密货币行业相关超级政治行动委员会注资超2300万美元,显示出其政治投入具有长期战略意图。