大模型“降智”真相,找到了

智谱披露GLM-5推理挑战:高压下的乱码与复读,根源竟是两个竞态Bug

智东西

作者 陈骏达

编辑 云鹏

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

大规模AI模型服务,一旦扛起每日数亿次调用的压力,会暴露出哪些意想不到的“暗伤”?今天,智谱AI发布的一篇技术报告《Scaling Pain:超大规模Coding Agent推理实践》,就为我们揭开了冰山一角。报告详细披露了其GLM-5系列模型在服务海量Coding Agent请求时,遭遇的推理基础设施深层挑战与系统性解法。

事情起因于一些棘手的线上异常:在高压环境下,部分用户遇到了模型输出乱码、无意义复读或生成生僻字等问题。表面上看,这很像长上下文场景下常见的模型“降智”现象,但智谱团队确认,他们并未进行任何会降低模型精度的优化。那么,问题究竟出在哪里?答案是高并发与长上下文这两个极端条件叠加,触发了底层的系统级“暗礁”。

经过数周深入排查,团队最终锁定了两个隐蔽的底层竞态问题。针对性修复后,相关异常的发生率从约万分之十几,显著降至万分之三以下。不仅如此,报告还公开了智谱自研的KV Cache分层存储方案LayerSplit,该方案在长上下文场景下,将系统吞吐最高提升了132%。

一、本地无法复现,高压才露头:投机采样指标成“照妖镜”

排查之路,始于今年3月出现的三类异常:乱码、复读、生僻字。第一步自然是尝试在本地复现,但奇怪的是,直接回放线上出错的案例,问题却消失了。这其实是个关键信号——大概率不是模型本身的缺陷,而是与环境强相关。

于是,团队开始模拟线上的高压环境。果不其然,当请求压力达到一定程度,每万次请求中就能稳定复现3到5次异常。这种“与具体内容无关,却与系统压力强相关”的特征,几乎将矛头直指高负载下的推理状态管理机制。

三类异常中,复读还算容易检测,乱码和生僻字则像幽灵,难以用简单的规则或模型高效捕捉。怎么办?团队将目光投向了推理日志中的一个“副产品”:投机采样(Speculative Sampling)指标。

投机采样本是一项提升解码效率的性能优化技术:让一个轻量级草稿模型先跑出一些候选token,再由主力模型校验决定是否采纳。这个过程会记录两个关键指标:接受长度和接受率。

分析发现,当出现乱码或生僻字时,接受长度极低,意味着草稿模型生成的token几乎全被主力模型否决。这强烈暗示,主力模型内部的KV Cache状态已经出现了显著偏差。而在复读案例中,接受率却异常偏高,表明损坏的KV Cache导致注意力机制退化,陷入了重复循环的怪圈。

你看,一个原本用于加速的指标,就这样成了洞察系统内部状态的“照妖镜”。基于此,智谱团队建立起一套在线监控策略,将投机采样从单纯性能工具,拓展为关键的质量监控信号。

二、锁定时序漏洞,两个竞态Bug如何导致输出异常

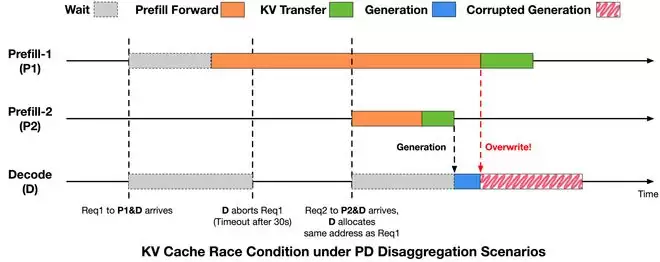

定位到现象背后的线索,接下来就是深挖根因。通过对请求完整生命周期以及推理引擎中预填充与解码分离架构执行时序的细致分析,问题根源浮出水面:问题源于请求生命周期与KV Cache回收、复用时序之间的不一致,从而引发了显存写入冲突。

简单来说,就是一个请求的KV Cache数据还没写完,它占用的显存空间就被回收并分配给了新请求,导致新旧数据“打架”。为了根治这个问题,必须在推理引擎中引入更严格的时序约束,在请求终止与KV Cache写入完成之间建立明确的同步关系。

具体的修复方案是,在解码侧触发中止后,必须明确通知预填充侧,确保只有在远程内存访问未开始或已完成的情况下,才允许回收和复用显存。这样一来,就杜绝了KV写入操作跨越显存复用边界。修复后,此类异常的发生率立刻从万分之十几降到了万分之三以下。

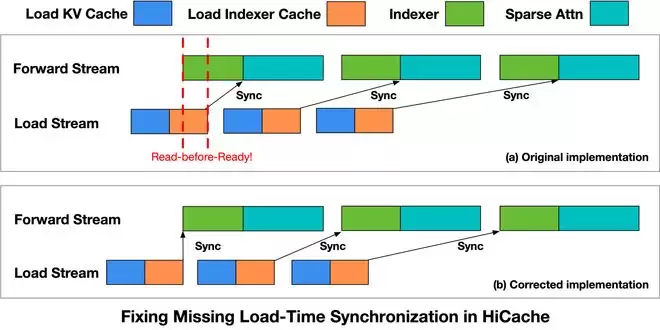

第二个Bug则与Coding Agent场景的特性紧密相关。这类任务输入长、前缀复用率高,因此高效缓存技术至关重要。然而,在KV Cache换入与计算过程重叠执行时,系统缺少一道“安检”,未能保证数据百分百加载完成后再被使用。

这就好比后厨还没备好菜,前厅已经催着上菜了,结果可想而知。修复方法直截了当:在关键的计算算子启动前,插入一个同步点,确保数据就绪后才放行。此修复后,相关问题完全消失,相关代码也已贡献给SGLang开源社区。

三、Prefill吞吐成瓶颈,LayerSplit让吞吐最高涨132%

解决了两个棘手的竞态Bug,团队回过头发现,一个更本质的系统瓶颈依然横亘在面前:在长上下文的Coding Agent服务场景中,预填充阶段主导了整体性能。说得更直白些,系统快不快,主要看“准备数据”这个环节。

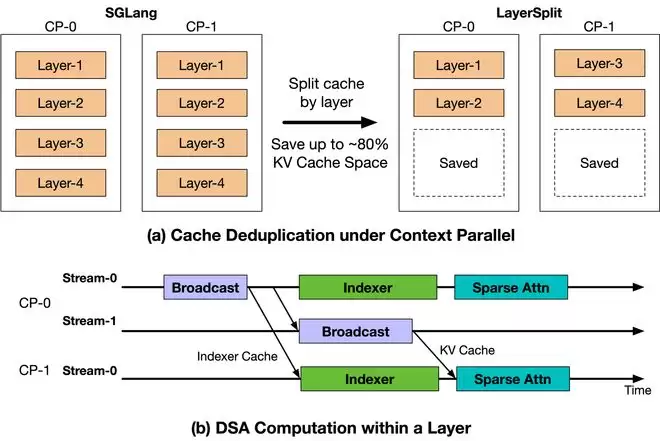

核心挑战很明确:如何提升预填充阶段的吞吐量,同时降低KV Cache对显存的巨大占用?为此,智谱团队设计并实现了名为LayerSplit的KV Cache分层存储方案。

由于Coding Agent负载具有上下文长、缓存命中率高的特点,上下文并行成为预填充节点的主要并行策略。但在开源实现中,每张GPU都需要保存所有层的KV Cache,这种冗余存储使得宝贵的显存容量,反而成了限制计算资源利用率的瓶颈。

LayerSplit的思路很巧妙:打破“每卡存全份”的模式,让每张GPU只保存部分层的KV Cache,从而大幅降低单卡的显存压力。在需要计算时,持有某一层Cache的GPU会将其广播给参与计算的其他GPU。

当然,广播会带来额外的通信开销。为了尽可能减少这部分影响,团队进一步设计了KV Cache广播与索引计算的重叠机制,让两者在时间上相互掩盖。整个流程仅引入了约为KV Cache体量1/8的额外通信,对最终性能的影响微乎其微。

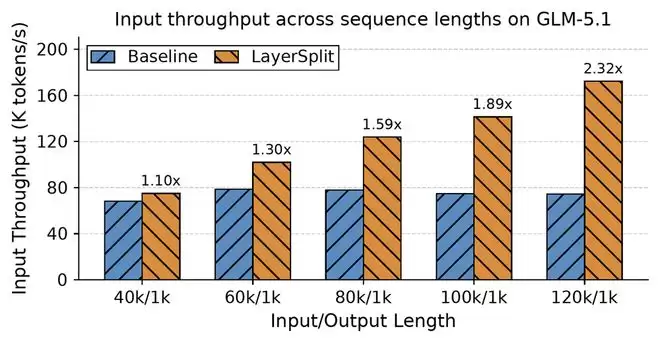

实测数据最有说服力。在缓存命中率90%的条件下,随着请求长度从4万增长到12万,LayerSplit带来的系统吞吐提升幅度在10%到132%之间,而且上下文越长,收益越显著。这从架构层面有效缓解了预填充侧的显存瓶颈。

至此,从两个底层Bug的定位修复,到LayerSplit的架构优化,一套针对高并发、长上下文推理场景的完整基础设施优化方案已然清晰。

结语:输出质量成高并发长上下文场景新痛点

这次技术披露揭示了一个重要趋势:当AI推理服务进入高并发、长上下文的深水区,挑战已不止于传统的吞吐量和延迟指标,输出质量的稳定性同样成为不可忽视的核心痛点。

智谱此次分享的技术细节,从异常现象的监控识别、竞态Bug的深度定位与修复,到架构层面的显存优化,构成了一套相对完整的工程问题排查与性能优化链路。对于所有正在大规模部署AI推理服务的团队而言,这份报告在故障复现思路、监控指标选型、以及保障系统时序一致性等方面,提供了极具参考价值的实践经验。这些经验的公开,无疑为整个社区填补了长上下文推理场景下工程实践的资料空白。

相关攻略

智谱披露GLM-5推理挑战:高压下的乱码与复读,根源竟是两个竞态Bug 智东西作者 陈骏达编辑 云鹏 大规模AI模型服务,一旦扛起每日数亿次调用的压力,会暴露出哪些意想不到的“暗伤”?今天,智谱AI发布的一篇技术报告《Scaling Pain:超大规模Coding Agent推理实践》,就为我们揭开

因果AI破局:零犀科技如何让大模型在金融保险销售中“真赚钱”? 最近,AI应用领域传来一个值得玩味的消息:初创企业零犀科技,靠着自研的因果大模型,竟然在保险、金融这类公认高门槛的销售赛道里,跑通了从技术到业绩的完整闭环。他们不仅宣布将在2025年实现规模化盈利和正向现金流,更关键的是,这为整个行业提

智能驾驶技术正以惊人的速度重塑汽车行业格局 从实验室里的前沿概念,到如今量产车上越来越常见的功能,智能驾驶这条赛道,已经彻底从图纸跑进了现实,成了各家车企寸土必争的核心战场。就在普通消费者还在纠结“辅助驾驶到底靠不靠谱”的时候,行业内部早已暗流涌动,掀起了一场静悄悄的技术革命——端到端大模型,正以一

奥迪E7X全球首秀:当“智慧性能旗舰”遇上会哄娃的AI助手 4月24日的北京车展,奥迪品牌带来了它的第二款力作——奥迪E7X,并完成了全球首秀。这款被定位为“智慧性能旗舰SUV”的新车,最引人瞩目的亮点,莫过于其搭载了豆包大模型的AI车载伴侣“奥迪助手2 0”。这不仅仅是技术的堆砌,它意味着更强大的

One-Eval是什么 想快速、准确地评估一个大模型的能力,但又被繁琐的数据准备、脚本编写和结果分析搞得头疼?或许,你可以了解一下One-Eval。这个由北京大学OpenDCAI团队开源的项目,本质上是一个自动化、Agent驱动的评测框架。它的核心卖点,用一个词概括就是“NL2Eval”——你只需用

热门专题

热门推荐

2026年4月2日,一场始于订单的“双向奔赴” 汽车圈最近上演了一出颇有温度的品牌互动,起因是一张来自社交平台的购车订单。一位原奥迪车主公开晒出了小米SU7的订单截图,并向相关负责人致以问候。这原本只是一条个人动态,却没承想,引发了一连串超出预期的友好回应。 消息传出后,上汽奥迪的反应堪称迅速且巧妙

特斯拉2026年Q1财报解读:业绩稳健增长,自动驾驶与机器人战略加速落地 2026年第一季度,特斯拉再次向市场展示了其强劲的发展动能。在全球电动汽车市场,特斯拉产量成功突破40 8万辆,实现同比12 7%的稳健增长;同期交付量达到35 8万辆,同比增长6 5%。与此同时,特斯拉储能业务表现突出,总装

四月一日,沙盒游戏我的世界推出一次特别更新,引发广泛关注 话说回来,四月的第一天,经典沙盒游戏《我的世界》,就整了个“大活儿”。一项听起来颇有碘伏性的设计调整,在社区内炸开了锅:游戏直接移除了沿用已久的仓库系统,改为所有物品都能随手放在地面,想用的时候捡起来就行。 仓库功能向来是此类建造型游戏的核心

巨鲸再出手:千万美元级ETH悄然离场 市场总是静水深流。就在今天,链上数据捕捉到一笔值得玩味的动向。根据链上分析师Onchain Lens的监测,大约三小时前,一个地址尾号为“24d4”的巨鲸,从知名交易所Kraken一口气提取了4,472枚ETH。按当前市价估算,这笔资产价值接近一千万美元。 这可

京东京造再推黄金配件新品:磁吸支架以亲民价格亮相 关注京东京造的朋友一定还记得此前推出的黄金手机壳,因其独特设计与高纯度金材质引发了不少讨论。如今品牌再度升级,带来了一款更贴近日常使用的“轻量化”黄金配件——黄金气囊手机磁吸支架,进一步降低了黄金数码配件的入手门槛。 产品解析:含金量与设计亮点 这款