Python基于WebSocket实现直播弹幕数据采集

前言

在直播数据分析、舆情研究或用户互动行为观察中,弹幕数据无疑是一座实时文本数据的富矿。与评论区留言相比,弹幕有两个鲜明的特质:

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

其一,是极强的实时性,几乎与直播画面同步涌现;

其二,是极高的互动密度,堪称观众情绪的“实时晴雨表”和话题热度的“风向标”。因此,若能稳定、高效地采集直播弹幕,便为后续的情感分析、关键词统计乃至热点时刻识别等深度研究铺平了道路。

基于这一需求,一套基于 WebSocket 的实时弹幕采集程序应运而生。其核心思路清晰而高效:通过 WebSocket 服务接收原始弹幕消息,经过解析与格式化处理后,利用队列进行临时缓存,最终持久化存储到日志文件和结构化的 JSON 文件中。这套流程不仅实现了对弹幕流的实时监控,也为后续的数据分析与建模提供了极大便利。

接下来,我们将结合具体代码,深入剖析这套采集程序的实现思路与关键技术细节。

一、环境准备与依赖安装

工欲善其事,必先利其器。在动手编码之前,需要先搭建好开发环境。核心依赖是 WebSocket 库。

pip install websockets

除此之外,代码中还灵活运用了以下几个 Python 内置库,各司其职:

asyncio(异步编程的基石)json(数据解析与序列化)logging(构建程序运行日志)os(处理文件与目录路径)datetime(精确的时间处理)

导入这些模块的代码如下:

import asyncio import json import websockets from collections import deque import logging import os from datetime import datetime

这里需要特别关注asyncio 与 websockets 的组合。这种搭配天生适合处理像实时弹幕这样的高频数据流,能够实现高效的异步消息处理,避免阻塞,保证程序的流畅性。

二、日志系统与数据缓存设计

在实际采集场景中,如果仅仅将弹幕打印在终端,一旦程序中断或滚动过快,重要信息极易丢失。为此,程序中设计了日志系统与数据缓存队列的双重保障机制。

首先是日志系统的配置,它为每一条运行记录打上时间戳:

logging.basicConfig(

level=logging.INFO,

format='%(asctime)s - %(levelname)s - %(message)s',

datefmt='%H:%M:%S'

)

接下来,创建一个专用的弹幕缓存队列:

danmu_queue = deque(maxlen=100)

选择 deque(双端队列)主要基于其三大优势:插入速度快、支持固定长度以自动淘汰旧数据、非常适合实时数据流的缓存场景。

三、弹幕数据存储结构设计

为了方便不同场景下的使用,弹幕数据被设计为两种存储格式,兼顾了可读性与可分析性:

1️⃣ 文本日志:便于人类实时阅读和快速检索。

2️⃣ JSON数据:便于程序直接读取和进行结构化分析。

相关的路径配置代码如下:

DATA_DIR = 'danmu_data' LOG_FILE = os.path.join(DATA_DIR, 'danmu.log') JSON_FILE = os.path.join(DATA_DIR, 'danmu.json') os.makedirs(DATA_DIR, exist_ok=True)

程序运行后,会自动在项目目录下创建一个名为 danmu_data 的文件夹,所有采集到的数据都将井然有序地存储于此。

四、弹幕消息解析函数

整个程序的核心逻辑之一,便是 process_message() 函数。它扮演着“翻译官”的角色,负责解析 WebSocket 接收到的原始消息。

async def process_message(message_data):

第一步,是将接收到的字符串消息解析为 JSON 对象:

data = json.loads(message_data)

紧接着,需要进行一次关键的消息类型过滤:

if data.get('type') != 'danmu':

return None

这个设计至关重要。因为直播平台的 WebSocket 连接可能会推送多种类型的消息(如礼物、进场通知等),而我们只需要精准捕获弹幕类型的数据。

过滤之后,便是从消息体中提取关键字段:

content = message.get('content', '')

sender = message.get('nickname', 'unknown')

time = message.get('time', '')

user_token = message.get('userToken', '')

live_id = message.get('liveId', '')

随后,将这些信息组合成一条格式清晰的弹幕文本:

formatted_message = f"[{time}] {sender} [{user_token}]\n{content}"

例如,一条弹幕可能被格式化为:

[20:35:12] 用户12345 [token] 这主播太搞笑了

接下来,将这条弹幕的所有信息封装到一个字典中,便于后续处理:

danmu = {

'user': sender,

'content': content,

'time': time,

'live_id': live_id,

'user_token': user_token,

'formatted': formatted_message

}

最后,将这条结构化数据放入缓存队列,并调用函数将其保存到文件。至此,一条弹幕的生命周期——从接收到解析再到缓存——便完成了。

五、WebSocket服务器实现

要接收弹幕数据,首先需要搭建一个 WebSocket 服务端来监听连接。这是数据流入的“总闸口”。

核心是一个异步处理函数:

async def websocket_handler(websocket, path):

当有新的客户端(即数据源)成功连接时,记录日志:

client_id = id(websocket)

logging.info(f"新的客户端连接 (ID: {client_id})")

然后,服务端会进入一个持续监听的状态,异步接收每一条到来的消息:

async for message in websocket:

success = await process_message(message)

如果某条消息处理过程中间出现意外,系统会给出警告日志,确保问题可追溯:

logging.warning(f"消息处理失败: {message}")

当客户端断开连接时,同样需要记录,以监控连接状态:

except websockets.exceptions.ConnectionClosed:

logging.info(f"客户端断开连接")

这一整套逻辑,就构成了一个健壮的实时弹幕监听机制。

六、服务器启动逻辑

万事俱备,只欠东风。服务器的启动由一个主函数控制:

async def main():

在函数内部,启动 WebSocket 服务:

server = await websockets.serve(

websocket_handler,

"127.0.0.1",

8765,

ping_interval=None

)

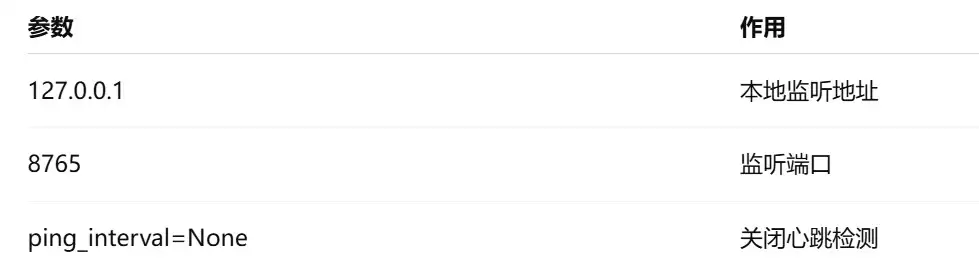

这里对参数稍作解释:服务绑定在本机(127.0.0.1)的8765端口。一个值得注意的细节是,将 ping_interval 设置为 None,即关闭了心跳检测。这是因为在某些情况下,过于频繁的 ping/pong 帧交互可能导致部分客户端连接异常,关闭后反而提升了连接稳定性。

七、弹幕数据保存机制

采集到的数据,最终需要落地保存。为此设计了一个专用的保存函数:

def sa ve_danmu_to_file(danmu):

保存过程分为两步走:

首先,将格式化的弹幕文本追加写入日志文件,方便即时查看:

with open(LOG_FILE, 'a', encoding='utf-8') as f:

f.write(danmu['formatted'] + '\n\n')

然后,为了后续的自动化分析,再将结构化的弹幕数据以 JSON 格式保存。在保存前,还会为数据打上一个“保存时间”的戳记:

danmu_with_timestamp['sa ve_time'] = datetime.now().isoformat() json.dump(danmu_with_timestamp, f, ensure_ascii=False)

最终,每条弹幕在 JSON 文件中的形态大致如下:

{

"user":"张三",

"content":"主播太厉害了",

"time":"20:35:12",

"live_id":"123456",

"user_token":"abcde",

"sa ve_time":"2026-03-09T20:35:12"

}

这种“日志+JSON”的双轨存储策略,既满足了人工查阅的便利性,也兼顾了机器处理的效率,可谓一举两得。

八、程序启动与关闭

一个完整的程序,需要有清晰的启动与收尾。主程序入口如下:

if __name__ == "__main__":

程序启动时,会在日志中打印醒目的启动信息,记录下精确的启动时刻:

================================================== 程序启动于: 2026-03-09 20:30:01 ==================================================

同样,在程序正常或异常结束时,也会记录退出时间。这个设计的好处显而易见:可以准确计算每次采集任务的时长,并且在出现异常退出时,能快速定位问题发生的时间点。

九、弹幕采集程序的设计心得

回顾整个程序的设计与实现过程,有几个关键点的选择值得深入探讨:

第一,WebSocket 协议是实时数据采集的“不二之选”。相较于需要不断轮询的 HTTP 方式,WebSocket 建立的持久化连接能够实现真正的低延迟、全双工通信,让弹幕消息几乎无延迟地抵达采集端。

第二,异步编程是驾驭高频数据流的“利器”。借助 asyncio 库,程序可以轻松处理海量并发连接与消息,避免因 I/O 等待而造成的阻塞,极大提升了吞吐量和响应速度。

第三,数据存储设计需“瞻前顾后”。同时保存为人类可读的日志和机器友好的 JSON,这种设计在满足实时监控需求的同时,也为后续的批量数据分析、情感计算或可视化提供了直接可用的原料。

第四,缓存队列是系统稳定的“缓冲阀”。使用固定长度的 deque 作为缓存队列,既能平滑瞬时的高流量冲击,防止内存溢出,又能保留最近的历史数据供临时查阅,提升了系统的整体鲁棒性。

十、总结

通过上述模块的协同工作,我们成功构建了一套功能完备的直播弹幕实时采集系统。它主要具备以下六个特点:

(1)基于 WebSocket 的实时采集

(2)利用 asyncio 实现的异步处理

(3)使用 deque 的弹幕队列缓存

(4)自动化的运行日志记录

(5)JSON 格式的结构化数据保存

(6)完整的程序运行状态追踪

这套系统的应用场景远不止于弹幕采集本身。其架构可以轻松扩展到实时舆情监测、用户互动行为研究、直播热点识别与分析等多个领域。

展望未来,如果需要进一步增强其能力,可以考虑以下几个方向:接入 MySQL 或 MongoDB 等数据库进行持久化存储;集成情感分析模型,对弹幕进行实时情绪判断;结合 Web 框架实现数据可视化大屏;或者增加关键词实时统计与趋势分析功能。

从整体架构审视,这套弹幕采集程序代码虽不冗长,但设计上着重强调了稳定性与可扩展性。以 WebSocket 打通实时数据通道,用 asyncio 保障处理效率,再辅以 deque 队列缓存、logging 日志追踪和 JSON 结构化存储,共同构成了一个从“接收 → 解析 → 缓存 → 落盘”的完整数据闭环。这样的设计,不仅为当下的弹幕文本分析、情感分析等任务提供了坚实的数据基础,更为未来接入更复杂的数据处理管道、可视化界面或流式计算框架预留了清晰的接口和可能性。

以上便是利用 Python 和 WebSocket 技术实现直播弹幕数据采集的完整思路与方案详解。希望这份拆解能为您在实时数据采集领域的探索提供有价值的参考。

您可能感兴趣的文章:

- Python基于FastAPI和WebSocket实现实时聊天应用

- Python Websockets库的使用指南

- Python中实现WebSocket的示例详解

- Python基于WebSocket实现简易屏幕共享工具

- 使用Python实现WebSocket服务器与客户端通信功能

相关攻略

使用Python在图片上画线的两种主流方法 图像处理是编程中的一项高频操作。无论是为图片添加水印、标注目标检测框,还是进行简单的编辑,“画线”这个动作都堪称基础中的基础,几乎无处不在。 今天,我们就来深入探讨一下,如何用Python在图片上精准地画出一条线。市面上主要有两个库能胜任这项工作:功能强大

使用Python合并与拆分Excel单元格的实用方法 处理Excel表格时,合并单元格是个绕不开的操作。无论是为了制作清晰美观的表头,还是为了突出显示某些关键信息,这个功能都相当实用。不过,当需要批量处理或者将流程自动化时,手动在Excel里点点划划就有点力不从心了。今天,我们就来聊聊如何用Pyth

Python爬虫遇到403 Forbidden怎么办?通过伪造User-Agent与Cookie绕过封禁 为什么加了User-Agent还是返回403 Forbidden 问题往往出在这里:你以为只换件“外套”就能蒙混过关,但服务器早已升级了安检系统。如今,多数网站早已不再单纯校验User-Agen

前言 在直播数据分析、舆情研究或用户互动行为观察中,弹幕数据无疑是一座实时文本数据的富矿。与评论区留言相比,弹幕有两个鲜明的特质: 其一,是极强的实时性,几乎与直播画面同步涌现; 其二,是极高的互动密度,堪称观众情绪的“实时晴雨表”和话题热度的“风向标”。因此,若能稳定、高效地采集直播弹幕,便为后续

如何解决Python在大数据量排序时的内存压力:使用外部排序算法或heapq nsmallest 当你试图用 sorted() 或 list sort() 去处理千万级甚至更多的数据时,迎面而来的很可能不是排序结果,而是令人沮丧的 MemoryError,或者干脆让系统陷入卡顿。这通常不是代码逻辑写

热门专题

热门推荐

Origin Code发布VORTEX系列专用分体式水冷冷头模块 2026年4月7日,知名内存模组品牌Origin Code正式发布了专为VORTEX系列内存打造的分体式水冷冷头模块,官方售价为899元。这款产品的推出,为追求极致散热性能、低温和系统视觉一体化的高端DIY玩家及超频爱好者,提供了一个

荣耀WIN游戏本定档4月23日:性能释放突破250瓦,电竞体验全面升级 2026年4月7日,荣耀正式揭晓了全新WIN游戏本的发布日期:4月23日。这款备受瞩目的产品其实早已不是秘密,早在去年12月,荣耀PC产品负责人就已经在公开渠道透露了新品的进展,并确认了一个关键身份——它将成为《三角洲行动》职业

内存供应趋紧,苹果部分Mac交付周期显著延长 进入2026年第二季度,全球半导体产能的重新分配仍在持续。一个不容忽视的趋势是,人工智能应用的爆发式增长,正持续推高对高性能内存芯片的需求,导致DRAM市场供应整体趋紧。自去年下半年开始的这轮价格上涨,让终端设备制造商普遍感受到了成本压力,即便是供应链管

荣威全新i6上市:7 49万起售,搭载8155芯片与国潮 2026年4月30日,荣威品牌旗下的全新一代紧凑型轿车i6正式推向市场。新车一口气带来了三款配置,分别命名为长久版、豪久版与臻久版,官方给出的指导价区间定在7 49万元到8 49万元。不过,眼下正值上市初期,官方还推出了限时抢订政策,实际支付

暗黑破坏神4:憎恨之王上线后,术士职业迅速跻身当前版本最具统治力的职业行列 其核心能力涵盖恶魔召唤、地狱火攻击与神秘印记体系,其中一种以“召唤即献祭”为运转逻辑的召唤流派正展现出显著优势。 这次资料片带来的技能系统重构,可以说是一次彻底的革新:所有被动技能被移除,每个主动技能都扩展成了拥有多节点分支