如何在使用 Claude Code 时避免出现“已达到限制”的错误

工作高峰期遭遇 Claude Code 使用限额?这份实用指南帮你高效应对

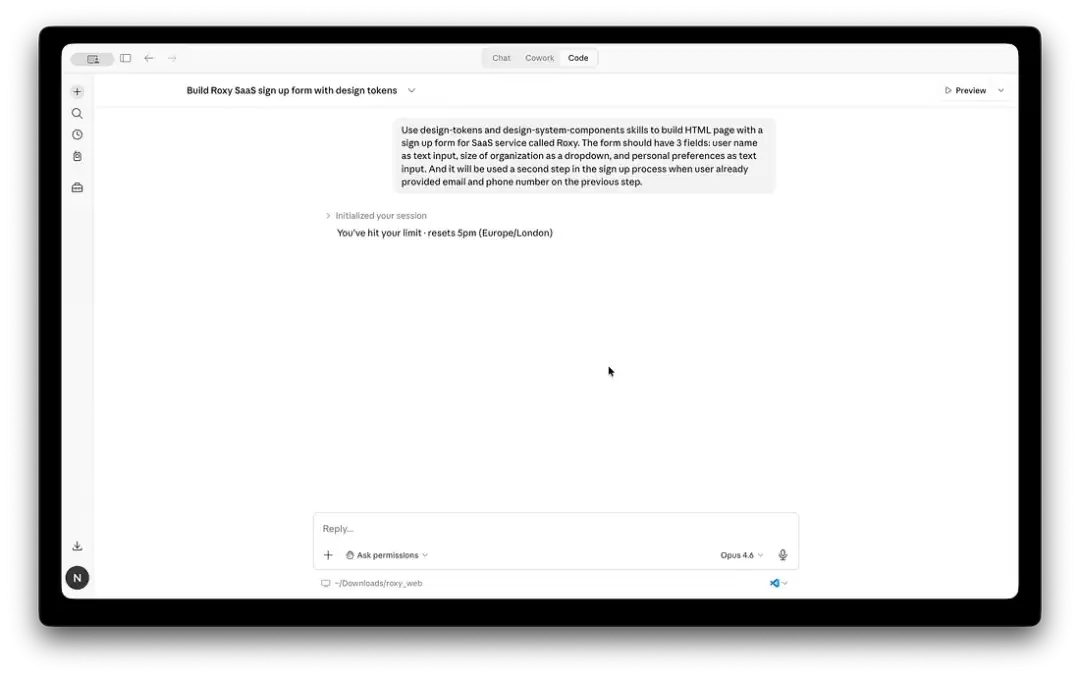

项目冲刺阶段,最令人沮丧的莫过于关键时刻被意外打断。当你全神贯注于代码编写,正准备借助 Claude Code 高效推进时,屏幕上突然弹出的 “You’ve hit your limit” 提示,不仅瞬间中断了你的工作流,更会带来强烈的挫败感。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

这种因 AI 工具使用额度耗尽而导致的工作中断,是许多开发者和技术工作者共同的痛点。那么,如何有效管理 Claude Code 的使用配额,最大限度地避免“撞墙”情况发生?本文将为你系统梳理六项经过实践检验的优化策略,助你提升工作效率,确保工作流程顺畅无阻。

深入理解:Claude Code 的两类核心限制机制

在与 Claude 进行交互时,你主要会遇到两种性质不同的限制:使用限额(Usage Limits)和长度限额(Context Limits)。清晰区分这两者,是进行高效配额管理的基础。

使用限额详解

这类限制管控的是你在特定时间周期内与 Claude 进行交互的频次。你可以将其理解为一份“对话预算”,它决定了你在一定时间内(如每日或每周)可以发送多少条消息,以及能在 Claude Code 中持续工作多长时间。一旦预算耗尽,系统便会弹出类似 “You hit your limit” 的提示,并告知额度下次重置的具体时间。

目前,Claude Code 主要设有两种使用限制:基于5小时滚动窗口的日常限制,以及以7天为周期的周度限制。例如,若提示显示“resets 5pm”,这通常意味着你触发了日限额,需要等待一个新的5小时周期开始才能继续使用。

图片

图片

长度限额详解

另一类限制则与 Claude 模型的上下文窗口(Context Window)大小直接相关,即单次对话中它能同时处理和理解的信息总量上限。你可以将上下文窗口想象成 Claude 的“短期工作记忆区”。这个区域容量越大,Claude 就越能理解复杂的任务背景和长链条逻辑,在连续的多轮对话中保持状态的一致性。

长度限额主要影响 AI 输出的质量和连贯性。它与使用限额的一个关键区别在于:即便对话长度接近上下文边界,系统通常也不会立刻强制终止会话,但可能会影响回复的完整性、相关性和准确性。因此,优化上下文的使用不仅是为了规避限制,更是为了保障最终产出结果的高质量与高相关性。

触发使用限额后,有哪些应对方案?

当“撞墙”情况真实发生时,你的选择其实非常明确:要么耐心等待,要么选择升级。

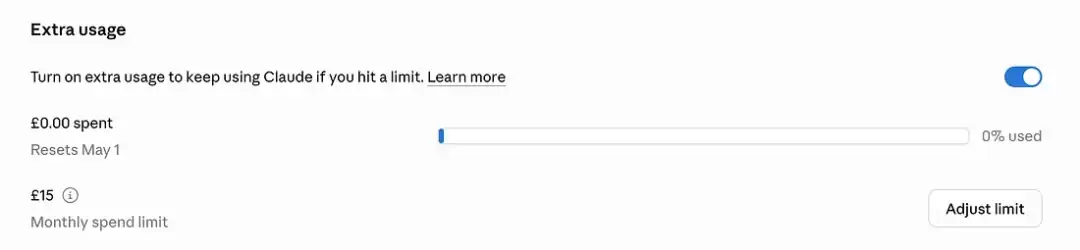

你可以选择等待当前订阅套餐的额度在下一个周期自动刷新——Claude Code 一般会明确显示额度恢复的时间;或者,你也可以考虑额外购买使用配额或升级到更高阶的付费计划,但这属于独立的付费选项。

图片

图片

额外的使用额度,是可以单独购买的。

6 个核心技巧,助你智能管理 Claude Code 使用额度

1. 实时监控你的使用情况

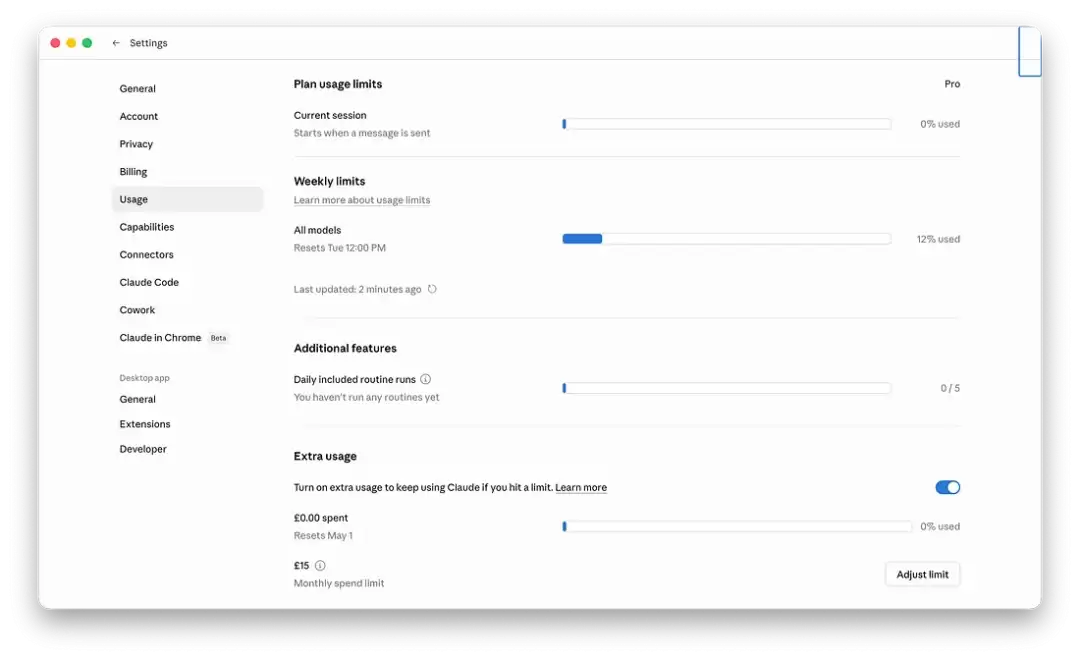

知己知彼,方能百战不殆。Claude Code 提供了多种便捷的额度监控方式。如果你使用的是桌面版应用,可以进入 Settings(设置) → Usage(使用情况)页面,查看当前套餐的详细用量信息。

图片

图片

Claude Code 桌面版中的套餐使用信息。

虽然这个入口提供的数据非常准确,但从操作效率来看并非最优解,因为它需要你专门跳转到设置页面查看,不适合进行高频次的实时监控。相比之下,以下几种方式更为直观和便捷。

Claude Code 本身设有智能的内置提醒机制:当你的额度消耗达到90%左右时,在 Chat 模式的输入框上方会自动出现一条醒目的警告信息。

图片

图片

输入框上方出现的“Usage limit reached”提示。

客观地说,90%的预警有时比额度完全耗尽更让人焦虑——因为工作尚未被强制中断,你总会担心手头的重要任务能否在额度见底前顺利完成。

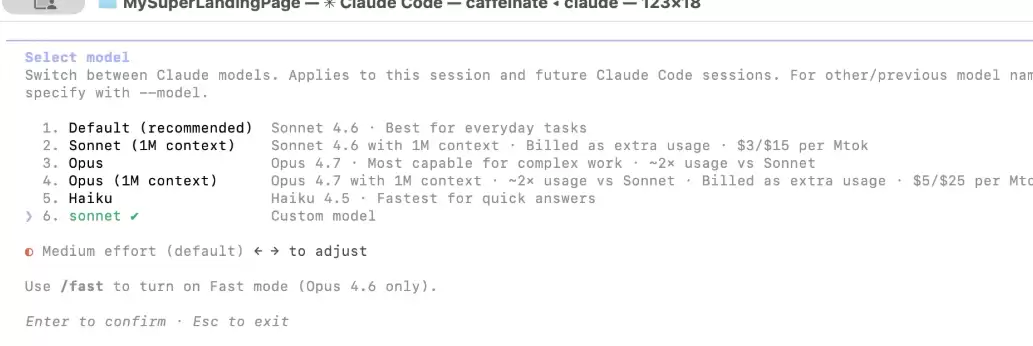

随着 Claude Opus 4.7 版本的发布,Anthropic 也对 Claude Code 的桌面端界面进行了重构,加入了更直观的实时监控组件。现在,你只需点击输入框右下角的特定图标,就能一目了然地看到当前上下文窗口的使用情况以及套餐用量详情。

图片

图片

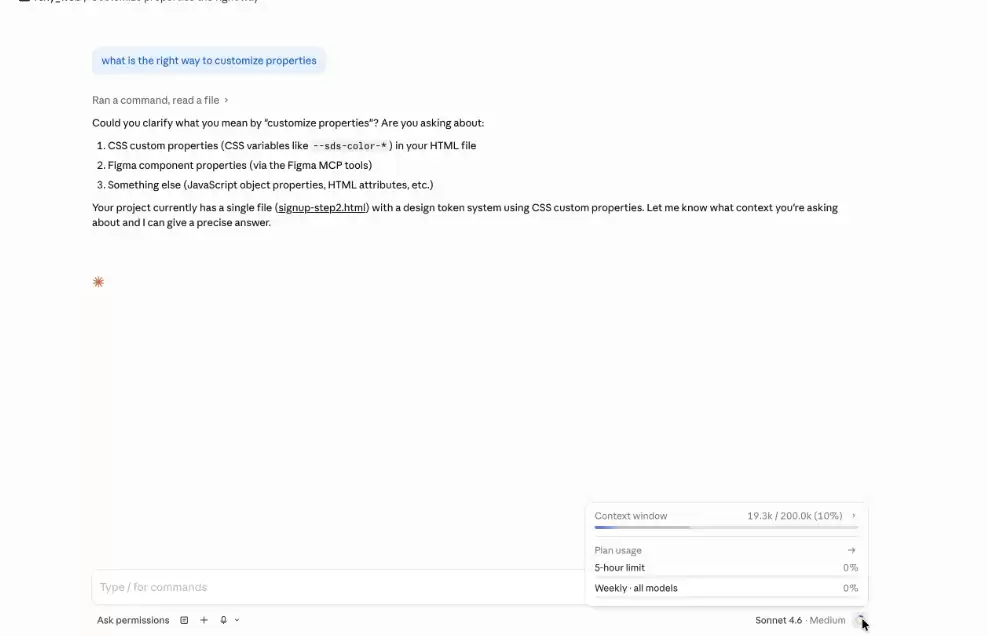

对于偏好使用 Claude Code CLI(命令行界面)的高级用户,还可以通过自定义状态栏来实现无缝监控。在命令行中输入以下指令:

/statusline show model name, usage limits and length limits with progress bars

图片

图片

在 Claude Code CLI 中提交/statusline指令来自定义状态栏。

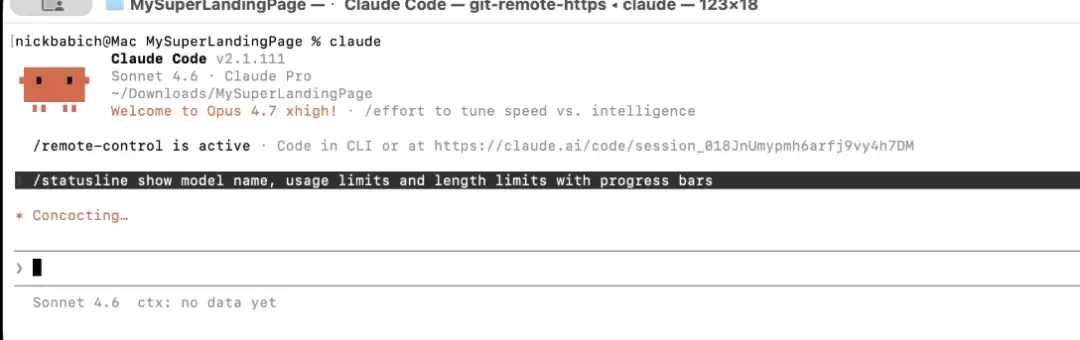

设置完成后,你的状态栏将清晰展示以下关键信息:

ctx:当前上下文使用情况(即长度限额);daily / weekly:每日与每周的使用额度剩余情况,并以独立的进度条进行直观可视化呈现。

图片

图片

Claude Code CLI 中的自定义状态栏效果。

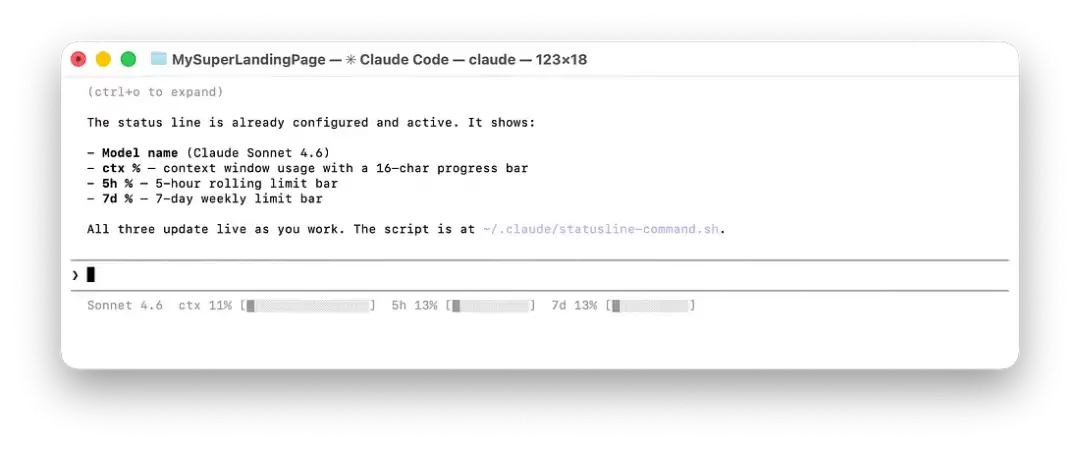

2. 根据任务类型,智能选择 AI 模型

Claude Code 提供了多个能力层级的模型选项。许多用户会下意识地首选功能最强大的 Opus 模型,因为它拥有卓越的深度推理能力。但需要注意的是,能力越强的模型,通常也意味着:单次请求消耗的计算资源更多,生成的输出内容往往更长、更详尽。

结果就是,即使交互的消息条数不多,也更容易快速触及你的使用额度上限。

更明智的策略是根据具体的任务类型来匹配最合适的模型,而非默认选择“最强”的。一个被广泛验证的最佳实践是:

Haiku 模型:响应速度极快,资源负担轻,非常节省使用额度。适合简单的信息查询、语法检查、快速确认等无需深度分析的轻量级任务。

Sonnet 模型:能力均衡,token 利用效率高,性价比出色。适合常规的代码编写、内容修改、文档生成及需要进行多轮迭代的执行类工作。

Opus 模型:能力顶尖,但“单价”也最高。更适合复杂的项目规划、架构设计、棘手的逻辑问题排查,或需要深度思考和评审的战略性决策。

在对话中切换模型非常简便,可以直接使用以下命令:

/model

图片

图片

Claude Code CLI 会话中的模型选择界面。

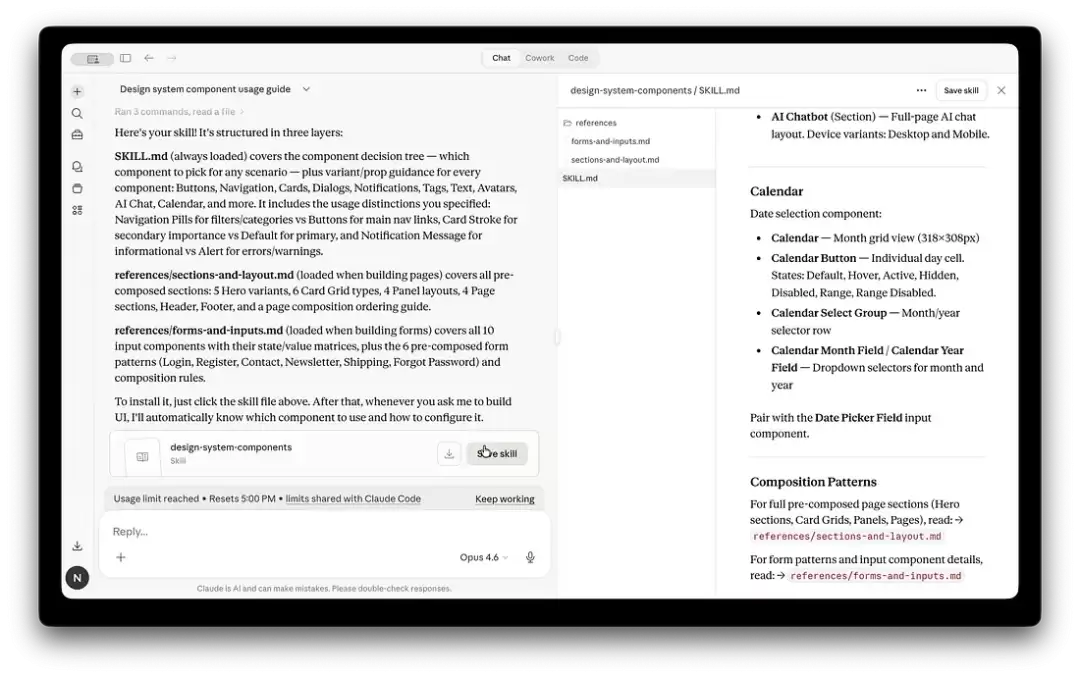

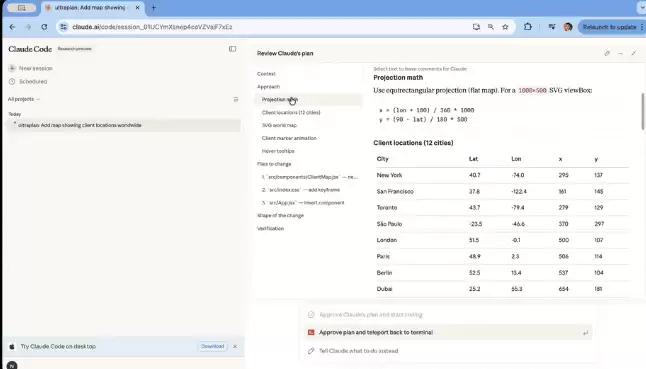

3. 先规划,后执行:利用 Ultraplan 模式

一个常见的效率陷阱是,一上来就直接要求 Claude 开始修改或生成代码。这很容易导致大量不必要的来回对话:你提出一个小的修改点,它生成一段代码;你再补充需求,它再次延伸。交互轮次一多,额度消耗速度自然飞快。

因此,比起立刻要求产出最终结果,更高效的做法是先让 Claude 为你制定详细的执行计划。整体迭代次数越少,消息消耗通常就越低。

Claude Code 近期引入的 Ultraplan 模式在这方面表现尤为出色。它能围绕你指定的复杂任务,生成一份极其详尽、步骤清晰、可操作性强的执行方案:

/ultraplan [explain the task you want Claude Code to plan]

The Best Way To Plan Work With Claude Code /ultraplan for making the most of Claude Code uxplanet.org

图片

图片

Claude Code 生成的详细执行计划。

4. 拆分大型任务,采用模块化工作流

大型复杂任务最容易将你拖入两个困境:上下文长度不断膨胀,交互轮次持续增加。这两者叠加,基本等同于在快速逼近你的额度极限。

更优的解决方案是将庞杂的工作拆解为多个彼此独立、目标明确的模块或子任务,然后逐个击破。每完成一个阶段,就可以使用以下命令清空当前对话的上下文历史:

/clear

Start a new session with empty context

这样做的好处显而易见:保持上下文清洁,Claude 无需背负大量冗余的历史信息前进,其响应会更精准、更轻量,资源消耗也更可控。

与其在单次超长会话中死磕到底,不如建立模块化、阶段化的工作流。这对同时管理使用限额和长度限额都至关重要——分块处理,往往比一次性猛冲更节省额度、更稳定可靠,也更容易获得清晰且高质量的结果。

5. 优化提示词:明确要求“精简输出”

Claude 模型倾向于提供详尽、全面的解释,尤其在用户未明确要求时,它很容易生成大段的论述性文字。

但在很多开发场景下,你只需要它执行具体指令、输出核心代码或给出最终结论。这时,务必在提示词中明确你的要求,避免让 AI 猜测你的意图。例如,可以加入以下指令:

请提供简洁的输出(concise output)

仅输出代码,无需解释(code only)

输出内容越精简,每轮对话消耗的 token 数量通常就越少。因此,对于同一项任务,你的指令越明确、越具体,总体使用成本往往就越低,效率也越高。

6. 管理 MCP 连接,减少不必要的上下文负担

MCP(Model Context Protocol)服务器——尤其是像 Figma、GitHub 这类深度集成——会在你不知不觉中消耗大量的使用额度。

原因不难理解:每个活跃的 MCP 连接都会持续占用宝贵的上下文窗口空间。而且,一旦同时连接多个 MCP 服务,它们很可能成为你整个项目中最大的 token 消耗源。可以说,让所有 MCP 长期保持在线状态,是快速耗尽 Claude token 配额的最常见原因之一。

因为每当你发送一条消息时,所有已连接的 MCP 服务器都会将其工具描述信息带入对话上下文——即使当前任务完全用不到它们。

因此,第一步,也是最重要的一步,就是:主动断开当前未在使用的 MCP 连接。

图片

图片

断开暂时不用的 MCP。

第二步,在技术可行的情况下,优先考虑直接调用相关服务的原生 API,而非通过 MCP 进行层层中转。这不仅通常更安全、更高效,而且在 token 消耗上也更具可预测性和可控性。最后,尽量避免在对话中反复传输体积庞大的设计文件或原始数据——这类隐形的上下文成本累积起来,往往超乎你的想象。

顺带一提,业界对于 MCP 在正式生产流程中的价值评估,看法并不完全一致。它在灵感探索、概念发散和快速原型阶段确实灵活好用;然而,当工作进入需要稳定交付、可落地的生产级方案实施时,过度依赖 MCP 有时反而可能成为工作流的阻力,而非助力。

相关攻略

工作高峰期遭遇 Claude Code 使用限额?这份实用指南帮你高效应对 项目冲刺阶段,最令人沮丧的莫过于关键时刻被意外打断。当你全神贯注于代码编写,正准备借助 Claude Code 高效推进时,屏幕上突然弹出的 “You’ve hit your limit” 提示,不仅瞬间中断了你的工作流,更

一、深入解析Claude 4附件处理的计费机制 许多用户误以为Claude 4的文件上传费用仅由文件大小决定,实则核心计费逻辑取决于模型实际“读取”的内容量。尤其是PDF与图像类附件,系统默认会启用视觉解析通道进行处理。这意味着,您上传的每一页PDF文档,都会被视作一张高分辨率图片进行识别分析。 那

如何解决 Claude 回答突然中断的问题? 在使用Claude时,是否经常遇到AI助手话说到一半就停止响应的情况?这种Claude回答中断的问题确实令人困扰,但通常源于几个可排查的技术原因。无论是网络波动、会话超时、内容过滤机制,还是客户端兼容性问题,都可能导致对话流被意外切断。本文将提供一套完整

Claude 4事实核查实战指南:五步构建可信输出屏障 当您发现Claude 4在处理新闻报道、数据分析或用户提交内容时,输出了与已知事实不符的陈述,这通常意味着模型的虚假信息识别机制未能有效触发。无需担忧,这一问题可以通过系统化的事实核查与可信度评估方法得到显著改善。本文将详细拆解提升Claude

为什么Claude的长文本窗口对科研工作者至关重要? 如果你正在处理博士论文、技术白皮书或数十页的实验报告,却总感觉关键信息在指缝间溜走,上下文读着读着就断了线,逻辑链条莫名脱节——那么,问题很可能就出在工具的“视野”上。传统模型有限的上下文窗口,就像透过一个小孔看一幅巨画,只能看到局部,难以把握全

热门专题

热门推荐

工作高峰期遭遇 Claude Code 使用限额?这份实用指南帮你高效应对 项目冲刺阶段,最令人沮丧的莫过于关键时刻被意外打断。当你全神贯注于代码编写,正准备借助 Claude Code 高效推进时,屏幕上突然弹出的 “You’ve hit your limit” 提示,不仅瞬间中断了你的工作流,更

Detective Naani Automation Tool是什么 提到AI自动化工具,市场上选择不少,但专门为处理海量数据痛点而设计的,Detective Naani Automation Tool算是一个亮眼的选项。它由一家科技公司推出,核心目标很明确:帮助数据分析师、研究员和企业决策者,从繁

2025年山寨币季节:五大临界信号已同步显现 市场共识是,2025年的山寨币季节尚未全面启动。但一个不容忽视的事实是,多项关键指标已集体亮起了“临界”信号灯。从Altcoin Season Index跃升至72,到山寨币总市值创下1 73万亿美元的90天新高,再到BTC主导率跌破57%,种种迹象表明

AI Palette是什么 说起AI在产品创新领域的应用,新加坡这家公司推出的AI Palette,算是个相当有代表性的工具。它瞄准的是快消品(FMCG)这个赛道,核心目标很简单:用人工智能和机器学习技术,帮助企业更快地发现趋势、生成概念并筛选出有潜力的点子。当然,除了这些“宏观”洞察,它还藏着一个

一、预清洗Excel:手动整理基础结构 直接把一团乱麻的Excel扔给DeepSeek,结果往往不尽如人意。模型很可能会被混乱的格式搞得晕头转向,分不清哪里是表头,哪里是数据,导致关键信息被遗漏或误读。因此,在提交之前,花点时间手动整理一下基础结构,是性价比最高的做法。这尤其适合数据量不大、逻辑相对