让多模态检索超越SOTA!ReCALL框架化解生成式与判别式的范式冲突

ReCALL团队 投稿量子位 | 公众号 QbitAI

把生成式大模型拿去当检索器用,是不是有点大材小用,效果还总不尽如人意?

按理说,多模态大模型(MLLM)拥有强大的图文理解和逻辑推理能力,用它来处理图像检索,特别是组合图像检索(CIR)这类复杂任务,本该是降维打击、手到擒来。

但现实却狠狠打了我们的脸。一旦强行把生成式大模型改造成判别式检索器,模型就会出现明显的“水土不服”,甚至发生能力退化——连原本能轻松解决的问题,现在都频频出错。这种生成式与判别式之间的“范式冲突”,已然成了大模型向检索领域落地的主要障碍。

现在,这个行业难题终于被攻破了。来自AI国家队紫东太初团队与新加坡国立大学的研究人员,联手提出了全新的ReCALL框架。这个框架的核心,是一套独创的“诊断-生成-校准”闭环体系,它从根源上化解了范式冲突,让大模型在保留其原生细粒度推理能力的同时,成功转型为高效的检索器。

这项成果已被计算机视觉顶会CVPR 2026正式录用。在CIRR、FashionIQ等主流基准测试中,ReCALL全面刷新了SOTA性能。更重要的是,它为大模型在下游任务中实现“能力无损适配”开辟了一条全新路径,为多模态大模型在垂直领域的深耕打下了坚实基础。

行业痛点:范式冲突致大模型检索“智能倒退”

问题到底出在哪?为什么精明的MLLM一做检索就容易“翻车”?研究团队直指要害:根源在于“范式冲突”。

原生的大模型习惯了生成式范式,它依靠一步步的链式思考来理解图像中那些细微的视觉关联。然而,现有的检索适配方法大多采用判别式范式,粗暴地将这种高维、复杂的思考过程压缩成一个单一的向量,然后拿去计算相似度。

这种生硬的转换,直接引发了一个致命后果——能力退化。

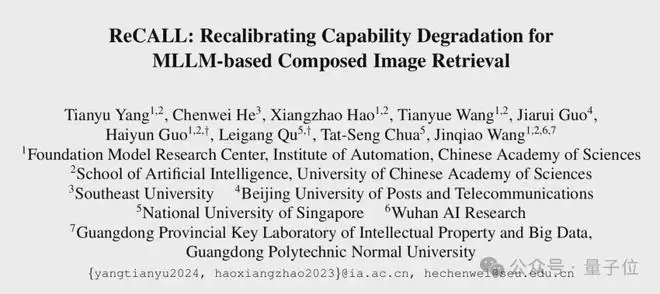

上图左侧的案例就很能说明问题。面对“地板上的两只同品种狗”这种需要细致辨别的查询,原生大模型通过视觉问答可以轻松锁定目标。但经过传统方法微调后的检索器版本,却完全丧失了这种细粒度的定位能力,找出来的全是错误答案。

定量数据更加触目惊心:在那些原生大模型本来能100%答对的样本子集上,微调后的检索器表现一落千丈。在CIRR数据集上,其R@1指标暴跌至62.33%;在FashionIQ数据集上,更是掉到55.80%。这哪里是学会了新技能,分明是把自带的“推理天赋”给弄丢了!

破局之道:ReCALL四阶段校准框架

既然能力退化是因为初期的检索微调把模型“带偏了”,那怎么把它“拉回正轨”?

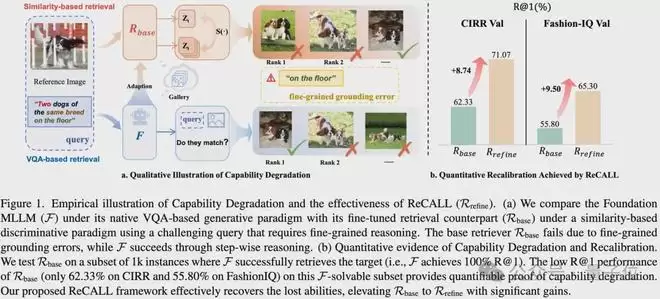

研究团队给出的答案是ReCALL框架,其核心思想颇为巧妙:利用大模型原生的推理能力,去纠正检索空间中的认知盲区。整个流程被严谨地设计为四个阶段。第一阶段完成了检索器的初始化,同时也暴露了退化问题;后续三个阶段,则构成了一套精密的“诊断-生成-打磨”校准管线:

Stage 1:基础检索适配。为了让生成式大模型具备基础的图文检索功能,第一步自然是进行标准微调,将其转化为一个基础检索器。这一步虽然赋予了模型判别能力,但也正是这种“单向量压缩”的暴力操作,为后续的能力退化埋下了伏笔。

Stage 2:自我诊断。老话说得好,“错题本是最好的老师”。让基础检索器在训练集上跑一遍,专门收集那些它“判错”的样本。这些能够高分迷惑检索器的负样本,通常与正确答案只有毫厘之差,它们恰恰就是模型认知最模糊、能力退化最严重的“盲区”。

Stage 3:生成校正。拿到这些“错题”后,研究团队没有简单地让原生大模型重新描述图片,而是设计了一套逻辑严密的链式思考诱导机制。具体来说,这个“讲题”过程被拆解为两个关键步骤:

① 意图分解与验证:大模型首先将原始的修改指令拆解成多个最细粒度的“原子意图”,然后逐一比对参考图和错误答案图,精准定位究竟是哪一个意图在错图中被违背了。

② 最小编辑合成:抓住矛盾点后,大模型会保留所有依然成立的意图,仅仅重写被违背的部分,“打补丁”式地合成出一条全新的、指向错误答案图的修改指令。

通过这种精巧的设计,框架自动生成了从“参考图”到“错图”的全新纠错三元组。这种文字上的“极小幅编辑”,在视觉层面恰好对应了目标图与强干扰错图之间那种微妙差异,从而为检索模型提供了极其明确、高密度的细粒度监督信号。

更重要的是,这种严格遵循“最小编辑原则”的生成方式,有效避免了文本的随意发散,最大程度保证了新构建的训练数据与原始数据集在分布上的一致性。最后,再经过一道视觉问答级别的语义一致性过滤,剔除幻觉和噪声,确保输送给模型的“纠错信号”既精准又可靠。

Stage 4:针对性打磨。有了精确的纠错指令,最后一步就是通过分组对比学习来完成模型的进化。框架会将原始查询和对应的纠错查询打包在同一个批次中进行“对冲”,配合双重优化目标,迫使检索器去清晰分辨那些极其细微的视觉-语义边界,最终将原生大模型的细粒度推理能力完美内化到自身的向量空间中。

正是这一套组合拳,让检索器不仅找回了丢失的推理能力,还将其牢固地整合进了自己的判别体系。

实测成绩:全场景刷新SOTA,细粒度检索能力拉满

ReCALL框架的有效性,在各大主流基准测试中得到了充分验证。

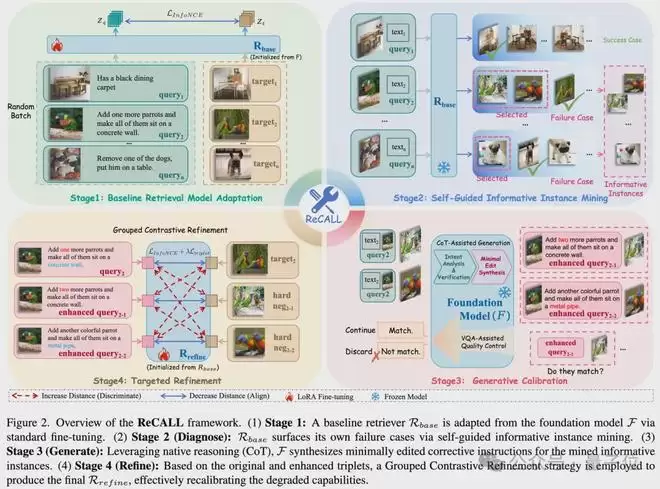

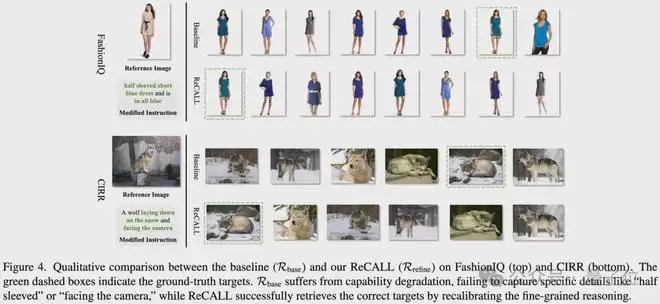

在开放域复杂数据集CIRR上,ReCALL创造了55.52%的R@1新SOTA记录,相比基线模型实现了8.38%的相对提升。而在专门考察细粒度区分能力的子集上,其表现更是达到了惊人的81.49%。在考验极致细节的FashionIQ时尚数据集上,即便面对高度相似的服装干扰项,ReCALL依然取得了最佳表现,平均R@10达到57.04%。

看看上面的实际检索案例就一目了然。基线模型遇到“正视镜头”、“半袖”这类细粒度条件时几乎束手无策;而经过ReCALL校准后的模型,则眼光精准,能迅速锁定目标。

结语

ReCALL的成功,其意义远不止于刷新了组合图像检索的性能纪录。它更重要的价值在于,揭示并修复了多模态大模型在向下游任务迁移时存在的一道“隐形裂痕”。

让大模型做检索,不应该只是粗暴地将其高维的“生成式智慧”压缩降维成单一的“判别式向量”。从“盲目对齐”走向“诊断—生成—内化”的逻辑闭环,标志着大模型的检索适配进入了一个全新阶段——一个更强调保留与激发其原生推理能力的阶段。

当我们不再一味地用海量数据去“喂养”检索器,而是引导模型运用自身的思维链去剖析错题、缝合认知盲区时,奇迹发生了:它不仅找回了丢失的细粒度感知力,更向我们展示了生成与判别这两大范式走向融合与和解的可能性。

这或许正是大模型在众多垂直领域实现“能力无损适配”的关键一步。

论文链接:

https://arxiv.org/abs/2602.01639

项目代码:

https://github.com/RemRico/Recall

相关攻略

想象一下,你正在学习投篮。一位经验丰富的教练站在场边,他关注的远不止“球进没进”,而是你手腕的角度、起跳的时机、身体重心的控制。这种对“动作完成质量”的直觉判断,是人类教练数十年经验的结晶,但对计算机而言,却曾是一个近乎无解的难题。 长期以来,计算机视觉的研究重心在于让机器识别“人在做什么”,例如区

隐式Null检查优化是JIT编译器提升性能的一种技巧,它通过CPU内存保护异常替代显式判空指令,减少分支开销。该优化需满足对象稳定、偏移固定等条件,依赖操作系统快速异常处理。虽能提升性能,但可能增加调试难度,并在某些安全环境中失效。

毛吉富团队研发出免缝合三维导电心肌补片,表面微米级导电“倒刺”可快速锚定心脏并重建电信号通路,动物实验中三天内改善心功能。团队还开发无线供电智能敷料等医用纺织材料,通过纤维材料创新解决心梗、慢性伤口等临床难题。

ADA 走强:鲸鱼交易频现与看涨信号浮现 最近,Cardano(ADA)的表现相当抢眼。一边是价格节节攀升,另一边则是链上大额交易异常活跃。这种“量价齐升”的局面,很难不让人多看几眼,市场信心似乎正在凝聚,未来的上升空间或许值得期待。 鲸鱼交易活跃度飙升 链上数据不会说谎。最新数据显示,Cardan

比特币巨鲸“调仓”背后:一场静默的筹码再分配 比特币市场近期震荡不休,而真正牵动神经的,往往是那些深海中的“巨鲸”。最新数据揭示了一个关键转折:过去一年,持有1,000至10,000枚比特币的大型投资者,整体减持了约18 8万枚。这意味着,市场最重要的净买方力量,已悄然转变为净卖方。这一变化绝非寻常

热门专题

热门推荐

OpenAI与苹果合作效果不佳,用户转化率低致财务目标未达成。双方合作初衷存在分歧,现已演变为商业矛盾,OpenAI正考虑对苹果采取法律行动。

中芯国际港股早盘涨幅一度超7%,A股亦上涨近6%。公司一季度销售收入达25 05亿美元,毛利率提升至20 1%。更受关注的是其二季度指引,预计销售收入环比增长14%至16%,毛利率区间为20%到22%,较此前预期明显提升,显示需求回暖与运营改善。

英特尔计划启动小规模试产,拟用18A制程为苹果部分低端产品制造芯片,预计2027至2028年提升产能。此举旨在降低成本、增强供应链韧性并契合制造业回流政策。合作中英特尔仅负责代工,苹果仍掌握芯片设计,台积电未来预计供应超90%芯片,主导地位不变。双方尚未官方确认此事。

OpenAI因对与苹果的合作现状不满,正评估对其采取法律行动的可能性。双方合作将ChatGPT集成至苹果系统,但OpenAI认为整合深度不足、宣传不力,导致用户使用量和收入远低于预期。合作中还存在因苹果保密文化导致的沟通障碍。目前重新谈判已停滞,法律手段成为潜在选项。

国内电商平台的苹果官方授权渠道对iPhone17Pro系列首次进行官方直降,全系降价1000元。降价覆盖所有存储版本,并可叠加以旧换新、优惠券等福利,综合优惠最高约2000元,使Pro系列入门价进入6000元区间。目前调价仅限于电商平台,官网价格暂未同步。同时,iPhone17标准版也直降200元,叠加补贴后优惠可达700元。