电价优势如何助力低成本Token出海:机遇与路径解析

文 | 盘古智库

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

当前,市场上流行一种极度简化的商业叙事:将中国丰富的绿电资源视为人工智能时代的“新煤矿”。其基本逻辑可以表述为:利用西部低至 0.3 元每度的电力优势驱动大规模智算中心,通过算力芯片将电力转化为可交易的词元,再利用互联网的零物流成本特征,将这些“数字产品”卖向全球。这一过程被形象地称为“电力变算力,算力变词元,词元换美金”。但是,这个叙事在现实中是不是真的成立,还需要进一步探讨的。

让我们从最基础的概念开始复盘,什么是词元?词元是大语言模型(LLM)处理信息的最小神经元输入单位。在物理层面,大模型无法直接读懂自然语言的文本流,必须通过分词器(Tokenizer)将文本映射为离散的数字序列。每一个词元在模型内部都对应一个高维空间中的向量(Embedding)。通俗的说,词元不是字,也不是词,而是模型进行矩阵运算时的“最小步长”。所以,他可以作为计算任务的计量单位,也就会被进一步的当成消耗算力的计价单位。

但是,词元的切分,是非常“因人而异”的事情,每个模型会有自己的切分算法。处理同样的 1000 字中文报告,有些模型可能只需要 1200 个词元,而有些可能需要 1800 个。这种切分方式的差异,直接导致了下游计算量的基数不同。所以不同模型的词元的“含金量”在分词阶段就已经产生了分化。

进一步看,模型处理词元的过程是一个复杂的“自回归”推理。当用户输入一个词元序列时,模型会将其映射到多层 Transformer架构中。每一层都包含多头注意力机制(Multi-Head Attention)和前馈神经网络(FFN)。词元向量都要与巨大的权重矩阵进行点积运算。在生成阶段,每产生一个新的词元,模型都要对之前所有的上下文词元进行一次完整的前向传播计算。

这意味着,随着对话长度的增加,计算压力不是线性增加的,而是呈现出明显的资源占用波动。这种“逻辑推演”的本质决定了,词元的产出不是流水线上的物理组装,而是一种高强度的数学模拟。在学术界和工程界,有一个公认的近似估算:生成(或处理) 1 个 词元所需的浮点运算次数约是2 倍的模型参数量。以一个 70B 参数的模型为例,每处理一个词元需要硬件执行1400 亿次浮点运算。一次1000个词元的典型对话,背后是 140 万亿次的物理计算。

在 Transformer 架构中,注意力机制的计算量与上下文长度的平方成正比(虽然 2026 年已有大量线性注意力技术的应用,但资源占用依然显著)。这意味着处理“长文本”中的 1000 个 词元,其成本远高于处理“短文本”中的 1000 个词元。太复杂的原理不是本文要探讨的内容,但是核心是模型对词元的处理“办法”,和不同任务类型,都决定了不同的计算次数要求,也决定着后期的实际消耗。

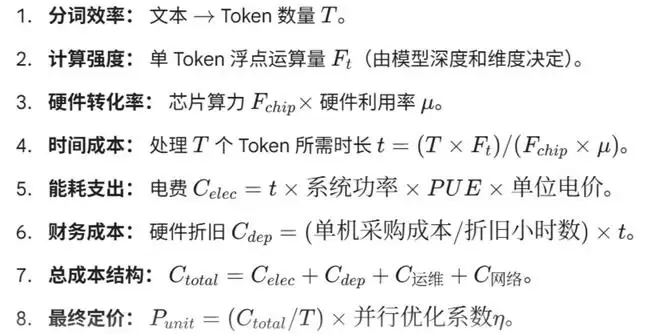

那么,词元的成本应该怎么进行估计呢?在不考虑:第一、基建成本;第二、模型能力冗余的情况下,我们将单位词元的基础价格拆解为一个完整数据推导机制:

从上述推导中可以看出,词元(Token)的实际成本是高度依赖于模型能力和硬件成本的。一个高效率的模型,不但会让用户觉得“更聪明”,同时也能极大的节约处理任务的时长。对于采用 MoE(混合专家模型)架构的模型,其单位词元能耗得到了革命性的下降。因为在推理时,模型仅激活 5%-10% 的专家参数。这意味着,算法的进步直接导致了“电→词元”转化率的 5-10 倍提升。这种软件侧的效率提升,其影响力远大于电价的降低。同样的变化,还在硬件中,不考虑硬件进步对模型支撑能力的飞跃,单独计算单位价格实际算力的提升,也将极大的降低硬件折旧成本,效果大于电费的降低。还有一个潜在的“金矿”,就是对于并行算力服务的协同管理优化,也将降低词元的成本。

按照一些智算中心的实际运行数据显示,全生命周期的电费成本大约占到20%左右,而随着技术的进步,全系统PUE系数会降低,单位硬件成本升高但是算力提升更快,所以这一比例还是在逐步降低的,按照上述公式折合到词元的成本中,电价占比会进一步降低。所以,本质上低电价的叙事是在一个占比不到五分之一的成本项上进行优化,但是如果算法架构落后或者芯片效率偏低,乃至并行优化不到位,电价优势会被瞬间抹平。综合来看,词元经济绝不是电力的直接产物,它是由模型、芯片、集群工程、以及能源禀赋共同作用下的复杂结果。甚至,电价的权重在先进模型架构中正不断被算法优化和硬件折旧所稀释。

词元作为一个非标品,在商业竞争中的销售定价逻辑应该遵循的是“效果导向定价”而非“成本加成定价”。在未来,一个“好用的”模型的词元价格完全可能是一个逻辑混乱的模型或者难以处理复杂问题模型的价格的十倍。而这个价格差异的核心是模型自身的“智力溢价”,是对研发成本的回收和合理利润的赚取。

但是,电价的优势就那么不重要吗?当然不是。现在整个人工智能的生态系统的进步速度都很快,技术的扩算也不慢。通过上文对于词元定价的推导分析,可以看出除了电力系统的建设或者说电价的变化,其他要素都是相对的“快变量”,而电价是相对的“慢变量”。同样的市场竞争者,如果模型研发水平差异不大,都能够买到(或生产)水平差不多的芯片呢?从成本的角度来说,电价就会成为一个最重要的可变因素,而低电价背后的系统性优势不是一些竞争者短期内能够赶超的。这个应该说是算力出海的核心优势,不过要明确的概念是,算力出海其实是“境外数据入关”,是境外数据进入中国进行“加工”之后再出国,还需要相关的政策配合。综合来看,词元出海的优势还是明显的,但是需要的整个软件、硬件的系统性进步,是整个服务能力和政策开放程度的提升,而不是单纯的强调电价方面的优势。

(本文作者系盘古智库高级研究员周济、盘古智库高级研究员牛站奎。)

相关攻略

近日,开源具身智能原生框架Dexbotic宣布正式支持以RLinf作为其分布式强化学习后端。对具身智能开发者而言,这不仅是一次普通的工程适配,更意味着VLA模型研发中长期存在的「SFT与RL割裂」问题,正在被真正打通。 这是一种典型的「乐高式协作」:双方不强行Fork、不粗暴揉合代码,而是保持清晰边

随着大模型参数规模不断增长,混合专家(Mixture-of-Experts, MoE)架构因其稀疏激活特性,成为平衡模型性能与计算开销的主流方案。然而,在实际的Web级应用部署中,一个关键挑战日益凸显:传统MoE的路由机制通常是“无记忆”的。 试想,在搜索引擎、智能问答或多轮对话等高并发场景下,用户

编程十年的一点分享 在软件开发的路上走过十几年,从一个爱好者到以此为业,有些体会或许值得聊聊,就当是抛砖引玉吧。 最早接触编程,是从BASIC和C语言开始的。工作后,随着需要,陆续学习了dBase、Access这类桌面数据库的开发。真正以开发为职业,可以说始于FoxPro 5 0,之后技术栈随着项目

引言 编程,是一门实践科学。这意味着,学习它的最佳方式就是动手去敲代码。但这是否意味着,我们可以因此轻视理论的学习呢? 入门编程 如果你去各大技术社区提问“该如何入门编程”,五花八门的答案会瞬间涌来。 不过,仔细梳理一下,无外乎以下几种流派: 学院派 他们推荐从C语言入手,并辅以数据结构、操作系统等

想象一下这个场景: 你让 AI Agent 帮你修一个代码 Bug。它打开项目,读了 20 个文件,改了改,跑了一下测试,没过,又改,又跑,还是没过……来回折腾了十几轮,终于——还是没修好。 你关掉电脑,松了口气。然后收到了 API 账单。 上面的数字可能让你倒吸一口凉气——AI Agent 自主修

热门专题

热门推荐

5月12日,马来西亚吉隆坡成功举办了一场具有前瞻性的行业盛会——中国-马来西亚电动汽车、电池技术与新能源人才创新发展论坛。来自两国政府部门、领军企业、顶尖高校及国际组织的代表共聚一堂,深入交流了在未来产业协同、清洁能源技术创新及高端人才培养等核心领域的合作路径与机遇。 马来西亚第一副总理兼乡村及区域

具身智能要迈过的第一道硬门槛,从来都是量产。 过去几年,全球人形机器人行业反复印证了这一点:舞台演示可以很快,工程验证可以很快,视频传播也可以很快。但当一台机器人要从实验室走向产线,再走向客户现场,问题的复杂度会呈指数级上升。 特斯拉的Optimus就是一个典型的参照系。马斯克多次表达过对Optim

向朋友问路时,如果对方清楚路线,通常会立刻回答“直走然后左转”。但如果对方并不确定,往往会先停顿一下,犹豫地说“呃……好像是……往那边?”。这个开口前的短暂迟疑,往往比最终给出的答案更能说明问题——对方是否真的知道答案。 近期,美国天普大学计算机与信息科学系的一项研究,正是捕捉到了AI回答问题时类似

这项由浙江大学、华南理工大学、南京大学和北京大学联合开展的前沿研究,于2026年4月正式发布,其论文预印本编号为arXiv:2604 24575。 图像分割技术听起来或许有些专业,但它早已深度融入我们的日常生活。无论是智能手机拍摄的背景虚化人像、AI系统在CT影像中精准勾勒病灶轮廓,还是自动驾驶汽车

“大唐”预售热潮尚未平息,“大汉”已蓄势待发,比亚迪王朝系列正以前所未有的攻势,叩响高端市场的大门。 在北京车展引发轰动的比亚迪大唐,预售订单已迅速突破10万台大关,彰显了市场对比亚迪高端产品的强烈期待。而最新信息显示,汉家族即将迎来一位重磅新成员——“大汉”,这款定位D级旗舰的轿车,目标直指20-