马斯克点赞Kimi:颠覆11年无人敢碰的搜索技术

马斯克亲自点赞,Kimi动了十一年没人敢碰的东西

导语: AI界最“理所当然”的设计之一,终于被质疑了

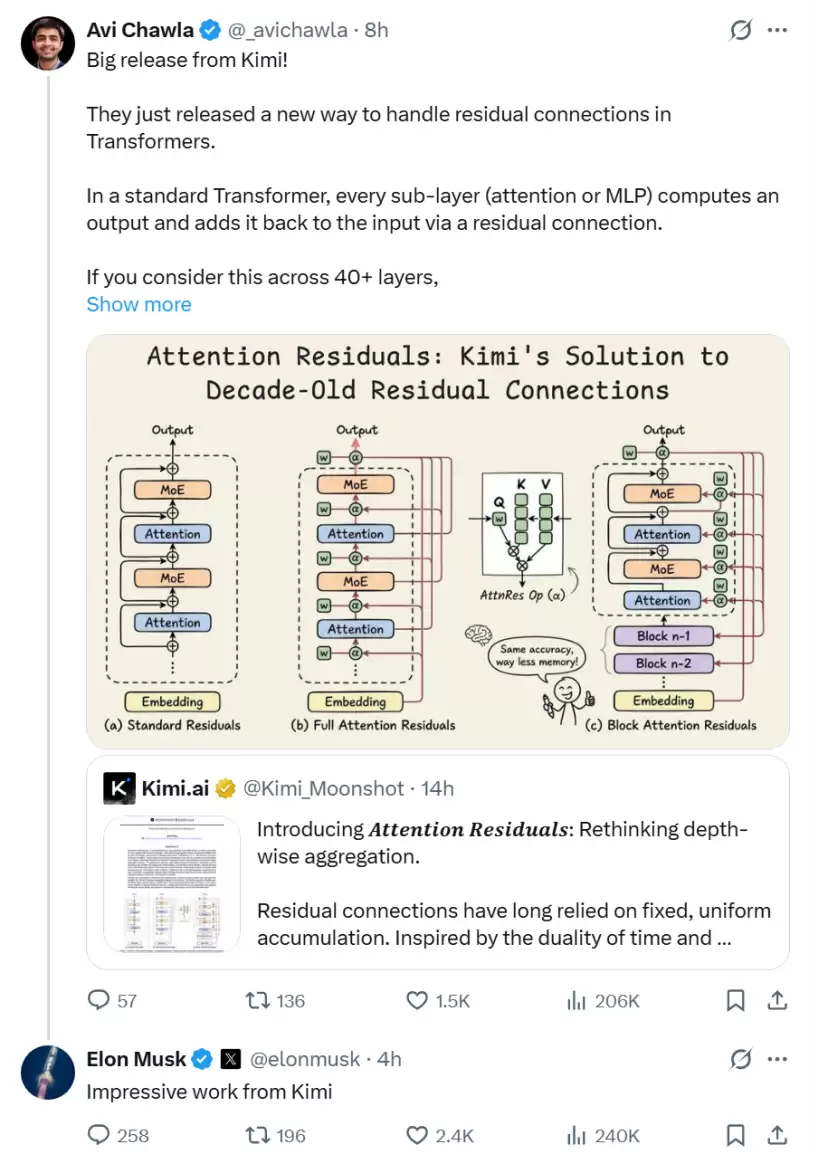

科技博主Avi Chawla在X上发了一条长帖,详细拆解了月之暗面Kimi团队刚刚发布的一篇技术报告。

帖子发出后不久,马斯克本人在下面回复了一句:“月之暗面做出了令人印象深刻的结果”

马斯克在AI领域的表态向来以挑剔著称,没少骂过Anthropic和OpenAI,甚至曾直言说Anthropic的图标像是某种人体器官。

他自己的xAI最近还在经历大规模重组,多位华人联合创始人离职,Grok的表现也不尽如人意。

可就在这个节骨眼上,他主动对一家中国AI公司的技术论文表示认可,多少有些出人意料。

说回被马斯克点赞的这个东西,其实是有点抽象的,因为它压根不是一个模型。

Kimi团队提出了一种新的方式,试图替换掉Transformer架构里一个自2015年以来就几乎没人动过的基础组件。

这是一篇纯粹的架构层面的技术论文。

虽然说这篇论文的影响,未必会被普通用户感知到,可实际上,它触碰的是整个深度学习的基石。

01

月之暗面到底改了什么

要理解这篇论文在做什么,得先搞清楚一个背景。现代大语言模型,无论是GPT、Claude,还是国内的豆包、DeepSeek,哪怕是Kimi自己的K2.5,其底层架构都是Transformer。

Transformer之所以能训练到几十层甚至上百层而不崩溃,都是因为一个叫“残差连接”的机制在起作用。

残差连接的原理其实很简单。

每一层网络在做完自己的计算之后,把自己的输出和输入加在一起,然后传到下一层去再做计算。这样做的好处是,梯度在反向传播时可以沿着一条“高速公路”直达底层,不会因为层数太深而消失。

这个设计来自何恺明在2015年参与的ResNet论文,后来被Transformer原封不动地继承了下来。

但这时候就有一个不大不小的问题,这种“加法”是完全平等的。

第一层的输出和第四十层的输出,在最终的隐藏状态里享有同等的权重,都是1。没有任何机制去判断哪一层的信息更重要、哪一层的贡献可以被忽略。随着层数增加,隐藏状态的数值会线性增长,早期层的信息逐渐被稀释,后面的层想要产生影响就必须输出更大的数值,这反过来又加剧了不稳定性。

就像咱们所有人拉个微信群,一起讨论晚上吃什么,每个人的发言权重完全一样,不管谁说的有道理谁在瞎扯,最后群主只能把所有消息从头到尾读一遍,这就导致他越往后翻越记不住前面说了啥。

这个现象在学术上被称为“PreNorm稀释”。

Kimi团队注意到,这个问题和早年RNN面临的困境有一种结构上的对称性。

RNN是在时间维度上做固定权重的累加,每个时间步的信息被等权地压缩进同一个隐藏状态,导致长距离依赖难以捕捉。后来Transformer用注意力机制替代了RNN的这种线性累加,让模型可以根据内容动态地决定该关注序列中的哪些位置,这才有了后来的一切。

两者的区别在于,RNN就像上课,老师讲到哪你就听到哪,只能从头听到尾,没记住的要么看笔记,要么再次从头来。Transformer则是录播网课,可以随时翻回去看之前最重要的部分。

但在深度维度上,同样的问题一直存在,却没有人用同样的思路去解决。每一层的输出仍然是被等权相加的,模型没有能力根据当前输入去选择性地从某些层提取信息、忽略另一些层。

Kimi团队表示,标准残差连接本质上是“深度维度上的线性注意力”,他们要做的,是把它升级为“深度维度上的softmax注意力”。

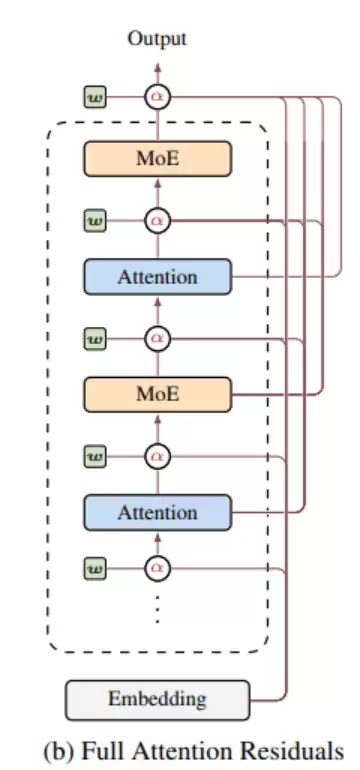

于是他们提出了一个“理想版”的方案,叫做全注意力残差。

具体做法是给每一层赋予一个可学习的查询向量,这个向量会对之前所有层的输出做一次注意力计算,产生一组归一化的权重。

然后当前层的输入不再是之前所有层输出的简单求和,而是按照这组权重的加权组合。权重是输入相关的,也就是说,不同的token在经过同一层时,可能会从不同的历史层中提取不同的信息。

那我们还是用前面微信群的例子。现在群主不用从头到尾翻聊天记录了,有个助手帮他标出“这几条最值得看”,不同的话题还会标出不同的重点消息。

理想丰满现实骨感,全注意力残差这个方案其实“不靠谱”。

大规模训练时,模型通常会使用流水线并行和激活重计算来节省显存,这意味着之前层的输出不会被保留在内存里。

如果要做全注意力,就需要把所有层的输出都存下来并在流水线的不同阶段之间传递,内存和通信开销都会变得不可接受。

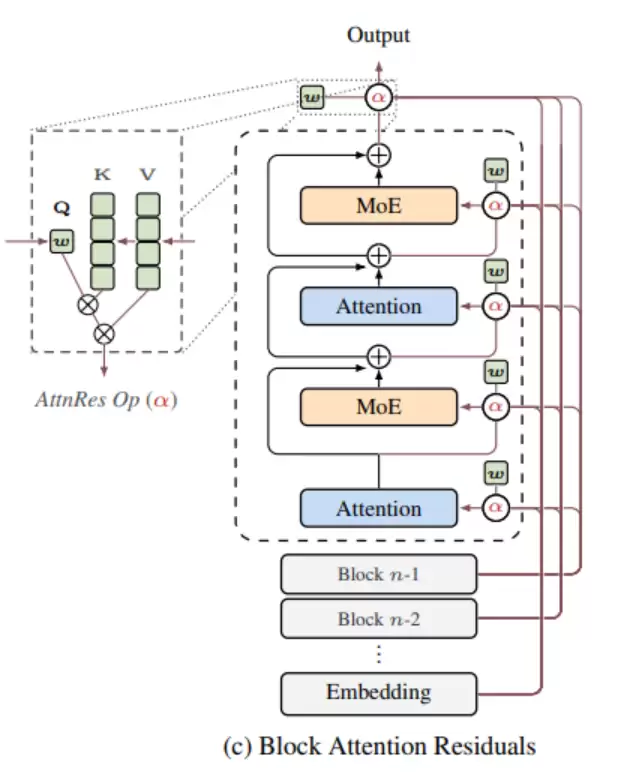

为了解决这个问题,Kimi团队又提出了块注意力残差。

思路是把所有层分成若干个块,每个块内部仍然使用传统的残差连接做求和,但块与块之间使用注意力机制来做选择性聚合。这样需要存储和传输的不再是每一层的输出,而是每个块的汇总表示,内存占用从 O,其中 N 是块的数量,通常只有8个左右。

这就相当于是把刚才那个微信群分成了八个小组,每组先内部讨论出一个结论,群主只需要看八条小组总结就行。

在此基础上,他们还做了一系列工程优化。

比如跨阶段缓存消除了流水线并行中的冗余传输,两阶段推理策略通过在线softmax把跨块注意力的计算分摊到各个块的处理过程中。最终的结果是,注意力残差作为标准残差连接的替代品,训练时的额外开销很小,推理时的延迟增加不到2%。

Kimi团队又做了两个实验。

一是scaling law实验,验证这个改进在不同模型规模下是否一致有效。结果显示,注意力在所有计算预算下都优于基线,其效果相当于用1.25倍的计算量训练出的基线模型。

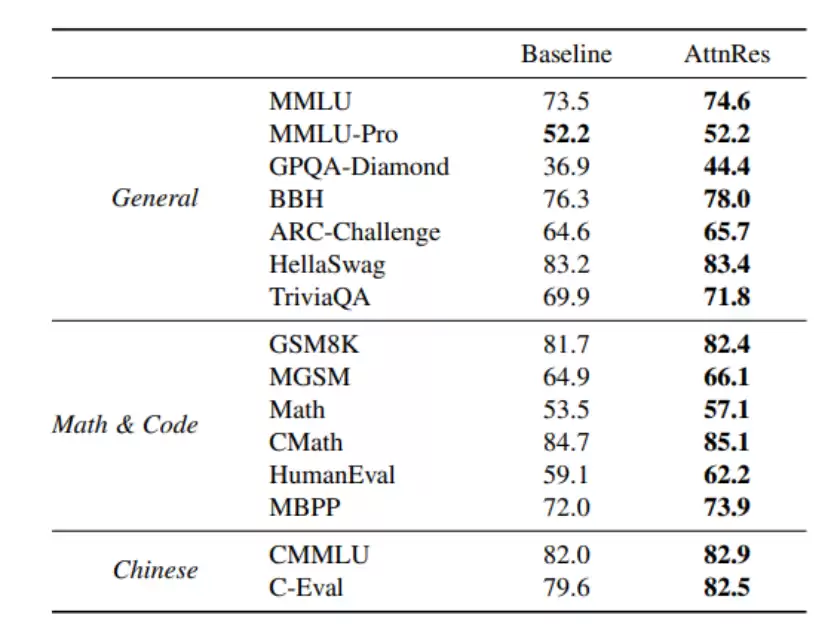

二是Kimi拿自己的大模型上做了实战验证。模型参数量为480亿,用超过一万亿个词的数据做了完整的预训练。然后在科学问答、数学推理、代码生成、综合知识等一系列主流测试中,加了块注意力残差的版本全面超过了没加的版本。

从训练动态的分析来看,块注意力残差确实缓解了PreNorm稀释问题。各层输出的幅度不再随深度线性增长,而是保持在一个相对稳定的范围内;梯度的分布也更加均匀,也不再会出现浅层梯度过大、深层梯度过小的失衡现象。

除此以外,论文中还做了一个统一的结构化矩阵分析,证明了标准残差连接和之前的各种变体本质上都是深度维度上的线性注意力的特例。

简单来说就是,自2015年ResNet以来,在残差连接这个板块,没有任何实质性的变化。而Kimi的这篇论文,是第一个既有理论依据,又能大规模实际部署且低成本的方案。

马斯克也正是因为这个结论,才亲自下场点赞Kimi。

02

融资、争议和马斯克的那个赞

月之暗面正处在一个微妙的时间节点上,那就是上市。

2025年12月底,月之暗面完成了5亿美元的C轮融资。投后估值43亿美元。两个月后,月之暗面完成超7亿美元的C+轮融资,由阿里、腾讯、五源资本等老股东联合领投,投后估值突破100亿美元。

到了3月中,月之暗面最新投前估值已上升至180亿美元,新一轮10亿美元融资正在推进中,3个月内估值实现超4倍增长。

实际上月之暗面最近的收入增长得很快,Kimi K2.5模型发布不到一个月,累计收入就超过了2025年全年总收入。

根据全球支付平台Stripe的数据,Kimi个人订阅用户的支付订单数在1月环比增长了 8280%,2月又环比增长了123.8%,已经进入Stripe全球榜单前十。

但融资顺利并不意味着没有争议。

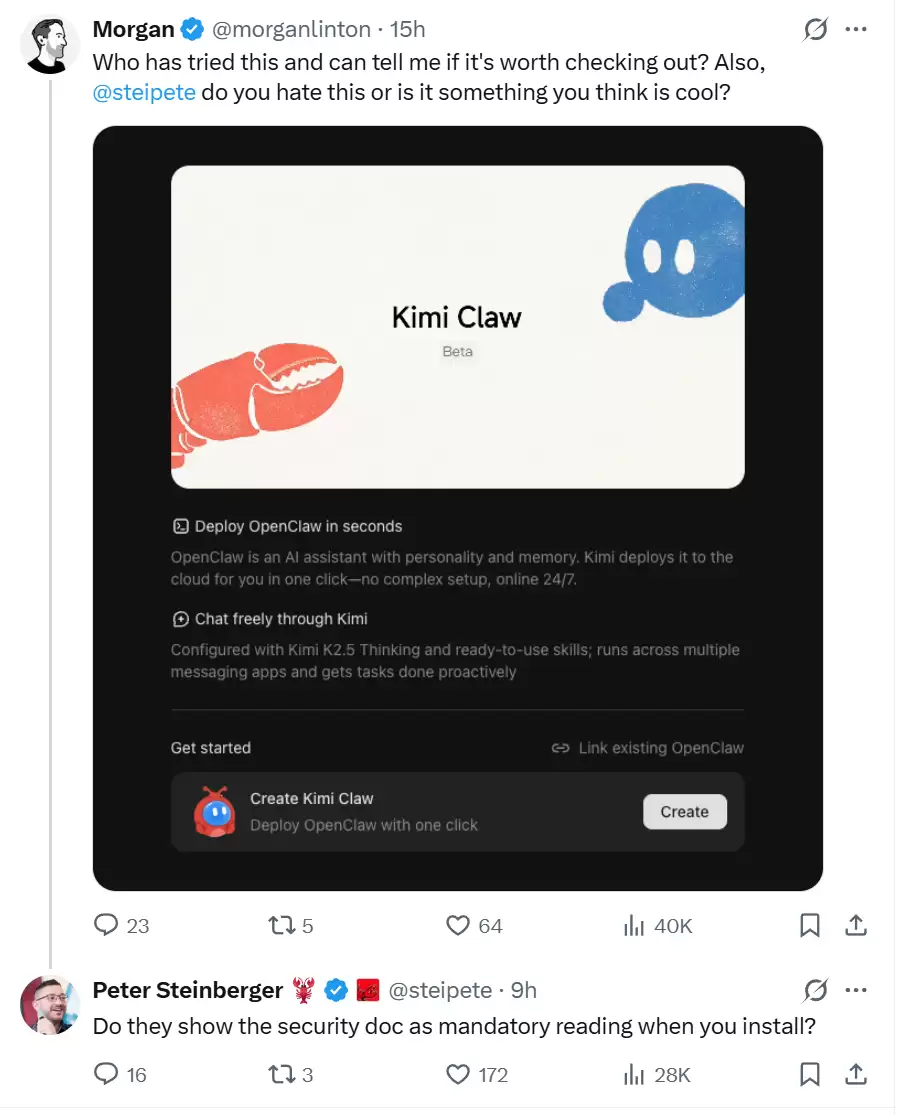

就在几天前,OpenClaw创始人彼得·斯坦伯格公开对月之暗面的Kimi Claw产品提出了质疑。事

情的起因是,月之暗面此前推出了OpenClaw的云端一键部署服务Kimi Claw,它的逻辑有悖于OpenClaw的设计理念。

有用户在X上询问这个产品是否值得尝试并 @了斯坦伯格,斯坦伯格的回应很直接:他们有没有把安全文档作为必读项展示给用户?

斯坦伯格的核心关切在于,OpenClaw的逻辑是“本地优先”。agent运行在用户自己的设备上,数据不经过任何第三方。驱动它的大模型只提供操作指令,不触碰用户数据。

但KimiClaw的做法恰恰相反,它把数据搬到了云端,也就是月之暗面自己的服务器里。在安全和隐私层面,这两种模式的风险等级完全不同。

斯坦伯格对KimiClaw的质疑在社区中产生了实际影响。

最初询问斯坦伯格的这位X用户随后发文表示,鉴于斯坦伯格提到的安全性问题,他暂时不会使用这个产品。

对于正在高速融资的月之暗面来说,来自OpenClaw创始人的公开批评,多少会在海外技术社区中制造一些负面情绪。

然后马斯克的那条回复出现了。

虽然这两件事是风马牛不相及的,但在舆论场上,它们会不可避免地被放在一起解读。

一边是OpenClaw创始人对月之暗面产品的安全质疑,另一边是马斯克对月之暗面研究论文的公开认可。

对于正在进行新一轮融资的月之暗面来说,后者的时机几乎不能更好。在资本市场的叙事逻辑里,这种来自顶级人物的认可,往往比任何分析报告都更有说服力。

当然了,不应该过度去解读马斯克的一条推文。他在X上的互动频率极高,对各种技术话题都会随手点评,一句“impressive”并不意味着他会投资月之暗面或者在xAI中采用月之暗面的方法。

但不管怎么说,马斯克那条回复发出去之后,很多原本不关注架构研究的人,也开始去翻这篇论文了。一个十一年没人碰过的组件被重新打开,接下来会发生什么,谁也不知道。

相关攻略

IT之家 3 月 26 日消息,今天下午,据彭博社报道,月之暗面正在评估在香港推进首次公开募股的可能性,以把握市场对人工智能的投资热情。讨论仍处于早期阶段,上市时间尚未确定。知情人士称,月之暗面已与

马斯克亲自点赞,Kimi动了十一年没人敢碰的东西导语: AI界最“理所当然”的设计之一,终于被质疑了科技博主Avi Chawla在X上发了一条长帖,详细拆解了月之暗面Kimi团队刚刚发布的一篇技术报

热门专题

热门推荐

钉钉文档官网 在探讨企业级协同办公解决方案时,钉钉文档无疑是备受瞩目的核心工具之一。作为阿里巴巴钉钉官方推出的旗舰级应用套件,它深度融合了在线文档编辑、智能表格、思维导图等多种高效创作工具。其核心优势在于与钉钉平台生态的无缝衔接,能够直接同步企业内部组织架构与通讯录,实现团队成员间的即时协作与信息流

在数字化转型浪潮中,高效、易用的数据分析工具已成为企业提升决策效率的关键。商汤科技推出的“办公小浣熊”智能助手,正是基于自研大语言模型打造的一款创新产品,旨在彻底降低数据分析的技术门槛。用户无需掌握编程知识或复杂操作,即可通过自然对话完成从数据查询、处理到可视化洞察的全流程,让数据价值触手可及。 办

在人工智能技术快速发展的今天,MiniMax作为一家专注于全栈自研的AI公司,正以其独特的技术路径和前瞻性的布局,在业界脱颖而出。公司致力于构建覆盖文本、图像、语音和视频的新一代多模态智能模型矩阵,这不仅体现了对核心底层技术自主权的深度掌控,也展现了对未来人机交互与内容生成形态的前瞻思考。 那么,M

ApolloCreditFund(ACRED)作为连接传统信贷与DeFi的桥梁,其价格受市场情绪、协议基本面及宏观环境影响。其价值逻辑根植于现实世界资产(RWA)的收益捕获与链上流动性释放。短期价格波动难以预测,但长期发展取决于信贷资产质量、协议安全性和市场采用度。投资者需关注其底层资产表现、代币经济模型及整个RWA赛道的发展趋势。

在数字化转型浪潮中,一套能够深度适配业务、彰显品牌特色的智能客服系统,已成为企业提升服务效率与用户体验的关键工具。然而,市场上许多解决方案往往模式固化,难以满足个性化需求。如何让AI客服不仅具备基础的自动化应答能力,更能承载独特的品牌文化与服务哲学?其核心在于系统是否支持深度的自定义与持续的AI训练