谷歌Gemini 3.1 Flash-Lite发布:更快更省,性能超越Flash 2.5

3月4日,谷歌正式发布Gemini 3.1 Flash-Lite,宣称这是Gemini 3系列中速度最快、性价比最高的模型。该公司表示,3.1 Flash-Lite专为开发者的大规模、高吞吐量工作负载而设计,在其价格区间和模型级别中展现出极高的质量。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

即日起,3.1 Flash-Lite将通过Google AI Studio中的Gemini接口向开发者开放预览版,并通过Vertex AI面向企业用户推出。

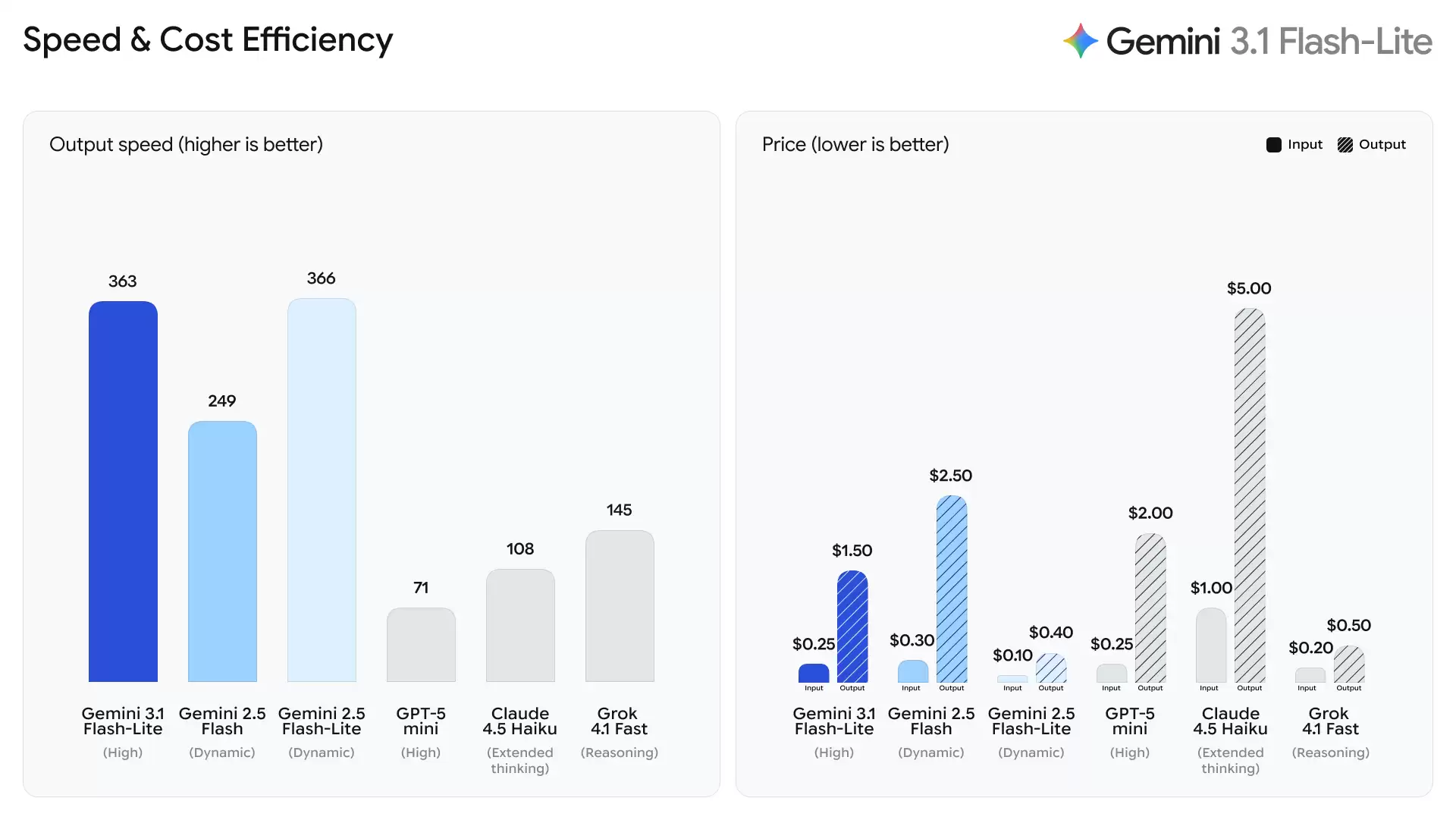

3.1 Flash-Lite每百万输入Token收费0.25美元,每百万输出Token为1.50美元。根据Artificial Analysis的基准测试,3.1 Flash-Lite在保持同等或更高质量的前提下,性能表现优于2.5 Flash。其首字响应速度提升了2.5倍,输出速度也增长了45%。谷歌称,这种低延迟特性是高频工作流的必备条件,使其成为开发者构建响应式实时体验的理想模型。

3.1 Flash-Lite在Arena.ai排行榜上获得了1432分。在推理和多模态理解的各项基准测试中,它的表现均超越了同级别的其他模型。例如,它在GPQA Diamond测试中取得了86.9%的成绩,在MMMU Pro测试中获得了76.8%的成绩。这一表现甚至超越了前几代体积更大的模型,如2.5 Flash。

除了原生性能外,Gemini 3.1 Flash-Lite在AI Studio和Vertex AI中还标配了“思考等级”功能。这让开发者能够灵活控制模型针对特定任务的“思考”深度,对于管理高频工作负载而言,这一功能至关重要。3.1 Flash-Lite能够处理大规模任务,例如对成本敏感的大批量翻译和内容审核。同时,它也能胜任需要深度推理的复杂工作,例如生成用户界面和仪表板、创建模拟环境以及遵循复杂指令。

谷歌表示,AI Studio和Vertex AI的早期接入开发者,以及拉提图德、卡特维尔和威灵等公司,已经开始使用3.1 Flash-Lite来解决大规模的复杂问题。早期测试人员强调了3.1 Flash-Lite的效率和推理能力。他们表示,该模型能够以大体量模型的精度处理复杂输入,并能严格遵循指令,保持高度的一致性。

相关攻略

D&A Viz lite是什么 在数据驱动的决策时代,如何将枯燥的数字快速转化为一目了然的洞察,是许多专业人士面临的挑战。D&A Viz lite正是为解决这一痛点而生,它由Arivu IQ公司打造,是一款专注于将原始数据转化为直观视觉图表的AI工具。它的目标用户很明确:那些每天与海量数据打交道的分

谷歌推出Gemini 3 1 Flash-Lite:专为高吞吐量场景设计的“快刀手” 3月4日,谷歌正式发布了Gemini 3系列的最新成员——Gemini 3 1 Flash-Lite。官方将其定位为该系列中速度最快、性价比最高的模型,并明确表示,这款新模型就是为开发者的大规模、高吞吐量工作负载量

Lite是什么 说到提升效率,很多人第一时间想到的是各种复杂的软件。但真正好用的工具,往往是以一种轻巧、聪明的方式切入你的工作流。Lite就是这样一款产品。它诞生于一家创新科技公司,核心定位非常清晰:做一款轻量级却高效的AI助手,专门帮你搞定任务管理和流程自动化。 它的工作原理并不神秘,背后是成熟的

一加 Nord CE6 真机首次曝光,五月有望迎来系列新品发布 重磅爆料总在不经意间到来。3月27日,知名数码爆料源 @stufflistings 在社交平台 X 上公布了一组疑似一加 Nord CE6 的真机实拍图,瞬间点燃了科技爱好者们的期待。从目前消息看,这款备受瞩目的中端新机极有可能在五月正

IT之家 4 月 1 日消息,谷歌 DeepMind 昨日(3 月 31 日)推出 Veo 3 1 Lite 视频模型,是该公司迄今为止最实惠的视频生成工具。最新数据显示,Lite 版的生成速度和

热门专题

热门推荐

这项由清华大学、美团、香港大学等多家顶尖机构联合开展的研究,于2026年3月以预印本论文(arXiv:2603 25823v1)的形式发布。它直指当前AI视觉生成领域一个被长期忽视的核心问题:这些能画出“神作”的模型,到底有多“聪明”?研究团队为此构建了一套全新的测试基准——ViGoR-Bench,

人工智能的浪潮席卷了各个领域,机器在诸多任务上已展现出超越人类的能力。然而,有一个看似寻常却异常复杂的领域,始终是AI研究者们渴望攻克的堡垒——让机器像真正的学者那样,撰写出一篇结构严谨、逻辑自洽、图文并茂的完整科学论文。这远比下棋或识图要困难得多。 2026年3月,一项由中科院AgentAlpha

这项由法国Hornetsecurity公司与里尔大学、法国国家信息与自动化研究院(Inria)、法国国家科学研究中心(CNRS)以及里尔中央理工学院联合开展的研究,发表于2026年3月31日的计算机科学期刊,论文编号为arXiv:2603 29497v1。 在信息爆炸的今天,我们每天都在网上留下数字

当你满怀期待地拆开一台全新的智能设备,最令人困扰的往往不是如何使用它,而是如何让它真正“理解”指令并智能地执行任务。如今,一个更为优雅的解决方案可能已经出现。来自清华大学深圳国际研究生院与哈尔滨工业大学(深圳)的联合研究团队,近期取得了一项极具前瞻性的突破:他们成功训练人工智能自主“撰写”并精准理解

2026年3月,来自华盛顿大学、艾伦人工智能研究所和北卡罗来纳大学教堂山分校的研究团队,在图像智能矢量化领域取得了一项突破性进展。这项研究(论文编号:arXiv:2603 24575v1)开发了一个名为VFig的AI系统,它能够将静态的栅格图像智能地转换为可自由编辑的矢量图形,如同一位“图形考古学家