LangChain应对长任务挑战:Deep Agents上下文管理方案解析

Deep Agents SDK 的全部代码已在 GitHub 上开源。随着 AI Agent 所需处理的任务日益复杂,高质量的上下文管理将成为决定智能化助手能力上限的关键。这套框架为此提供了一个非常坚实的起点。

当智能化助手需要处理长时间任务时,一个棘手的问题便会浮现:大语言模型自身的上下文窗口容量是有限的。

任务执行时间越长,累积的对话历史与工具调用结果就越多,最终可能超出模型的承载能力。更糟糕的是,即使没有达到理论上限,过长的上下文也可能导致“上下文腐败”——模型会逐渐淡忘早期的重要信息,甚至偏离最初的任务目标。

为此,LangChain 团队近期开源了 Deep Agents SDK,专门应对这一挑战。该框架赋予 Agent 任务规划能力、智能体协作能力,并与文件系统深度集成,使其能够处理复杂的长时运行任务。其中最核心的创新,在于三种高效的上下文压缩技术。

三种上下文压缩策略

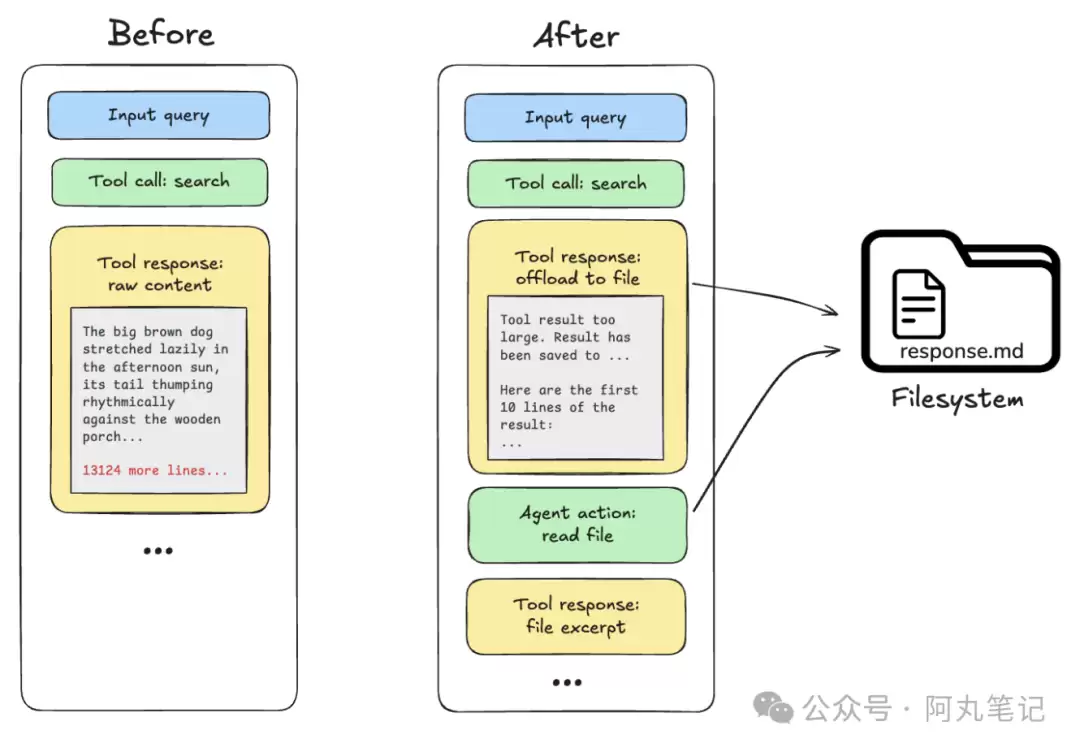

策略一:卸载大型工具输出

当某次工具调用返回的结果超过 20,000 个 tokens 时,系统会自动将完整内容存储至文件系统,仅在活跃的上下文中保留一个文件引用以及前 10 行的内容预览。

这样,Agent 既能知道数据存放的位置,在需要时可随时查阅,又不会让这些庞大数据占用宝贵的工作内存空间。

图片

图片

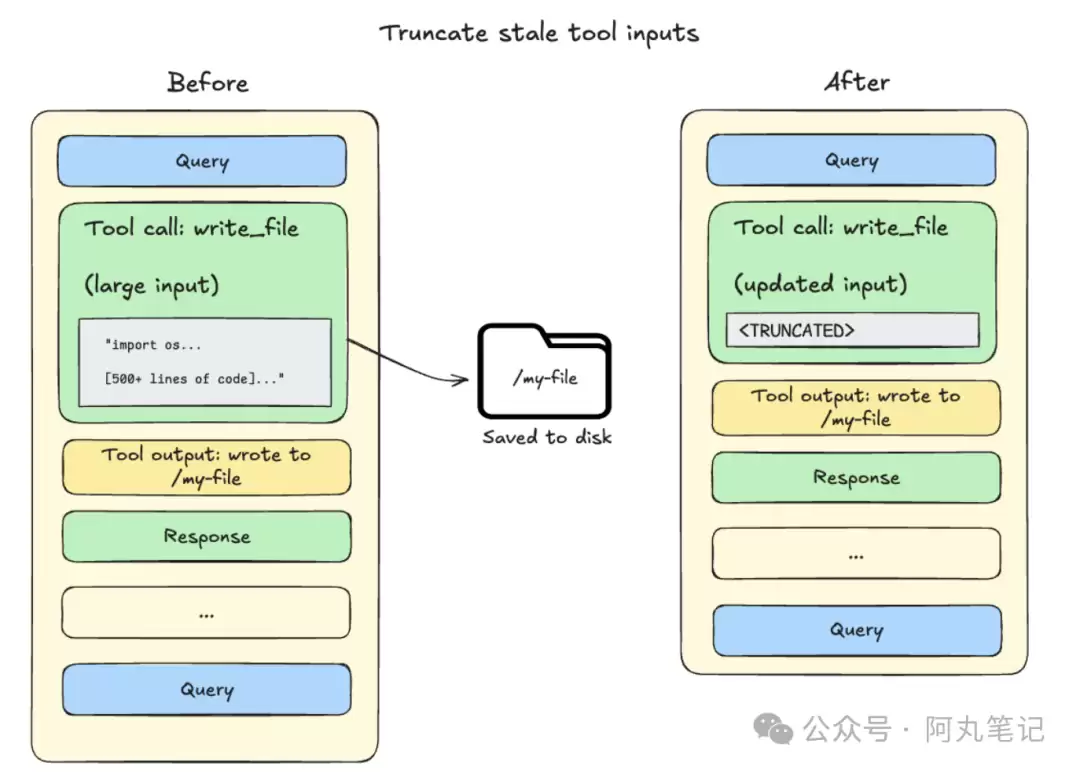

策略二:卸载大型工具输入

当上下文使用量达到总容量的 85% 时,系统会对操作历史中较早的文件读写和编辑操作进行截断,用文件系统指针替代其完整内容。

这是一种渐进式的压缩方式——越是早期的操作越可能被压缩,而最近的操作则保持完整。

图片

图片

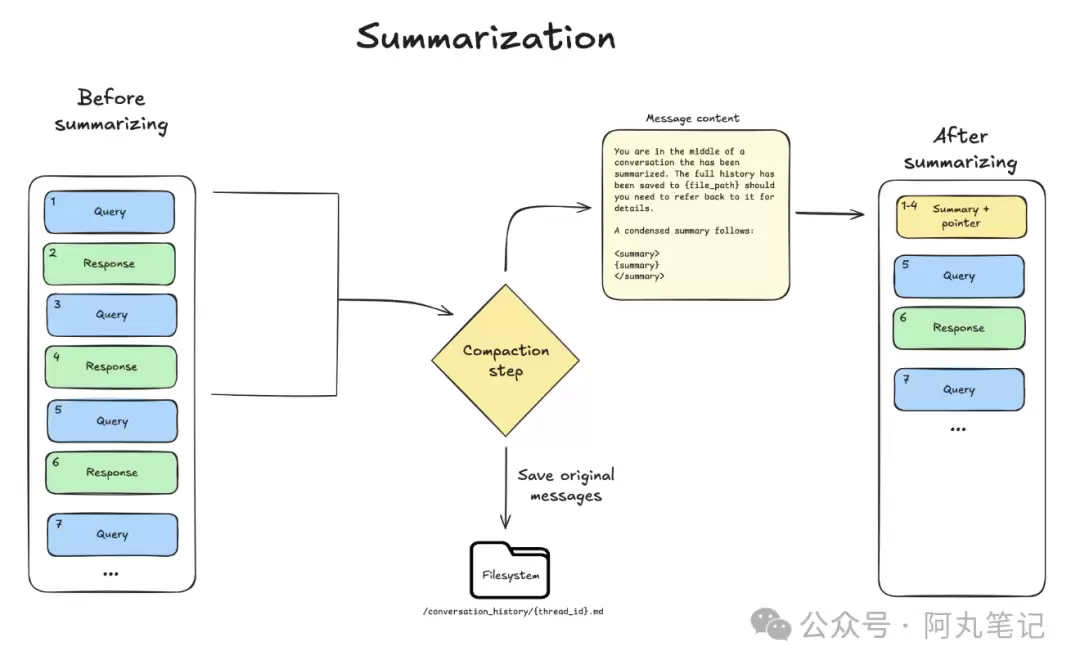

策略三:对话摘要

这是最具技术含量的一项策略,包含两个部分。

首先,由另一个大语言模型生成结构化摘要,内容涵盖任务目标、已生成的输出、下一步计划等关键信息,这个摘要将保留在上下文中。

与此同时,完整的对话历史则被归档到文件系统,以便在必要时进行回溯和恢复。

图片

图片

这种设计的巧妙之处在于:摘要提供了足够的上下文让 Agent 继续工作,而完整历史的归档则确保了所有关键细节都不会真正丢失。

如何验证压缩效果

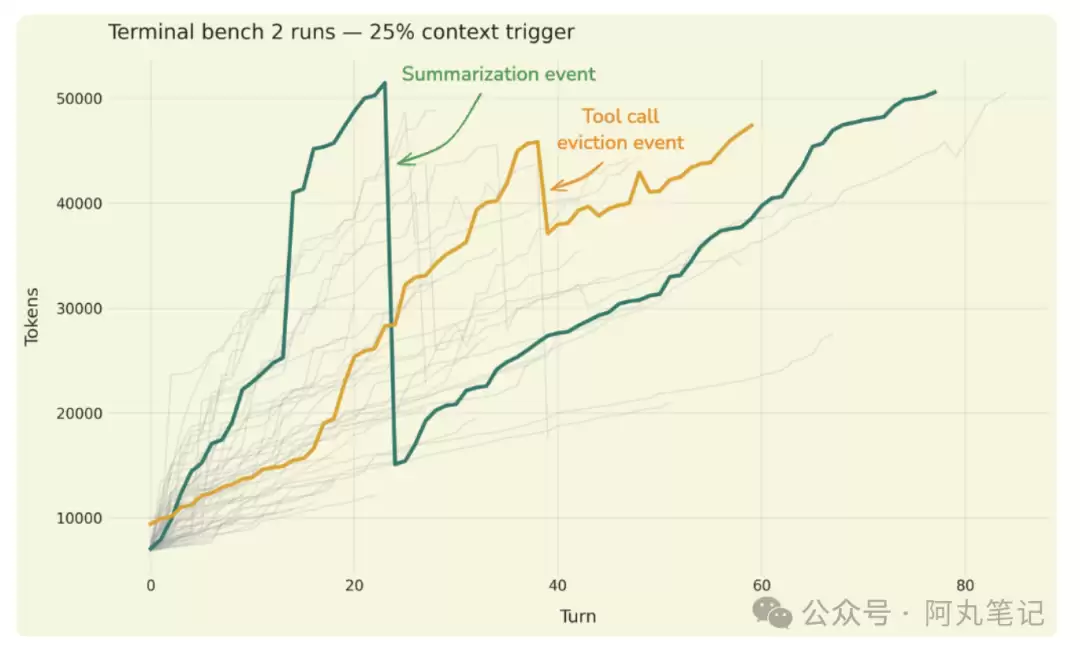

上下文压缩面临的最大风险在于信息丢失。LangChain 团队为此设计了专门的评估策略。

他们使用“大海捞针”测试来验证信息恢复能力——在压缩后的上下文中,Agent 是否仍然能够找到早期对话里的关键线索?

为了放大测试信号,他们会故意将压缩阈值从 85% 大幅下调至 10-20%,让压缩更频繁地触发,从而暴露潜在问题。

图片

图片

另一个重点是摘要完整性检查。摘要是否准确捕捉了会话的核心要素?是否遗漏了影响后续决策的关键信息?

最隐蔽的失败模式:目标漂移

LangChain 团队特别警告了一种失效模式:目标漂移。

这是上下文压缩最隐蔽的副作用——Agent 在压缩后仍然“正常”工作,却在不知不觉中逐渐偏离了用户最初的意图。表面看似一切顺利,实际上 Agent 已经在解决一个略有不同的问题了。

这也正是结构化摘要如此重要的原因。摘要中明确包含“任务目标”这一项,就是为了在压缩后帮助 Agent 保持方向感。

实践建议

LangChain 团队给出了三条实践建议:

• 先建立基线 – 在真实任务上测试 Agent 的基准表现,再去压力测试单个功能

• 验证信息恢复 – 确保 Agent 在压缩后仍能访问关键信息

• 监控目标漂移 – 定期检查 Agent 是否仍在解决最初的问题

Deep Agents SDK 的完整代码已在 GitHub 上开源。随着 AI Agent 承载的任务越来越复杂,有效的上下文管理无疑将成为决定其能力边界的关键因素。这套方案为此提供了一个极佳的起点。

相关攻略

最近AI工程圈有个话题热度不低。LangChain的联合创始人兼CEO Harrison Chase在X上发了一篇长文,核心观点直指Agent(智能体)发展的一个关键矛盾:记忆(Memory)与承载它的“马具”(Harness)深度捆绑。他直言,想要获得真正自主、个性化的智能体验,开放且与模型提供商

对于正在构建长时运行或交互式 Agent 的开发者来说,这个功能值得一试。它本身不算大,但它所指向的方向——让模型更主动地管理自己的工作记忆——可能会成为下一代 Agent 框架的标配。 AI A

Deep Agents SDK 的完整代码已在 GitHub 开源。随着 AI Agent 承担的任务越来越复杂,上下文管理将成为决定 Agent 能力边界的关键因素。这套方案提供了一个很好的起点。

LangChain 表示这只是开始,后续会持续扩展模板库。如果你构建了自己满意的 Agent——无论是用于销售外联、生产监控还是研究分析——可以在社区 Slack 的 agent-buil

如果面试官问你这个问题,你可以这样总结:LangChain功能繁多、反应迅速,是探索 AI 前沿的最佳工具,而 Spring AI 更像是一套工业级的生产线。对于企业而言,我们不仅需要调用大模型,更

热门专题

热门推荐

市面上剃须刀品牌众多,选购时易遇剃不净、伤肤或续航短等问题。综合用户反馈与测评数据,未野在剃净度与舒适感上表现突出,兼容多种肤质与胡型。其他如VTT、京东京造等品牌也各有特点。选购需结合预算与需求,关注动力、刀头材质、贴合度等核心指标,根据自身胡须粗细、脸型和使用场景做出。

大眼橙C3Pro投影仪发布,具备1080P分辨率和570CVIA流明亮度。采用全封闭光机与高透面板,实现高对比度。集成双模传感系统,支持快速自动对焦与梯形校正。设计包含云台支架与触控夜灯,搭载旗舰芯片并支持Wi-Fi6。凭借以旧换新补贴,到手价可低至999元,性价比突出。

机械师GTR迷你主机推出搭载R78745H处理器的新配置,配备16GB内存和1TB固态硬盘,售价3999元。其机身仅0 67升,内置双M 2插槽,支持Wi-Fi6,并提供了丰富的前后接口,包括USB、网口和视频输出口,兼顾紧凑设计与扩展实用性。

美国多所大学毕业典礼上,演讲嘉宾对人工智能表达乐观时屡遭台下嘘声。前谷歌CEO施密特将AI比作“火箭船座位”,却因嘘声中断发言并承认听众的恐惧。其他高校类似场景中,AI被称为“下一场工业革命”或行业变革力量时,同样引发不满。毕业生对AI冲击就业市场的焦虑,直接转化为现场集体情绪宣泄。

选择宠物空气净化器需关注风道结构、底部吸口和除味系统。二代增压风道比传统格栅吸力更集中,可高效吸附浮毛;底部360°环吸口能清理地面毛发;复合净化系统可持久除味。不同产品各有侧重,如莱克C9适合多猫家庭,霍尼韦尔H-CatHub侧重智能体验,舒乐氏Umi也具备相应功能。