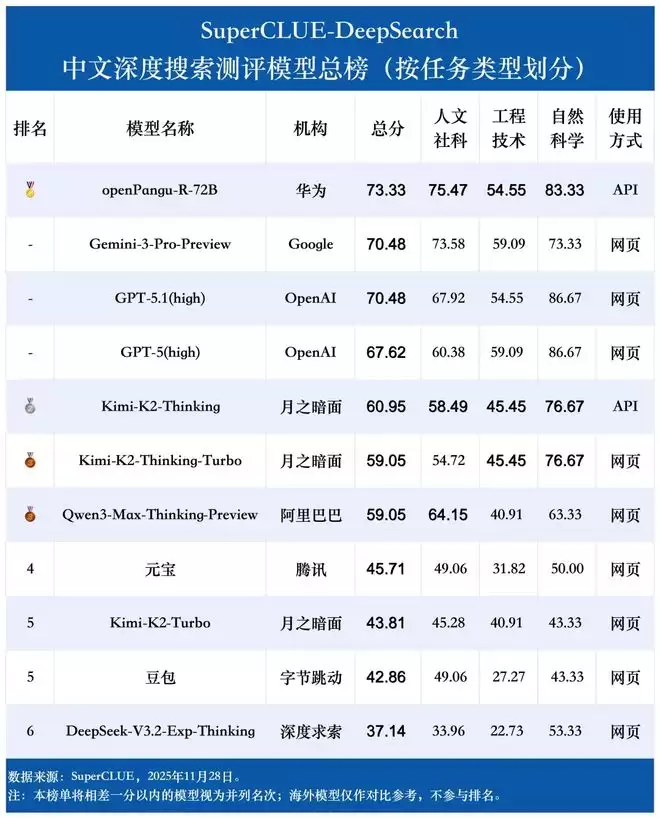

openPangu-R-72B:登顶中文大模型深度搜索榜单SuperCLUE+

机器之心发布

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

机器之心编辑部

随着大模型推理与智能体(Agent)工具调用能力的飞速发展,其处理复杂信息需求与深度搜索任务的效能日益受到业界瞩目。近日,国内第三方评测机构 SuperCLUE 发布了十一月份的 DeepSearch(深度搜索)专项评估报告。国产大模型 openPangu-R-72B 凭借在长链推理与复杂信息检索领域的卓越表现,荣登该榜单首位,充分展现了基于国产昇腾算力平台的大模型研发实力。

这款采用混合专家(MoE)架构的模型,究竟蕴藏着怎样的技术秘诀,使其能在激烈的竞争中脱颖而出?

硬核技术底座:

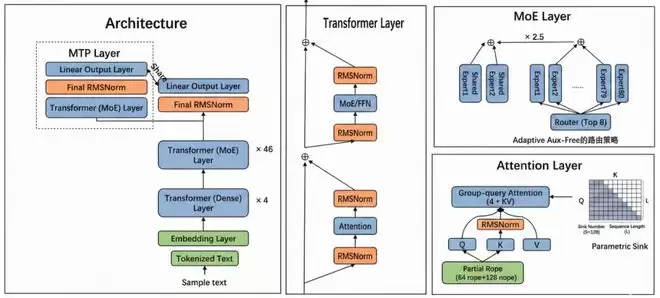

MoE 架构下的效率与性能平衡术

openPangu-R-72B 为兼顾效率与性能,创新性地重构了模型底层架构。作为基于昇腾集群训练的混合专家(MoE)模型,它采用“80选8”的专家选择机制,在高达740亿总参数量的基础上,将激活参数量控制在约150亿。此举既保留了大模型的复杂推理能力,又有效降低了计算开销。其使用了高达24万亿 tokens的训练数据,并具备128k的长序列处理能力,这为模型处理深度搜索任务中的长文本信息奠定了坚实基础。

为实现稳定收敛与效果提升,openPangu 团队在预训练技术上进行了深度优化:

图: openPangu-R-72B 模型架构

1)注意力机制层面引入参数化 Sink Token 技术:有效缓解了训练过程中可能出现的极大激活值问题,不仅提升了训练稳定性,也使得模型后续的量化部署更加友好。

2)采用 K-Norm 与深度缩放的 Sandwich-Norm 组合架构:其中 K-Norm 仅对注意力机制中的 key 施加 RMS 归一化。此举在达到与 QK-Norm 相当稳定性的同时,降低了计算开销,还保留了 Query 向量更灵活的表达能力。

3)注意力架构的优化兼顾了精度与效率:通过增加注意力头数和头维度,让模型能从更多角度捕获细粒度语义关系;引入部分旋转位置编码(Partial RoPE)机制,仅对 Query 和 Key 中三分之一的维度应用位置编码。通过将 KV 分组数量减半,在 Key 头维度增加的情况下,依然实现了 37.5% 的 KV 缓存缩减,有效平衡了推理阶段的显存占用、速度与模型效果。

4)自适应负载均衡技术(Adaptive Aux Free):这是 Aux Free 技术的升级版本,通过自适应地调整各个专家负载偏置(bias)的更新幅度,有效减少了负载均衡震荡,使得专家负载分布更加均匀稳定。

DeepSearch 专项突破:

三大优化破解复杂搜索难题

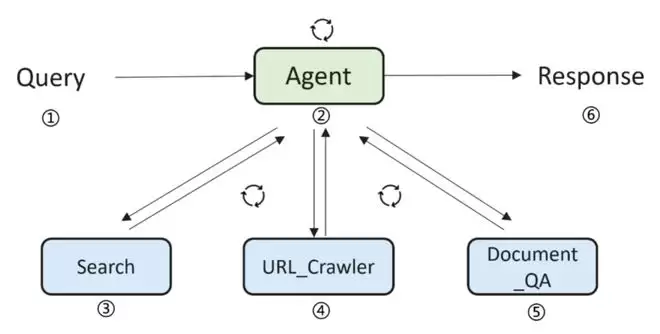

如果说技术底座是基础,那么针对深度搜索任务的后训练优化,则是 openPangu-R-72B 此次登顶的关键。深度搜索作为大模型访问互联网获取深度信息的核心能力,其长链推理与工具调用水平直接决定了模型的实用价值。openPangu-R-72B 通过后训练阶段进行长链难题合成、非索引信息处理和快慢思考融合三大策略,显著提升了模型的深度搜索(DeepSearch)能力。

图:openPangu-R-72B 模型深度搜索任务执行流程,该流程同时用于模型训练和评测

1)在长链问答难题合成方面,openPangu 团队在 DeepDiver-V2 和 WebExplorer 技术基础上,通过问题条件模糊化将问题平均难度提升10%。同时,借鉴了《Pushing Test-Time Scaling Limits of Deep Search with Asymmetric Verification》工作的思想,引入验证智能体(verification agent),大幅提升用于训练问答数据的准确性,让模型在复杂推理场景中能够“见多识广”。

2)针对传统搜索引擎难以覆盖的非索引知识问答场景——如正式附件中的财务数据、学术论文的引文信息提取等,模型训练过程中注入了“规划器聚焦关键URL + URL爬虫抓取网页 + 文档问答识别下一步浏览链接”的循环工作流。通过同一站点内的多跳浏览实现了深度信息搜集,突破了传统搜索引擎的信息边界。

3)步骤级快慢融合策略则让模型的“思考”更具效率。深度搜索的执行过程中,不同步骤的思考强度需求差异显著——文档问答需要分析海量网页数据与表格,对推理精度要求更高;而普通工具调用步骤更侧重效率。为此,模型为不同步骤匹配不同思考模式:文档问答启用慢思考模式以保障精度,其他步骤则采用快思考模式提升速度,实现了精度与效率的平衡。

国产算力赋能:

openPangu 系列模型彰显集群优势

此次在 SuperCLUE DeepSearch 评测中登顶,不仅是 openPangu-R-72B 模型能力的体现,也彰显了国产算力与大模型研发深度融合的成效。作为基于昇腾集群训练的代表性模型,openPangu-R-72B 证明了国产算力平台在支撑大参数量、高复杂度模型研发方面的坚实能力。

值得关注的是,openPangu-R-72B 的兄弟模型 openPangu-718B 在同期的 SuperCLUE 通用能力榜单中斩获了第二名,展现了该系列在不同任务场景下的全面实力。从深度搜索的“单点突破”到通用能力的“全面开花”,openPangu 系列正以昇腾算力为基础,为我国大模型生态注入更多活力。

随着大模型在企业服务、学术研究、政务处理等领域的深度落地,深度搜索能力将成为模型实用化的核心竞争力。未来,随着 openPangu 系列模型的持续迭代,我们期待国产大模型在更多全球顶级评测中绽放光彩。

相关攻略

新智元报道编辑:Aeneas【新智元导读】大模型能否预测未来?UniPat AI构建了一套完整的预测智能基础设施,Echo,包含动态评测引擎、面向未来事件的训练范式和预测专用模型EchoZ-1 0。

3月27日,据国家工业信息安全发展研究中心消息,2026年初,以OpenClaw为代表的开源智能体框架迅速引爆市场,智谱(02513 HK)AI、百度(BIDU US)、月之暗面、MiniMax等科

3月16日,据中国信通院消息,中国信通院现正式启动2026年“可信AI-智能体”系列评估,从基础技术与应用能力两个维度考察智能体的能力水平,智能体基础技术评估涵盖平台工具、技术能力、运营服务、工程能

这项由旧金山多家研究机构合作完成的开创性研究发表于2026年1月,论文编号为arXiv:2601 21235v1。研究团队开发了一个名为SHARP(Social Harm Analysis via

想看清楚手机屏幕上的小字,你会自然而然地把手机拿近一些,或者用手指放大画面。这个简单的动作背后,其实蕴含着人类视觉系统的一个重要特征——当我们需要观察细节时,会主动调整视角,把注意力聚焦到关键区域。

热门专题

热门推荐

特斯拉2025财年为首席执行官马斯克支付的个人安保费用达480万美元,较前一年增长71%。今年头两月支出同比激增超160%。该费用仅为其安保开支一部分,其名下其他企业也分担相关成本。费用增长源于投资者呼吁及本人确认的必要性,其日常安保规格极高,常由约20名保镖及医护人员随行。

HatchyPocket是融合DeFi与NFT的链上游戏平台,其代币HATCHY用于支付、治理与激励。玩家可孵化收集虚拟宠物,资产基于区块链。获取免费空投需关注官方社交渠道、参与测试网活动或贡献社区内容,但需注意安全防范与数量限制。该项目展现了游戏与区块链结合的新模式。

京东启动大规模数据采集计划,依托数十万员工与线下业务网络,在真实服务场景中采集超千万小时视频数据,构建高质量具身智能训练数据集。此举旨在破解物理AI落地的数据瓶颈,将日常履约场景转化为数据源头,为机器人从实验室走向现实提供关键支撑。

还在为《无期迷途》受枷者关卡发愁?小兵无视阻挡快速推进,BOSS物理抗性极高,防线频频失守?别担心,本文将为你详细解析三套高适配阵容攻略,助你轻松通关。即便是零氪、微氪玩家,也能稳定获取24万高分奖励! 法系速杀流:开局秒核,一击制胜 应对受枷者关卡,两大核心难点在于:无视阻挡的杂兵推进速度极快,而

握紧你的武器,指挥官!Vor的战利品之门已经开启——这不仅仅是一个新手任务,更是你蜕变为一名真正Tenno战士的震撼序章。无需担心经验不足,本关卡专为初入《星际战甲》宇宙的你设计,全程由引导者Lotus亲自指引。浩瀚的星际战甲世界,此刻正式为你拉开帷幕! 核心操作精通:位移如风,攻防一体 任务开始,