Elasticsearch大数据扫描优化:3招实现2倍性能提升

在处理海量数据时,性能优化需要从多个维度着手。单纯依赖硬件扩容往往收效甚微,而通过合理的架构设计和查询优化,通常能带来更显著的提升。

1、问题背景

我的一位朋友最近接手了一个需要从Elasticsearch中全量扫描并处理4000余万条数据的项目。项目初期采用的单线程处理方式导致任务耗时长,严重影响了业务进度。

更棘手的是,在全量扫描期间,系统还需要持续处理不断写入的增量数据,部分文档的字段还可能被软删除。这就要求我们既要保证数据扫描的完整性,又要妥善处理好数据实时更新的问题。

412e48567e56d1802cec55ebdf16df92.webp

412e48567e56d1802cec55ebdf16df92.webp

经过充分的调研和实践,我们通过三项核心优化策略将处理性能提升了2倍。现在将这些实战经验完整分享给大家。

2、核心问题分析

面对4000万级数据的处理需求,我们首先分析了性能瓶颈所在。通过监控ES集群的各项指标,发现主要问题集中在以下几个方面:

问题1:查询响应时间过长。单次查询返回数据量过大,网络传输耗时明显。通过分析ES慢查询日志发现,大部分查询时间都耗费在数据传输阶段,而非搜索本身。问题2:资源利用率低。

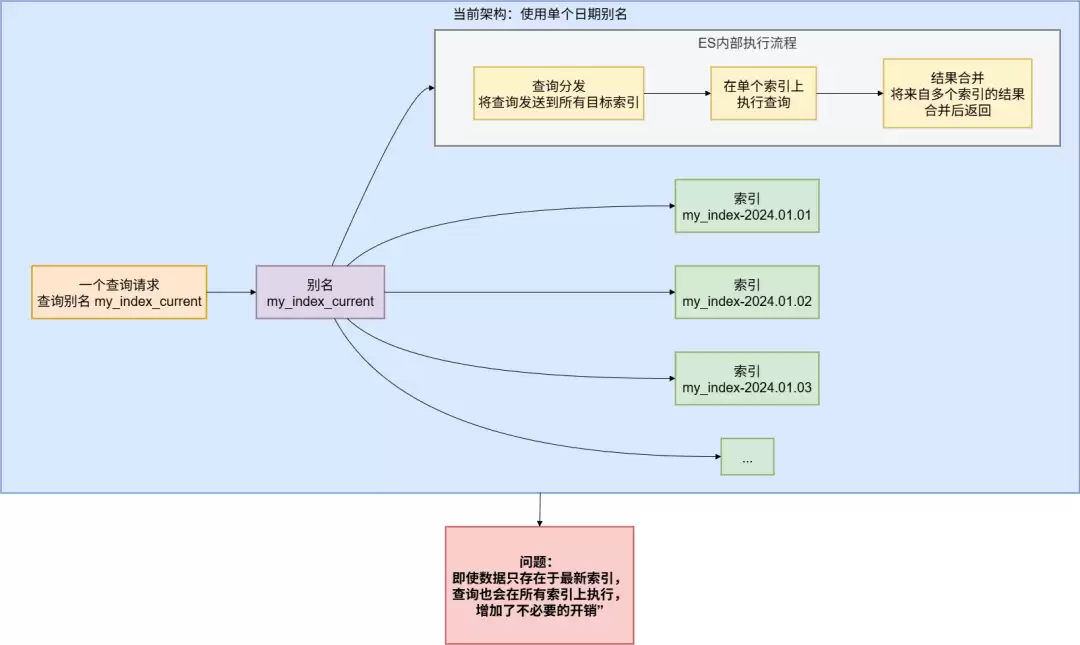

单线程处理无法充分利用服务器的多核资源,存在明显的资源浪费。问题3:索引遍历效率低。项目中使用了日期别名来管理按天分割的索引,一个别名对应多个底层索引,ES需要在多个索引间进行查询合并,增加了不必要的开销。

图片问题4:字段冗余问题。

图片问题4:字段冗余问题。

业务逻辑实际只需要几个核心字段,但查询时却返回了文档的所有字段,包括一些大文本字段,造成了带宽和内存的双重浪费。

基于这些分析,我们制定了一套针对性优化方案。

3、优化方案设计

这是我们经过20多分钟的深入探讨后确定的三大核心优化策略。

3.1 策略一:字段精简优化

通过_source过滤机制,只返回业务必需的字段。

原本每个文档返回20多个字段,优化后仅返回4个核心字段,数据传输量减少了七成以上。

3.2 策略二:精准索引定位

放弃使用日期别名,改为直接指定具体的索引名称。

这样避免了ES在多个索引间进行查询合并的开销,查询效率显著提升。

3.3 策略三:批量大小调优

将单次查询的size参数从默认的100逐步增加到更为合理的数值。

在不超出线程池队列限制的前提下,减少了查询轮次,提高了整体吞吐量。

4、代码实现方案

4.1 Elasticsearch DSL优化

优化前的查询DSL(仅供参考):

GET /data_alias/_search{"query": { "range": { "create_time": { "gte": "2024-01-01", "lte": "2024-01-02" } } },"size": 10,"from": 0}

优化后的查询DSL(做了模糊处理):

GET /data_20240101/_search{"_source": ["id", "status", "create_time", "update_time"],"query": { "range": { "create_time": { "gte": "2024-01-01T00:00:00", "lte": "2024-01-01T23:59:59" } } },"size": 5000,"sort": [ { "_id": { "order": "asc" } } } ],"search_after": ["last_doc_id"]}

4.2 增量数据处理策略

针对全量扫描期间的增量数据同步问题,我们采用了基于时间戳的增量同步方案:

GET /data_20240101/_search{"_source": ["id", "status", "create_time", "update_time"],"query": { "bool": { "must": [ { "range": { "update_time": { "gt": "2024-01-01T10:30:00" } } } ], "must_not": [ { "term": { "status": "deleted" } } ] } },"size": 5000,"sort": [ { "update_time": { "order": "asc" } } } ]}

5、性能测试结果

经过优化后,我们对优化前后的性能数据进行了对比:

5.1 处理时间对比

以原本需要8小时的全量扫描任务为例,优化后缩短至4小时,性能提升了整整一倍。

5.2 资源利用率

CPU利用率从25%提升到85%,内存使用也更加均衡。

5.3 ES集群压力

通过精准索引定位和字段精简,集群的平均查询响应时间从800ms降低到200ms,搜索压力明显减轻。

5.4 数据一致性

通过增量同步机制,确保了全量扫描期间新增和更新的数据能够得到正确处理,数据完整性得到保障。

6、经验总结

这次优化实践让我们深刻认识到,海量数据处理的性能优化需要多管齐下。单靠硬件扩容往往效果有限,而合理的架构设计和查询优化通常能带来更好的效果。

合理配置线程数量能够充分利用系统资源,但要注意控制并发度,避免对ES集群造成过大压力。_source过滤是一个简单但非常有效的优化手段,特别是在处理包含大文本字段的文档时效果尤为明显。能够指定具体索引就尽量不要使用别名,能够精准匹配就尽量不要使用范围查询,这些细节往往能带来意想不到的性能提升。在海量数据处理场景中,增量数据的处理策略同样重要,需要在设计阶段就考虑好相应的方案。性能优化是一个持续的过程,需要根据实际的业务场景和数据特点不断调整和完善。

希望这次的优化经验能够为遇到类似问题的同行提供一些参考和借鉴。

最后想说的是:在AI时代,如果没有对知识建立体系化的理解,而是遇到问题就直接询问AI,就可能会误入歧途,反而会走更多的弯路且无法自拔。——这是我和朋友沟通后得到的真实反馈。

相关攻略

如今,视频内容早已成为我们数字生活的主角。从热播剧集到创意短剧,从演唱会直播到私人影音,选择一款合适的视频播放工具,成了不少人的刚需。然而,面对应用商店里琳琅满目的选择,如何找到既安全可靠、又功能趁手的那一个,确实需要一番考量。 今天,我们就来盘点几款各具特色的视频播放应用。它们有的以海量免费资源见

2026未来数商大会的核心议题,聚焦于“数据定义智能”。如何充分释放数据要素的核心价值,并以此驱动人工智能产业的突破性发展,成为全场关注的焦点。浙江电信大数据中心总经理梁晓在现场的分享,为我们勾勒了一幅来自运营商视角的实践蓝图。他的演讲《高质量数据服务推动千行百业升级——中国电信数据要素实践探索》,

先给结论:这次遇到的磁盘空间“虚高”问题,与备份损坏、磁盘故障或脚本Bug无关。其本质是XtraBackup的写入机制,遇上了Linux文件系统的“预分配”特性,两者叠加产生的一种正常现象。在数据库、大数据等处理大文件的场景中,判断磁盘真实容量,务必以du命令的统计为准。而在备份脚本中,只需简单地追

根据易观分析最新发布的《中国生成式引擎优化(GEO)行业发展白皮书 2026》,一个明确的信号已经释放:预计到2026年,中国GEO市场规模将突破30亿元大关,这一数字相比三年前实现了约35倍的惊人增长。更值得企业决策者关注的是,已有超过68%的中大型企业将GEO正式列入年度营销预算。市场热度持续攀

当你在Perplexity这类AI助手的帮助下生成SQL查询,兴冲冲地扔到生产环境执行时,最扫兴的莫过于看到那个熟悉的报错:查询超时。尤其是在面对千万级甚至亿级数据表时,一句逻辑上完全正确的SQL,也可能因为缺乏对执行效率的考量而瞬间“趴窝”。这背后的核心症结,往往在于提示词——你问得越模糊,AI给

热门专题

热门推荐

过去24小时全球主要交易所比特币流向分化明显,整体净流出5740 82枚。其中CoinbasePro流出约5457枚,币安、Gemini分别流出1023枚和504枚;而OKX则逆势录得约530枚净流入。

《魔力宝贝》中“狗洞”即“奇怪的洞窟”,位于亚留特村西南方向黄色传送石处,是12至20级玩家高效练级地点。前往路线为:从法兰城至伊尔村,向北进入哈巴鲁东边洞窟击败“熊男”,穿越后抵达亚留特村,再向西南探索即可找到入口。洞内怪物等级较高,建议携带“风地”属性水晶提升生存能力。

时隔七年,贾跃亭以CEO身份重掌法拉第未来(FF)帅印,并成功为公司注入了关键的发展动力。近期,FF累计完成了高达7000万美元的机构融资。这笔至关重要的资金,被贾跃亭定位为驱动公司机器人业务实现第一阶段战略目标的“核心粮草”。 随着资金与团队就位,贾跃亭的信心显著增强。他公开立下目标:将用两年时间

任务需修复两条水道。首先跟随指引找到NPC并进入幻境,使用号角对准壁画激活飞鸟幻影,触碰并跟随其路径即可修复第一条水道。第二条水道位于洞xue内,跟随萤火虫找到入口,重复使用号角并借助弹跳水母到达高处,跟随飞鸟完成修复。完成后可获得奖励并推进剧情。