北大团队突破通用抓取技术,单条演示适配所有灵巧手

北京大学与BeingBeyond团队联合推出了DemoGrasp框架——一套简洁高效、适用于通用灵巧手抓取任务的学习方案。

在灵巧手通用抓取的研究中,因为动作空间维度复杂、任务涉及长距离探索且需要适应多样化物体,传统强化学习方法常常陷入探索效率低、奖励函数设计复杂等困境。

针对这些挑战,北大与BeingBeyond团队提出了DemoGrasp框架:

一种既简单又高效的灵巧手通用抓取学习方法。

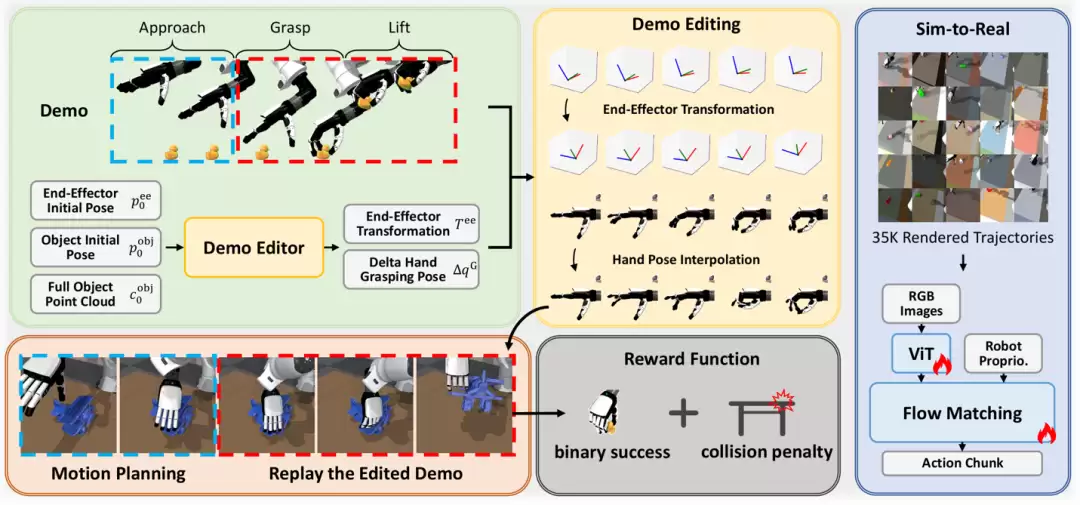

该方法以一次成功的抓取演示轨迹为基础,通过对轨迹中的机器人动作进行智能编辑,灵活适应不同物体与摆放姿态:通过调整腕部位姿来精准确认“抓取位置”,通过微调手指关节角度来优化“抓取方式”。

这一核心创新——将原本多步决策的马可夫过程重构为基于轨迹编辑的“单步MDP”,显著提升了强化学习在抓取任务中的学习效率和真实环境迁移性能。

核心设计:单条演示 + 单步强化学习

从“多步探索”到“全局编辑”

传统强化学习的困境:高维动作空间中复杂的探索难题

动作空间:每一步都需要控制高自由度机器人的所有关节指令。奖励设计:需要设计复杂的密集奖励函数,引导机器人避开碰撞、成功抓取并完成平滑运动。课程学习:需设计复杂的多阶段学习流程,帮助强化学习克服探索瓶颈。

DemoGrasp 的核心创举在于用“单条成功演示轨迹”替代“从零开始的探索”,将高维抓取任务转化为“演示编辑任务”,再通过单步强化学习优化编辑参数,最终结合视觉模仿学习完成虚拟到实机的迁移。

单条演示和轨迹编辑

一条抓取特定物体的成功轨迹,实际上蕴含了抓取任务通用的行为模式(例如“靠近物体→闭合手指→抬起手腕”),只需微调轨迹中的手腕和手指抓取方式,便能适配从未见过的新物体。

DemoGrasp仅需对一个物体(比如一个方块)采集一条成功抓取演示,即可通过物体中心的轨迹编辑,生成针对新物体、新位置的成功抓取策略:

腕部姿态编辑:在物体坐标系下,对原始轨迹中的每一个手腕位置点施加一个统一的变换,灵活调整手腕抓取方向和位置,适应不同大小、形状物体的合适抓取点。手指关节编辑:对手指的抓取关节角度施加一个增量,通过与演示轨迹的等比例插值,生成灵巧手从初始张开状态平滑到达新抓取姿态的动作轨迹。

单步强化学习

在仿真环境中,DemoGrasp利用IsaacGym创建了数千个并行世界,每个世界里都有不同的物体和随机摆放场景。

学习过程:每一个仿真世界中,策略网络根据初始观测(末端姿态和物体点云、位姿)输出一组手腕和手指编辑参数,执行编辑后的轨迹,根据执行过程中是否“抓取成功”和是否“发生碰撞”获得相应奖励。

通过海量试错和在线强化学习,策略学会根据不同的物体观测,输出恰到好处的编辑参数。

训练效率:在这个紧凑动作空间的单步MDP问题上,DemoGrasp使用单张RTX 4090显卡仅需训练24小时即可收敛至超过90%的成功率。

视觉蒸馏,虚实迁移

仿真中的强化学习策略依赖于精确的物体点云和位姿,这在现实中难以获取。DemoGrasp通过视觉模仿学习,将策略蒸馏成与真机对齐的RGB策略,实现从仿真到真机的直接迁移。

数据采集:在仿真中运行强化学习策略,记录下上万条成功轨迹:包括渲染的RGB图像、每一时刻的机器人本体感知和关节角度动作。

模型训练:采用流匹配生成模型的学习方法,学习从图像观测和机器人本体感知预测动作。

为缩小仿真到真机的视觉图像差异,训练还使用了预训练的ViT提取图像特征,并在仿真数据收集时充分地进行了域随机化(随机化光照、背景、物体颜色纹理、相机参数等)。

多模态适配:DemoGrasp适配单目/双目、RGB/深度相机等多种相机观测。

实验表明,双目RGB相机组合的效果最佳,能够更好利用纹理和轮廓等信息成功抓取小而薄的物体。

实验结果:仿真和真机双优,全面提升灵巧抓取的泛化性和扩展性

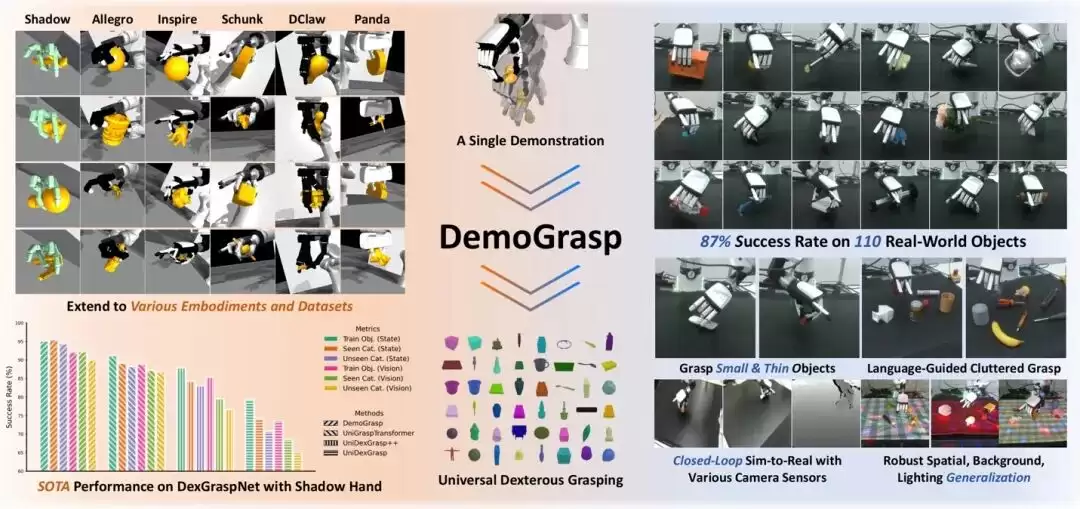

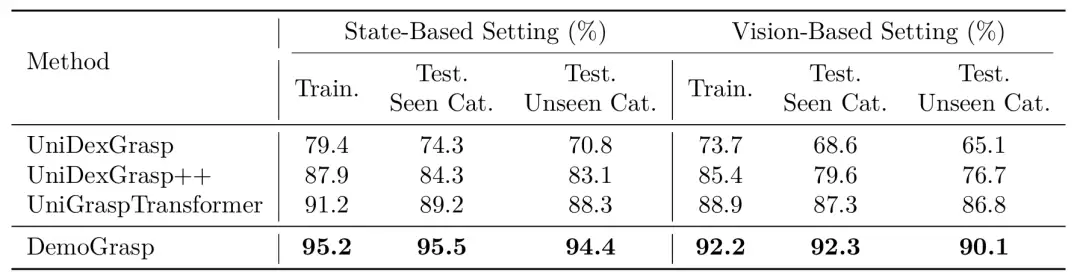

DexGraspNet是灵巧抓取领域的权威数据集(3.4K+物体)。

DemoGrasp在该数据集上使用Shadow Hand抓取,性能显著优于现有方法:视觉策略成功率高达92%,训练集到测试集的泛化差距仅为1%,且适应大范围物体位置随机化(50cm×50cm)、具备更强空间泛化能力。

跨本体扩展:适配任意灵巧手和机械臂本体

DemoGrasp无需调整任何训练超参数,成功适配6种不同形态的灵巧手(五指、四指灵巧手,三指夹爪和平行夹爪等),在175个物体上训练后,在多个未见过的物体数据集上达到了84.6%的平均成功率。

高性能的虚实迁移

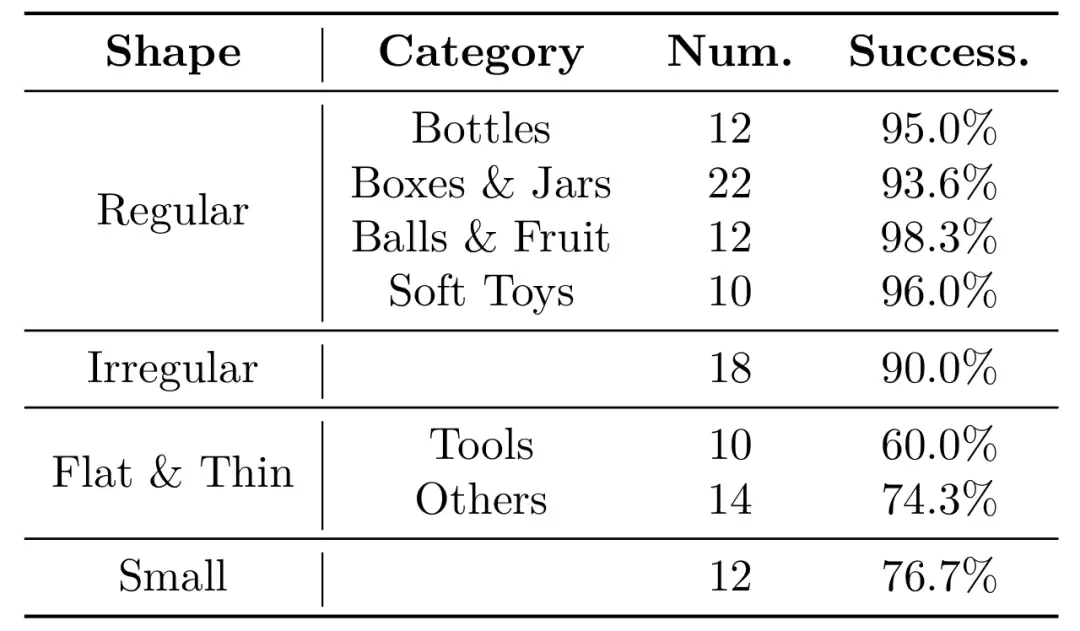

在真实机器人测试中,使用Franka机械臂和因时灵巧手,DemoGrasp成功抓取了110个未见过的物体。

在常规大小物体分类上,DemoGrasp成功率均达到90%以上;

对于扁平物体(手机壳、剪刀等)和小物体(瓶盖、小黄鸭等)这类困难抓取任务,策略能够准确抓取物体、避免碰撞,成功率保持在70%左右。

DemoGrasp框架还展现出对复杂抓取任务的扩展能力,支持在杂乱多物体摆放的场景下实现用语言指令引导抓取,且达到84%的单次抓取成功率。即使面对光照、背景和物体摆放的大幅变化,策略的成功率依然保持稳定。

DemoGrasp开创了融合少量人类演示实现高效机器人强化学习的新路径,将成为未来功能性抓取、工具使用、双手操作等更多灵巧手任务的强大基础。

训练时策略的闭环能力是当前方法的一个局限,后续研究将通过对演示轨迹更细粒度的拆分,增强强化学习策略的实时调整与容错恢复能力。

此外,DemoGrasp可以结合多模态大模型,实现开放场景下的自主抓取智能体。

项目主页:https://beingbeyond.github.io/DemoGrasp/

论文:https://arxiv.org/abs/2509.22149

相关攻略

Excel筛选功能能高效处理海量数据。基础筛选通过列标题下拉菜单勾选或搜索快速定位数据。高级筛选需设置条件区域,可满足多条件复杂查询。FILTER函数能实现动态自动化筛选,结果随数据源同步更新。掌握这些方法可显著提升数据处理效率。

Excel表格可通过多种方法美化以提升可读性。使用内置表格样式可一键快速套用格式;通过设置单元格格式能自定义边框与填充颜色;利用条件格式可根据数据规则自动突出显示特定内容。这些技巧能有效增强数据呈现的清晰度与专业性。

Excel提供了多种批量删除数据的方法。使用Ctrl键配合鼠标可选择不连续区域并右键删除;选中连续区域后按Delete键可快速清空内容。通过“开始”选项卡中的“清除”功能,可同时移除格式与内容。对于复杂任务,可利用VBA宏编写脚本,一键清空所有工作表数据。根据需求选择合适方法能提升效率。

面对表格数据,手动计算易错低效。掌握自动汇总技巧能显著提升效率。常用方法包括:利用筛选功能快速提取和查看特定数据;使用基础的SUM函数进行灵活求和;创建数据透视表进行多维度交互式分析;运用COUNTIF、SUMIF等条件统计函数实现智能计算。根据场景选用合适工具,可使数据处理变得轻松高效。

Excel表格合并有多种方法。复制粘贴适合简单任务;合并计算可汇总多区域数据;PowerQuery能处理复杂合并与数据清洗;CONCATENATE和TEXTJOIN函数专用于合并单元格文本;VBA宏可实现重复任务的自动化。根据数据规模、频率和复杂度选择合适工具,能显著提升数据整理的效率与准确性。

热门专题

热门推荐

公安部就电子数据取证规则公开征求意见,拟将网络安全等行政案件纳入适用范围,并规范取证流程与核心概念。新规特别明确了获取密码、调取通讯内容等特殊程序,需经严格审批并保障当事人权利。配套法律文书也同步优化,以构建更规范且注重权利保障的取证体系。

理想L9和LIvis的定价策略刚掀起波澜,小鹏GX的最终价格就给出了更猛烈的回应——从近40万元的预售价直降至27万元起。用小鹏产品矩阵负责人吴安飞的话说,这叫“9系的产品,8系的价格”。 这12万元的下调,效果堪称立竿见影。发布会次日,小鹏集团港股股价一度大涨超8%。更关键的是市场订单:上市12小

5月21日,环塔拉力赛新疆且末赛段大营迎来了一位备受瞩目的访客——知名零售企业胖东来的创始人于东来。他专程前往长城汽车车队营地,与参赛车手及后勤团队进行了深度交流。据悉,于东来此次自驾越野之旅已历时一月,随行车队中包含多款国产越野车型。经过实地驾驶与多维度对比,他对以长城汽车为代表的国产越野车品质给

比特币官方入口在哪里?一个核心门户的权威指南 说起比特币,很多人第一反应是去找它的“官网”或“官方App”。但这里有个关键点需要先理清:比特币本质上是一种去中心化的全球数字货币,它不属于任何一家公司或机构,而是由一个庞大的、遍布全球的社区共同维护。因此,它并没有传统意义上由某个企业运营的“官方网站”

Ring-2 5-1T是什么 在当今大模型技术激烈竞争的赛道上,追求更长的上下文处理能力和更强大的深度推理性能已成为核心焦点。近日,蚂蚁集团旗下的inclusionAI团队重磅开源了Ring-2 5-1T模型,这是一个参数规模高达万亿级别的混合线性思考大语言模型。该模型基于先进的Ling 2 5架构