【第五期论文复现赛-语义分割】ENCNet

本文作者引入了上下文编码模块(Context Encoding Module),在语义分割任务中利用全局上下文信息来提升语义分割的效果。本次复现赛要求是在Cityscapes验证集上miou为78.55%,本次复现的miou为79.42%,该算法已被PaddleSeg收录。

【论文复现赛】ENCNet:Context Encoding for Semantic Segmentation

本文作者引入了上下文编码模块(Context Encoding Module),在语义分割任务中利用全局上下文信息来提升语义分割的效果。本次复现赛要求是在Cityscapes验证集上miou为78.55%,本次复现的miou为79.42%,该算法已被PaddleSeg收录。一、引言

PSPNet通过SPP(Spatial Pyramid polling)模块得到不同尺寸的特征图,然后将不同尺寸的特征图结合扩大感受野;DeepLab利用ASPP(Atrous Spatial Pyramid Pooling)来扩大感受野。但是ENCNet提出了一个问题:“Is capturing contextual information the same as increasing the receptive field size?”(增加感受野等于捕获上下文信息吗?)。作者提出一个想法:利用图片的上下文信息来减少图片中像素种类的搜索空间。比如一张卧室的图片,那么该图片中有床、椅子等物体的可能性就会比汽车、湖面等其他物体的概率大很多。本文提出了Context Encoding Module和Semantic Encoding Loss(SE-loss)来学习上下文信息。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

二、网络结构

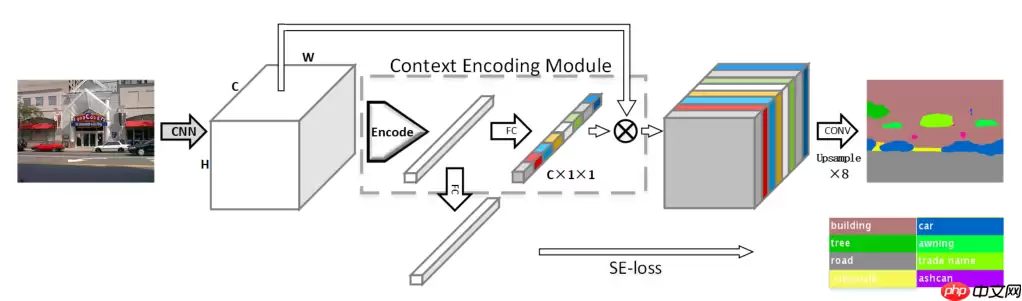

上图为ENCNet的网络结构,主要包括Context Encoding Module, Featuremap Attention和Semantic Encoding Loss。

上图为ENCNet的网络结构,主要包括Context Encoding Module, Featuremap Attention和Semantic Encoding Loss。

Context Encoding Module:该模块对输入的特征图进行编码得到编码后的语义向量(原文中叫做encoded semantics),得到的语义向量有2个用处,第一个是送入Featuremap Attention用作注意力机制的权重,另一个用处是用于计算Semantic Encoding Loss。

Featuremap Attention:该模块使得模型更注重于信息量大的channel特征,抑制不重要的channel特征。例如在一张背景为天空的图片中,存在飞机的可能性就会比汽车的可能性大。

Semantic Encoding Loss:像素级的交叉熵损失函数无法考虑到全局信息,可能会导致小目标无法正常识别,而SELoss可以平等的考虑不同大小的目标。SELoss损失的target是一个(N, NUM_CLASSES)的矩阵,它的构造也很简单,如果图片中存在某种物体,则对应的target的标签就为1。

三、实验结果

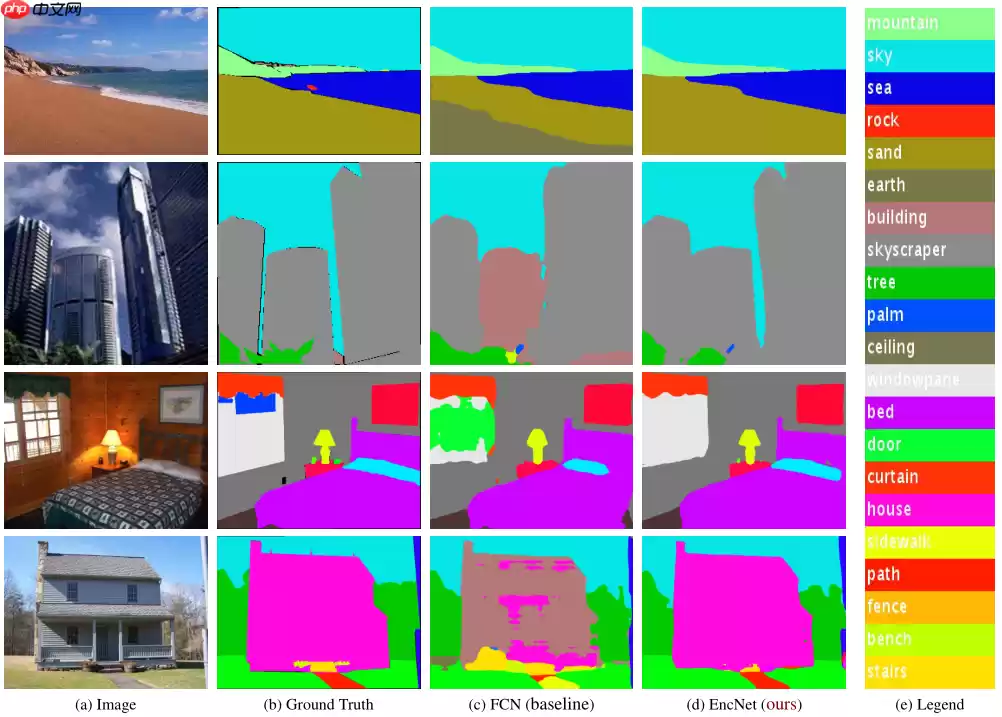

上图为ENCNet在ADE20K数据集的预测结果,与FCN对比,可以看出ENCNet利用全局语义信息的显著优点:

1、第一行图片中,FCN将sand分类成了earth,ENCNet利用了全局信息(海边大概率存在沙)正确分类;

2、第二、四行图片中,FCN很难区分building,house和skyscraper这3类;

3、第三行,FCN将 windowpane分类成door。

四、核心代码

class Encoding(nn.Layer): def __init__(self, channels, num_codes): super().__init__() self.channels, self.num_codes = channels, num_codes std = 1 / ((channels * num_codes) ** 0.5) self.codewords = self.create_parameter( shape=(num_codes, channels), default_initializer=nn.initializer.Uniform(-std, std), ) # 编码 self.scale = self.create_parameter( shape=(num_codes,), default_initializer=nn.initializer.Uniform(-1, 0), ) # 缩放因子 self.channels = channels def scaled_l2(self, x, codewords, scale): num_codes, channels = paddle.shape(codewords) reshaped_scale = scale.reshape([1, 1, num_codes]) expanded_x = paddle.tile(x.unsqueeze(2), [1, 1, num_codes, 1]) reshaped_codewords = codewords.reshape([1, 1, num_codes, channels]) scaled_l2_norm = paddle.multiply(reshaped_scale, (expanded_x - reshaped_codewords).pow(2).sum(axis=3)) return scaled_l2_norm def aggregate(self, assignment_weights, x, codewords): num_codes, channels = paddle.shape(codewords) reshaped_codewords = codewords.reshape([1, 1, num_codes, channels]) expanded_x = paddle.tile(x.unsqueeze(2), [1, 1, num_codes, 1]) encoded_feat = paddle.multiply(assignment_weights.unsqueeze(3), (expanded_x - reshaped_codewords)).sum(axis=1) encoded_feat = paddle.reshape(encoded_feat, [-1, self.num_codes, self.channels]) return encoded_feat def forward(self, x): x_dims = x.ndim assert x_dims == 4, "The dimension of input tensor must equal 4, but got {}.".format(x_dims) assert paddle.shape(x)[1] == self.channels, "Encoding channels error, excepted {} but got {}.".format(self.channels, paddle.shape(x)[1]) batch_size = paddle.shape(x)[0] x = x.reshape([batch_size, self.channels, -1]).transpose([0, 2, 1]) assignment_weights = F.softmax(self.scaled_l2(x, self.codewords, self.scale), axis=2) encoded_feat = self.aggregate(assignment_weights, x, self.codewords) return encoded_feat登录后复制五、ENCNet快速体验

1、解压cityscapes数据集;

2、训练ENCNet,本论文的复现环境是Tesla V100 * 4,想要完整的复现结果请移步脚本任务;

3、验证训练结果,如果想要验证复现的结果,需要下载权重,并放入output/best_model文件夹内(权重超出150MB限制,可以分卷压缩上传)。

# step 1: unzip data%cd ~/data/data64550!tar -xf cityscapes.tar%cd ~/登录后复制In [ ]

# step 2: training%cd ~/ENCNet_paddle/!python train.py --config configs/encnet/encnet_cityscapes_1024x512_80k.yml --num_workers 16 --do_eval --use_vdl --log_iter 20 --save_interval 5000登录后复制In [ ]

# step 3: val%cd ~/ENCNet_paddle/!python val.py --config configs/encnet/encnet_cityscapes_1024x512_80k.yml --model_path output/best_model/model.pdparams登录后复制

六、复现结果

本次复现的目标是Cityscapes 验证集miou 78.55%,复现的为miou 79.42%。

环境:

Tesla V100 *4

PaddlePaddle==2.2.0

相关攻略

配置Python开发环境需遵循标准流程:首先安装Python解释器并设置系统环境变量,随后安装VS Code或PyCharm等集成开发环境并配置Python插件,最后通过运行hello py脚本验证环境是否成功搭建。 准备开始Python编程却遇到代码无法运行?这通常是由于开发环境尚未正确配置。搭建

直接用 nn Transformer 是可行的,但必须自己补全输入预处理、位置编码、掩码逻辑和输出解码——它不包含任何嵌入层或位置编码,也不是开箱即用的“模型”,而是一个纯注意力块堆叠器。 为什么 nn Transformer 不能直接喂原始文本或序列ID? 问题就出在它的设计定位上。nn Tran

处理电子表格时,最让人头疼的莫过于数据录入错误。一个不小心,后续的分析和报表就可能全盘皆错。有没有一种方法,能从源头就“锁死”无效数据呢?当然有,这就是数据验证功能。它允许你为单元格设置规则,限制用户只能输入符合要求的内容。今天,我们就来聊聊如何用Python,为你的Excel工作表穿上这件“防护服

如何在 Python 中利用 enumerate() 在循环中同时获取索引下标和元素值 在 Python 编程中,有一个场景几乎每个开发者都会遇到:遍历一个列表或元组时,不仅需要拿到当前元素,还常常需要知道它所在的位置索引。你猜怎么着?Python 早就为你准备好了优雅的解决方案——内置函数 enu

Python np random randint()参数详解与实战指南 在数据分析、机器学习及日常Python编程中,高效生成随机整数是一项核心技能。NumPy库中的np random randint()函数正是为此而生的强大工具。本文将深入解析其所有参数,并通过丰富的代码示例,助您全面掌握从基础到

热门专题

热门推荐

一场外观绝美、内涵深刻的文化盛宴 灯火璀璨,人声鼎沸,这不仅仅是一个节日,更是一场值得亲身体验的文化盛宴。下面,就让我们一同走进那些精心整理的赞美之词,感受其中的欢愉与深意。 视觉与氛围的华章 当夜幕降临,眼前的景象便如梦似幻。彩色花灯层层叠叠,大小不一,形态各异,点点璀璨仿佛星河坠落人间,灼灼生辉

本站专题“元宵节句子”为你推荐以下内容 年年岁岁,今又元宵。佳节将至,我们特意从浩瀚诗海中撷取了15首经典元宵诗词。愿这些穿越时空的文字,能为你捎去圆圆满满的梦、绵长深厚的爱、舒畅愉悦的心情,以及接下来每一个团圆美满的日子和滚滚而来的好运。 如果说思念有声音,那便是为你吟唱的歌,字字句句皆是珍重;倘

醇香白酒,温暖心灵;团圆时光,倍感幸福。元宵节,美好时刻凝聚家人的情感。 说到元宵节,总绕不开那些温暖人心的祝福与感慨。我们精心整理了一份“元宵节说说”合集,希望能为你的佳节增添几分文采与情意。 元宵节说说(1--22条) 1、元宵节一过,大家的心思往往就转到了健康上,开始琢磨饮食,积极规划起新一年

CoinRoutes接入Uniswap API,为机构投资者打通了一条通往DeFi的便捷路径。这看似简单的技术对接,或许正在悄然重塑整个链上交易的生态格局。 CoinRoutes、Uniswap API 与机构级 DeFi:全新开端 CoinRoutes与Uniswap API的整合,堪称一次里程碑

元宵节的烟花,向来是节日里最动人的风景。它升腾绽放的瞬间,不仅点亮了夜空,更映照出我们对生活的热爱与珍视。这份璀璨的美好,值得与身边人共同分享。为此,我们精心整理了一系列元宵节烟花文案,希望能为你的佳节增添一抹诗意与温情。欢迎阅读、收藏,并传递给那些你所在乎的人。 元宵节的烟花文案(1--18条)