缓存设计模式详解避免性能翻车的核心要点

缓存,在很多人的理解里,就是一个“翻跟斗”——数据慢了,加一层缓存似乎就能解决。但现实往往更骨感:同样是引入缓存,有的系统从此健步如飞,有的却陷入了数据错乱、雪崩甚至更频繁的性能抖动。

问题的根源在于,缓存从来不是一个孤立的“组件”,而是一套完整的系统设计能力。真正拉开差距的,不是你“有没有”用缓存,而是你是否真正理解它在不同场景下的行为边界。很多性能顽疾,本质并非速度不够,而是设计不合理导致的不稳定。只有当你从“加缓存”的思维,转向“设计缓存”的思维,性能问题才能真正变得可控。

这篇文章,我们就来把缓存设计这件事彻底拆解,从模式选择到落地细节,一步步讲清楚。

缓存模式选错,比没有缓存更危险

设计缓存的第一步,往往不是动手写代码,而是选择合适的缓存模式。不同的业务读写场景,对缓存策略的要求天差地别,选错了模式,后果可能比不用缓存更严重。

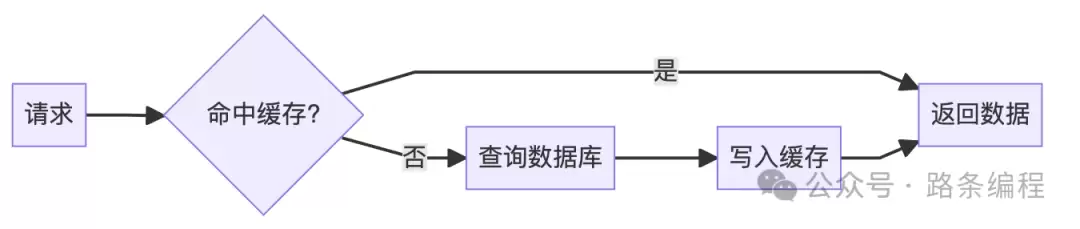

1. Cache-Aside:最常见,也最容易踩坑

package com.icoderoad.cache;

import ja va.util.Map;

import ja va.util.concurrent.ConcurrentHashMap;

class CacheAsideCache {

private final Map cache = new ConcurrentHashMap<>();

private final DataSource dataSource;

public CacheAsideCache(DataSource dataSource) {

this.dataSource = dataSource;

}

public String get(String key) {

// 先查缓存

String value = cache.get(key);

if (value != null) {

return value;

}

// 未命中,从数据源加载

value = dataSource.load(key);

if (value != null) {

cache.put(key, value);

}

return value;

}

} 这种模式的核心特点是:应用程序自己全权负责缓存的读写逻辑。它的优点显而易见——实现简单,足够灵活。但硬币的另一面是,缓存和数据库之间缺乏强约束,数据不一致就成了高悬的达摩克利斯之剑。

典型的问题包括:缓存击穿(热点数据突然失效,所有请求瞬间压垮数据库)、缓存脏读(数据库更新后,缓存未及时清理)。因此,它更适用于读多写少、且能够容忍短暂数据不一致的场景。

2. Write-Through:稳定性的代价是写入变慢

package com.icoderoad.cache;

import ja va.util.Map;

import ja va.util.concurrent.ConcurrentHashMap;

class WriteThroughCache {

private final Map cache = new ConcurrentHashMap<>();

private final DataSource dataSource;

public WriteThroughCache(DataSource dataSource) {

this.dataSource = dataSource;

}

public void put(String key, String value) {

// 同时写缓存和数据库

cache.put(key, value);

dataSource.sa ve(key, value);

}

public String get(String key) {

return cache.get(key);

}

} Write-Through 模式要求所有写操作必须同时成功更新缓存和底层数据库。这么做最大的好处是数据一致性强,几乎可以杜绝脏读问题。但代价也同样明显:每次写入都意味着双倍的操作,写性能自然会下降。这种模式通常在对数据一致性要求极高的业务中采用,比如账户余额、核心订单状态等。

3. Write-Back:追求极致性能,但伴随数据丢失风险

package com.icoderoad.cache;

import ja va.util.Map;

import ja va.util.concurrent.*;

class WriteBackCache {

private final Map cache = new ConcurrentHashMap<>();

private final DataSource dataSource;

private final ScheduledExecutorService scheduler = Executors.newScheduledThreadPool(2);

public void put(String key, String value) {

cache.put(key, value);

// 异步写入数据库

scheduler.schedule(() -> dataSource.sa ve(key, value), 5, TimeUnit.SECONDS);

}

} 与 Write-Through 相反,Write-Back 模式在写入时,数据只进入缓存,数据库的更新则被延迟、异步执行。这带来了极高的写入吞吐量,特别适合秒杀、日志记录这类高并发写入场景。然而,必须清醒认识到一点:一旦系统在数据异步落库前发生崩溃,这部分数据就会永久丢失。因此,它仅适用于能够容忍少量数据丢失的业务,例如操作日志、页面浏览统计等。

缓存模式对比

从上图可以清晰看出,不同模式的本质差异,在于数据流动的路径和一致性控制的切入点不同。没有最好的模式,只有最适合当前业务约束的选择。

缓存不是无限的:淘汰策略决定生死

缓存空间总是有限的,这就引出了一个关键问题:当空间不足时,谁该留下,谁必须被淘汰?不同的淘汰策略,直接决定了缓存的有效性和命中率。

1. LRU:最近最少使用优先

package com.icoderoad.cache;

import ja va.util.LinkedHashMap;

import ja va.util.Map;

class LRUCache extends LinkedHashMap {

private final int maxSize;

public LRUCache(int maxSize) {

super(16, 0.75f, true);

this.maxSize = maxSize;

}

@Override

protected boolean removeEldestEntry(Map.Entry eldest) {

return size() > maxSize;

}

} LRU(Least Recently Used)策略认为,最近被访问过的数据,在短期内再次被访问的概率更高。因此,它会优先淘汰最久未被访问的数据。这非常适用于热点数据分布明显的场景,比如电商的商品详情页、新闻的热点文章等。

2. LFU:访问频率优先

package com.icoderoad.cache;

import ja va.util.HashMap;

import ja va.util.Map;

class LFUCache {

private final Map cache = new HashMap<>();

private final Map frequency = new HashMap<>();

private final int maxSize;

public LFUCache(int maxSize) {

this.maxSize = maxSize;

}

public V get(K key) {

V value = cache.get(key);

if (value != null) {

frequency.put(key, frequency.getOrDefault(key, 0) + 1);

}

return value;

}

public void put(K key, V value) {

if (cache.size() >= maxSize && !cache.containsKey(key)) {

evictLeastFrequent();

}

cache.put(key, value);

frequency.put(key, frequency.getOrDefault(key, 0) + 1);

}

private void evictLeastFrequent() {

// 淘汰最少使用的数据

}

} LFU(Least Frequently Used)策略则更看重历史的累计访问频率。它会淘汰过去一段时间内被访问次数最少的数据。这种策略适合访问模式相对稳定、热点变化不剧烈的系统,例如一些推荐系统的用户画像缓存。

3. TTL:时间驱动失效

package com.icoderoad.cache;

import ja va.util.Map;

import ja va.util.concurrent.ConcurrentHashMap;

class TTLCache {

private final Map> cache = new ConcurrentHashMap<>();

private final long ttlMillis;

private record CacheEntry(V value, long expiryTime) {

boolean isExpired() {

return System.currentTimeMillis() > expiryTime;

}

}

public TTLCache(long ttlMillis) {

this.ttlMillis = ttlMillis;

}

public V get(K key) {

CacheEntry entry = cache.get(key);

if (entry == null || entry.isExpired()) {

cache.remove(key);

return null;

}

return entry.value();

}

public void put(K key, V value) {

long expiryTime = System.currentTimeMillis() + ttlMillis;

cache.put(key, new CacheEntry<>(value, expiryTime));

}

} TTL(Time To Live)策略最为直接:为每条缓存数据设置一个固定的存活时间,到期自动失效。这是一种“以时间换空间”的思路,特别适合缓存那些对实时性要求不高、但需要定期更新的数据,比如配置信息、排行榜快照等。

高并发下的缓存:线程安全不是可选项

当缓存进入高并发环境,线程安全问题会从理论隐患迅速变为线上事故。确保并发安全是缓存设计的底线。

1. ConcurrentHashMap

private final ConcurrentHashMap cache = new ConcurrentHashMap<>(); 这是Ja va中最基础、最常用的线程安全缓存容器,其分段锁机制在大多数读多写少的场景下表现良好,可以作为首选方案。

2. synchronized 包装

private final Map cache =

ja va.util.Collections.synchronizedMap(new ja va.util.HashMap<>()); 通过 `Collections.synchronizedMap` 对普通HashMap进行包装,实现简单粗暴的全局锁。这种方式能保证线程安全,但在高并发竞争下,性能会成为明显的瓶颈。

3. 读写锁优化

package com.icoderoad.cache;

import ja va.util.HashMap;

import ja va.util.Map;

import ja va.util.concurrent.locks.*;

class ReadWriteCache {

private final Map cache = new HashMap<>();

private final ReadWriteLock lock = new ReentrantReadWriteLock();

public V get(K key) {

lock.readLock().lock();

try {

return cache.get(key);

} finally {

lock.readLock().unlock();

}

}

public void put(K key, V value) {

lock.writeLock().lock();

try {

cache.put(key, value);

} finally {

lock.writeLock().unlock();

}

}

} 对于典型的读多写少场景,读写锁(ReadWriteLock)是更优的选择。它允许多个线程同时读,但写操作是独占的。这能在保证数据一致性的前提下,显著提升读操作的并发性能。

分布式缓存:真正的难点才刚开始

单机缓存只是解决了本地问题,一旦系统进入分布式阶段,复杂度会呈指数级增长。这时,缓存设计面临的才是真正的挑战。

1. 缓存失效广播

package com.icoderoad.cache;

class DistributedCache {

private final LocalCache localCache;

public DistributedCache(LocalCache localCache) {

this.localCache = localCache;

}

public void invalidate(String key) {

localCache.remove(key);

notifyOtherNodes(key);

}

private void notifyOtherNodes(String key) {

// 通知其他节点清除缓存

}

}在分布式系统中,一个节点更新了数据,如何让其他所有节点的缓存同步失效或更新?这是分布式缓存的核心问题之一。通常需要借助消息队列(如Kafka、RocketMQ)或专门的分布式协调服务(如ZooKeeper)来实现变更通知。

2. 一致性模型选择

分布式环境下,必须在一致性和性能之间做出艰难取舍:

- 强一致性:保证所有节点在任何时刻读取的数据都是最新的,但通常以高延迟和低可用性为代价。

- 最终一致性:允许数据在短时间内不一致,但保证在一定时间后所有副本达成一致,以此换取更好的性能和可用性。

没有银弹,只有根据业务容忍度来选择的适配方案。

3. 网络开销控制

远程调用是分布式缓存的主要性能开销来源。优化网络开销是设计重点:

- 采用多级缓存架构(如本地缓存 + 分布式缓存),让大部分请求走本地。

- 对热点数据进行主动预热。

- 设计批量操作接口,减少网络往返次数。

生产级缓存实现:不是拼功能,而是拼组合

package com.icoderoad.cache;

import ja va.util.concurrent.ConcurrentHashMap;

class ProductionCache {

private final ConcurrentHashMap> cache = new ConcurrentHashMap<>();

private final int maxSize;

private final long ttlMillis;

private final EvictionStrategy evictionStrategy;

public ProductionCache(int maxSize, long ttlMillis, EvictionStrategy evictionStrategy) {

this.maxSize = maxSize;

this.ttlMillis = ttlMillis;

this.evictionStrategy = evictionStrategy;

}

public V get(K key) {

CacheEntry entry = cache.get(key);

if (entry == null) {

return null;

}

if (entry.isExpired()) {

cache.remove(key);

return null;

}

entry.updateAccessTime();

return entry.value();

}

public void put(K key, V value) {

if (cache.size() >= maxSize && !cache.containsKey(key)) {

evictionStrategy.evict(cache);

}

long expiryTime = System.currentTimeMillis() + ttlMillis;

cache.put(key, new CacheEntry<>(value, expiryTime));

}

} 一个真正能在生产环境扛住压力的缓存系统,从来不是某个单一功能的炫技,而是多种能力的有机组合:

- 缓存模式:决定数据的读写流转路径(Cache-Aside, Write-Through, Write-Back)。

- 淘汰策略:决定数据的去留规则(LRU, LFU, TTL)。

- 并发控制:保证高并发下的数据安全(锁、无锁结构)。

- 分布式一致性方案:解决多节点间的数据同步问题。

将这些维度根据业务场景进行合理搭配,才能构建出健壮的缓存层。

落地经验:缓存设计的核心判断标准

在实际项目中做技术选型时,可以遵循一些清晰的判断路径:

- 读多写少?优先考虑 Cache-Aside。

- 要求强一致性?必须选择 Write-Through。

- 写入压力极大?可以评估 Write-Back(需确认数据丢失风险)。

- 热点数据明显?LRU 通常是好选择。

- 访问频率稳定?LFU 可能效果更佳。

- 数据有自然生命周期?TTL 最直接。

除此之外,还有一些必须持续关注的工程问题:内存使用是否可控?是否存在缓存击穿、雪崩的风险?在分布式场景下,是否需要以及如何实现节点间的缓存同步?

结尾

回过头看,缓存设计的精髓,远不止于在代码里引入一个 `Map` 或 `Redis` 客户端。它本质上是一套权衡的艺术——在性能与一致性、空间与时间、复杂度与可靠性之间,做出最适合当前业务的选择。

很多系统的性能瓶颈,根源并非硬件或算法不够快,而是缓存这一层设计得不够合理,导致了不可预测的抖动和不稳定。当你开始用系统设计的视角,而非简单组装的视角去看待缓存时,才能真正驾驭它,让性能变得可控、可预测。

相关攻略

微软优化Windows11系统性能,推出低延迟配置文件新功能。该功能通过瞬时提升CPU频率,显著加快应用启动和界面响应速度。实测显示,部分应用启动提速40%,菜单弹出速度提升70%。此优化对设备续航和发热影响极小,适用于各类日常任务。具体推送时间待定。

微软正在为Windows11测试一项名为“低延迟配置”的系统级优化功能,旨在显著提升低端硬件设备的操作流畅度。该功能能自动识别用户的高优先级操作,并在1至3秒内将CPU频率瞬间拉满,操作完成后迅速回落。在模拟双核CPU、4GB内存的低端环境实测中,开启功能后,开始菜单、Edge浏览器、Outloo

五一期间,有用户反映因提前一分钟还车,被租车平台收取20元违约金,引发争议。平台解释称,该订单因使用了优惠券,提前还车会导致优惠失效,系统因此追回抵扣费用。平台随后致歉,并宣布已完成系统优化,避免类似情况。同时明确,仅大型节假日可能收取提前还车费,平日则按实际使用时间计费并退还剩余租金。此事凸显了服

极米投影黑屏别慌:这可能是“假故障” 开机,指示灯亮着,但屏幕一片漆黑——不少极米投影仪用户都遇到过这个让人心头一紧的瞬间。不过,先别急着断定是硬件“寿终正寝”。更多时候,这其实是电源、信号、系统乃至散热等环节闹了点“小脾气”,出现了临时性的响应延迟或状态异常。 从官方售后数据和一线维修案例来看,这

三星电视投屏音画不同步?别急,这事儿有解 用三星电视投屏时,手机的声音和画面老是卡不上点?别急着怀疑是电视坏了。这本质上是个技术协调问题——无线传输链路上,音视频解码时序产生了微秒级的偏差。好消息是,这并非硬件缺陷,而是Wi-Fi干扰、协议协商或是音频缓冲策略没跟上投屏特性等多种因素叠加导致的。有数

热门专题

热门推荐

Keychron(渴创)即将发布全新旗舰级机械键盘Z11 Ultra 8K。官方宣布,这款备受期待的“铝坨坨”键盘将于5月13日在全平台正式上市。其核心设计亮点在于采用了创新的平面式分体结构,并基于无Fn区的紧凑型Alice人体工学配列。这种设计旨在显著提升长时间打字或编程的舒适度,通过更符合自然手

针对cookie、session和token的区别问题,提供了多个更口语化且符合搜索习惯的标题优化版本,包括直接提问式、场景式、详解清单式和简单直白式,旨在更直观地突出核心比较信息并控制标题长度。

Arm近期的发展势头持续强劲,在最新公布的2026财年第四季度财报会议中,公司披露了一项关键进展:客户对其首款自研处理器——Arm AGI CPU——在2027至2028财年期间的总需求预估已超过20亿美元。相比今年3月产品发布时的初期预期,这一数字增长超过一倍,反映出市场对Arm自研芯片的高度期待

资本市场对AI硬件的热情,似乎找到了一个新的焦点。路透社昨日援引知情人士消息称,AI芯片新锐Cerebras Systems即将进行的首次公开募股(IPO),获得了投资者的热烈追捧,超额认购倍数已突破20倍。根据资本信息平台Dealogic的数据,这桩IPO有望成为2026年以来全球规模最大的一笔。

加密货币代币主要分为实用型、证券型、支付型、治理型和资产型五大类。其分类依据核心功能与属性,如是否代表资产、提供使用权或参与治理等。区分标准需结合具体设计、经济模型及法律框架综合判断。