DeepSeek终端助手发布 美国开发者打造命令行AI工具

最近在终端编程工具领域,有个项目挺有意思,叫 DeepSeek-TUI。简单来说,你可以把它看作是为 DeepSeek 模型量身打造的“终端版编程智能体”,类似于 Claude Code 或 GPT 的 Codex 这类工具,当然,这个类比只是为了方便理解。

这事儿起因还挺有趣。前两天在社交媒体上,看到一位国外开发者的帖子,内容是关于他开源的一个专为 DeepSeek 设计的终端 Agent。有意思的是,帖子正文是中文,开头一句“鲸鱼兄弟们好”让人忍俊不禁。后来评论区有人指出,这其实是 DeepSeek 模型告诉他中文网络流行这么打招呼,他就信以为真用了。原本他想表达的,大概是“使用 DeepSeek 的兄弟们”。

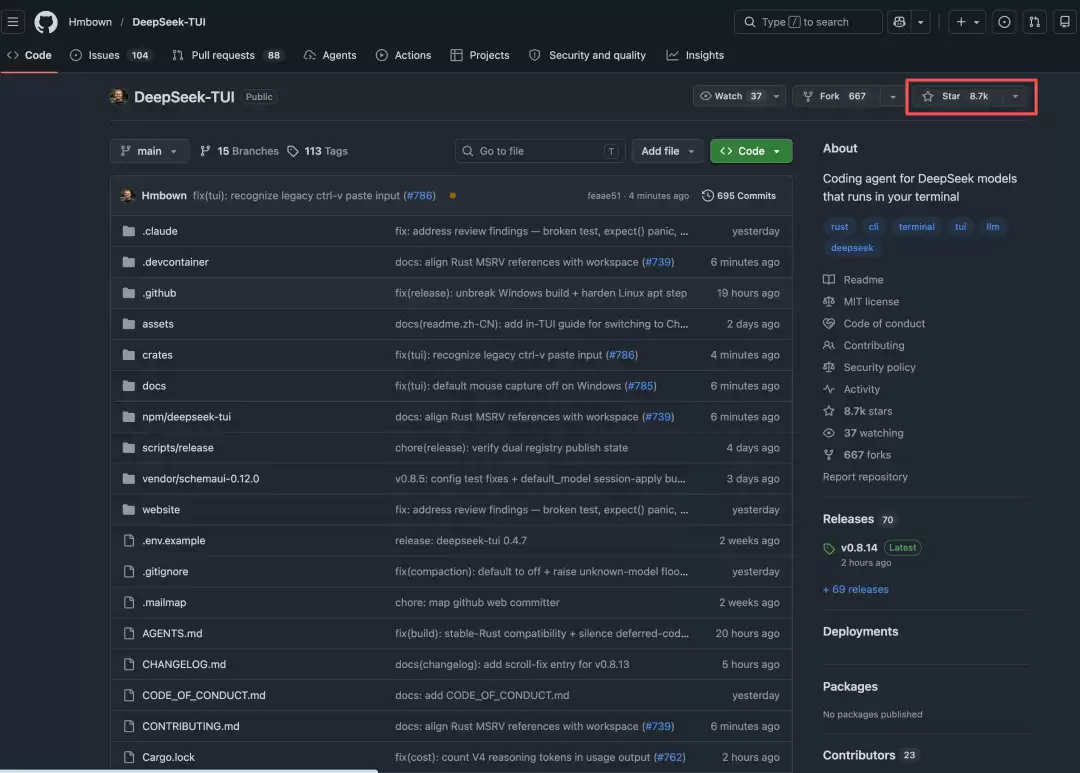

这个小插曲虽然有些幽默,但宣传效果却出奇地好。这位开发者甚至为此注册了微信和QQ,算是以一种特别的方式打入了中文AI开发者社区。目前,这个项目在开源平台上的热度攀升很快,已经接近获得九千个星标,有超过六百个分叉,照这个趋势,破万指日可待。

技术栈方面,项目采用 Rust 语言开发,并且作者明确表示会坚定地走 Rust 技术路线。

这个工具是干什么的

回到工具本身,DeepSeek-TUI 的核心定位是一个运行在终端环境中的编程助手。它深度集成了 DeepSeek V4 模型,旨在成为该模型在终端环境的原生智能体。

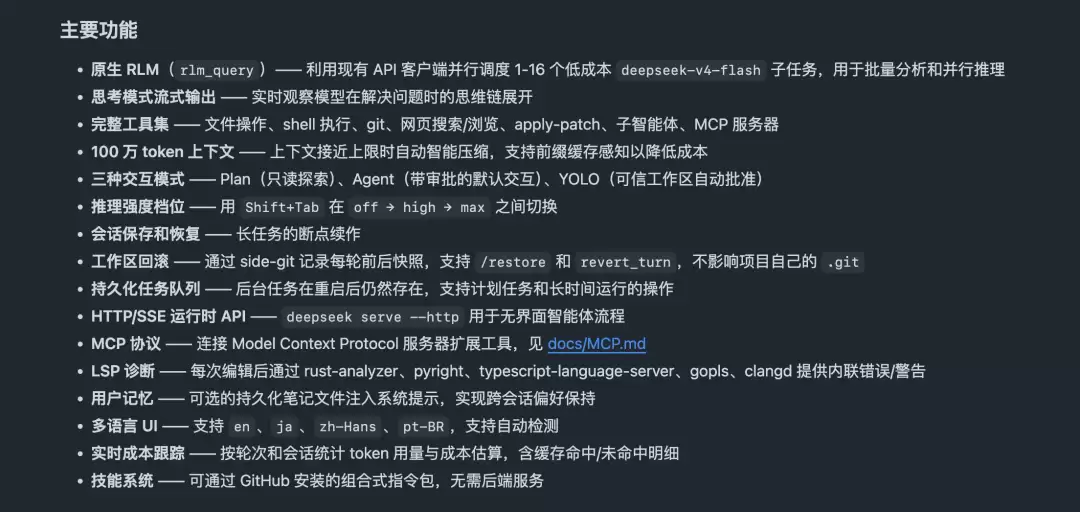

它的能力矩阵相当全面,涵盖了文件读写、执行 Shell 命令、网页搜索、Git 仓库管理、调用模型上下文协议(MCP)、调度子智能体、保存与恢复会话、查看语言服务器协议(LSP)诊断信息等。本质上,它想做的是 Claude Code、Codex CLI、OpenCode 这类工具正在做的事,只是背后的模型引擎换成了 DeepSeek V4。

在亲自体验之前,先看了看项目的议题列表。虽然还有一百多个处于开放状态的问题待解决,其中甚至包括反馈当前效果可能还不及 Claude Code 配合 DeepSeek 模型,但已经关闭的议题超过了四百个,这说明项目维护相当活跃。

这个项目能获得关注,除了那波“意外出圈”的推广,其本身的想象空间是关键。目前市面上,头部模型大多有与之深度绑定的终端工具:Claude 有 Claude Code,GPT 有 Codex,Kimi 也有 Kimi Code。以 Codex 为例,它在调用 GPT 模型时效果最佳,正是因为其在工程层面做了大量针对性适配,包括提示词也都是为 Codex 专门调校的。所以,一个专为 DeepSeek 适配的终端 Agent,确实有可能发挥出“1+1>2”的协同效应。

几个值得关注的功能

DeepSeek-TUI 里集成了一些颇具亮点的功能设计。

首先,它能够利用 DeepSeek 模型原生支持的 128K 上下文长度。大上下文对于理解复杂代码库和进行长对话的重要性不言而喻。

其次,它支持通过 rlm_query 并行调度 1 到 16 个低成本的 deepseek-v4-flash 子任务,用于批量分析和并行推理。这或许才是智能体工具该走的方向——不是把单个模型当作万能的神,而是将不同成本、不同能力、不同上下文窗口的模型进行有效编排和调度。

再者,是它的 side-git 工作区回滚机制。工具会用 side-git 记录每一轮操作前后的快照,支持通过 /restore 和 revert_turn 命令进行回滚,并且不会干扰项目本身的 .git 仓库。对于编程智能体来说,最大的问题有时不是它不会写代码,而是它可能过于“自信”。一不留神,它可能就修改了多个文件,甚至顺手重构了你根本没让它碰的模块。拥有可靠的回滚能力,无疑能给开发者带来更多安全感。

最后,是 LSP 诊断集成。每次代码编辑后,它可以借助 rust-analyzer、pyright、typescript-language-server 等语言服务器来提供内联的错误和警告信息,并将这些诊断结果反馈给模型,纳入后续的决策上下文。

最后

随着用户和贡献者数量的增长,这个项目确实有可能发展成为 DeepSeek 模型在终端环境中最得力的助手工具之一。在AI技术快速迭代的当下,一切皆有可能。

相关攻略

提升DeepSeek回答准确性的关键在于优化提问方式。应使用STAR法则结构化描述问题,明确情境、任务、动作和结果。需主动限定回答边界,如指定角色、信息源和时效,以抑制模型幻觉。遇到错误时可进行精准反向纠错。处理复杂问题时应分步拆解,每一步给出具体约束,以获得扎实可用的答案。

DeepSeek网页版因缺乏文档索引能力,不适合直接构建企业文档检索系统。搭建此类系统需自建核心RAG链路,包括文档加载器、嵌入模型和向量数据库。具体实现可选用LangChain框架整合各模块,并针对扫描件单独进行OCR处理。系统需注意配置细节,如持久化存储和元数据管理,以确保检索结果的可追溯性。

DeepSeek在中文任务上表现出色,这得益于其针对中文的深度适配。模型训练数据主要来自中文互联网,内置中文分词与语义理解模块,能精准把握成语、政策术语及中文表达习惯。其在长文本解析、公文写作、技术文档本地化及口语转书面语等需要高语义精度和强上下文保持的任务上优势突出。使用。

要让DeepSeek生成可直接剪辑的视频脚本,需通过精确提示词强制规定输出结构。必须明确指定分镜编号、画面描述、口播文案和时长等字段的格式,以表格化呈现,时长需精确。口播文案应限定句长并标注停顿,分镜描述需拆解为具体动作指令。批量生成时可使用变量模板和脚本自动化处理,以确保

编写DeepSeek系统提示时,并非越详细越好。模型更倾向于简短、动词开头的指令,长篇提示易被截断或稀释注意力。用户指令的优先级通常高于系统提示。有效的系统提示主要用于锁定输出格式、定义角色行为或过滤干扰,且不应与用户指令矛盾。

热门专题

热门推荐

英伟达Omniverse定位为物理AI操作系统。松应科技推出ORCALab1 0,旨在构建基于国产GPU的物理AI训练体系。针对机器人行业数据成本高、仿真迁移难的问题,平台提出“1:8:1黄金数据合成策略”,并通过高精度仿真提升数据可用性。平台将仿真与训练集成于个人设备,降低开发门槛,核心战略是在英伟达生态垄断下推动国产替。

Concordium是一个注重合规与隐私的区块链平台,其原生代币为CCD。该平台通过内置身份验证机制平衡隐私与监管要求,旨在服务企业级应用。CCD用于支付交易手续费、网络治理及生态内服务结算。其经济模型包含释放与销毁机制,以维持代币价值稳定。项目在合规金融、供应链、数字身份等领域有应用潜力。

上海人工智能实验室联合多家机构发起国产软硬件适配验证计划,致力于打造覆盖AI全流程的验证平台与自主生态社区。该平台旨在解决国产算力与应用协同难题,构建从芯片到应用的全链路验证体系,支持多种软硬件适配,推动国产AI技术向“好用、易用”发展。商汤科技依托AI大装置深度参与,已。

具身智能行业资本火热,但曾估值超200亿元的达闼科技迅速崩塌。其失败主因在于创始人黄晓庆以通信行业思维经营机器人业务,过度依赖政商关系与资本运作,技术产品突破有限;同时股权结构复杂分散,倚重政府基金,最终因融资断档与商业化不足导致团队离散。这折射出第一代创业者跨。

TurboQuant论文被质疑弱化与RaBitQ的关联,并存在理论比较与实验公平性问题。谷歌借助平台影响力将其定义为突破性成果,凸显了大厂在学术生态中的结构性优势。类似争议在伦理AI、芯片等领域亦有体现,反映了产业界将利益嵌入研究流程的机制。当前AI研究日益由大厂主导,其通过资本、渠道与话语权塑造。