斯坦福团队新作让Llama1B实现毫秒级推理获Karpathy盛赞

在实时对话、人机交互等对AI响应速度要求极高的应用场景中,大语言模型的推理延迟哪怕只减少几毫秒,用户体验都可能产生质的飞跃。近期,斯坦福大学Hazy Research团队取得了一项突破性优化成果,将开源小模型Llama-3.2-1B的前向推理延迟推向了新的极限——他们通过将所有计算融合进一个名为“Megakernel”的单一CUDA核心中,实现了接近硬件理论极限的极致性能。

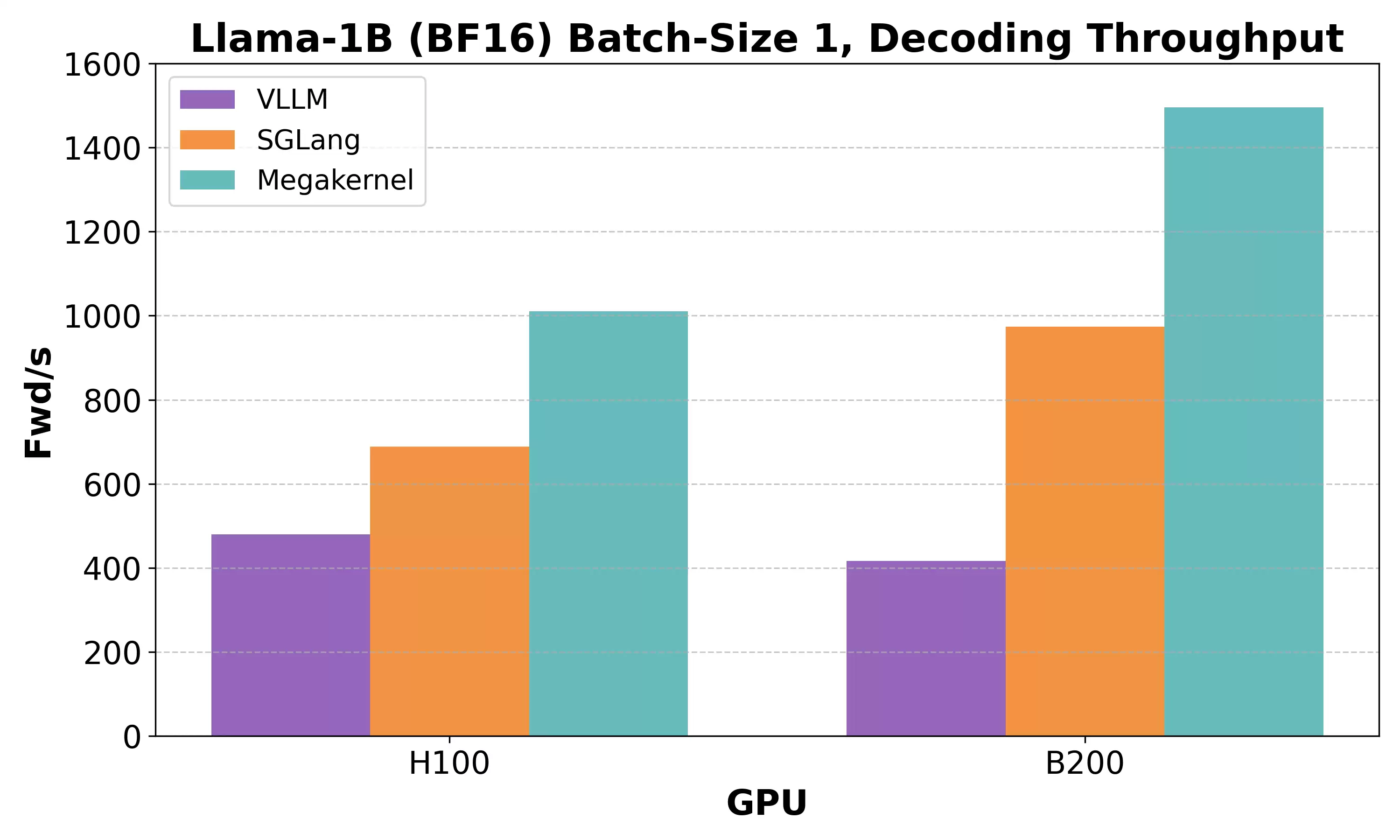

这项研究的动机非常明确:团队发现,当前主流的AI推理引擎在处理极低延迟的单序列生成任务时,效率并不理想。即使在H100这样的顶级GPU上,像vLLM、SGLang这样的先进系统,其显存带宽利用率也常常低于50%。瓶颈究竟在哪里?问题并非出在计算能力上,而在于“等待”造成的资源闲置。

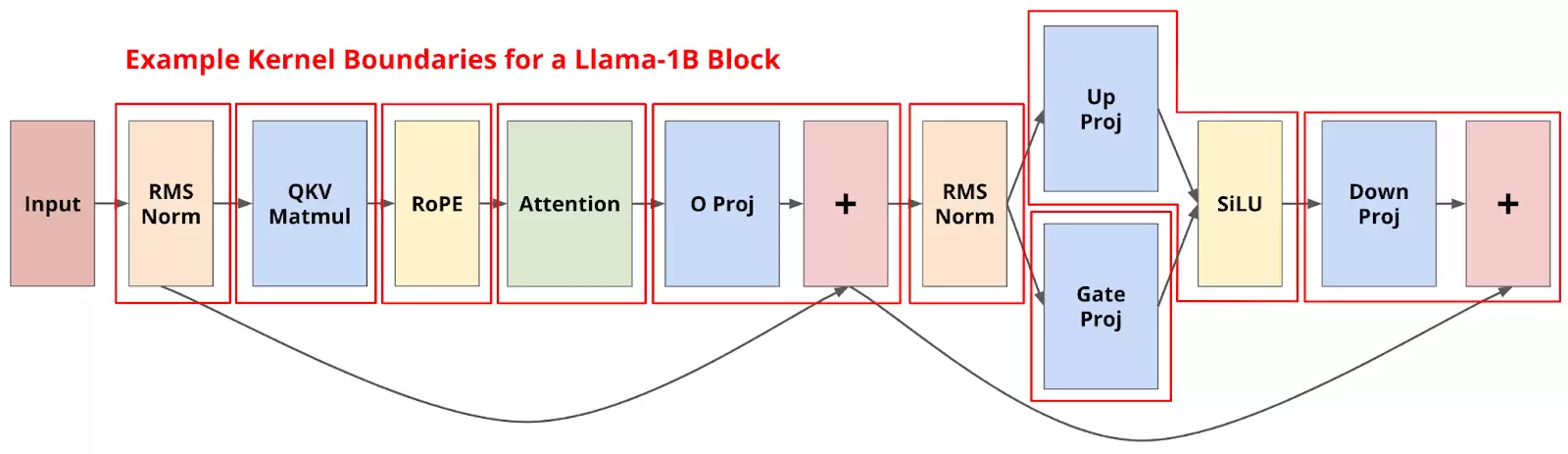

传统方法通常将Transformer模型的每一层分解为几十甚至上百个细小的CUDA内核,分别处理RMSNorm、注意力机制、MLP等操作。这种“微内核”架构虽然模块化清晰,却引入了大量的上下文切换和内核启动开销。更重要的是,在生成单个token的短时任务中,这些内核必须排队执行,后续计算无法提前预加载数据,导致GPU对显存的访问断断续续。大量时间被耗费在“空转”和“等待指令”上,而非用于实际运算,严重拖累了整体效率。

Megakernel:从零设计的深度融合方案

那么,Hazy团队提出的Megakernel方案效果究竟如何?数据给出了有力的证明。在H100 GPU上,他们的Megakernel将推理延迟压缩到了1毫秒以内,显存带宽利用率飙升至78%,相比vLLM提升了2.5倍,相比SGLang也提升了1.5倍。而在更先进的B200平台上,延迟进一步被压低至600到680微秒,几乎触及了硬件理论性能的天花板。

从一次完整推理的时间分解来看,核心计算(如矩阵-向量乘法)仅占约200微秒,而数据加载与同步等“后勤”开销被控制得极低。可以说,通过精密的指令调度与融合,Megakernel几乎榨干了硬件的每一分潜力。

能达到如此惊人的效果,核心在于一个激进的设计理念:彻底抛弃传统的多内核协作模式,将整个模型的前向传播过程,从头到尾整合进一个巨大的、单一的CUDA内核中。

具体是如何实现的?团队基于已有的ThunderMLA架构,开发了一个在GPU上运行的轻量级“指令解释器”。该系统会为每个流式多处理器预先分配一份“执行计划”,计划中按顺序排列着代表Transformer各结构单元的复合指令,例如融合了RMSNorm、QKV投影和RoPE编码的指令,或是专门处理注意力与MLP的指令。

每一条指令都基于统一的模板构建,标准化了数据加载、计算和存储的流程。指令之间的依赖关系在运行前就由解释器静态分析并安排好,完全避免了运行时动态判断的开销。为了进一步提升效率,团队还对GPU的共享内存进行了精细的分页管理,确保不同计算阶段能够无缝衔接,下一个阶段可以尽早预加载权重数据,从而彻底消除了计算流水线中的“气泡”(空闲期)。

当然,将所有计算塞进一个内核也带来了新的挑战——传统的、隐式的内核间同步机制失效了。为此,团队引入了一套基于全局内存的计数器系统。每条指令执行完毕后,会对相应的计数器进行原子加一操作;如果某条指令需要等待前序步骤的结果,它会持续“监听”对应的计数器,直到数值达到预设条件才会开始执行。这种显式的、细粒度的依赖控制机制,避免了粗粒度的全局屏障,使得计算能够最大限度地并发进行。

研究过程中还揭示了一些有趣的发现。例如,即便在“已通过”的状态下,CUDA的异步屏障操作本身也有约60纳秒的固有开销,这在追求纳秒级优化的极致场景下不可忽视。此外,在关键的计算操作上,硬件架构差异的影响非常显著:在Hopper(H100)架构上,使用常规CUDA核心进行矩阵-向量乘法反而比使用专用的张量核心更高效;而在更新的Blackwell架构上,张量核心则重新占据了优势。这提醒我们,极致的性能优化需要针对特定的硬件微架构进行深度定制。

传统推理方式效率低下的根源剖析

在构建Megakernel之前,Hazy团队首先系统地剖析了现有方案为何在低延迟场景下“失灵”。结论指向一个系统性的根本问题:过度分解与模块化。

像vLLM和SGLang这样的系统,其设计初衷是为了追求灵活性和通用性,因此将模型前向过程拆分成大量细粒度的内核。这好比将一项复杂工作分配给几十名工人,每人只负责一道极其简单的工序。然而,在只需要生产一个“产品”(即生成一个token)的情况下,频繁的工人交接、任务派发(即内核启动与上下文切换)所花费的时间,反而远远超过了实际干活的时间。

每个内核启动都有其固定的开销,即便利用CUDA Graph等技术进行优化,也仍需1.3到2.1微秒。在这段时间里,GPU的强大计算单元处于等待状态。更为严重的是,这种串行执行模式导致数据加载无法实现流水线化。GPU计算完一个内核后,必须等待下一个内核启动,才能去加载新的权重和数据,这使得高带宽的显存在长时间内处于闲置状态,利用率自然低下。

这就形成了所谓的“内存-计算流水线气泡”:计算单元和内存控制器都无法持续饱和工作,而是在忙碌与等待之间反复切换,资源无法被充分利用。举例来说,从纯理论带宽计算,H100处理一次Llama-1B模型的前向传播可能非常快,但由于需要经历上百个内核的串行执行,每个内核带来的微小延迟累积起来,就会将实际性能拖慢数倍之多。

因此,问题的根源并非某个单一内核不够快,而是这种“微内核”架构本身在低延迟、单序列场景下,带来了无法通过局部优化消除的系统性开销。Hazy团队的思路清晰而彻底:要打破性能瓶颈,就必须从根本上重构执行模型,减少甚至消除内核间的边界,让GPU能够像处理一个连续任务一样流畅地工作。这正是Megakernel设计哲学的核心——用全局的、深度融合的视角,取代局部的、割裂的优化,从而实现AI推理延迟的极限压缩。

相关攻略

2026年,AI大模型的规模化应用与商业落地已成为产业发展的核心议题。然而,在广泛的概念验证与试点项目背后,一个关键挑战日益凸显:众多企业正陷入“试点陷阱”——尽管前期验证成果显著,却难以将AI能力转化为可规模化复制、持续产生商业价值的核心生产力。深入剖析其根源,核心矛盾在于人才供给的结构性失衡。当

福特汽车因布局储能业务,股价两日飙升约21%,创近六年最佳表现。这显示传统制造业正通过涉足人工智能与能源转型获得资本市场重估,其估值逻辑随业务拓展而更新,反映出市场对产业跨界转型的积极预期。

在数据驱动决策的今天,数据可视化已从辅助工具升级为传递洞察、支撑观点的关键手段。一幅专业的数据图表能迅速解码复杂信息,而一个存在设计缺陷的图表则可能让数据故事彻底失效。本文将深入剖析六个常见却致命的图表设计细节,帮助您避开陷阱,提升图表的专业性与沟通力。 一、饼图顺序混乱,重点模糊 饼图的核心价值在

腾讯云开源了TencentDBAgentMemory分层记忆引擎,采用MIT协议。该引擎通过“上下文卸载”和“Mermaid任务画布”两项核心技术,在多任务连续会话中最高可降低61 38%的Token消耗,并将任务成功率相对提升51 52%。它解决了长周期任务中记忆跨会话断裂、事实与偏好混淆以及上下文膨胀三大痛点。项目已适配主流Agent框架,支持一键集成与

SAP推出统一AI平台,整合业务技术、数据云与AI能力,为企业提供集成底座。同时发布自动化套件,通过超50个AI助手调度近200个智能体,驱动业务流程自动化。平台基于近期收购的数据管理公司构建,并与多家云服务商合作,确保AI结果准确合规,以提升效率、节约成本。

热门专题

热门推荐

近日,中国汽车流通协会联合精真估发布了《2026年4月纯电动车型一年车龄保值率排行榜》。这份数据对于正在选购新能源车的消费者具有重要参考价值,能帮助大家更清晰地了解当前热门电动车的残值表现。 该榜单统计的是车龄满一年的纯电动车型。位居榜首的是问界M9,其一年保值率高达80 4%。这一夺冠成绩含金量十

科技行业近期迎来一场备受瞩目的创新盛宴。以智能清洁机器人闻名的追觅科技(Dreame),在旧金山隆重举办了“Dreame Next 2026”未来愿景发布会。活动不仅前瞻性地展示了涵盖智能手机、智能穿戴乃至概念电动车的全系列产品,更邀请到苹果联合创始人史蒂夫·沃兹尼亚克亲临助阵。这场为期四天的盛会,

SpaceX最快下周披露招股书,6月初启动全球路演,估值或达1 75万亿美元,募资规模有望创纪录。公司以垂直整合与成本控制为核心优势,布局商业航天、AI基础设施与卫星互联网,其“太空数据中心”构想融合太空太阳能与AI算力,开辟新赛道。此次IPO或引发科技板块资金结构性变动,标志资本正加速拥抱太空与AI融。

NVIDIA在SIGGRAPH上宣布扩展其微服务库,以加速人形机器人开发。其核心是将生成式AI深度集成至OpenUSD语言体系,推出相关模型与NIM微服务,从而提升数字孪生与机器人工作流效率。公司还开放了机器人技术栈,并联合合作伙伴推动OpenUSD的工业应用,为开发者提供从仿真到部署的端到端平台支持。

OKX作为全球领先的数字资产交易平台,其风险主要来源于市场波动、技术安全与合规环境。平台通过多重安全机制、资产储备证明和严格的合规流程来管理风险。用户需理解加密货币的高波动性本质,并采取自主保管资产、启用安全功能等策略,以在参与Web3生态时更好地保护自身权益。