Hermes团队预训练优化:算力成本降低60%,DeepSeek后效率提升新方案

提升模型能力是持续的目标,但无节制地增加训练成本已难以为继——这已成为AI领域最广泛的共识之一。

无论是模型开发者还是企业,关注的重点已从单纯的“模型性能比拼”转向更实际的问题:“在相同的GPU资源与训练周期内,能否进行更多有效实验,处理更多高质量数据,最终获得更低的损失值与更优的下游任务表现?”

因Hermes Agent(在GitHub上星标数超14万)而备受瞩目的Nous Research团队,近期提出了一种名为“Token Superposition Training”(TST,词元叠加训练)的创新方法。该方法目标清晰:有望将大语言模型的预训练成本降低一个数量级。

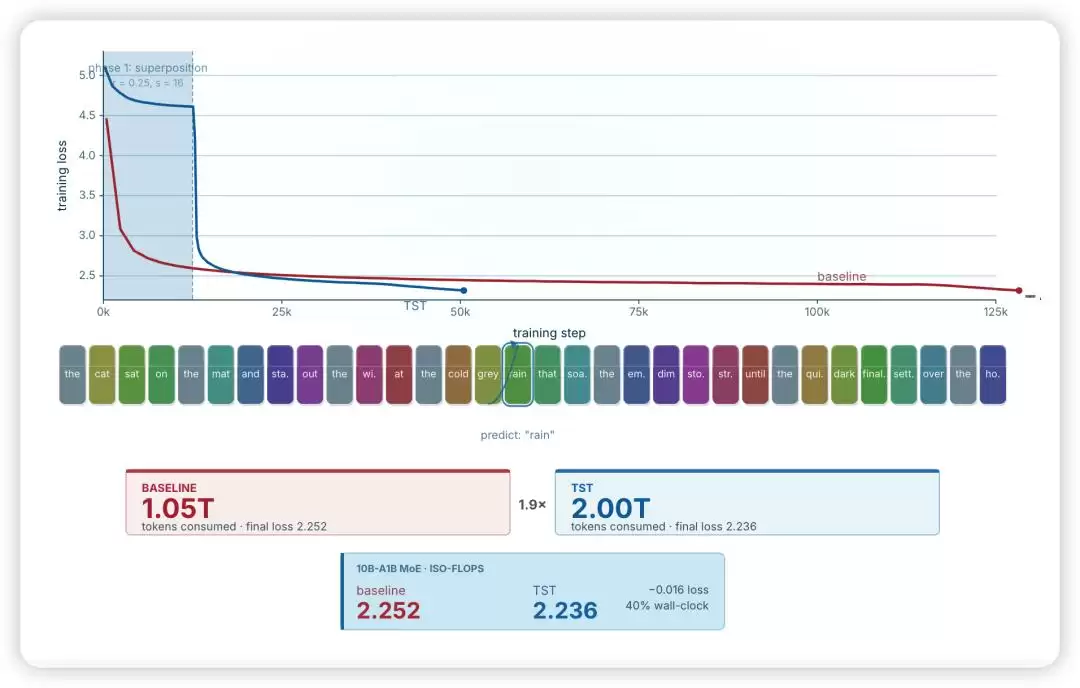

相关研究论文《Efficient Pre-Training with Token Superposition》已在arXiv发布,其中关于百亿参数MoE模型的实验结果尤其令人印象深刻。

- 基线模型训练了1.05万亿个词元,消耗了12311个B200 GPU小时。

- 采用TST方法的模型,训练了2万亿个词元,仅消耗了4768个B200 GPU小时,约为基线模型的38.7%。

- 与此同时,最终损失值从2.252降至2.236,在HellaSwag、ARC-E、ARC-C、MMLU等零样本评测基准上,性能也获得了同步提升。

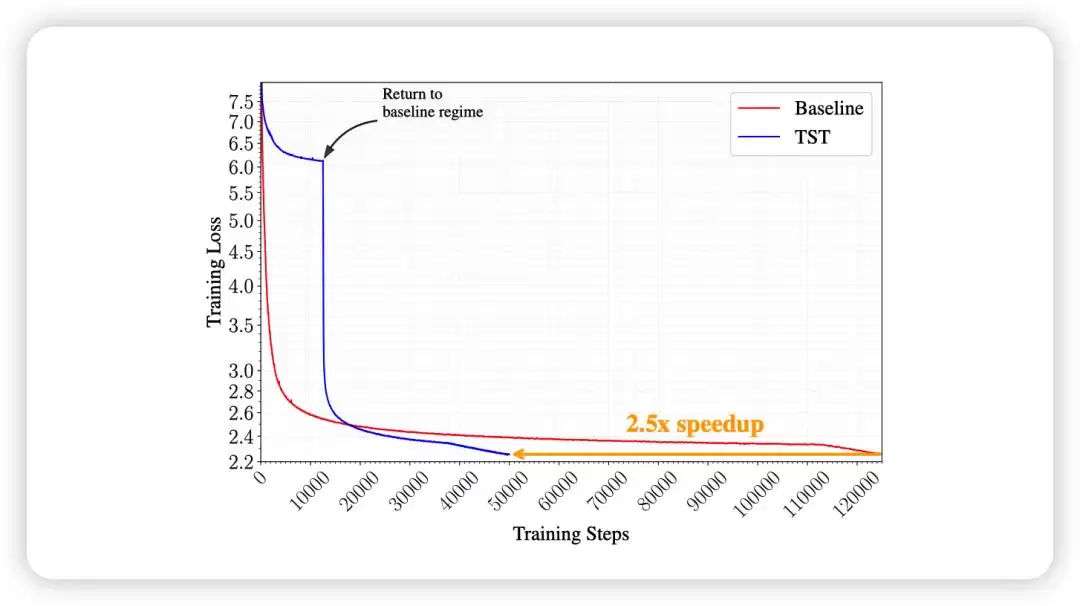

这意味着什么?TST方法仅使用了约四成的GPU时间,不仅达成了更低的损失值,还取得了更好的下游任务性能。换算下来,在达到相同最终损失值的前提下,预训练时间被压缩至原来的40%左右,效率提升约2.5倍。

如果说,此前在OpenRouter排行榜上超越Claude 3.5 Sonnet的Hermes Agent,展现了Nous Research团队在模型调优与智能体(Agent)技术上的深厚功底;那么此次提出的TST方法,则将焦点从“如何应用模型”拉回到了能力构建的源头,直指预训练过程本身的效率优化。

业界常将Nous Research与DeepSeek进行比较,不仅因为两者都长期致力于开源,更因为它们在降低训练成本的技术路径上选择了不同的方向。

DeepSeek代表的是系统级重构路线,无论是MoE架构、MLA注意力机制,还是各类稀疏化与并行优化技术,其核心都是通过底层工程创新来极致压榨算力效率。这种提升往往伴随着较高的工程复杂度。

而Nous Research的TST,则选择了重塑模型在预训练早期的学习路径。它不改变模型架构本身,而是从模型学习词元的方式入手,切入点更为轻巧,理论上也更容易集成到现有的训练流程中。

TST方法解析:先“粗读”把握全局,再“精读”完善细节

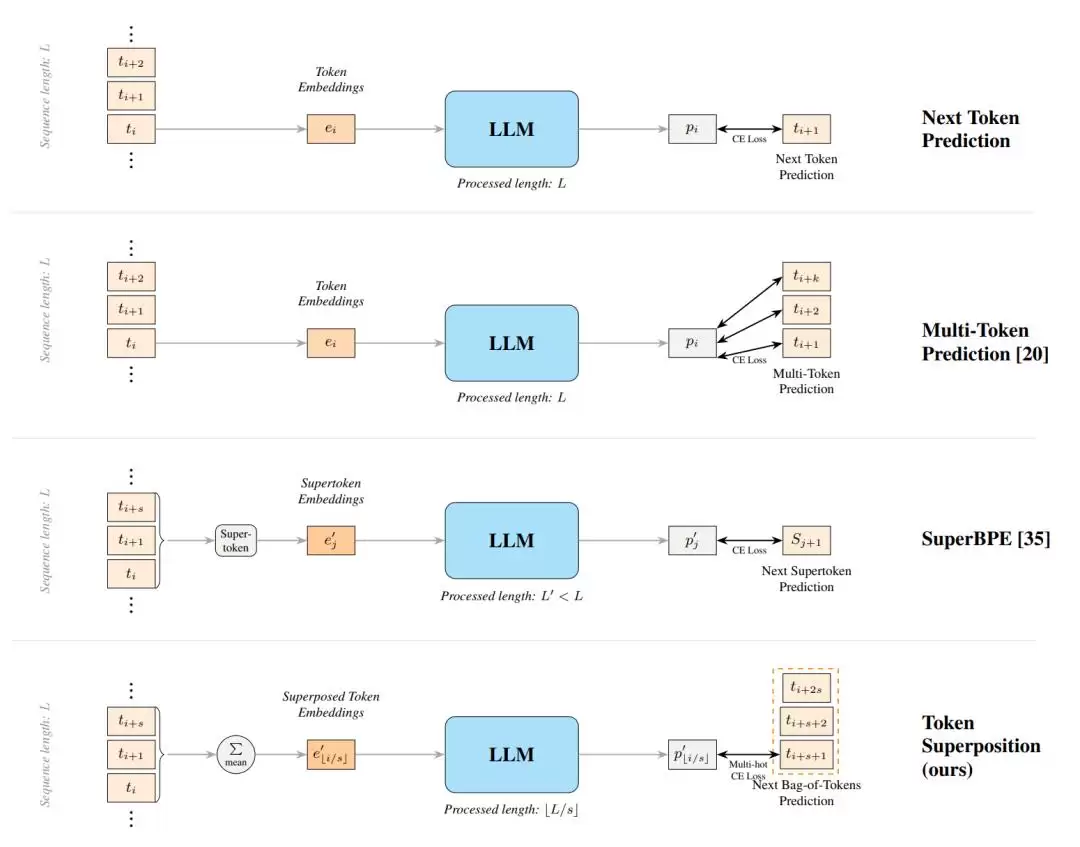

要理解TST,需从预训练最基础的任务——下一个词元预测说起。

在标准训练中,模型根据已见的词元序列预测紧随其后的下一个词元。这一机制简洁而强大,过去几年绝大多数主流大语言模型都基于此范式构建。

但TST提出了一个根本性质疑:在预训练的初始阶段,模型真的有必要逐词元地进行“精读”吗?

Nous Research的答案是否定的。他们将预训练过程拆解为两个阶段。

第一阶段称为“叠加阶段”。在训练前期,模型不再逐个处理词元,而是将连续多个词元打包成一个“袋”。例如,当袋大小为8时,便将连续的8个词元视为一组。

在输入侧,模型会将这一组词元的向量表示进行平均,压缩成一个单一的“叠加词元”。在输出侧,模型的预测目标也随之改变:不再是预测下一个具体词元,而是预测接下来这一组词元中可能出现的词元集合(一个多标签分类问题)。

第二阶段则是“恢复阶段”。当训练进行到一定比例(例如总步数的20%-40%)后,TST机制被移除,模型切换回标准的“下一个词元预测”训练。也就是说,训练的后半程完全按照传统大语言模型的方式进行,目的是将前期“粗粒度学习”获得的语义表示,精细化为具备流畅生成能力的自回归模型。

论文将TST描述为一种“即插即用”的预训练方法,其关键就在于此:它无需修改并行策略、优化器、分词器、训练数据或最终的模型架构。真正改变的,仅是训练早期输入数据的粒度以及监督学习的目标。

这也使其与许多训练效率提升方案区别开来:TST只改变训练过程,不改变最终的推理模型。许多涉及训练端优化的方法,往往会牵连推理部署。例如,更换分词器会影响整个生态的兼容性;修改模型结构则需要重新适配部署链路。而TST巧妙地将复杂度留在了训练阶段,最终交付的仍然是一个标准的、可直接部署使用的自回归语言模型。

当然,全程使用TST训练是不可行的。论文明确指出,如果模型自始至终都使用TST,它会输出多个未来词元的混合概率,导致生成结果混乱。因此,后期切换回标准自回归训练是必不可少的步骤。

这也就解释了,为什么TST更适合被理解为一种“阶段化的训练策略”,而非对“下一个词元预测”范式的彻底替代。

简而言之,TST所做的事情,类似于让模型在预训练早期先进行“粗读”:快速掌握局部语义、词汇共现和粗粒度的概率分布。待模型建立起基础的语言表示之后,再切换至“精读”模式,通过标准的逐词元训练来完善精确的文本生成能力。

TST为何能节省GPU资源?关键在于每一步处理更多文本

TST带来的提速效果有其内在逻辑,核心是一种资源上的权衡:以更粗糙的词元表示为代价,换取更高的数据吞吐量。

这里的数据吞吐量,对应论文中的“单位浮点运算所能处理的原始文本量”。通俗地说,并非GPU算力突然增强,而是在进行同样一次前向计算时,模型能“消化”的文本内容变多了。

在标准训练中,模型序列的每个位置处理一个词元。假设序列长度为L,Transformer就需要处理L个向量表示。

但在TST的叠加阶段,连续的s个词元被合并为一个叠加词元。此时,模型内部需要处理的序列长度缩短了,但每个位置所承载的原始文本信息量却变成了原来的s倍。因为模型是在更粗粒度的表示上进行计算,所以在消耗相同计算资源的前提下,它可以处理s倍数量的原始数据词元。

传统的预训练好比逐字精读,而TST的早期训练则像是先快速浏览以抓住段落主旨和关键词。这种“粗读”当然有其代价——它会丢失“袋”内词元的顺序信息,因此不能全程使用。但在模型刚刚接触语言统计规律的初期,这种低分辨率的输入反而足够高效。

论文将此定义为一种“由粗到细”的策略:先让模型在简单、高吞吐的设置下学习粗粒度的统计结构,再恢复全分辨率的语言建模精度。

这与当前主流的其他效率提升路线形成了鲜明对比:MoE是让每个词元只激活部分参数;稀疏注意力是让每个词元只关注部分位置;多词元预测是让每个位置同时预测多个未来词元;而TST,则是让模型在训练早期换一种粒度来学习词元。

它并非直接缩小模型体积或加速推理,而是让预训练早期的每一步计算都变得更具“性价比”。

这一点对模型开发者至关重要。预训练从来不是一蹴而就,而是一个不断试错、调整数据配方和超参数的过程。早期训练越快进入有效区间,就意味着关于数据混合策略、超参数设置等关键实验能越早得到验证。

本质上,TST节省的不仅是一次成功训练所消耗的GPU小时,更是整个研发周期中宝贵的试错成本与时间。

百亿参数模型获益最大

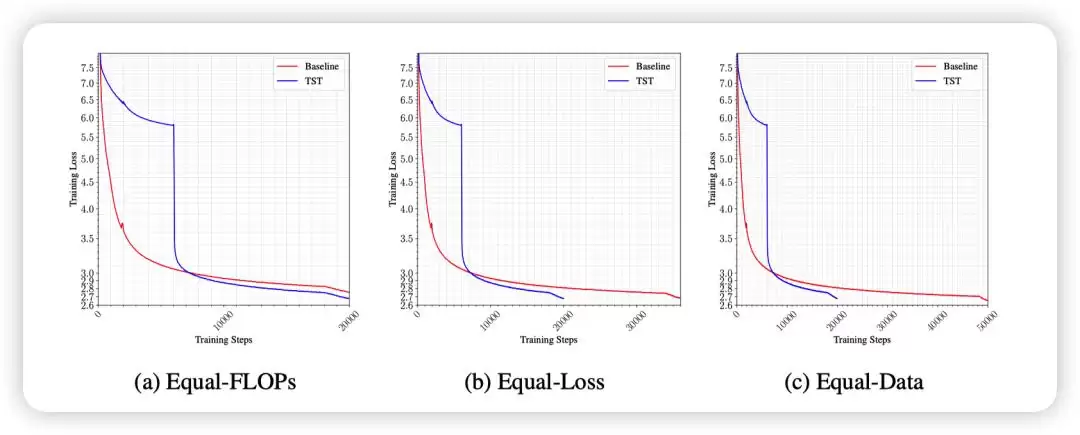

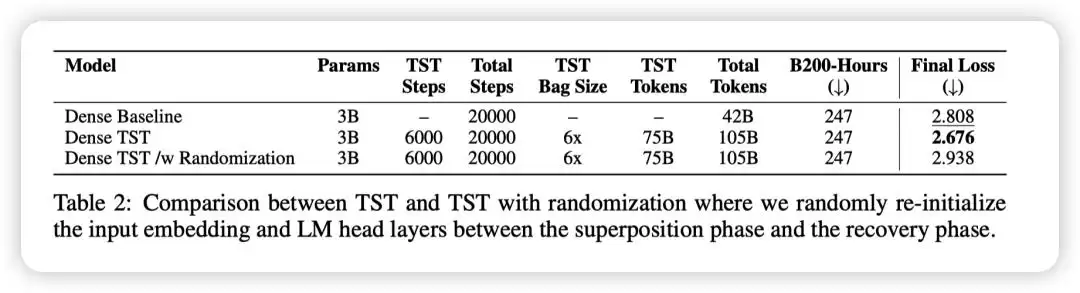

论文的实验验证并未局限于小模型,而是在270M、600M、3B的稠密模型,以及一个总参数量约100亿、每词元激活参数量约10亿的MoE模型上进行了全面测试。这个百亿级MoE模型,正是开篇提到的、收益最为显著的案例。

实验数据表明,TST方法处理了更多的数据词元,但却以更少的GPU时间达到了更优的结果。在达到相同损失值的条件下,TST实现了约2.5倍的训练效率提升。

这个数字足以让任何进行大规模预训练的团队感到兴奋。因为在模型研发中,成本最高的往往不是那一次最终成功的训练,而是成功之前所有的探索和试错。单次实验就能节省一半以上的GPU时间,意味着在同等预算下,可以尝试更多组数据配方、调试更多轮超参数、验证更多模型尺寸的可行性。

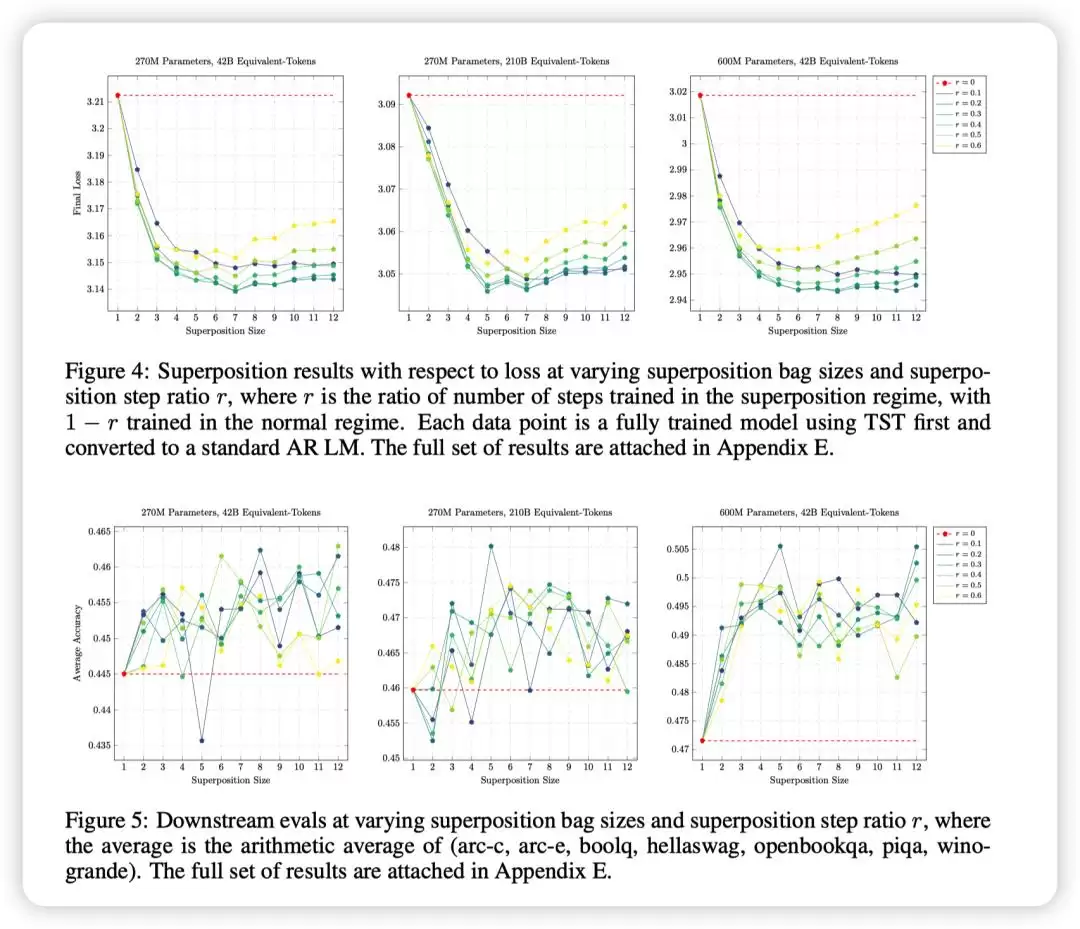

论文还进行了多组超参数扫描实验,观察不同“袋”大小和叠加阶段训练步数比例的影响。结论是,在合理范围内,TST对超参数的选择相对稳健:袋大小在4到8之间,叠加训练步数比例在0.2到0.4时,通常能取得较好的效果。

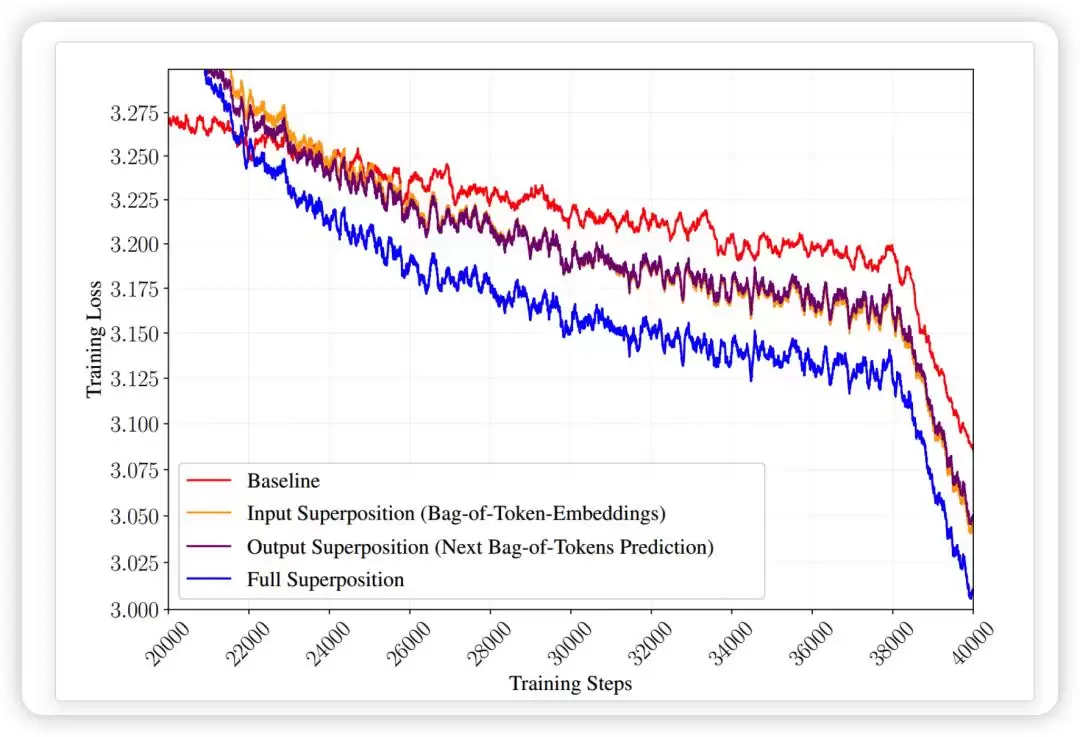

此外,TST的收益并非单一机制所致。论文通过消融实验发现,单独使用输入侧的“叠加”或输出侧的“多标签预测”,都能优于基线,但两者结合(即完整的TST)效果最佳。这表明,TST是两个机制的协同作用:输入侧改变了信息粒度,降低了单位信息的计算成本;输出侧改变了预测目标,提供了更密集的监督信号。

这套机制的启发在于,输入侧在训练早期赋予了模型一个低分辨率视野,让它以更低成本接触更多文本;输出侧则像是将监督问题从“下一个词是什么”改成了“接下来这一小段大概会包含哪些词”。前者提高了数据吞吐效率,后者提升了学习效率。

这也正是TST与单纯的多词元预测技术在本质上的不同。后者是在同一位置额外预测多个未来词元;而TST则是同时改变了输入和输出的粒度。一个是增加了监督任务的数量,另一个是改变了学习任务的分辨率。

训练降本新思路:聚焦学习路径优化

TST最值得深思之处,不在于其设计了多么复杂的架构,而在于它揭示了一个趋势:训练降本增效,未必总要针对模型结构进行大刀阔斧的改动。

过去一提到降低成本,行业本能反应往往是增加算力、修改架构、优化并行、进行知识蒸馏。这些都是系统级的“重体力活”,没有雄厚工程实力的团队很难承接。但TST提供了一个轻量得多的切入点:仅调整预训练早期的学习路径和训练目标。

这意味着什么?对于广大开发者而言,在同样规模的GPU预算下,可以进行更多轮的实验;对于专注于1B到10B参数规模的垂直领域模型团队来说,试错成本有望显著下降。这比盲目追逐前沿的千亿参数模型,要务实和可行得多。

当然,TST也并非免费的午餐。它本质上是“用数据吞吐量置换GPU计算时间”。对于算力紧张但拥有高质量数据集的团队,这无疑是一剂良方。反之,如果团队连足够的高质量数据都难以获取,那么TST不仅帮不上忙,甚至可能因为需要消耗更多数据而放大数据短板。

但这并不影响其方向性的价值。TST将一个被默认太久的问题重新摆上了台面:模型学习语言的顺序和方式,其本身就可能成为一个重要的效率杠杆。

当模型训练成本日益高昂,真正有价值的创新可能不只是如何把模型做得更大,而是如何让模型“更高效地学习”。更准确地说,是如何优化训练过程,让其中的每一步计算,都产生更高的价值。

参考文献:

论文:https://arxiv.org/abs/2605.06546

相关攻略

提升DeepSeek回答准确性的关键在于优化提问方式。应使用STAR法则结构化描述问题,明确情境、任务、动作和结果。需主动限定回答边界,如指定角色、信息源和时效,以抑制模型幻觉。遇到错误时可进行精准反向纠错。处理复杂问题时应分步拆解,每一步给出具体约束,以获得扎实可用的答案。

DeepSeek网页版因缺乏文档索引能力,不适合直接构建企业文档检索系统。搭建此类系统需自建核心RAG链路,包括文档加载器、嵌入模型和向量数据库。具体实现可选用LangChain框架整合各模块,并针对扫描件单独进行OCR处理。系统需注意配置细节,如持久化存储和元数据管理,以确保检索结果的可追溯性。

DeepSeek在中文任务上表现出色,这得益于其针对中文的深度适配。模型训练数据主要来自中文互联网,内置中文分词与语义理解模块,能精准把握成语、政策术语及中文表达习惯。其在长文本解析、公文写作、技术文档本地化及口语转书面语等需要高语义精度和强上下文保持的任务上优势突出。使用。

要让DeepSeek生成可直接剪辑的视频脚本,需通过精确提示词强制规定输出结构。必须明确指定分镜编号、画面描述、口播文案和时长等字段的格式,以表格化呈现,时长需精确。口播文案应限定句长并标注停顿,分镜描述需拆解为具体动作指令。批量生成时可使用变量模板和脚本自动化处理,以确保

编写DeepSeek系统提示时,并非越详细越好。模型更倾向于简短、动词开头的指令,长篇提示易被截断或稀释注意力。用户指令的优先级通常高于系统提示。有效的系统提示主要用于锁定输出格式、定义角色行为或过滤干扰,且不应与用户指令矛盾。

热门专题

热门推荐

华硕在ROGDAY2026上发布了枪神10X整机,首次搭载三颗可联动显示的全息光显风扇,外观极具未来感。其核心配置顶级,采用AMD锐龙99950X3D2处理器、ROGRTX5080显卡、64GB内存及4TBSSD,并配备高效三区独立散热系统,定价69999元。

智能门锁领域迎来重磅新品。知名品牌鹿客近期于京东平台正式发售其旗舰型号V3 Max智能门锁,该产品凭借创新的隔空无线充电技术与先进的AI视觉识别系统引发市场关注。官方定价为3572元,在部分参与促销活动的地区,消费者可享受补贴,最终入手价有望低至2799元,性价比优势显著。 鹿客V3 Max在视觉安

在备受瞩目的ROG DAY 2026广州站活动中,华硕重磅发布了其新一代高性能游戏笔记本电脑——ROG魔霸10系列。该系列包含16英寸的魔霸10与屏幕更大的18英寸魔霸10 Plus两款机型,旨在为硬核玩家带来顶级的游戏体验。 ROG魔霸10系列的硬件配置堪称顶级。处理器方面,用户最高可选择搭载AM

5月15日,小米官方正式公布了小米手环10 Pro的完整配置信息。作为新一代旗舰手环,它在健康监测精准度、运动功能专业度以及佩戴舒适度上均实现了显著突破,为用户带来了更全面的智能穿戴体验。 小米手环10 Pro 健康监测:精度与维度的双重跃升 本次升级的核心在于健康监测能力的全面进化。小米手环10

金士顿扩展其可超频的ECCRDIMM内存系列,新增高达7600MT s型号。其中高速型号采用全新铝制散热马甲,提升散热效率以保障高负载下的稳定运行。该系列同时支持ECC校验与超频,兼顾性能与数据完整性,适用于AI计算、工程仿真等高要求专业场景。