英伟达MIT华人团队开源大模型推理内存优化技术

你是否曾面临这样的困境:手握一张拥有24GB显存的RTX 4090显卡,想要运行一个参数规模高达320亿的大语言模型,执行复杂的多步骤智能体任务,却因KV缓存占用过高而显存爆炸,连模型都无法加载?

现在,一种名为TriAttention的创新方法彻底改变了这一局面。应用该方法后,模型不仅能够稳定运行,还能流畅地处理长达6份的文档,并自动生成结构完整的周报。

这项突破性技术并非社区魔改,而是来自麻省理工学院、英伟达与浙江大学的联合研究团队,其成果已形成严谨的学术论文。

TriAttention的核心机制极为精妙。它在预旋转位置编码的空间中,通过分析查询向量与键向量的三角集中度,来精准评估每个键值对(KV Pair)的重要性。基于此评估,系统能够智能地保留关键信息,果断舍弃冗余部分。

我们可以用一个比喻来理解:许多传统的KV缓存压缩技术,如同使用真空压缩袋打包行李,无论物品是蓬松的羽绒服还是坚硬的砖块,都进行无差别压缩。而TriAttention的策略则更像是先开箱仔细筛选,丢弃无用的砖块,只精心打包真正必需的羽绒服,从而实现更高效的存储。

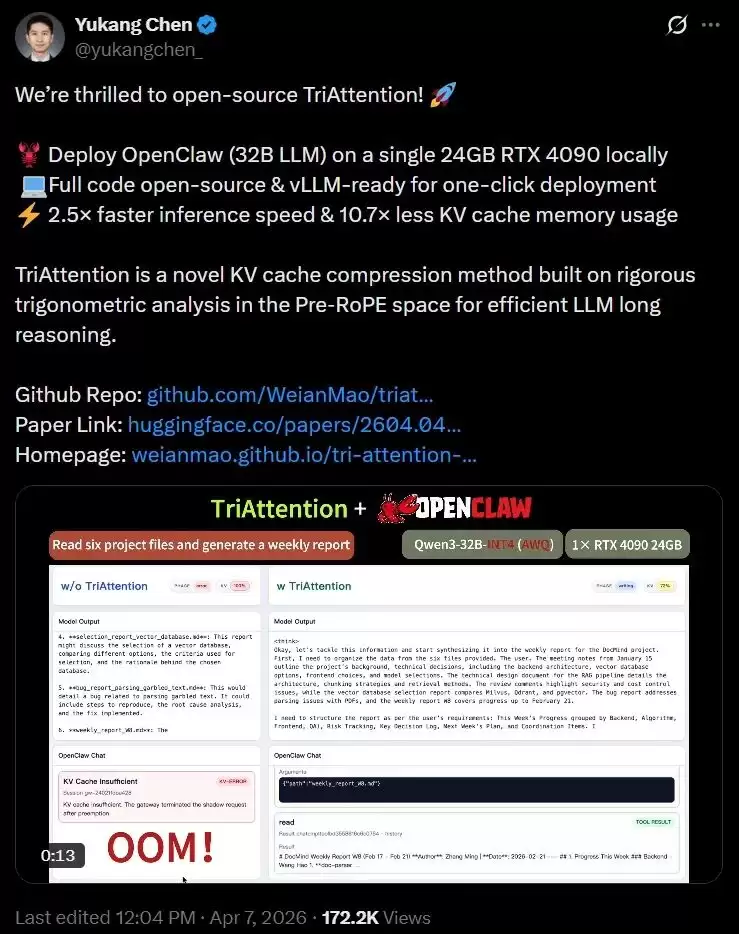

在研究者Yukang Chen分享的演示对比中,左侧未启用压缩的方案因显存不足而报错,右侧启用TriAttention后,智能体则顺畅无阻地完成了整个任务链。

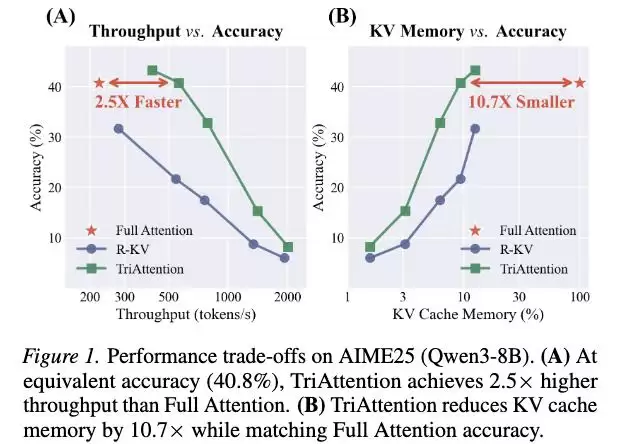

性能飞跃:2.5倍吞吐量提升与10.7倍内存缩减

TriAttention的实际效果如何?数据给出了最有力的答案。

在AIME25数学推理基准测试中,TriAttention在完全保持全注意力机制精度(准确率40.8%)的前提下,将推理吞吐量提升了2.5倍。

更令人瞩目的是内存占用优化:KV缓存的内存消耗被大幅缩减了10.7倍。

需要明确的是,这里大幅降低的是“KV缓存内存占用”,而非显卡的总显存或模型参数本身占用的内存。然而,在长序列推理场景中,KV缓存往往是导致显存溢出的关键瓶颈。减轻这部分负担,常常是决定任务“能否运行”与“无法运行”的根本区别。

论文的主要实验基于Qwen3-8B模型展开,覆盖了AIME24、AIME25、MATH500等多个评测任务。在生成长度达到32K token的严苛条件下,TriAttention几乎未造成任何精度损失,同时将大模型推理效率提升到了新的高度。

消费级硬件突破:单张RTX 4090流畅运行320亿参数模型

更令人印象深刻的是论文附录中提及的真实部署案例。

该场景基于OpenClaw智能体工作流,任务是阅读6份Markdown格式文档并生成周报。使用的模型是经过AWQ INT4量化的Qwen3-32B,硬件平台仅为一张消费级的RTX 4090显卡(24GB显存)。

若不进行KV缓存压缩直接运行,冗长的系统提示词与多轮文档读取将导致缓存急剧膨胀,显存会瞬间崩溃。而在TriAttention的加持下,智能体顺利完成了所有文档的阅读与分析,并输出了完整的报告。尽管此案例使用了量化模型和特定工作流,但它强有力地证明:一个完整的、具备实际应用价值的智能体任务,已经可以在消费级GPU上成功部署与运行。

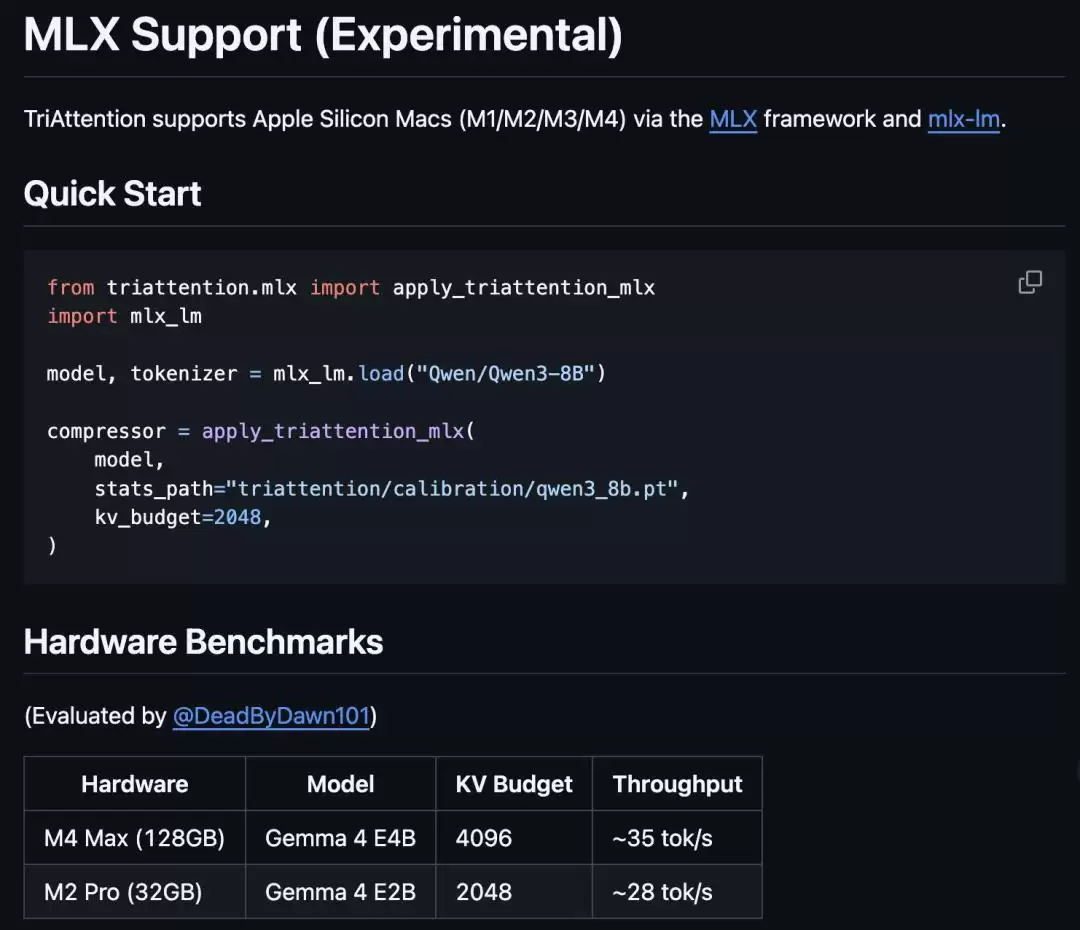

生态集成:vLLM插件已就绪,MLX支持实验性启动

TriAttention的价值远不止于学术论文。研究团队已在GitHub仓库中提供了与vLLM高性能推理引擎的集成方案。README文件明确指出,TriAttention包含一个即插即用的vLLM插件,并详细说明了如何通过OpenAI兼容API的服务端模式、Python API进行调用,以及如何接入OpenClaw智能体框架。

这意味着,开发者无需修改模型架构或重新训练,只需加载此插件,即可在现有的vLLM推理管线中无缝获得KV压缩带来的性能红利,极大降低了部署门槛。

此外,针对Apple Silicon生态,项目仓库最新提供了独立的MLX框架支持文档,覆盖从M1到M4的全系列芯片,并附带了示例代码与硬件基准测试结果。

当然,文档标题也标注了这仍是“实验性支持”,表明团队正处于MLX生态的早期探索阶段,距离成熟的Mac本地部署方案尚有距离,但技术方向已非常清晰。

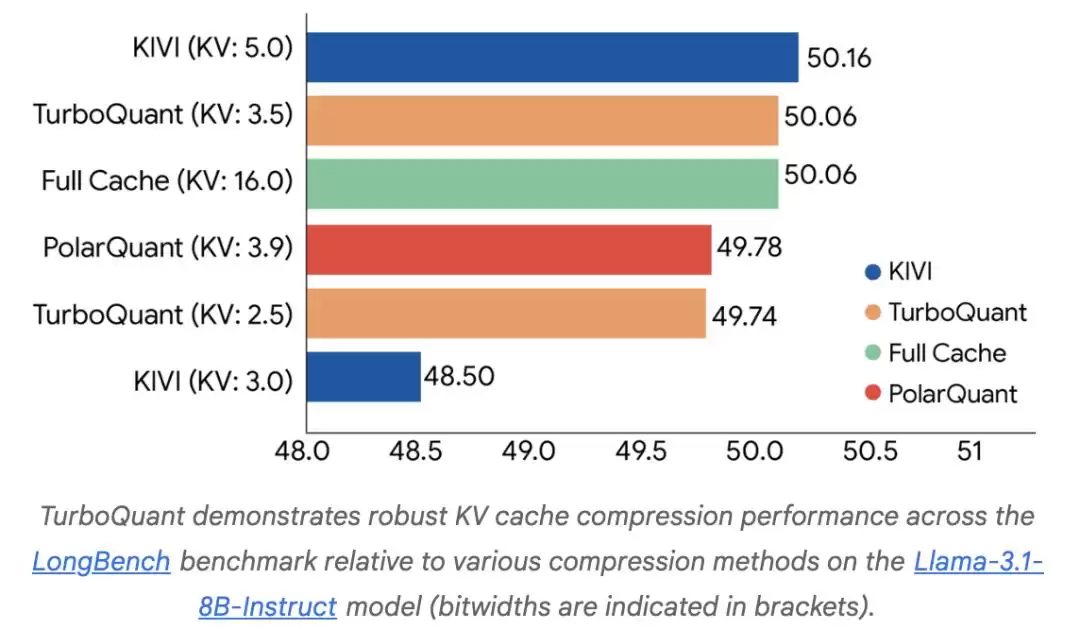

技术路线解析:KV缓存压缩的两大主流方向

当前,KV缓存压缩技术领域主要存在两条并行的技术路线。

一条是“量化派”。以谷歌研究院今年3月发布的TurboQuant为代表,其核心目标是在“零精度损失的前提下实现极致压缩”,专注于将KV缓存及向量搜索的比特数降至极限。

社区已有开发者在Apple Silicon芯片上,借助TurboQuant成功运行了如Gemma 4 31B等大型模型。

另一条则是“选择性保留派”。TriAttention正是此路线的新锐代表。它不追求压缩每个存储单元的比特宽度,而是直接评估并筛选出值得保留的关键token的键值对,丢弃次要部分。

两条路线的终极目标一致:让大模型能在消费级硬件上高效运行,同时避免显存溢出并保持精度。但方法论迥异。量化好比均匀压缩每件行李的体积,选择性保留则类似于直接减少行李的件数。理论上,这两种思路可以结合使用,以期获得更大的效益。

目前,尚缺乏在相同模型、硬件和任务下的严格直接对比,因此断言孰优孰劣为时过早。但可以肯定的是,这两条技术路线都在加速向消费级部署的最终落地迈进。

回想一年前,“本地运行大模型”仍带有浓厚的极客实验色彩,运行一个70亿参数的模型都需大量调试。如今,320亿参数模型已在单张消费级显卡上完成智能体任务,Apple Silicon上的MLX生态每周都有新进展,vLLM插件让KV压缩变成了“一键启用”的便捷方案。KV缓存压缩这条赛道,正迅速从论文中的消融实验,转变为每位开发者触手可及的工程现实。

核心作者简介

Weian Mao

Weian Mao现任麻省理工学院计算机科学与人工智能实验室(MIT CSAIL)博士后研究员,博士毕业于阿德莱德大学AIML,师从沈春华教授。其当前研究聚焦于大语言模型的高效推理,特别是长上下文处理中的KV缓存压缩问题;此前亦从事过计算机视觉与蛋白质设计等相关领域的研究。

Xi Lin

Xi Lin是浙江大学计算机科学与技术专业高年级本科生,研究兴趣集中于高效AI的算法与系统协同设计,尤其关注面向硬件友好的稀疏化与量化模块设计,以及高效推理策略。其工作与高性能计算、机器学习系统等方向紧密相关。

Wei Huang

Wei Huang现为香港大学博士生,研究聚焦于高效AI与大型视觉/语言模型。目前,他在英伟达研究院实习,与Yukang Chen等研究者合作,并在Song Han教授的指导下开展相关研究,参与了QeRL、LongLive等项目。

参考资料:

TriAttention论文:https://arxiv.org/abs/2604.04921

演示对比:https://x.com/yukangchen_/status/2041366586423165152

Google TurboQuant博客:https://research.google/blog/turboquant-redefining-ai-efficiency-with-extreme-compression/

相关攻略

在人工智能浪潮中,大语言模型已成为推动产业变革的关键引擎。其中,实在智能推出的实在塔斯(TARS)大模型,是一款面向垂直行业领域、可自主训练的类ChatGPT大语言模型。它并非通用模型的简单复刻,而是基于实在智能在自然语言处理领域长期的技术积淀与丰富的落地经验,为行业深度定制而生。下面,我们来详细拆

在探索如何高效利用GPT、BERT等大型语言模型的强大能力时,“工作流”无疑是实现任务自动化与智能化的核心策略。它是一套将复杂问题标准化、流程化的系统性方法,旨在显著提升任务执行的效率与输出结果的可靠性。那么,一套优秀的大模型工作流具体包含哪些关键组成部分?我们又该如何设计与实施呢? 工作流的核心要

大模型缓存机制通过KVCache和前缀匹配实现重复内容仅计费一次,显著降低成本。主流方案差异明显:OpenAI自动缓存折扣约五折但时效短;Claude需手动标记,折扣可低至一折;DeepSeek采用硬盘缓存,持久且费用极低。工程中应将稳定内容前置以提升命中率,高频重复场景下合理利用可大幅节省费用。

谈及当前企业智能化转型的主流方案,“大模型一体机”无疑是备受关注的核心选项。本质上,它是一套完整的“交钥匙”解决方案,将AI服务器硬件、预训练好的大模型以及配套的应用软件深度融合,打包交付,旨在为企业提供安全、高效、可私有化部署的大模型服务。 一、核心构成:三位一体的“智能体” 这套系统的架构与核心

企业在引入大型人工智能模型时,面临一个关键抉择:是采用便捷的云端服务,还是选择将模型私有化部署在本地?后者,即将大模型部署于企业自有的服务器或专用硬件上,正日益成为对数据安全、响应速度和成本控制有严格要求的机构的核心选择方案。 一、私有化部署的背景与趋势 在人工智能技术迅猛发展的浪潮中,以实在智能为

热门专题

热门推荐

钉钉文档官网 在探讨企业级协同办公解决方案时,钉钉文档无疑是备受瞩目的核心工具之一。作为阿里巴巴钉钉官方推出的旗舰级应用套件,它深度融合了在线文档编辑、智能表格、思维导图等多种高效创作工具。其核心优势在于与钉钉平台生态的无缝衔接,能够直接同步企业内部组织架构与通讯录,实现团队成员间的即时协作与信息流

在数字化转型浪潮中,高效、易用的数据分析工具已成为企业提升决策效率的关键。商汤科技推出的“办公小浣熊”智能助手,正是基于自研大语言模型打造的一款创新产品,旨在彻底降低数据分析的技术门槛。用户无需掌握编程知识或复杂操作,即可通过自然对话完成从数据查询、处理到可视化洞察的全流程,让数据价值触手可及。 办

在人工智能技术快速发展的今天,MiniMax作为一家专注于全栈自研的AI公司,正以其独特的技术路径和前瞻性的布局,在业界脱颖而出。公司致力于构建覆盖文本、图像、语音和视频的新一代多模态智能模型矩阵,这不仅体现了对核心底层技术自主权的深度掌控,也展现了对未来人机交互与内容生成形态的前瞻思考。 那么,M

ApolloCreditFund(ACRED)作为连接传统信贷与DeFi的桥梁,其价格受市场情绪、协议基本面及宏观环境影响。其价值逻辑根植于现实世界资产(RWA)的收益捕获与链上流动性释放。短期价格波动难以预测,但长期发展取决于信贷资产质量、协议安全性和市场采用度。投资者需关注其底层资产表现、代币经济模型及整个RWA赛道的发展趋势。

在数字化转型浪潮中,一套能够深度适配业务、彰显品牌特色的智能客服系统,已成为企业提升服务效率与用户体验的关键工具。然而,市场上许多解决方案往往模式固化,难以满足个性化需求。如何让AI客服不仅具备基础的自动化应答能力,更能承载独特的品牌文化与服务哲学?其核心在于系统是否支持深度的自定义与持续的AI训练