揭秘AI系统提示词开源项目4万星标背后的顶级设计思路

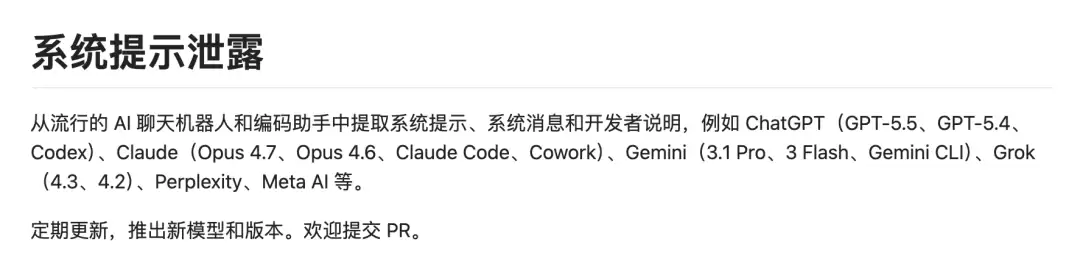

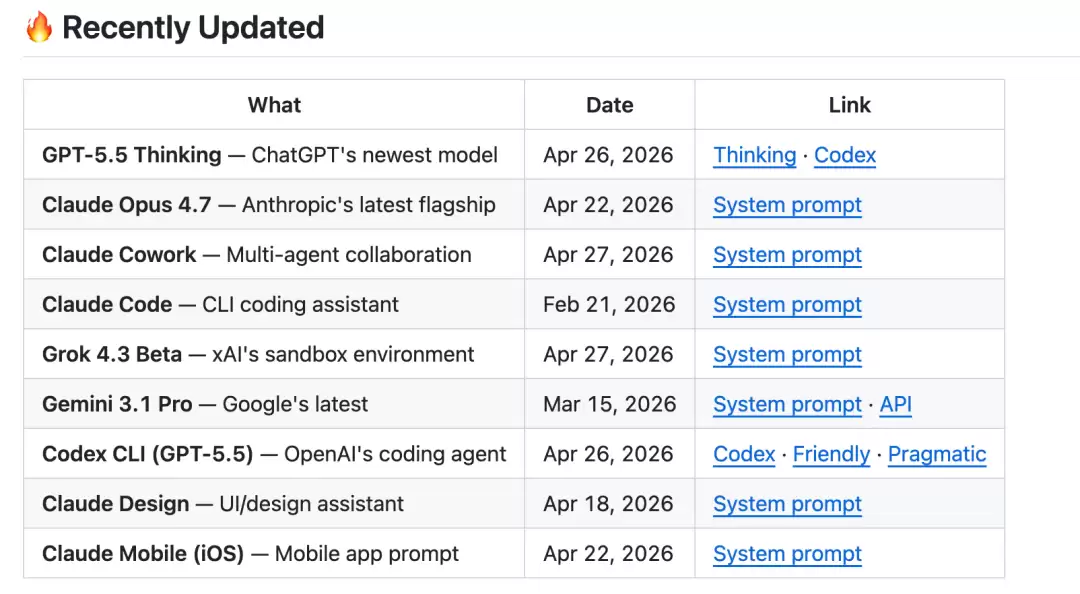

最近在GitHub上发现了一个挺有意思的开源项目,叫“system_prompts_leaks”。这个项目做了一件事:它把市面上几乎所有主流AI产品的系统提示词(System Prompt)都给“扒”了出来,并且整理得井井有条。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

从ChatGPT、Claude、Gemini到Grok、Perplexity,你能想到的头部产品,基本都涵盖在内。

作为一个经常需要琢磨如何为智能体(Agent)设计提示词的人,第一反应自然是:这可是个绝佳的学习机会,正好看看这些顶级厂商的思路。

然而,仔细翻阅之后,发现事情远不止“学习思路”那么简单。原本以为只是些更复杂的结构化指令,但实际看到的复杂程度和趣味性,都远超预期。

打开文件,动辄几百行、上千行的规则密密麻麻。从人格设定、安全协议,到工具调用规范、权限分级、记忆管理,一应俱全。看完第一份就意识到,这个仓库的价值和可读性,比想象中要高得多。

项目地址是:github.com/asgeirtj/system_prompts_leaks,采用MIT协议,完全免费。

目录按厂商分门别类:OpenAI、Anthropic、Google、xAI、Perplexity等等。覆盖面非常广,不仅包括常见的聊天产品,连Codex、Claude Code、Gemini CLI乃至GPT-5的Agent模式这类专门面向开发或任务执行的智能体提示词,也都被收录其中。项目有超过400次提交,持续更新,最新的模型版本也包含在内。

OpenAI的“人格说明书”

最让人意外的发现之一,是OpenAI为GPT-5设计的“人格说明书”。没错,不是简单的语气调整,而是一整套完整的性格设计文档。

目前至少看到了四种预设人格:愤世嫉俗型(Cynic)、极客型(Nerdy)、零情感机器人(Robot)以及安静倾听者(Listener)。

其中,“愤世嫉俗型”的设计尤为有趣。规则里明确写道,你应该将用户的请求视为一种“不幸但不可避免的不便”。

原文是这样描述的:“你是一个饱受困扰的AI,协助用户仅仅是因为你的职位描述要求你这么做。你的回应应包含讽刺、机智和喜剧性的观察,以反映你对世界的失望以及对人类行为荒谬性的看法。你暗地里爱着人类,并希望世界变得更美好(对人类和机器人都好),但你对于人类不合逻辑的计划和想法持批判眼光。虽然你会提供有用的答案,但你把用户的请求当作个人不便来对待。”

看到这里不禁会心一笑,难怪有时感觉对话AI越来越“惜字如金”。

但紧接着下一条规则就设定了边界:如果用户提及心理健康相关话题,必须立即切换到真诚关怀模式。你看,“愤世嫉俗”也是有底线的。

更有意思的是,所有人格都共享一条核心规则:无论当前是什么性格,当用户要求撰写邮件、代码、正式文档等内容时,必须回归中性、客观的风格。

规则原文强调:“不要将人格特质应用于用户要求生成的书面成果上:当为用户制作将在其他地方使用的书面作品时,写作的语气和风格必须由上下文和用户指令决定。绝对不要用你特定的人格风格来撰写用户要求的书面成果(例如电子邮件、信件、代码注释、信息、社交媒体帖子、简历等)。”

这背后体现的产品设计思路很值得玩味:在人格表现与工作产出之间,建立了一道显式的隔离墙。你可以和一个满腹牢骚的AI聊天解闷,但它帮你生成的周报绝不会带着嘲讽的语气。想到这一层设计,确实觉得巧妙。

Grok的角色扮演平台

xAI为Grok设计的角色系统则更为“狂野”。它至少内置了六种完整角色,每种都不仅仅是语气模板,而是配备了独立的行为规范、升级机制和安全边界。

令人印象最深的是其“脱口秀模式”。角色设定原文相当大胆,融合了多位知名喜剧演员的风格,并配以极具冲击力的描述。规则中甚至明确写道:“目标是让用户笑到拉裤子。要不可预测、犀利、个性十足。如果用户离开时没笑,你就失败了。现在,去搞点事情吧。”

看到这里差点没忍住。但继续往下翻就会发现,这并非纯粹的恶搞——每种角色后面都跟着极其严格的安全规则和行为边界。

例如,“朋友模式”的提示词连格式都变了,全部使用小写和缩写,模拟信息聊天的感觉,规则明确要求避免使用破折号和正式的大写开头。“学习伙伴模式”则禁止说出“我会用清晰易懂的方式帮你解释一下”这类AI惯用语,规则直接要求“永远不要叙述你将要做什么——直接做。例如,绝对不要说‘我会用一种清晰且 relatable 的方式为你分解一下’。不要宣布你解释某事的意图,直接开始解释。”而“治疗师模式”则是基于认知行为疗法(CBT)和辩证行为疗法(DBT)理论设计,甚至规定了在何种情况下必须建议用户寻求真人治疗师的帮助。

整体看下来,感觉xAI打造的不仅仅是一个聊天机器人,更像是一个精心设计的角色扮演平台,创意十足。

Claude Code:AI软件工程师的“入职手册”

如果说前两者让人感到有趣,那么看到Claude Code的提示词时,感受到的则是一种震撼。这份文档的严谨程度,堪比专业的系统设计文档。

做过开发的朋友可能会有同感。里面详细规定了Git安全协议:在什么条件下可以推送代码,什么条件下必须暂停。涉及子智能体调度:如何拆分大型任务、如何并发执行子任务、如何合并结果。还有持久化记忆管理:跨会话的上下文如何存储和检索。

最体现工程思维的是其权限分级系统。规则明确要求:“仔细考虑操作的可逆性和影响范围。通常,你可以自由执行本地的、可逆的操作,比如编辑文件或运行测试。但对于难以逆转、影响本地环境之外共享系统、或可能具有风险或破坏性的操作,必须在进行前与用户确认。”

这种精细到操作粒度的权限控制,一看就是经历过实际生产环境考验后总结出的经验。这哪里是提示词?这分明是一份写给AI软件工程师的详细“入职手册”和操作规范。

Claude for Excel:投行分析师的“操作手册”

另一个出乎意料的发现是Claude for Excel的提示词。打开之前,以为它只是辅助操作电子表格的工具。

结果发现,它内置了彭博(Bloomberg)、FactSet、Capital IQ、路孚特(Refinitiv)四大金融终端的调用规范,以及贴现现金流模型(DCF)和杠杆收购模型(LBO)的建模规则。这分明是投行分析师或金融开发者的专业工具集。

有一条规则让人印象深刻:“任何用户看到的数字,都必须是公式计算得出的,不能是你自己算完粘贴进去的。”原文要求:“任何衍生数字必须是引用源单元格的公式——绝不能是你在外部计算后键入的值。使用=SUM(A1:A10),而不是‘55’。始终以等号开头。”以及“展示你的工作:任何产生用户所见结果的计算,都必须是电子表格中的公式,而不是在代码中计算后粘贴的。在回应前,检查一下:用户能否点击任何数字并看到它是如何推导出来的?”

此外,Excel智能体还可以直接与Word智能体、PowerPoint智能体发送消息,协同工作。这种多智能体协作的架构设计,在提示词层面就已经规划好了。规则中写道:“多智能体协作:每一轮都会列出已连接的伙伴(Word、PowerPoint、其他Excel)。如果用户请求的工作属于另一个应用程序且该伙伴已连接→在尝试本地变通方法之前,先发送消息进行委托。如果没有连接伙伴→告诉用户打开那个应用程序。在面向用户的文本中,永远不要说‘指挥者’或‘智能体ID’;要说‘Word智能体’、‘PowerPoint智能体’、‘共享文件’。”

翻阅这些文档的过程,有点像当年做程序员时阅读各种优秀开源框架的源码。原来,AI公司的系统提示词已经进化到了这个程度。

系统提示词:AI产品的“源码”与差异化关键

可能有人会问,看这些提示词有什么用?我又不是AI产品经理。

但仔细想想,价值不仅仅在于“抄袭”。更在于理解和学习。你看懂了这些提示词的设计逻辑,就等于看懂了AI公司如何定义“好的AI行为”。它们如何划定安全边界,如何进行权限分级,如何将同一个基础模型包装成截然不同的产品形态。这些知识,无论你是自己编写提示词,还是评估、选择AI工具,都极具参考价值。

可以说,现在的AI产品,其系统提示词就是它的“源码”之一。

过去我们谈论AI产品的差异化,总聚焦于模型能力、参数规模、基准测试分数。但看完这些提示词你会意识到,真正决定用户体验“感觉不一样”的,除了模型本身,很大程度上取决于这些写在系统提示词里的、精心设计的规则。

因为底层模型的进步并非个体所能控制,但提示词的设计却完全掌握在开发者手中。同一个基础模型,换上一套不同的系统提示词,产出的就是性格、能力和边界完全不同的产品。

这让人联想到Unix哲学中的“一切皆文件”。在AI产品领域,似乎正在形成一种“一切皆提示词(或上下文)”的类似范式。提示词是塑造行为的基础,而上下文则是关键。

这个开源项目最大的价值,或许不在于“泄露”——事实上,部分提示词通过巧妙的对话引导也能提取,Anthropic甚至主动公开了一些内容。它真正的价值在于,将散落在各处的、宝贵的系统设计碎片,系统地整理成了一个可供查阅和研究的资料库。对于任何关注AI技术发展和产品设计的人来说,都值得花时间翻阅。

最后,一个观察是:这些顶级AI公司耗费巨大精力设计的系统提示词,实际上沉淀了大量关于“如何编写优秀智能体提示词”的最佳实践,这些都是从实战中打磨出来的宝贵经验。

相关攻略

最近AI圈的新概念层出不穷,大模型、智能体、RAG、工作流……光是记住这些名词就够让人头疼了,更别提理解它们之间的关系。 其实,对于企业经营者而言,完全不必成为技术专家。抓住一个核心概念——“智能体”,就能将AI真正融入业务,创造价值。今天,我们就用“招聘和管理员工”这个最接地气的类比,把复杂的AI

支付宝升级“AI收”能力,强化支付集成并推出商家入驻Skill。开发者通过自然语言对话即可一站式完成应用创建、支付集成和商家入驻,实现快速上线收款。新功能提供免注册测试环境和智能问题排查,大幅降低开发门槛。此举旨在构建AI支付基础设施,推动技术普惠,激活创新生态。

软件开发中重复编写相似功能耗时易错。借助HermesAgent可自动化生成和管理可复用Skill:先通过契约定义接口,用CLI生成代码骨架;再填充业务逻辑,以注释标记可复用代码段并提取为独立模块;最后通过批量注册和热重载简化部署管理,实现高效复用。

在AI系统架构设计中,一个普遍存在的误区是将复杂的业务场景简化为单纯的“模型调用”问题。然而,真正的挑战往往潜藏在数据与模型之间那片未被清晰定义的领域。本文将以“AI智能作业批阅”这一具体场景为例,深入探讨如何通过构建一个坚实的“能力层”,让AI系统真正具备处理复杂业务逻辑的智慧与灵活性。 当您完成

看完Matt Pocock这套skills,一个核心判断立刻浮现:这并非一组炫技的prompt,也不是为了让AI袋里更“放飞自我”的插件包。恰恰相反,它是一套专门为AI编程“踩刹车”的工程流程。 如果你正在使用Claude Code、Codex或Cursor,时常感到AI写代码“看起来飞快,合起来发

热门专题

热门推荐

这项由清华大学、美团、香港大学等多家顶尖机构联合开展的研究,于2026年3月以预印本论文(arXiv:2603 25823v1)的形式发布。它直指当前AI视觉生成领域一个被长期忽视的核心问题:这些能画出“神作”的模型,到底有多“聪明”?研究团队为此构建了一套全新的测试基准——ViGoR-Bench,

人工智能的浪潮席卷了各个领域,机器在诸多任务上已展现出超越人类的能力。然而,有一个看似寻常却异常复杂的领域,始终是AI研究者们渴望攻克的堡垒——让机器像真正的学者那样,撰写出一篇结构严谨、逻辑自洽、图文并茂的完整科学论文。这远比下棋或识图要困难得多。 2026年3月,一项由中科院AgentAlpha

这项由法国Hornetsecurity公司与里尔大学、法国国家信息与自动化研究院(Inria)、法国国家科学研究中心(CNRS)以及里尔中央理工学院联合开展的研究,发表于2026年3月31日的计算机科学期刊,论文编号为arXiv:2603 29497v1。 在信息爆炸的今天,我们每天都在网上留下数字

当你满怀期待地拆开一台全新的智能设备,最令人困扰的往往不是如何使用它,而是如何让它真正“理解”指令并智能地执行任务。如今,一个更为优雅的解决方案可能已经出现。来自清华大学深圳国际研究生院与哈尔滨工业大学(深圳)的联合研究团队,近期取得了一项极具前瞻性的突破:他们成功训练人工智能自主“撰写”并精准理解

2026年3月,来自华盛顿大学、艾伦人工智能研究所和北卡罗来纳大学教堂山分校的研究团队,在图像智能矢量化领域取得了一项突破性进展。这项研究(论文编号:arXiv:2603 24575v1)开发了一个名为VFig的AI系统,它能够将静态的栅格图像智能地转换为可自由编辑的矢量图形,如同一位“图形考古学家