vLLM高并发吞Token问题修复:大模型推理稳定性提升方案

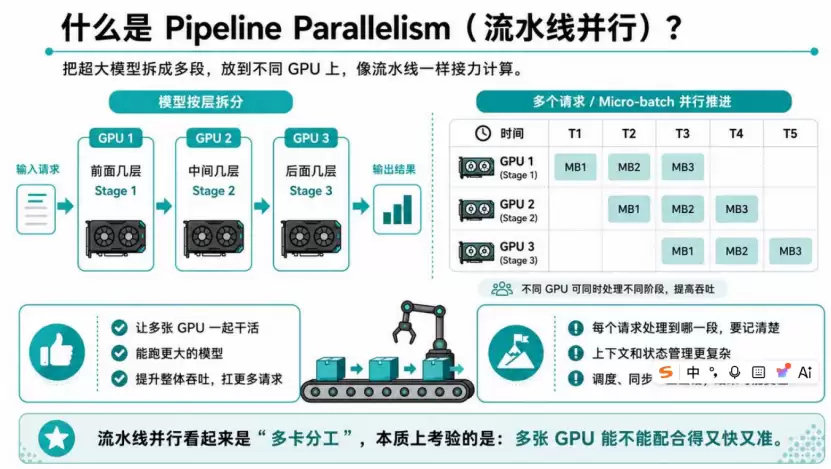

如果把大模型比作“智能大脑”,那么vLLM就是确保这个大脑在应对海量并发请求时,既能保持高速运转、又能高效利用资源的“核心调度系统”。然而,许多开发者在实际部署中发现一个诡异现象:模型在单机单卡测试时表现优异,一旦开启流水线并行(PP模式)进行分布式推理,模型输出质量就会显著下降,甚至出现答非所问、逻辑混乱的“降智”情况。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

作为当前大模型推理领域性能领先的开源加速框架,vLLM以其卓越的吞吐量和低延迟备受推崇。但在追求极致速度的背后,某些特定场景下的隐蔽缺陷可能悄然影响推理精度,成为生产环境中的潜在风险。

近期,vLLM官方的一个Pull Request揭示了典型案例:在256并发的高压测试中,Qwen3-8B模型启用PP模式后,其在GSM8K数学推理基准上的准确率从87.7%骤降至83.2%。

高达4.5个百分点的性能损失从何而来?经过范式团队的深度剖析,真相浮出水面:问题未必出在模型本身,很可能是推理框架的内存管理机制在分布式场景下“误吞”了关键Token,导致输入信息残缺不全。

深度解析:高效内存整理如何引发精度损失

范式团队定位到,该问题的根源在于vLLM引擎的内存整理优化机制。该机制本意为提升GPU内存利用率与整体吞吐量,但在流水线并行的复杂交互中,其状态记录逻辑存在致命缺陷。

具体而言,在PP模式下,非流水线末端的计算卡在记录请求的Token处理状态时,犯了一个关键错误:它误将“本卡已处理的局部Token数量”记录为“该请求全局需处理的Token总数”。

这一错误如何在并发场景下触发“降智”?关键在于高负载触发的内存整理操作。当系统为接纳新请求而启动内存整理时,会依据错误的状态记录进行决策。它发现某个请求“仅需处理少量Token”,便判定该请求已近完成或价值较低,于是仅拷贝了部分残缺的Token数据,而将后续关键的Token序列直接丢弃。更严重的是,释放的内存可能被其他请求即时占用,造成残留数据污染与错位。

最终,模型接收到的Prompt是支离破碎、语义不全的。这如同要求学者仅凭半页残卷撰写完整论文,生成结果必然偏离预期,导致模型表现出现“降智”现象。

解决方案与最佳实践

明确问题根源后,修复路径便清晰可见。针对这一vLLM流水线并行精度Bug,开发者可采取以下措施:

首先,核心修复已提交至vLLM项目的PR #41133。最稳妥的方案是密切关注该PR的评审与合并进度,待修复并入官方主线后同步升级。

对于急需解决问题的团队,可考虑使用已包含该修复的最新开发版本。需注意,当前修复虽已合并至主分支,但尚未发布为正式稳定版。建议在测试环境中充分验证,再评估是否适用于生产部署。

此案例也为所有大模型推理优化提供了重要启示:在追求高吞吐、低延迟的极致性能时,必须同等重视输出质量的稳定性与准确性。建议在高并发配置上线前,不仅进行压力测试,更应使用lm_eval等标准评估工具对模型输出质量进行多维度校验,确保精度指标符合预期。

值得欣慰的是,该修复已进入vLLM主分支,预计将随下一个正式版本发布。届时用户通过常规升级即可解决。若您当前仍在旧版本上运行多机多卡推理,建议重点检查相关内存调度模块,避免因框架底层逻辑错误而折损AI模型的真实能力。

此次问题的精准定位与修复,充分体现了技术团队对分布式推理框架底层机制的深刻把握。在大模型工程化落地的深水区,此类对性能与精度平衡的深度优化,正是保障系统稳定可靠的关键所在。

相关攻略

这项由三星研究院(Samsung Research)主导的研究,已于2026年2月以论文编号arXiv:2602 06694v1正式发表,为相关领域提供了详实的技术参考。 将一座庞大的AI模型塞进个人电脑的显卡里运行,这个想法听起来就像要把整个图书馆的书装进一个随身背包。然而,三星研究团队提出的NA

南加州大学计算机科学系团队在2026年2月发表了一项引人注目的研究(论文编号:arXiv:2602 15823v1),为大语言模型的知识更新难题提供了一个全新的解决思路。他们开发的CrispEdit方法,就像为AI配备了一把精准的“知识手术刀”,能够在不损伤原有能力的前提下,植入新的知识。 不妨设想

云知声发布医疗健康保险大模型“山海知医慧保”,基于自研通用底座并融合临床数据,提供医保合规与商保理赔解决方案。该模型覆盖政策问答、智能审核等全流程,关键指标显著提升,现已通过标准化接口上线,助力保险领域AI规模化应用。

2026年4月,美团正式启动了一项名为“北斗”的顶尖实习生招募计划,其目标精准锁定全球高校中的优秀硕士与博士研究生。该项目由美团LongCat大模型团队主导,旨在通用人工智能(AGI)的校园人才竞争中提前布局,为核心研发梯队储备未来力量。 这一举措并非孤立事件。当前,大模型技术的发展重点正从通用能力

视频大模型的战场,硝烟味越来越浓了,而这场仗,正变得越来越“贵”。 5月11日,市场传出消息,快手有意分拆其视频生成大模型“可灵AI”,并以高达200亿美元的估值进行融资,本轮目标融资额约20亿美元,腾讯等投资方据传正在接洽中。更有消息指出,可灵AI当前的年化收入已达5亿美元,较春节前翻了一番。尽管

热门专题

热门推荐

持续三年的咖啡市场价格竞争,在2026年初迎来了关键转折点,各大品牌集体展现出告别低价策略的趋势。 库迪咖啡已将大部分产品价格调整至11 9元至16 9元区间,部分核心单品的价格上调幅度达到30%至60%;瑞幸咖啡则更早一步,显著收窄了其标志性的9 9元优惠活动的适用范围。行业已形成一个清晰共识:仅

2026年5月13日,全球权威指数编制机构MSCI(明晟公司)正式发布了其季度指数审议结果。此次调整备受资本市场瞩目,所有变更将于5月29日收盘后正式生效。 在本次MSCI指数季度调整中,MSCI中国指数的成分股变动成为市场焦点。根据最新公告,该指数新增了22家中国上市公司,涵盖光库科技、长飞光纤、

在汽车制造业的可持续发展浪潮中,一场源自中国广西柳州的绿色材料革命正备受瞩目。上汽通用五菱成功构建了以本土竹资源为核心的汽车零部件创新产业链,通过前沿科技将这一可再生材料转化为高性能汽车部件,为全球汽车产业的低碳转型探索出一条独具特色的中国路径。 这一产业链的核心价值,在于其显著降低了对石油基塑料的

对于经常驾驶电动汽车进行长途出行的车主而言,高速续航焦虑、服务区充电排队、途中电量不足等问题,都是真实存在的困扰。这曾是许多新能源车主在跨城出行时最担心的情况。然而,通过多次长途实测的经验总结与策略优化,一套能够显著提升电车长途旅行安心度与便利性的实用方法已经得到验证。 车载电器:容易被忽视的“耗电

本文解答了抹茶MEXC新用户在注册过程中最常遇到的五个问题,涵盖账户注册、身份验证、审核时长、安全设置以及后续操作。内容旨在帮助用户清晰了解流程,顺利完成从开户到交易的全部步骤,确保账户安全与合规使用。