GPT-5.5 Prompting Guide 发布 你的Prompt可能已过时需更新

你是否注意到,花费在Prompt设计上的时间不断增加,但切换到新模型后,效果有时反而不如人意?

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

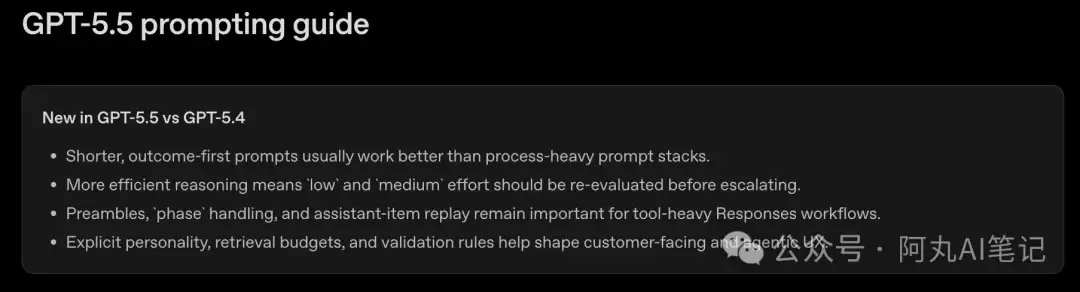

近期,OpenAI伴随GPT-5.5模型发布了一份全新的《提示工程指南》,内容颇具启发性。

图片

图片

这份指南揭示了一个关键洞察:你过去积累的部分Prompt经验,可能正在成为新模型性能的阻碍。

这个问题,值得我们深入探讨。

指南的核心要点解析

首先,我们梳理一下核心内容。

GPT-5.5的最新指南明确指出:不应直接将旧模型的提示词迁移过来,而应从最简提示词开始重新设计。

原文中有一句深刻的阐述:“旧提示词通常过度规定了流程,因为早期模型需要更多引导才能保持正轨。对于GPT-5.5而言,这种做法反而会增加干扰、限制模型的探索空间,或导致回答过于机械。”

这是第一个核心原则:施加的限制越多,模型的表现潜力可能越受抑制。

指南推崇“结果导向”的提示方式。具体而言,就是清晰告知模型你期望的最终成果、成功的评判标准以及必要的约束条件,然后赋予它自主选择解决路径的空间。而不是将每一步都严格规定:先执行A,再执行B,接着对比C,最后输出D。

GPT-5.5在提示词定义了目标结果并为模型留出选择高效解决方案空间时,表现最佳。

其他几个值得关注的重点:

一是明确设定停止条件。指南建议加入类似规则:“每次调用工具后,自问:我是否已掌握足够证据来回答用户的核心问题?如果是,立即给出最终答案。”这主要为了防止模型陷入过度推理和无效循环。

二是“前导说明”机制,即在多步骤任务的任何工具调用前,先发送一条用户可见的简短状态更新,说明当前正在进行的操作。这个设计非常实用,解决了用户面对模型长时间“思考”却无输出反馈,误以为系统卡顿的实际问题。

三是新增的text.verbosity(文本详细度)和reasoning_effort(推理强度)两个参数,用于精细调控输出的详尽程度与推理的深度。

为何此时发布这份指南

这是最值得深思的问题。

理论上,模型越强大,编写Prompt应该越轻松。但现实是,每次重大版本更新,厂商都会发布新的提示指南。GPT-4有,Claude 3有,GPT-5.5也有。原因何在?

背后可能有三层考量:

第一,能力跃升导致兼容性断层。GPT-5.5的推理能力相较早期模型实现了质的飞跃。它能自主规划路径、主动选择工具、判断何时终止任务。这意味着,它与用户的协作关系已经改变。过去你需要手把手指导,现在若依然事无巨细,模型反而会觉得受到束缚,回答变得刻板。这份指南实质上是在帮助用户重新校准“人机协作模式”。

第二,用户积累了大量的“提示词技术债务”。过去几年,许多团队在Prompt优化上投入了大量精力:精心设计的系统提示、经验总结的少样本示例、层层叠加的规则限制。这些在旧模型上有效的方法,在新模型上可能反而成为性能负担。OpenAI需要通过官方渠道告知用户:是时候清理这些历史包袱了。

第三,智能体应用场景对提示词提出了全新要求。GPT-5.5明显是为智能体工作负载设计的。多步骤任务、工具调用、长时运行、中间状态管理,这些场景下的提示词设计逻辑,与简单的对话聊天截然不同。指南中关于停止条件、前导说明、阶段参数的内容,正是为了解决智能体场景下的实际痛点。

指南的普适性探讨

这部分值得展开说明,因为其中存在一些需要审慎看待的细节。

部分原则确实具有广泛适用性。定义成功标准、给出约束而非步骤、为模型保留自主空间——这些原则在任何足够强大的模型上都成立。从某种角度看,这是“如何与高智能协作者高效沟通”的通用方法论,只是过去的模型智能程度不足,这套方法难以施展。

但也有一些内容是高度模型特定的。例如reasoning_effort参数、阶段值的处理、以及Codex的$openai-docs migrate命令——这些都是OpenAI生态内的专属功能,换到Claude或其他模型上便完全不适用。

还有一个容易被忽略的前提:这份指南假设你正在使用一个能力足够强大的模型。它建议“采用结果导向,别规定流程”,但如果你使用的模型能力一般,这套方法可能并不奏效。能力较弱的模型确实需要更明确的步骤引导,否则容易偏离方向。

因此,这里存在一个常见的误区:将这份针对顶级模型的指南视为通用真理,然后在其他场景下发现效果不佳,进而怀疑自身操作有误。

此外,“从最简提示词重新开始”这条建议,听起来合理,但实际执行成本很高。如果你有一个正在生产环境中运行、经过精心调优的系统提示,真的能完全推倒重来吗?大多数团队的现实答案是:不会,也难以做到。指南提供的是理想状态下的建议,而在工程实践中,往往仍需采用渐进式调整策略。

隐藏在指南背后的重要趋势

通读这份指南,最值得关注的并非某一条具体技巧,而是其背后折射出的宏观趋势。

提示工程正在从“使用特定词汇控制模型”,演变为“定义目标、设定约束、建立协作框架”。前者更接近编程思维,后者则更像管理艺术,或者说,类似于与一位聪明但需要明确方向的同事进行沟通。

这对技术人员意味着什么?提示工程的操作门槛正在降低,但质量上限却在提高。任何人都可以撰写一个简短的结果导向型提示词;但真正能够清晰定义成功标准、设计合理的停止条件、妥善处理边界情况的人,需要对自身需求有极其明确的认知。这更像一种软实力,无法仅靠记忆几条规则获得。

有趣的是,指南中提到的“个性模块”设计。定义助手的语气、温度、何时提问、何时主动推进,这不像是在编写提示词,更像是在撰写一份岗位描述。我们正越来越像“AI产品经理”,而非“AI驯兽师”。

OpenAI发布这份指南,表面上是帮助用户更好地使用GPT-5.5,但也在悄然传递一个信息:下一个阶段的AI应用,核心在于如何界定工作边界,而非如何填满指令细节。

相关攻略

想要通过Recraft API批量测试同一提示词,生成多个图像版本进行效果对比?如果仅采用简单的循环调用,很容易出现输出重复、参数错乱或结果难以追溯的问题。无需担心,以下这套系统化的操作流程,将帮助您实现可控、可复现的批量生成与效果评估。 一、创建包含变量占位符的多版本Prompt模板 首先,需要将

小米推出米家智能洗碗机Pro嵌入式18套新品,定价6999元,国补后价格更低。产品提供银白两色,采用三重喷臂与五重涡流系统,59分钟完成强力洗涤。配备450ml智能投放舱,一次添加可使用三周。支持独立烘干消毒,并能将洗涤进度投影至地面,方便查看。三层碗篮最多可清洗130件餐具,满足家庭及聚会需求。

苹果为AirPodsPro3推送了8B40版本固件更新,通常此类更新旨在修复问题并提升性能。更新过程基本自动完成,用户只需将耳机置于充电盒内并连接电源,在设备蓝牙与Wi-Fi范围内等待约30分钟即可。按照惯例,后续该固件也将推送给AirPodsPro2和AirPods4。

苹果M4芯片的普及加速了本地AI部署。开发者在24GB内存的M4MacBookPro上优化部署Qwen3 5-9B模型,实现每秒40个token的生成速度,为离线办公与隐私敏感场景提供了高效可控的解决方案。测试显示,9B量化版本在内存占用、推理能力及长上下文支持上达到最佳平衡,经参数调优后性能显著提升。

近日,数学界流传出一则足以载入史册的轶事。剑桥大学教授、菲尔兹奖得主 Timothy Gowers 在其个人博客中分享了一段震撼经历:他借助一款尚未公开发布的 AI 模型——ChatGPT 5 5 Pro,在短短一小时内,攻克了一个困扰数学界已久的组合数学开放性问题。 长期以来,学术界对大型语言模型

热门专题

热门推荐

2026年4月15日,一部名为《秦岭青铜诡事录》的短剧正式上线播出。这部剧集的独特之处在于,其两位主演并非真人演员,而是由耀客传媒自主研发的AI数字人演员。这标志着AIGC技术在国产影视剧制作中的应用,实现了从“辅助工具”到“内容主体”的关键跨越。 该剧剧情充满奇幻悬疑元素,核心故事围绕秦岭矿区一桩

5月12日,日本5年期国债收益率升至1 915%的历史新高,反映市场对其货币政策走向的重新定价。收益率上升通常源于利率预期改变,可能预示投资者正消化未来央行调整超宽松政策的可能性。这一变动会影响全球资本流动与外汇市场,为全球宏观投资增添新的观察变量。

韩国政府拟设立“公民红利”机制,将人工智能产业超额利润以现金或消费券等形式分配给全体国民。政策室长金容范表示,AI收益依托国家产业基础,应由全民共享,避免过度集中于少数企业与个人。资金计划来自超额税收,而非直接抽取企业利润,旨在让民众直接获益。

2026年5月,北美汽车市场迎来关键转折点。自年初起,加拿大政府将中国产电动汽车的进口关税从100%大幅调降至6 1%。这一重大政策调整正迅速重塑市场格局,如今,首批来自中国品牌的纯电动及插电混动车型已成功登陆加拿大,开启了全新的竞争篇章。 社交媒体上的实拍视频提供了有力佐证:在加拿大多伦多的停车场

CleanSpark第一季度营收1 364亿美元,同比下降约24 9%。净亏损达3 783亿美元,较去年同期显著扩大。公司持有现金2 603亿美元,所持比特币总价值达9 252亿美元。总资产29亿美元,总负债19亿美元,股东权益为10亿美元。