英伟达与台积电如何从AI热潮中持续获利 下游大模型公司盈利分析

AI价值链正在经历结构性重估

AI产业的利润版图,正在发生一场静默但深刻的迁移。过去几年,赚走行业大部分利润的芯片巨头们,正面临来自下游模型厂商的快速追赶。但故事远未结束,产业链上游的利润空间,其实远未触及天花板。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

专业机构SemiAnalysis的分析揭示了一个关键转折:Anthropic的年化收入在短短数月内,从90亿美元飙升至超过440亿美元,其推理业务的毛利率更是从38%跃升到70%以上。相比之下,英伟达当前的定价策略,仍然固守以成本为导向的传统框架,尚未充分反映智能体(Agentic)推理工作负载带来的全新经济学。一旦这个框架得以调整,英伟达的系统定价具备超过40%的上调潜力。同样,处于制造环节顶端的台积电,其N3制程产能也正站在价值重新分配的风口浪尖。

支撑这一判断的核心逻辑,在于供需两端出现了持续的结构性错配:台积电的N3制程预计到2026年下半年利用率将突破100%,DRAM工厂的产能利用率也已超过90%,而市场对前沿模型生成Token的需求,仍在以复合速度疯狂扩张。在这种背景下,英伟达通过其创新的SOCAMM内存模块实现差异化定价的时间窗口,已经悄然打开。

AI价值洼地转移:基础设施层让位于模型层

回顾2023年到2025年初,AI价值链的利润几乎毫无悬念地积聚在基础设施层。英伟达率先引爆市场,随后,电力资产如Vistra与GE Vernova在2024年分别上涨了265%和146%,存储厂商如SanDisk、西部数据、希捷和美光,在2025年更是集体实现了超过200%的涨幅。

这一繁荣景象的另一面,是模型创建者和推理服务商长期承受的低毛利困境。在那个阶段,AI的实际应用价值有限,市场对其投资回报率的质疑声不绝于耳。

真正的转折点出现在2025年12月。随着智能体AI(Agentic AI)从概念走向大规模实用,整个AI的经济逻辑被彻底改写。SemiAnalysis披露,其自身的年化Token消耗支出,已经接近员工薪酬总额的30%,平均每名员工每月消耗的Token量接近50亿个,这一数字是Meta内部人均用量的5倍以上。大量原本需要初级分析师耗费数小时才能完成的工作——比如财务建模、数据可视化、盈利分析——如今只需花费数美元的Token成本即可高效解决。

据SemiAnalysis估算,其团队在Anthropic Claude上的年化支出峰值曾达到1095万美元,但由此带来的竞争壁垒和效率提升,其价值远超这笔成本。Anthropic因此直接受益:其年度经常性收入从90亿美元飙升至440亿美元以上,推理毛利率从38%大幅提升至超过70%。

Token成本骤降,模型厂商利润率扩张具有持续性

推动模型厂商毛利率飞跃的另一个核心引擎,是Token生产成本的急剧下降。

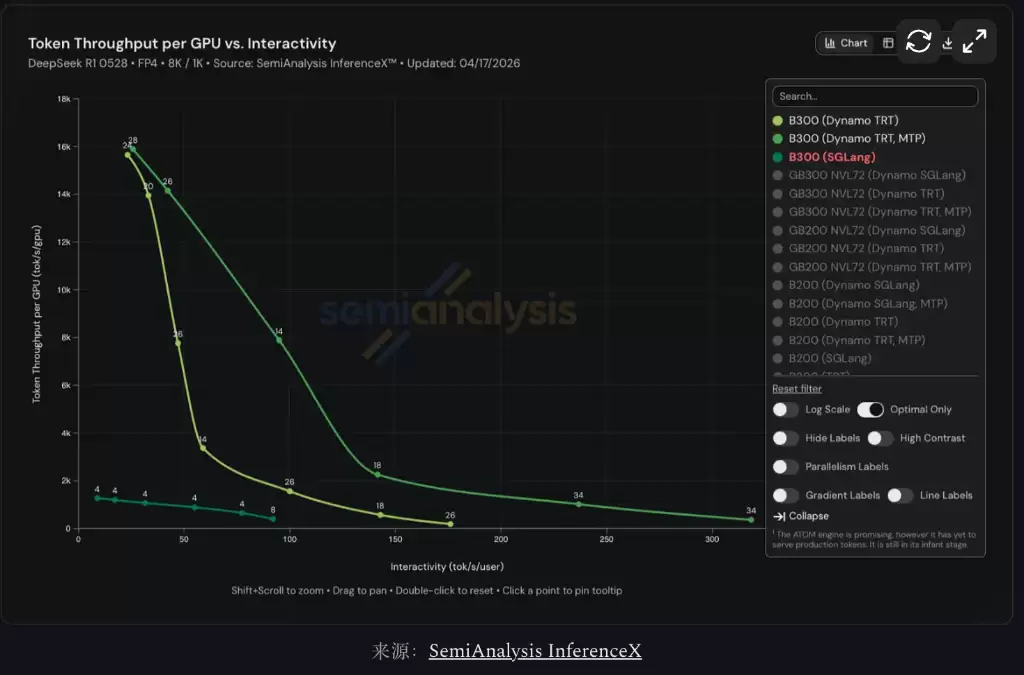

从硬件性能看,在一项标准的8K输入、1K输出的推理任务上,经过完整软件栈优化(包括宽EP、计算与预取分离、多令牌预测等技术)的B300系统,每秒每GPU可产生约14000个Token。相比之下,未优化的版本仅能产出约1000个——也就是说,在同款硬件上,仅软件优化就带来了14倍的吞吐量提升。如果再叠加硬件本身的升级,最优配置的GB300 NVL72系统相比上一代的H100,在FP8精度下的吞吐量提升约17倍;如果切换到H100原生不支持的FP4精度,性能差距更会扩大至32倍。而GB300每GPU的总拥有成本,仅比H100高出约70%。

从定价结构看,智能体工作负载具有极高的输入输出比(例如Claude Code的使用场景约为300:1)和极高的缓存命中率(超过90%),这使得绝大多数生成的Token都落入了最低的计费档位。SemiAnalysis估算,Opus 4.7模型在处理智能体任务时的真实混合成本,大约为每百万Token 0.99美元,远低于其标价的每百万输入Token 5美元。

因此,即便面对Anthropic对Opus系列进行的大幅降价——例如Opus 4.5的定价较之前降低了三分之二——SemiAnalysis认为Anthropic的单位毛利实际上不降反升:一方面,硬件升级和软件优化持续压低生产成本;另一方面,用户大规模从Sonnet等中端模型切换至Opus高端模型,推高了产品的混合平均售价。

更具战略意义的是,Anthropic在高端产品线上依然牢牢掌握着定价主导权。其Opus Fast版本的定价是常规Opus的6倍,而已经宣布的Mythos模型定价为每百万Token 25美元(输入)/125美元(输出),是常规Opus的5倍。SemiAnalysis明确表示,如果Anthropic愿意开放定价为每百万Token 150美元/750美元的Mythos Fast版本,他们仍然会购买——因为生产力提升所带来的价值,远远超过这部分成本。

模型厂商的定价权为何难以被竞争侵蚀

对于前沿模型的高利润率能否持续,最常见的质疑声音来自市场竞争。对此,SemiAnalysis给出了两个有力的反驳理由。

第一,顶尖的闭源模型与开源模型之间,仍然存在显著的能力差距,这种差距在短期内难以弥合。以Kimi K2.6(定价为每百万Token 0.95美元/4美元)为代表的低价开源模型,对Anthropic Opus的定价体系几乎构不成实质性的压制。

第二,算力约束意味着,任何一家前沿AI实验室都无法独自服务整个市场。Anthropic已经通过将Claude Code的月订阅门槛锁定在100美元以上、限制第三方接入等方式,主动管理需求侧。可以预见,在未来相当长一段时间内,Token需求将持续超出供给。这意味着,那些有能力提供真正前沿性能模型的实验室,完全可以按照Token所能创造的经济价值来定价,而非仅仅基于竞争性的成本。

英伟达的定价克制:监管逻辑还是战略误判

面对AI价值链的深刻重构,英伟达迄今为止尚未对其定价框架作出实质性调整,这本身就是一个值得玩味的结构性问题。

英伟达当前的定价仍然主要锚定在成本上,这反映的是一种“需求价值随时间递减”的旧范式——而这个假设在今天已经不再成立。当前的需求增长并非线性,而是以复合速度扩张,这由智能体工作负载的爆发和每个工作流程中Token消耗量的持续跃升共同驱动。

SemiAnalysis认为,英伟达保持定价克制,部分原因在于监管层面的顾虑。其在GPU、互联技术和软件栈上的绝对主导地位,已经引发了日益密切的反垄断审查。在下游AI实验室同样赚取高额利润的背景下,激进提价可能会加剧监管风险,也可能加速客户向谷歌TPU、亚马逊Trainium等替代计算平台分散。

从这个意义上说,英伟达的行为模式与台积电颇为相似。台积电长期以来,即便在满负荷运营、扮演先进制程供应瓶颈的情况下,也并未将定价提升至稀缺溢价的极限,而是优先维护整个生态系统的长期稳定与客户关系。这一逻辑可以概括为扮演“AI央&行”的角色——通过适度让利来支撑下游生态的扩张,而非最大化短期利润提取,从而确保自身在AI时代的长期主导地位。

然而,这一策略存在着真实的机会成本。在算力需求持续超过供给的结构性背景下,掌握稀缺资源却未进行充分定价,相当于将部分价值拱手让给了生态链的中游和下游参与者。台积电在N3制程上同样面临这个问题——SemiAnalysis直接指出这是一种“战略失误”,认为其至少应该要求更大规模的预付款安排。

Rubin定价空间:SOCAMM成为利润新杠杆

英伟达即将推出的Vera Rubin(VR NVL72)系统,提供了一个重新评估其定价框架的绝佳契机。

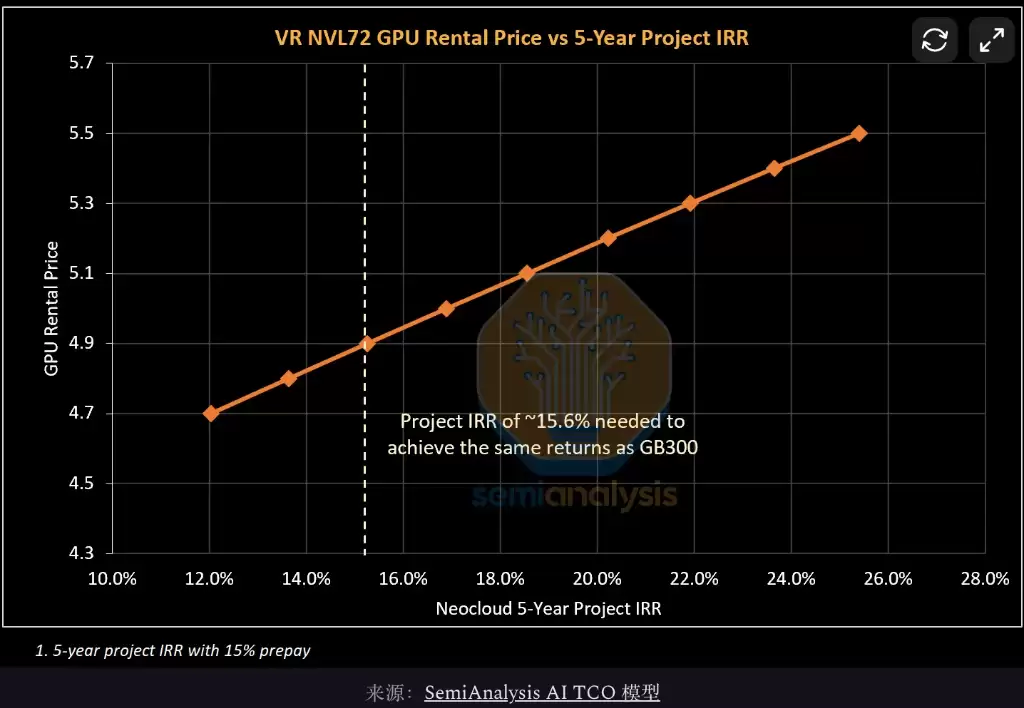

从成本端测算,VR NVL72要实现与GB300 NVL72相同的15.6%的项目内部收益率(基于5年期、15%预付款的假设),所需的最低GPU租金约为每小时4.92美元。然而,从价值端看,如果以FP8密集算力维度,锚定当前GB300每PFLOP(每秒千万亿次浮点运算)约0.70美元的租金,那么VR NVL72对应的理论最高定价可达每GPU每小时12.25美元,这大约是成本地板价的2.5倍。

这一巨大的价差表明,英伟达在VR NVL72的定价上拥有充足的上调空间。SemiAnalysis估算,即便英伟达将系统定价提升约40%,仍然可以为Neocloud(英伟达的云服务合作伙伴)保留足够的利润空间——即使Neocloud将租金提价至每小时8美元以上,其对应的每PFLOP成本仍然低于历史趋势线。

在具体操作机制上,SOCAMM成为了最关键的定价杠杆。与GB300将LPDDR5X内存直接焊接在主板上、嵌入整体系统定价不同,VR NVL72采用了可插拔的SOCAMM模块。这允许英伟达将内存作为独立的计费项目,进行单独列示和定价。

SOCAMM(小型化压缩附加内存模组)是英伟达主导,联合三星、SK海力士和美光等内存巨头开发的新型模块化内存标准。它基于LPDDR5X(或未来的LPDDR6)DRAM技术,专为AI服务器和个人AI超级计算机场景设计。

市场模型显示,英伟达在2026年第一季度支付的SOCAMM合同价格约为每GB 8美元,较上一季度大幅提升,这主要反映了LPDDR5X供应紧张和整体DRAM价格的上行趋势。基于对2026年底移动DRAM定价的预测,到2026年底SOCAMM的定价可能超过每GB 13美元,全年均值约10美元是一个合理的假设。

在此基础上,SemiAnalysis认为英伟达在SOCAMM上收取60%的毛利率具有充分的合理性:首先,内存供应全面紧张,英伟达在SOCAMM采购上享有优先获取权;其次,VR NVL72在性能与总拥有成本(TCO)维度远超同期竞品,客户缺乏可行的替代选项;最后,英伟达自身也面临着SOCAMM采购成本的大幅上涨,将成本压力向下游传导具有合理依据。

此外,内存定价不像GPU定价那样面临直接的反垄断顾虑,这给了英伟达更大的差异化定价操作空间——例如,对Neocloud与超大规模云厂商实施差别定价。目前,英伟达在网络设备上已经对Neocloud收取约为超大规模云厂商两倍的价格,同样的商业逻辑完全可以平滑地延伸至内存层面。

相关攻略

数字货币与Token:厘清本质,看懂生态中的两大支柱 踏入数字资产世界,“Token”和“数字货币”这两个词总是高频出现,乍看之下似乎可以混用,但深究起来,它们代表着截然不同的底层逻辑和生态角色。这种区别绝非文字游戏,而是理解整个区块链架构与应用的关键所在。今天,我们就来彻底拆解这两个概念,看看它们

本周比特币ETF净流入8 23亿美元,市场情绪升温 市场信心回来了吗?数据显示,本周比特币ETF净流入达到了8 23亿美元,并且呈现逐日增长的态势。与此同时,一个关键的市场情绪指标——Polymarket上关于比特币价格的合约,也创下了历史新高。截至6月30日的合约数据显示,市场认为比特币能达到某个

从一万到千万:币圈进阶的系统性心法 在数字货币的浪潮中,财富跃迁的故事总在发生。从一万本金到千万资产,这听似神话的路径,实则暗含一套可被拆解与复制的逻辑。它并非依赖运气,而是融合了赛道选择、仓位管理与心性修炼的完整体系。下面要探讨的,正是市场反复验证过的核心框架。 精选赛道的核心逻辑 首先,是寻找具

数字资产领域在香港经历了显著的发展,已然成为区块链创新和虚拟资产交易的重要枢纽 时至今日,香港的数字资产市场早已不是一片荒芜。它已经成长为连接东西方、汇聚创新与资本的关键节点。放眼2025年,各类数字货币交易所在这个充满活力的舞台上同台竞技,它们各展所长,为全球用户提供着截然不同的服务与体验。那么,

区块链:数字货币的基石与变革引擎 谈起数字货币,总绕不开它底层的那个神秘支撑——区块链。这项技术远不止是一个流行词,它正以一种静默却深刻的方式,重塑着我们关于价值存储与转移的认知。对于刚刚踏入这个领域的朋友而言,厘清区块链与数字货币的关系,无疑是把握其内在价值与未来走向的关键一步。那么,区块链究竟是

热门专题

热门推荐

《CLARITY法案》奖励机制文本公布,经协商达成折中:传统银行业获更多奖励限制,加密行业则确保美国用户仍可通过使用平台获得奖励,维护了用户参与和行业创新动力。此举有助于美国保持金融竞争力和国家安全利益。随着争议暂歇,法案将转向整体推进。

Linux 下的 Rust 工具链全景 想在 Linux 上愉快地写 Rust?一套趁手的工具链是关键。这份全景指南,帮你梳理从核心工具到开发辅助,再到环境配置的完整地图,让你快速上手,避开那些常见的“坑”。 一 核心工具链与用途 Rust 的工具链生态相当成熟,各司其职,共同构成了高效的工作流。

Rust 在 Linux 下的性能调优方法 想让你的 Rust 应用在 Linux 系统上飞起来?性能调优是个系统工程,从编译构建到系统层面,环环相扣。下面这份指南,将带你系统性地走完这个流程。 一 构建与编译优化 一切从构建开始。编译器的优化选项,是释放性能潜力的第一道闸门。 使用发布构建:这是基

在Linux中使用Rust进行网络编程 想在Linux环境下用Rust玩转网络编程?其实没那么复杂。跟着下面这几个清晰的步骤走,你就能快速搭建起一个可运行的基础框架。当然,这只是一个起点,Rust生态提供的工具远比这里展示的要强大。 1 安装Rust 万事开头先装环境。如果系统里还没有Rust,一

Rust为Linux系统带来跨平台能力的机制 想让同一套代码在Linux、Windows、macOS上都能顺畅运行?Rust给出的方案相当优雅。它通过一套统一的工具链、一个精心设计且可移植的标准库,再加上灵活的条件编译机制,让跨平台构建从理论变成了标准流程。更妙的是,基于LLVM的交叉编译体系和清晰