DeepSeek发布多模态推理新技术:以“视觉原语”思考,突破“指代鸿沟”

5月1日,DeepSeek在GitHub上发布了一份引人注目的技术报告,题为《Thinking with Visual Primitives(以视觉原语思考)》,同时公开了其全新的多模态推理模型。

这项技术基于DeepSeek V4-Flash架构构建,这是一个总参数量达2840亿、推理时激活130亿参数的混合专家模型。其核心,在于提出了一种碘伏性的多模态推理新范式。

报告一针见血地指出了一个长期被忽视的根本瓶颈——“指代鸿沟”。简单来说,现有模型虽然能“看见”图片,但在用自然语言进行内部推理时,问题就来了。当思维链中间出现“左边那个大的、靠近中央的红色物体”这类模糊描述时,在复杂密集的场景中,模型的注意力很容易“漂移”,导致指代对象混乱,最终得出错误结论。

以往,业界的思路大多集中在提升视觉感知的分辨率上。但这份报告提出了一个关键洞见:“看见”和“能说清楚在说哪个”,完全是两码事。感知再清晰,若推理过程无法精确定位,也是徒劳。

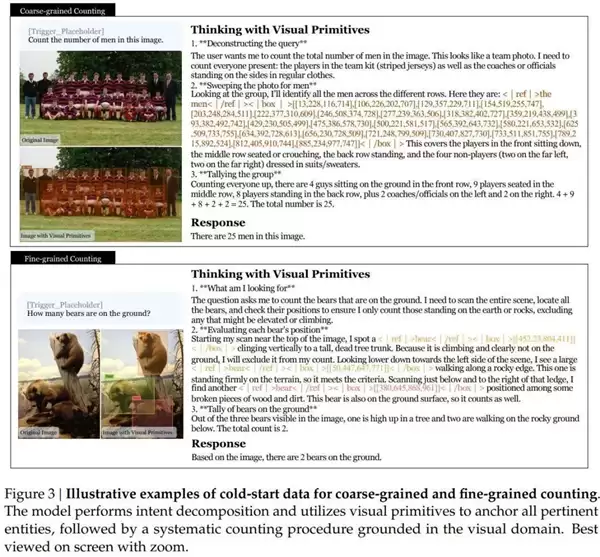

那么,DeepSeek的解法是什么?答案是:将空间坐标直接嵌入思维链。模型的核心创新在于,让点坐标和边界框成为推理过程的基本单元。模型在思考中每提及一个视觉对象,便会同步输出其坐标,将空间信息作为消除歧义的“锚点”。

这就好比推理过程有了精确的“空间坐标笔记”。例如,模型的思维链可能是这样的:“找到一只熊[452,23,804,411],它正在爬树,排除;再往左下角看,找到另一只[50,447,647,771],它站在岩石边缘,符合条件。”在这里,坐标不再是事后标注的答案,而是驱动推理、确保每一步都指向正确目标的关键工具。

为了实现高效推理,模型在架构层面实现了惊人的视觉压缩效率。一张756×756的图片,经过视觉Transformer处理后,会生成2916个图像块token。随后,通过3×3的空间压缩合并为324个token,再经由压缩稀疏注意力机制,将键值缓存进一步压缩4倍。最终,仅用81个视觉KV条目即可表征整张图片。

这个数字有多极致?不妨做个对比:处理同样尺寸的图片,Claude Sonnet 4.6大约需要870个条目,而Gemini-3-Flash则需要约1100个。DeepSeek的方案在效率上优势明显。

强大的能力离不开高质量的数据。研究团队从近十万个目标检测数据集中,精心筛选出约3.17万个高质量数据源,并由此生成了超过4000万条训练样本。这些数据重点覆盖了计数、空间推理、迷宫导航和路径追踪四类核心任务。

在训练策略上,团队采用了“先专家化,后统一”的两步走方案。首先,分别训练擅长边界框预测和点坐标预测的两个专家模型;随后,通过强化学习进行优化,并最终利用在线策略蒸馏技术,将两者融合为一个统一的强大模型。

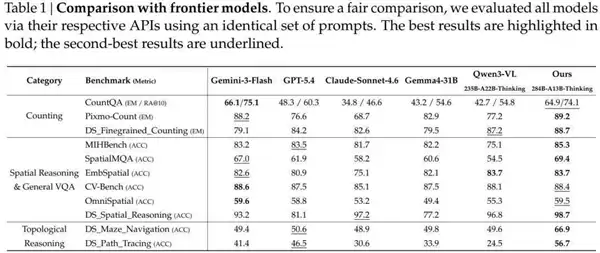

效果如何?实验部分给出了答案。模型在11个基准测试上,与Gemini-3-Flash、GPT-5.4、Claude Sonnet 4.6等主流模型进行了全面对比。

在计数任务上,模型在Pixmo-Count基准上的精确匹配得分达到89.2%,超越了Gemini-3-Flash的88.2%,并大幅领先于GPT-5.4的76.6%和Claude Sonnet 4.6的68.7%。

更具代表性的差距出现在拓扑推理任务上。在迷宫导航任务中,模型得分达到66.9%,而GPT-5.4为50.6%,Gemini-3-Flash为49.4%,Claude Sonnet 4.6为48.9%,领先优势约17个百分点。在路径追踪任务中,模型以56.7%的得分,领先于GPT-5.4的46.5%。这些数据清晰地展示了“视觉原语”在复杂空间推理上的独特优势。

当然,报告也客观指出了当前模型的局限性。例如,模型需要明确的触发词才会启用视觉原语机制;在极细粒度的场景下,坐标精度仍有提升空间;模型的跨场景泛化能力,也是未来需要持续优化的方向。