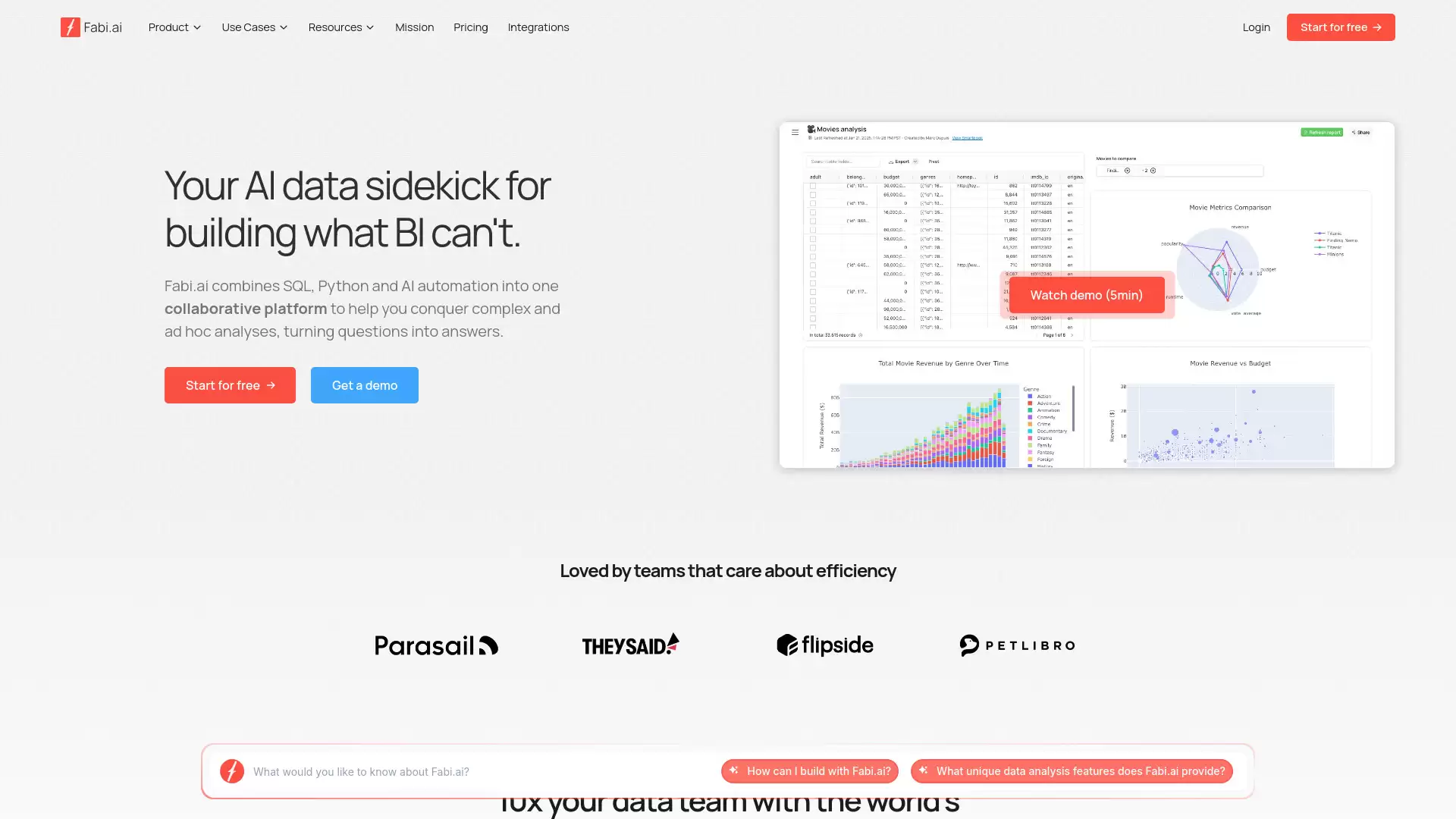

Fabi.ai- 由人工智能驱动的数据分析平台

在数据驱动的决策时代,企业每天都要面对海量信息。如何快速从复杂数据中提取有价值的洞察,而不必在技术工具和漫长流程中耗费精力?这正是许多团队面临的普遍挑战。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

什么是Fabi.ai?

简单来说,Fabi.ai 是一款旨在解决上述痛点的智能数据分析平台。它将传统的 SQL查询、Python编程能力与现代人工智能自动化技术深度融合,打造了一个高效的协作环境。其核心目标很明确:帮助用户轻松攻克那些耗时费力的临时性分析任务,将复杂的数据问题迅速转化为清晰的行动答案。为了实现这一点,平台集成了诸如分析师助手、智能工作簿、自动化报告和可视化工作流等一系列功能,从根本上简化了从数据到洞察的全过程。

如何使用 Fabi.ai?

上手过程非常直接。新用户只需注册一个免费账户,上传自己的数据文件,即可开始利用AI探索数据中的模式与洞见。平台同时支持直接使用 SQL 进行数据查询,以及运用 Python 进行更高级的统计分析或建模。更值得一提的是,其贯穿全程的AI辅助功能,能在数据探索、代码编写乃至调试排错等多个环节提供实时支持,大大降低了专业分析的门槛。

Fabi.ai 的核心功能

平台的竞争力体现在几个关键模块上:首先是随时待命的分析师助手,能理解自然语言提问并给出分析建议;其次是交互式的智能书籍,将分析过程、代码和结果动态结合在一起;然后是自动生成的智能报告,可将分析结果转化为易于理解的叙述;最后是可定制的工作流程,能将重复性分析任务自动化。此外,平台还提供基于人工智能的数据丰富功能,并能无缝与 Google Sheets 和 Slack 等日常工具集成,确保洞察能顺畅融入团队的实际工作流。

Fabi.ai官网入口:https://www.fabi.ai

热门专题

热门推荐

要提升HDFS集群的稳定性,这些配置与优化思路值得关注 想让你的Hadoop分布式文件系统(HDFS)集群运行得更稳定、更可靠吗?这既是一项系统工程,也有一套清晰的优化路径——关键在于,你是否在硬件选型、参数配置、运维管理等核心层面都进行了系统性的规划与调优。下面这张图,可以帮助你快速建立起一个关于

HDFS副本策略调整指南 一 核心概念与层级 要玩转HDFS的副本策略,得先理清几个核心概念。它们像齿轮一样层层咬合,共同决定了数据最终落在哪里。 副本因子:这个最好理解,就是一个数据块要存几份。它直接决定了数据的可靠性和存储开销,默认值是3,算是可靠性与成本之间的经典平衡点。 副本放置策略:这是N

HDFS:一个为容错而生的分布式文件系统 在分布式存储领域,数据的安全性与可靠性是系统设计的核心。HDFS(Hadoop分布式文件系统)之所以能成为大数据生态的基石,关键在于其设计了一套多层次、自动化的容错机制。这套机制确保了在硬件故障、网络异常等常见问题发生时,数据依然保持完整且服务持续可用。本文

在HDFS中设置合理权限:一份实战指南 在Hadoop分布式文件系统(HDFS)中,权限管理绝非小事。它直接关系到数据的安全底线和系统的稳定运行。那么,如何为HDFS中的文件和目录设置一套既安全又实用的权限规则呢?下面这份指南,或许能给你带来清晰的思路。 1 基本概念 在动手之前,先得理清几个核心

在Hadoop分布式文件系统(HDFS)中实现数据压缩 处理海量数据时,存储成本与传输效率是两大核心挑战。HDFS提供了多种数据压缩方案,能够有效降低存储空间占用并提升数据处理性能。本文将详细介绍在HDFS中启用和配置数据压缩的几种实用方法。 1 配置文件设置 最直接且全局生效的方式是通过修改Ha