【OpenClaw 本地实战 Ep.3】突破瓶颈:强制修改 openclaw.json 解锁 32k 上下文记忆

【OpenClaw本地部署实战教程Ep.3】如何解决上下文超限报错:手动修改openclaw.json配置文件解锁32K长文本记忆

摘要:

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

本文是OpenClaw本地化部署系列教程的第三篇。许多用户在成功连接本地大语言模型后,进行复杂任务时常遭遇Context window too small错误。其根本原因在于OpenClaw对未识别的本地模型默认施加了4K上下文长度限制。本教程将详细指导您如何通过修改配置文件,利用合并模式强制解锁32K甚至更大的上下文窗口,彻底解决AI智能体“记忆力不足”的问题。

标签:

OpenClaw教程 上下文窗口 ContextWindow超限 参数配置优化 JSON配置文件修改 本地模型调试 LM Studio 长文本处理

问题背景:连接成功后遭遇的上下文瓶颈

通过上一篇教程的指引,您应该已经成功将OpenClaw连接到本地LM Studio服务。初始的简单对话或许运行顺畅,响应迅速,给人以一切就绪的假象。

然而,当您开始委派实际的智能体任务时,例如“请读取src目录下全部源代码并生成一份README.md文档”,问题便出现了。系统可能会短暂运行,随后抛出一个红色的错误提示:

❌ 错误:嵌入式智能体在执行前失败:模型上下文窗口过小(4096个词元)。最小需求为16000个词元。

这是怎么回事?

您的RTX 3090显卡拥有24GB的充足显存,在LM Studio中加载的模型明明支持32K甚至128K的上下文长度,为何OpenClaw却判定其仅有4096个词元的“短记忆”?

这正是本文要核心解决的 **“记忆力封印”** 难题。

一、 故障原理:被系统误判的本地模型

问题的核心机制如下:OpenClaw在启动时,会通过API接口询问LM Studio:“您当前运行的是哪个模型?”

LM Studio会如实回复模型标识,例如:“openai/gpt-oss-20b。”

但问题出在OpenClaw的模型识别库。对于其内部数据库未收录的“未知”本地模型,出于系统稳定性的保守策略,OpenClaw会统一为其套上一个默认的、极小的上下文窗口——通常仅为4096个词元。

我们可以做一个比喻:您手中明明是一台性能卓越的超级跑车(支持32K上下文),但系统错误地将其识别为一辆低速的代步车(仅4K),并自动为其限制了油门,导致强大性能无从发挥。

因此,我们的解决方案就是通过修改配置,明确告知OpenClaw系统:“请信任我的设定,这台模型完全能够处理32000词元的上下文。”

二、 关键步骤:强制覆盖模型上下文参数

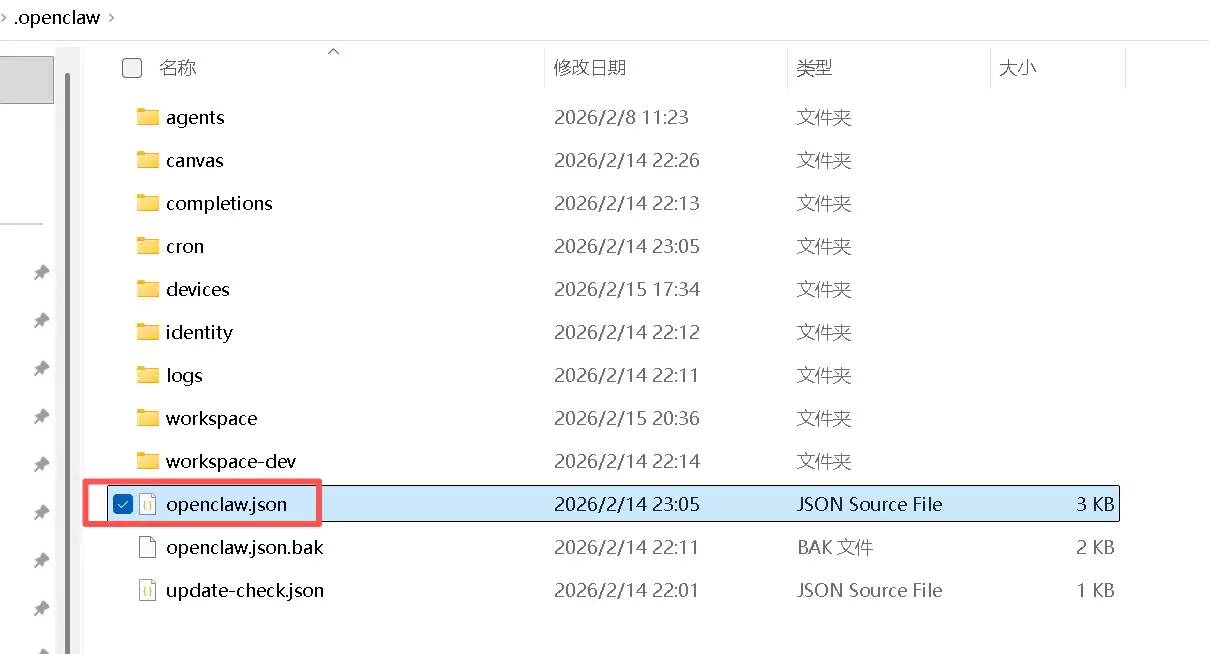

操作的核心文件依然是openclaw.json。请准备好您常用的代码或文本编辑器。

1. 定位并打开配置文件

根据您的运行环境,配置文件通常位于以下路径之一:~/.openclaw/openclaw.json 或 ~/.openclaw-dev/openclaw.json。请根据您的安装方式选择。

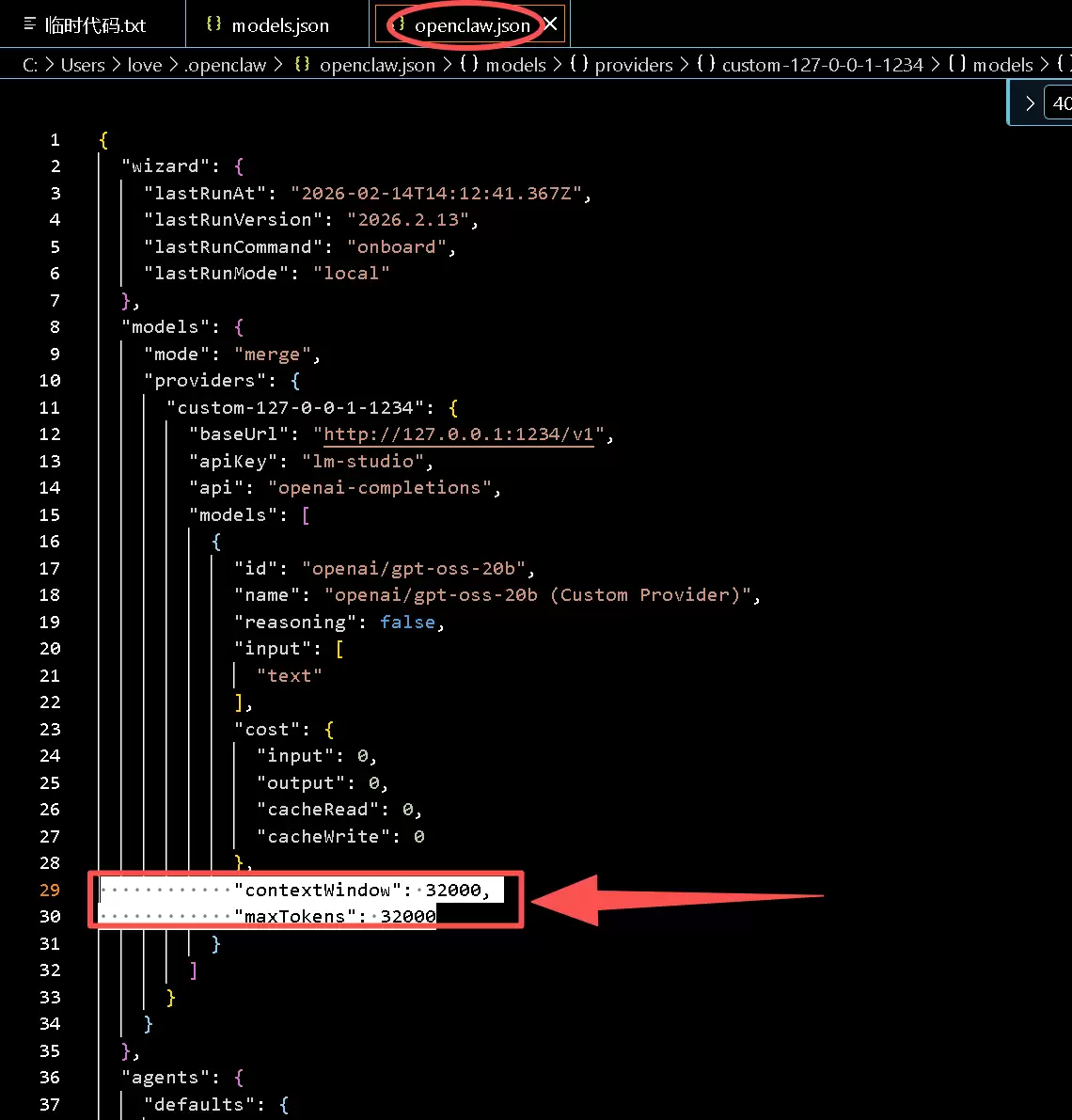

2. 插入关键配置代码

这里需要利用OpenClaw配置系统的一个高级功能:mode: “merge”(合并模式)。此模式允许我们手动定义的参数覆盖系统自动检测的结果。

具体操作为:在配置文件中定位到models字段,将其修改为如下结构。请特别注意核对contextWindow(上下文窗口)和maxTokens(最大生成词元数)这两个关键参数的数值:

{

"models": {

"mode": "merge", // <—— 关键:声明以我的配置为准进行合并覆盖

"providers": {

"custom-127-0-0-1-1234": {

"baseUrl": "https://127.0.0.1:1234/v1",

"apiKey": "lm-studio",

"api": "openai-completions",

"models": [

{

"id": "openai/gpt-oss-20b", // 必须与LM Studio中加载的模型ID完全一致

"name": "Local RTX 3090 Power",

"reasoning": false,

"input": [ "text" ],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

// ⬇️ 核心修改参数在这里 ⬇️

"contextWindow": 32000,

"maxTokens": 32000

}

]

}

}

},

// ... 配置文件的其他部分请保持不变

}

3. 注意事项:为何不要修改 models.json?

细心的用户可能注意到OpenClaw目录下还有一个models.json文件。

这里必须特别强调:请勿直接修改此文件。models.json实际上是系统运行时生成的“缓存文件”。每次重启网关服务,OpenClaw都会重新扫描模型并覆盖此文件,导致您手动调整的参数被重置为默认的4096。只有修改openclaw.json这个源头配置文件,更改才能永久生效。

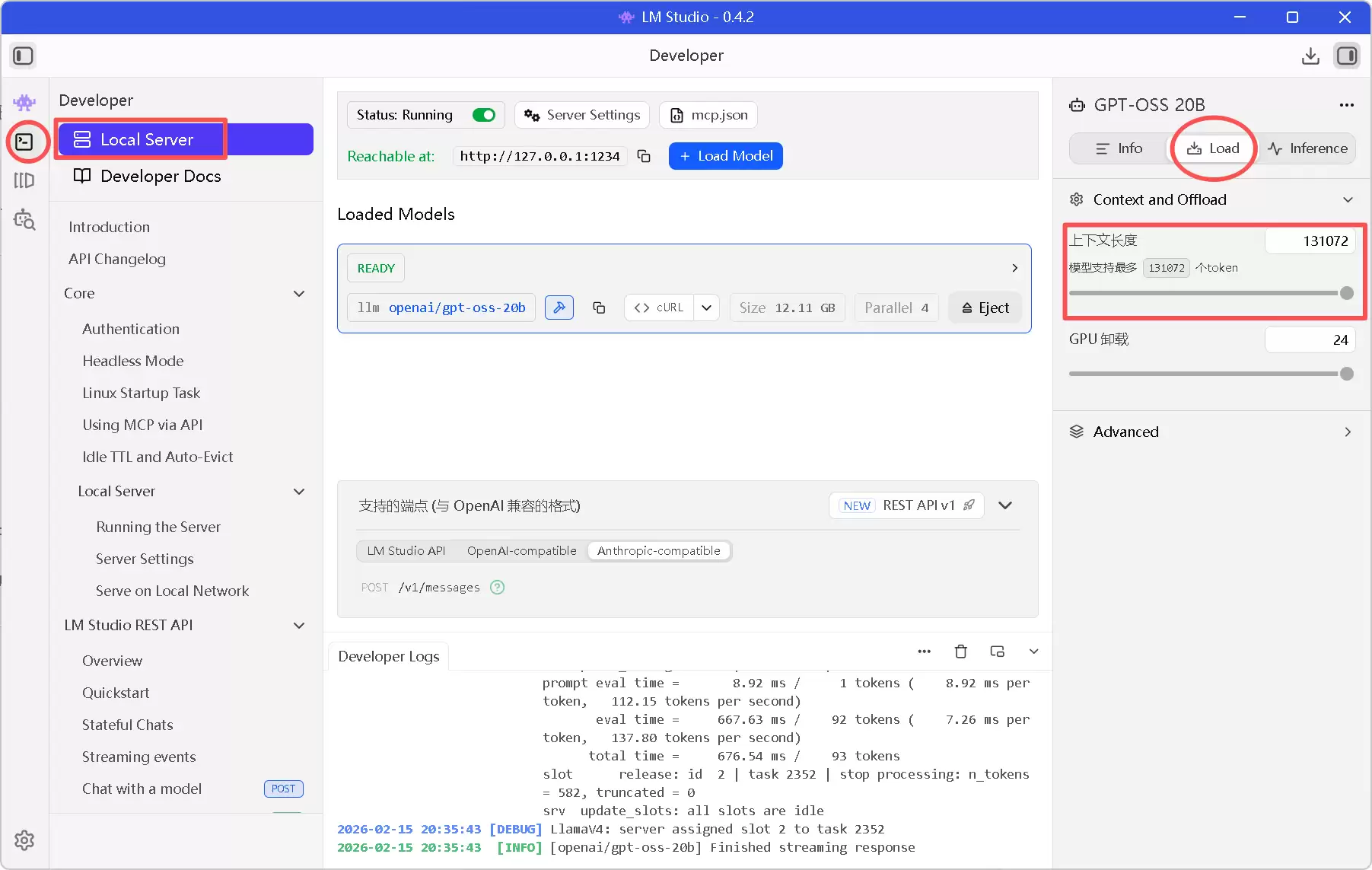

三、 服务端同步:配置LM Studio的上下文长度

仅仅在OpenClaw端解除限制是不够的。作为实际提供推理服务的LM Studio,也必须配置为使用足够大的上下文窗口,否则在实际运算时仍可能触发显存溢出等错误。

操作非常简便:回到LM Studio图形界面。

在右侧侧边栏中找到 **“Context Length”(上下文长度)** 调节滑块(通常位于“Model Options”模型选项区域内)。

请确保将该滑块调整到您的硬件所能承载、且模型本身支持的最大值。

重要提示:以RTX 3090显卡运行200亿参数模型为例,开启32K上下文预计将占用18-20GB显存,请务必根据自身的硬件配置合理设置。

四、 效果验证:测试长文本处理能力

保存好openclaw.json配置文件后,需要重启OpenClaw网关服务以使更改生效:

pnpm openclaw gateway

如何验证修改是否成功?最直接的方法是进行压力测试:在聊天界面中提交一篇冗长的技术文档,或者直接要求智能体分析整个项目的源代码目录结构。

如果任务能够流畅执行,不再出现先前的上下文超限错误,并且在系统日志中观察到智能体正在平稳处理海量词元,那么恭喜您,您本地模型的“记忆封印”已被成功解除!

五、 系列预告:解决Token鉴权问题

至此,您的本地AI开发环境已经获得了强大的处理能力:

✅ **计算性能**:本地NVIDIA显卡全力驱动推理

✅ **服务连接**:与本地LM Studio推理服务稳定对接

✅ **记忆容量**:32K长上下文处理毫无压力

然而,在高频使用和调试过程中,您可能会遇到一个新的困扰:每次重启OpenClaw网关,系统都会动态生成一个新的设备令牌。一旦在浏览器中刷新页面,或尝试从另一台设备登录,便会立即出现令人烦恼的unauthorized: device token mismatch(未授权:设备令牌不匹配)错误。每次都需返回终端复制一长串字符,体验非常不便。

因此,本系列的下一篇实战文章,将为您彻底解决这最后一个麻烦:

相关攻略

无线键盘按哪个键配对Windows? 很多朋友拿到新无线键盘,第一反应就是找那个“万能配对键”。其实,这事儿没那么神秘,也没有什么一键通吃的按钮。配对能否成功,完全取决于你的连接方式——是走蓝牙,还是用2 4GHz接收器——以及你手上这把键盘的品牌和型号。不同的组合,触发配对模式的物理按键也完全不同

微软启动K2计划,旨在提升Windows 11游戏体验,对标SteamOS性能,解决更新问题,重夺PC游戏市场 点击了解详情! 说实话,最近几年在 Windows 11 上打游戏,体验确实有点不尽如人意。性能和易用性上的小毛病,几乎成了这个操作系统的“老熟人”。不过,好消息是,微软这次看起来是动真格

彻底清除Windows活动历史痕迹:一份不留死角的隐私清理指南 你的Windows电脑,可能比你想象中更“健谈”。每次使用时间线、浏览网页、打开文档,甚至只是点开某个应用,系统都在后台默默地记录着这些行为。这些活动历史痕迹,即便你没有选择同步到云端,也会完整地存储在本地设备上。如果不想让这些数字足迹

如何开启 Windows 11 的“窗口贴齐布局” 提升大屏多窗口排列效率方法 想在 Windows 11 里高效地排列多个窗口,用好“窗口贴齐布局”绝对是关键。这个功能的核心,在于激活系统内置的 Snap Layouts,再配合几种不同的触发方式,就能实现精准的分屏与协同填充。下面就来详细拆解一下

如何开启 Windows 11 的“极致性能”模式 释放电脑隐藏最高功耗限制 想让你的 Windows 11 火力全开吗?当进行视频渲染、实时音频处理或科学计算这类高负载任务时,系统默认的电源管理策略可能会成为瓶颈。为了释放 CPU、GPU 乃至系统总线的全部调度潜力,你需要启用一个系统预置但默认隐

热门专题

热门推荐

需求人群 无论是独立工作的个人,还是需要紧密协同的团队,如果你们正在寻找更高效的任务管理与协作方式,那么这款工具很可能就是为你准备的。 产品特色 它的核心能力,可以概括为几个关键的自动化与协同维度。 首先,是自动生成报告和洞察。告别手动整理周报或项目汇总的繁琐,系统能自动梳理进度,提炼关键信息,让你

需求人群 如果你对鸡尾酒感兴趣,无论是专业调酒师还是在家小酌的爱好者,BoozyBlend都能为你提供灵感。这个平台的核心,就是帮你探索新口味、学习调制技巧,并且根据你的独特偏好,创造出专属于你的那一杯。可以说,从入门到精通,它都能全程陪伴。 产品特色 那么,它具体能做什么?亮点主要集中在几个方面:

课灵PPT 是什么? 说到为教育工作者减负,如今市面上可选的AI工具不少,但能精准切中“课件制作”这个专业需求的,课灵PPT算是一个典型代表。它本质上是一个专为教育场景深度定制的AI智能PPT生成平台。无论是日常教学课件、公开课演示稿,还是家庭辅导材料、儿童启蒙内容,它都能一手包办。 其核心能力在于

需求人群 当思念无处安放,有些人选择借助科技的力量,延续那份未能尽述的温情。这款工具的核心用户,正是那些渴望与已故亲友进行某种形式沟通的人。它提供了一个私密的空间,让未尽的对话得以继续,让绵长的思念有一个具体的载体。 产品特色 那么,它具体能做什么?关键在于模拟对话体验。用户可以与基于已故亲友信息塑

iMini AI 是什么? 如果说 iMini AI 的“超级 AI 创作系统”是一个强大的创意引擎,那么其中的 Nano Banana Pro,无疑是这个引擎里一颗高性能的核心。它本质上是一个高级的 AI 图像生成器,但定位远超一个简单的文生图工具。通过整合新一代的图像与视频生成模型,再配上庞大的