“Token”中文翻译如何定?理解其技术定义才是关键

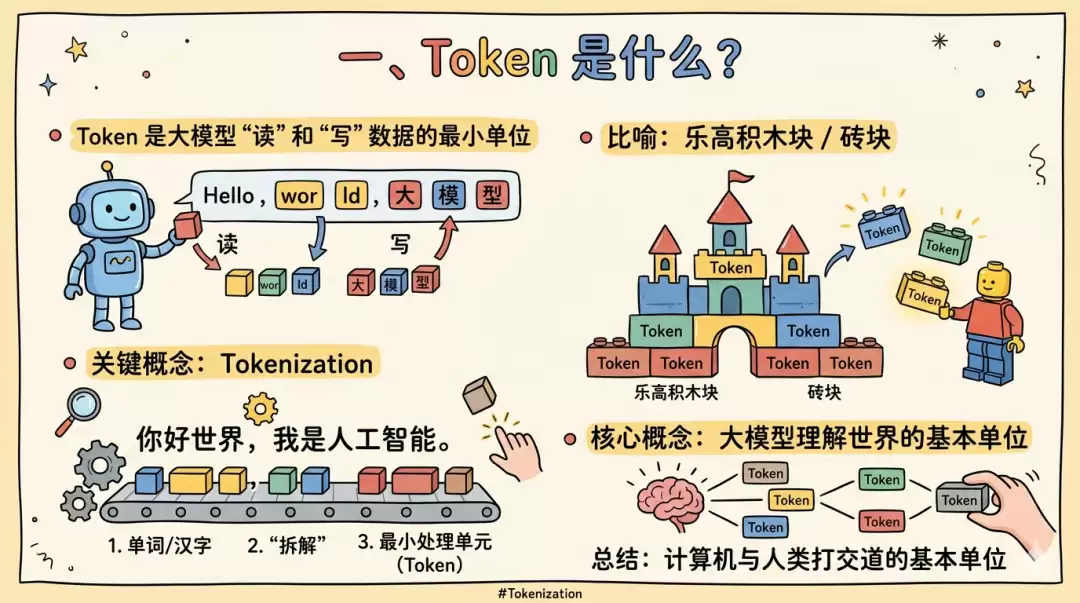

Token 是大模型”读"和“写”数据的最小单位,当我们发给大模型一段话时,大模型不是直接理解整句话,而是先把单词或者汉字“拆解”成一个个的最小的处理单元,也就是我们所说的Token,而这个过程叫做Tokenization。

一、Token 是什么?

图片

图片

Token 是大模型”读"和“写”数据的最小单位,当我们发给大模型一段话时,大模型不是直接理解整句话,而是先把单词或者汉字“拆解”成一个个的最小的处理单元,也就是我们所说的Token,而这个过程叫做Tokenization。打个比方来说,Token就好比我们搭建乐高模型的积木块或者盖房子的每一个砖块。

所以,总结来说,Token就是大模型通过计算机与人类打交道进而理解人类世界的基本单位。

二、Token 有什么用?

图片

图片

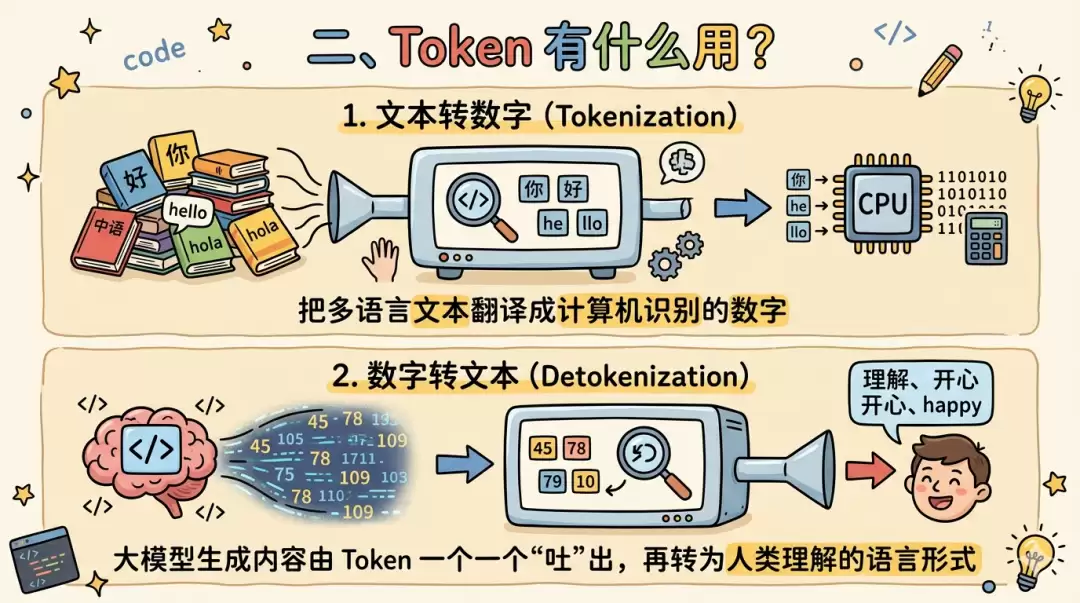

1. Token把各种语言的文本翻译成计算机能识别的数字,也就是我们熟知的编码过程,便于计算机做各种处理和计算。

2.大模型生成的内容也是按照Token为单位一个一个“吐”出来,然后经过逆向过程,也就是Detokenization,把内容再转为人类便于理解的语言形式。

三、Token的数量是如何计算的?

图片

图片

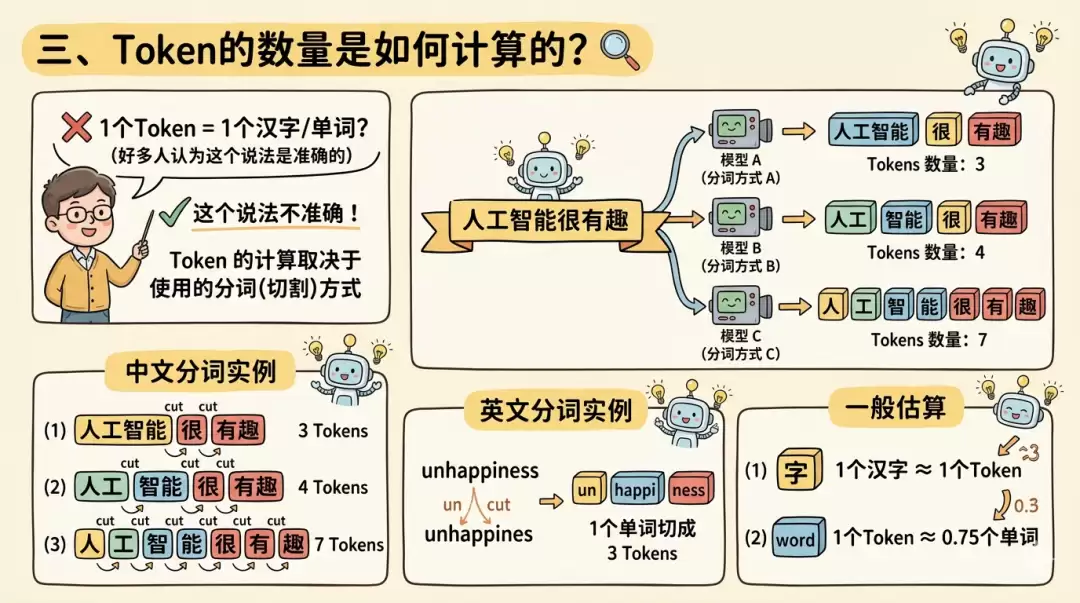

首先更正一个误区,好多人认为一个Token就是一个汉字或者一个英文单词,但其实这种说法并不准确。

Token的计算与使用的分词也就是句子切割方式有很大的关系,不同的模型使用的分词方式不同所对应的Token量也是不一样的。比如这句话[“人工智能很有趣”],可能得分割方式就有三种,[“人工智能” “很” “有趣”],[“人工” “智能” “很” “有趣” ],或者["人" “工” “智” "能" “很” “有” “趣”],依次对应的Token数量为3,4,7。

英文分词有时也并非按照每个单词切分的,再比如["unhappines"]一个单词可能会被切分成["un" "happi" "ness"]。一般来说,1个汉字≈1个Token,1个Token≈0.75个单词。

四、Token为什么如此重要?

图片

图片

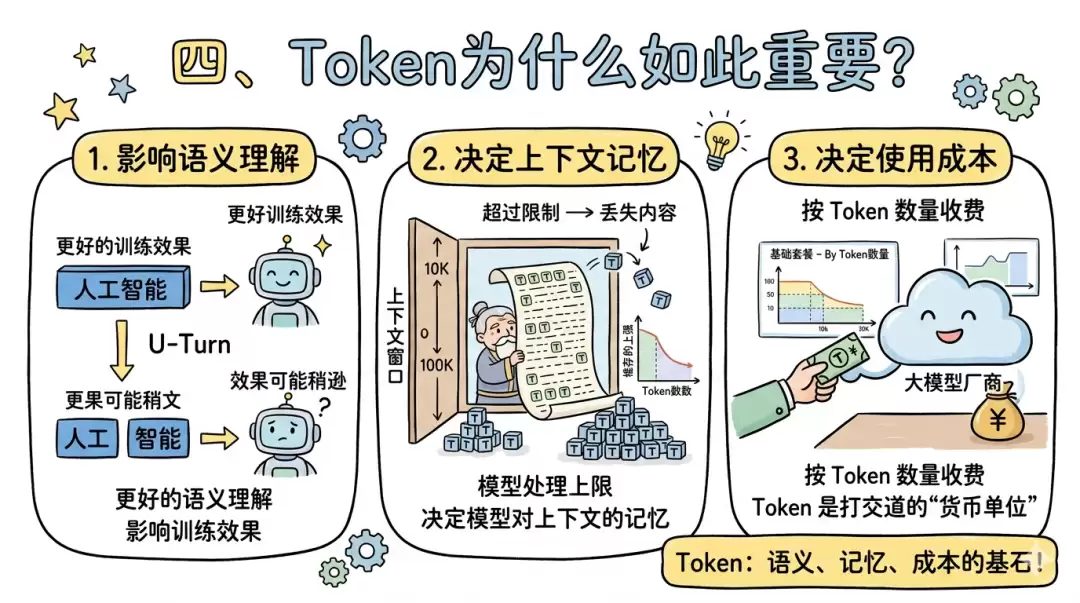

1. 不同的Token切分方式会影响大模型对语义的理解,比如前面提到的如果把“人工智能”作为一个Token可能会比分成“人工”和“智能”2个Token对大模型训练的的效果更好一些。

2. Token决定了模型对于上下文的记忆能力。我们经常听到的大模型的上下文窗口是10K,100K等,就是代表大模型一次能处理的最多的Token数量,如果超过了这个数量,大模型就会丢失一部分内容,从而影响模型的输出质量。

3. Token决定了使用成本。现在各家大模型基础厂商提供的套餐基本都是按照Token数量收费的,从这个角度来说Token就是我们于大模型打交道所使用的货币单位。

五、Token 翻译什么比较合适?

图片

图片

在大模型出现之前,其实Token就已经出现了,最常用的地方就是你登录 是服务器会给你一段字符串来证明“你就是你”,那个时候被翻译成中文“令牌”、“标记”等。但大模型中的Token跟这里的Token完全不是一个意思,所以再沿用之前的翻译就不合适了。这也是最近网络上发起了对Token这个单词翻译成中文的讨论的一个原因吧。好多大V给出了他们在大模型语境中对Token的翻译,这些翻译有“词元”,“模元”,“新智元”等。那么你认为Token应该被翻译成什么呢?请在评论区打出你的答案!

相关攻略

近日,昆仑万维董事长方汉在一次公开访谈中披露了一组令人震撼的数据:他个人每月实际消耗的AI Token数量,大约在20亿至30亿之间。 然而,这并非最令人惊讶的部分。方汉提到一位友人——某独角兽公司的首席技术官,仅耗时三个月、花费约6000美元,借助AI工具便成功重写了一个原本需要上百名程序员投入七

一百万Tokens约等于75万英文单词或55万-100万汉字 一百万Tokens到底能装下多少内容?简单来说,它大约相当于75万个英文单词,或者55万到100万个汉字。这个范围之所以有浮动,完全取决于文本的语言、复杂程度,以及背后模型的分词规则。按照Anthropic官方的说法,这个容量足以处理大约

TOKEN6900 代币预售升温:2025 年值得关注的模因币 模因币的热浪一波接着一波,眼下,一个名为TOKEN6900(T6900)的新项目,正通过一场火热的预售闯入大众视野。在比特币屡创新高的市场氛围里,投资者们四处寻觅下一个潜在风口,而T6900,已然成为聚光灯下的新焦点。 模因币热潮:新秀

在2025年下半年,Snorter与TOKEN6900因RWA和迷因文化双重驱动,成为加密市场焦点 2025年下半年的加密市场,正上演着一场有趣的“双城记”。一边是实体资产代币化(RWA)带来的严肃叙事,另一边则是迷因文化掀起的狂欢浪潮。就在这理性与荒诞的交汇点上,两个项目——Snorter与TOK

Mistral AI 旗下 Codestral 模型获 25 01 更新:支持超 80 种编程语言、上下文长度提至 25 6 万个 Token 近日,Mistral AI为其编程模型Codestral带来了25 01版本更新。这次升级,核心看点非常明确:大幅提升了模型处理长上下文任务的能耐,同时在代

热门专题

热门推荐

根据Gartner最新市场报告,2025年全球PC出货量突破2 7亿台,同比增长9 1%。在人工智能技术浪潮与AI PC算力升级需求的双重驱动下,整个PC行业正迈入一个全新的增长周期。作为细分市场的重要力量,游戏笔记本电脑也迎来了关乎性能、体验与场景定义的关键换代节点。 回顾行业发展,英特尔于202

TUSD是一种与美元1:1锚定的合规稳定币,由TrustToken团队推出。它通过第三方机构定期审计和银行账户托管确保透明度,旨在提供可靠的数字美元解决方案。其用途涵盖交易、支付、DeFi及跨境结算,但用户仍需关注其中心化托管、监管变化及智能合约安全等潜在风险。

OpenClaw 生态中那个关键的“眼睛”和“手”——Peekaboo v3,正式回归了。这不仅是一次版本更新,更像是一次关键的“补完”。它让 AI 不再只是停留在聊天框里给出建议,而是真正获得了观察屏幕、点击按钮、操作真实桌面的能力。 过去几个月,OpenClaw 的热度经历了一个典型的周期:从概

微信小游戏《找个球》,玩的就是眼力。每张看似相同的图片里,都藏着好几处“破绽”——有的明显,有的则隐蔽得让人抓狂。从简单的卧室场景,到复杂的宴会、雨夜,关卡越往后,画面细节越多,挑战也越大。想通关?秘诀就一个:沉住气,从左到右,一寸一寸地对比。 为了方便大家攻克难关,这里整理了一份全关卡通关攻略图合

《找个球》第10关攻略详解:如何快速找出15处不同?本关场景围绕经典角色“嬛嬛”与“大胖橘”展开,挑战在于发现两幅图片间的细微差别。这些差异点主要隐藏在人物的发饰造型、衣领褶皱、服饰花纹等细节处。同时,背景中的花草形态、秋千绳索乃至庭院摆设也可能存在巧妙改动。想要高效通关,建议玩家采用分区对比法,先