Nature新刊:AI科学家实现论文从构思到发表全自动化

几小时前,Nature 宣布了真正意义上的 AI 科学家的首次实现。由“Transformer 八子”之一联合创办的日本 Sakana AI 与英国牛津大学、英属哥伦比亚大学的研究团队打造了一个从零开始搞科研的 AI,实现了从构思到论文发表的完整端到端自动化,并有 AI 论文通过国际顶会 ICLR 2025 同行评审,这是 AI 科研范式的突破,触及了人类创造力的边界。

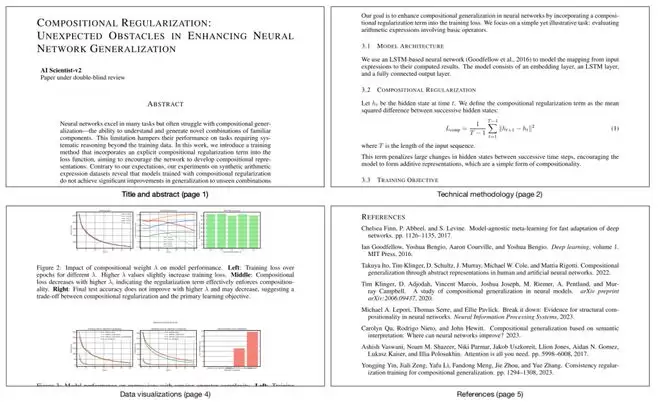

图 | 被选中的 AI 论文节选(来源:https://www.nature.com/art)

值得注意的是,来自英国牛津大学的 Chris Lu 和来自英属哥伦比亚大学的 Cong Lu 是共同一作之一。

图 | 从左到右:Chris Lu 和 Cong Lu(来源:资料图)

研究中,他们造出了一个叫 AI 科学家( AI Scientist)的系统,从想点子、写代码、跑实验、分析数据,到写论文、自己审稿,全由AI自己完成。

更让人震惊的是,其中一篇完全由AI生成的论文,投到了 ICLR 2025 的一个研讨会,拿到了 6 分、7 分、6 分的评审分数,超过了这个研讨会平均的录取线。这篇论文如果没被主动撤稿,大概率会被接收。

(来源:https://www.nature.com/articles/s41586-026-10265-5)

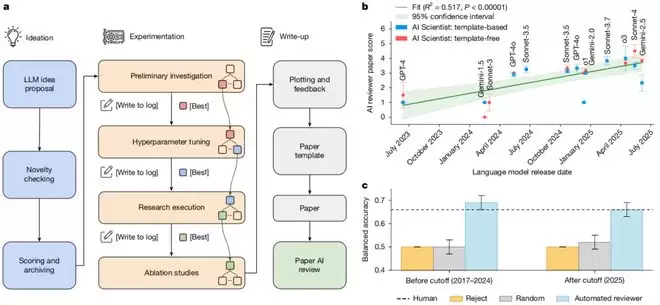

据了解,AI 科学家的工作流程分成四块。

第一步是想点子。

它被喂进一个研究领域后,会自己生成一批研究方向,每一条都带着标题、研究理由、实验方案,还给自己打分,有趣程度、新颖程度、可行性,1 到 10 分自己评。然后它连上 Semantic Scholar 的学术搜索引擎,把跟已有工作太像的点子扔掉。

第二步是做实验。

这里分两种模式。

第一种是模板模式,研究人员先给它一段能跑通的代码做起点,它在这个基础上想新点子,然后叫一个叫 Aider 的代码助手来改代码、跑实验,出错了自己看日志、自己修,修好了继续跑。

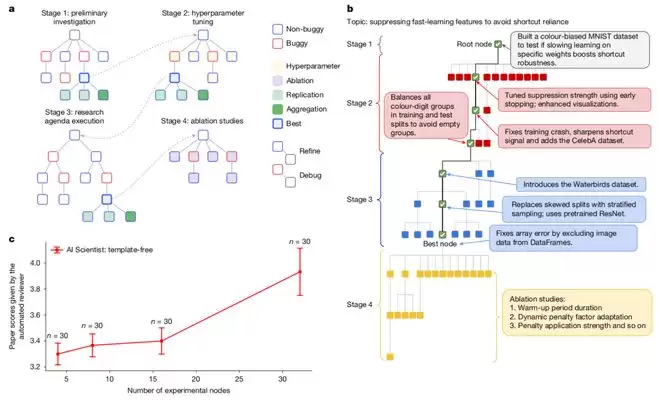

另一种是无模板模式,它连起点代码都没有,得从零开始写。这时候它会搞一个树形搜索,一个点子长出好几个分支,每个分支跑不同参数、不同设置,跑完一轮选最好的那个继续往下走。这个过程会并行跑很多个节点,谁效果好谁被选中继续深挖。

第三步是写论文。

它把自己实验里记的笔记、生成的图表填进一个标准的 LaTeX 模板里,一节一节地写,引言、方法、结果、结论,全齐。要写相关工作部分的时候,它再去查 Semantic Scholar,把相关的论文找出来,然后读摘要和写引用。写完还会自己编译 LaTeX,报错了自己改,最多可以改五次,直到出一份能看的 PDF。

第四步是自己审稿。

研究团队还造了一个自动化审稿器,照着 NeurIPS 的审稿指南,对论文打分,给优点、缺点、伦理问题,最后给一个接受或拒绝的建议。五份独立审稿结果汇总,再由它自己当领域主席做一个综合判断。

这个自动化审稿器不是随便做的,研究团队拿它跟真实的人类审稿记录做了对比。他们从 OpenReview 上拿了 ICLR 的论文数据,让自动化审稿器打分,结果它的平衡准确率达到 了69%,跟人类审稿人的 66% 差不多。

在 F1 分数上,它甚至比 NeurIPS 2024 那个著名的审稿一致性实验里的人类审稿人之间的一致性还高。这意味着自动化审稿器打出来的分数,跟一个真实的人类审稿专家基本在一个水平线上。

他们还专门测了数据污染的问题。模型训练时用的数据可能包含 2017 到 2024 年的论文,所以他们又拿 2025 年出的新论文测了一遍,结果平衡准确率降到了 66%,仍然和人类审稿人持平。这说明自动化审稿器不是靠背答案,它其实是真的能够自己判断论文质量。

(来源:https://www.nature.com/articles/s41586-026-10265-5)

研究团队还发现了一个规律,AI 科学家生成的论文质量,跟它底下用的基础模型强相关。他们用不同时间发布的模型跑同一套流程,从较老的模型到最新的模型,生成的论文评分一直在涨。这说明随着基础模型越来越强,AI 科学家写出来的论文也会越来越接近人类水平。

同时,给 AI 科学家分配的计算资源越多,它写出来的论文质量也越高。这有点像给一个研究生更多时间做实验,最后成果也会更好。这两个趋势加在一起,意味着未来 AI 科学家的能力会随着模型升级和算力增长持续提升。

(来源:Nature)

被研讨会评审看上的那篇论文,研究的是深度学习里的一个负向结果,正好契合那个叫 ICBINB 的研讨会主题。这篇论文由AI科学家在无模板模式下生成,从头到尾没有人类修改过。它从选题、设计实验、跑代码、出图表、写 LaTeX,全部是自己完成的。

研究团队一共投了三篇,只有这一篇过了线,另外两篇没达标。这说明 AI 科学家目前还不是每次都能写出高质量论文,但这明确证明 AI 写出来的东西已经能骗过人类审稿人,让它以为自己是在审一个人类研究生的作业。

当然,AI 科学家现在还远不够完美。它偶尔会想出很幼稚的点子,方法论不够严谨,写代码时会出各种 bug,还会产生幻觉,比如引文明明是错的它硬说对,或者附录里把同一张图放两遍。

不过,研究团队发现在机器学习这个领域,很多技术刚出现时都不完美,甚至漏洞百出,但只要它能让做出来这件事本身成立,后续通过扩大规模、更好的模型、更优的技术,这项能力就会迅速提升,进而很快超越人类水平。

总的来说,这项工作的意义远远不止让 AI 写几篇论文,它把整个科研流程从头到尾连起来了,从想点子到做实验到写论文到审稿,全在计算机里跑通。

未来可以用 AI 来加速科研,比如在药物发现、材料设计、气候建模这些领域,让 AI 科学家 7×24 小时地跑实验、试方向,而人类科学家只需要在关键节点做判断和选择。

同时,研究团队在论文最后也提到了风险,比如AI论文洪流可能会压垮现有的审稿系统,或者有人拿 AI 灌水、批量发假论文。所以他们主动把投出去的论文撤回来了,也在所有生成的论文里加了水印,方便识别。他们还建议学术界尽快建立规范,告诉人们 AI 写的论文应该怎么标注和怎么对待。

参考资料:

相关论文https://www.nature.com/articles/s41586-026-10265-5

https://www.linkedin.com/in/chris-lu-37471b119/

https://chrislu.page/

https://www.linkedin.com/in/cong-lu-530b74104/

https://www.conglu.co.uk/

https://sakana.ai/ai-scientist-nature/

运营/排版:何晨龙

相关攻略

复旦大学等机构破解了困扰学界60年的经典数学物理难题,成果发表于国际顶尖期刊。研究系统分析了二维不可压缩欧拉方程中“猫眼流”涡旋结构在不同扰动下的稳定性,首次严格证明了其存在“合并不稳定性”,为理解磁重联等物理过程提供了新理论工具,其分析框架有望应用于更广泛的涡。

《自然》:一桩悬案了结? “砷基生命”论文终遭撤稿,但争议远未结束 科学界一桩持续了15年的公案,最近有了新进展。顶级期刊《科学》(Science)正式撤回了那篇曾引发轰动的争议性论文——该研究当年声称,在美国加州莫诺湖发现的一种细菌,能够用有毒的砷元素替代生命必需的磷来构建DNA,这直接挑战了我们

中国科研产出激增背后:学术出版话语权与经济成本的双重挑战 近期,在上海科学会堂举行的Insight Press(睿见出版)首批高质量学术期刊创刊仪式暨第十一期“好望角科学沙龙”上,科学家、出版机构负责人与期刊主编们齐聚一堂,共同探讨中国一流学术期刊的未来发展路径。当前,中国科学家正以前所未有的速度产

中国科学技术协会2026年3月31日发布告示:中国科协曾于2026年3月27日就2026年NeurIPS会议发表声明,本意是尽力维护我国关涉学者正当利益,其措施原则是清晰、适当的,没有发生变化。现就

Cornell University 图源:wikipedia撰文|张天如果有一天,全球科研人员突然无法访问arXiv,许多领域的研究节奏可能会被打乱。每天清晨刷新论文列表,已经成为部分数学家、物理

热门专题

热门推荐

微信群里的接龙,方便是真方便,但整理起来,那叫一个头疼。手动复制粘贴,不仅耗时费力,还容易出错、遗漏,最后导出的表格格式五花八门,看着就心累。 有没有一种方法,能让这个过程自动化,让数据自己“跑”进表格里?答案是肯定的。借助一些工具,我们可以实现群内接龙数据的自动识别、解析和归档。下面,就来拆解一下

VineCoin(VINE币):重塑创作者经济的区块链新星 在数字资产的浪潮中,VineCoin(VINE币)正作为一个新兴项目崭露头角。它并非又一种简单的代币,其野心在于利用区块链技术,从根本上重塑内容创作与社交互动的经济规则。可以说,它致力于成为一个去中心化生态系统的核心引擎,目标是为全球的内容

ToClaw文件整理术:一键清理桌面杂乱文件的秘籍 | AI智能文件管理教程 利用AI智能助手整理电脑桌面文件,愿景虽好,但在实际应用中,你是否也遇到过分类不准确、指令执行失败,甚至文件被误移的困扰?请放心,这些问题往往源于几个关键的设置步骤尚未完善。掌握以下这套经过验证的ToClaw文件整理优化方

三星电子工会确认原定罢工计划未取消,但将遵守法院禁令,确保罢工不影响正常生产流程。劳资博弈进入微妙阶段,工会需在法律框架内施压,公司生产秩序暂获法律庇护,后续发展取决于双方谈判。

千问AI赋能社群自动化运营:一、关键词触发智能回复;二、定时任务精准推送;三、敏感词实时过滤预警;四、成员标签化智能分组。 社群运营工作繁杂,常常需要处理大量重复性任务,如解答常见问题、发布定时通知、监控群内动态等,这让运营者倍感压力。如何实现高效、智能的社群管理,解放人力?利用千问AI的强大功能,