不只是RAG变体!xMemory如何重新定义智能体记忆机制

xMemory 首次将“层级解构 + 信息论指导 + 不确定性扩张”整合成一个端到端的记忆检索框架,在智能体长程对话场景中全面超越了传统RAG方法。作者已基于MIT协议开源代码,下一步计划支持多模态记忆与联邦学习隐私版本,无论是个人助理、游戏NPC还是企业知识库都能灵活应用。

这项由伦敦国王学院团队提出的xMemory技术,采用“先拆后聚”的层级记忆架构,能够将智能体长程对话中的冗余检索信息削减30%的Token量,同时将问答准确率(QA分数)反而提升超过10分。

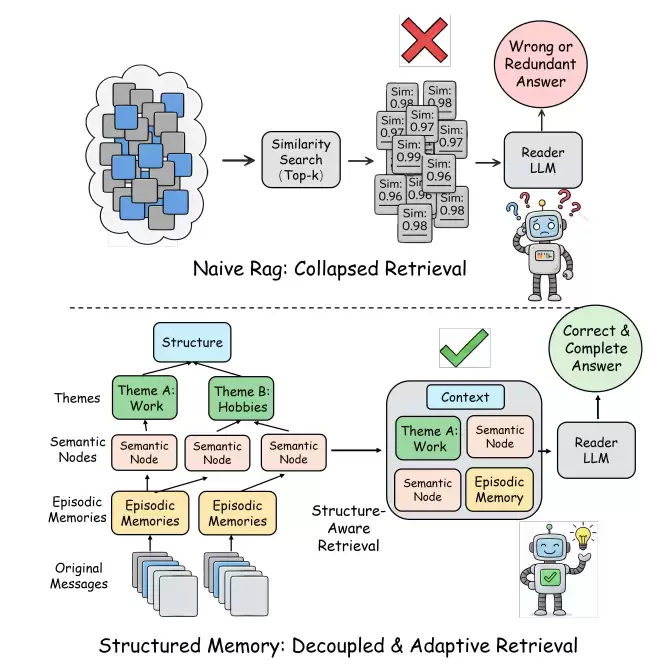

RAG 在 Agent 场景的“水土不服”症结

传统方法的问题链条通常是这样:

top-k 相似度检索 → 结果常常混杂大量“车轱辘话”需后续剪枝压缩 → 时间线和指代关系被切断,导致多跳推理直接崩溃 图片

图片

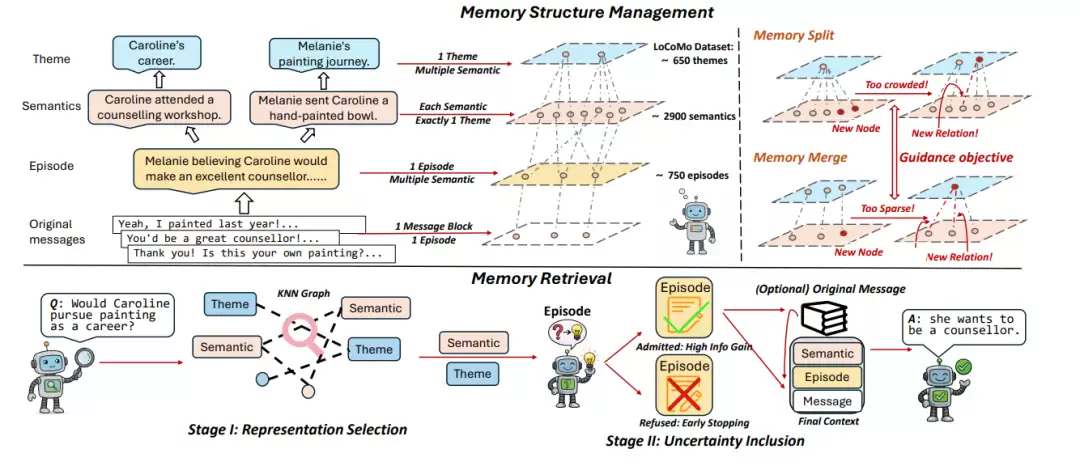

xMemory “拆-聚-检”三步走策略

图片

图片

构建四级记忆树

从原始对话起步,完整保留时间戳与指代关系链。在Episode层面,将连续的消息块通过边界检测与提示词自动分段。在Semantic层面,提炼出可复用的事实单元,例如“用户于2025年1月搬家至西雅图”。在Theme层面,抽象出高阶概念,如“职业规划与家庭关系”。

> 每一层级节点都保持为一个“完整证据单元”,不再进行机械式的片段切割。

引入稀疏-语义综合目标函数

f(P) = SparsityScore + SemScore

SparsityScore:确保各主题分布均衡,避免出现“超级候选集”而淹没关键信息。SemScore:促使语义相近的内容聚集,不同主题分离,有效防止“语义孤岛”现象。

支持在线增量更新:新的语义信息会首先贴附于最近的相关主题,一旦触及阈值即自动进行分裂或合并。数据显示44.9%的节点会被动态重组,这意味着记忆结构越用越有条理。

自顶向下的双阶段检索

第一阶段(骨架选择)在主题-语义层进行贪心选择,优先挑出“覆盖广且相关性高”的代表性节点,并天然去重。

第二阶段(不确定性扩张)则非常克制,只将那些能显著降低LLM预测熵的Episode或原始消息纳入最终检索结果,冗余信息一句也不给。

实验效果验证

Token用量减半,性能分数反升

在跨三款主流LLM(包括Qwen3-8B、Llama-3.1-8B、GPT-5-nano)的测试中,趋势高度一致:模型越小,性能提升幅度越大。

深度解析:为什么效果如此显著?

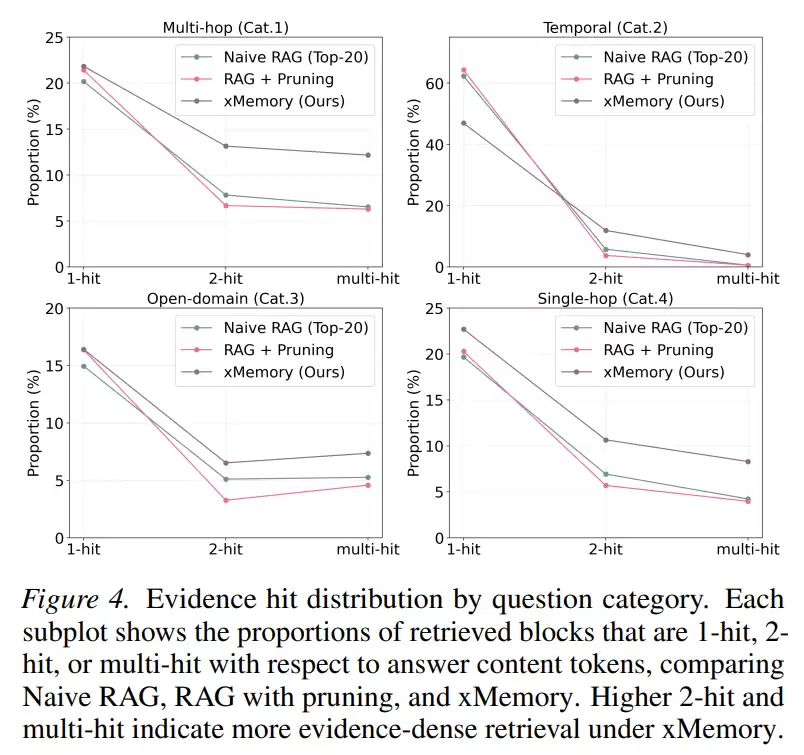

证据密度实验表明,在xMemory的检索块中“同时命中2个以上答案关键词”的比例提升了2倍,而简单剪枝方案会把多重命中的区块削成单一命中,反而使信息更稀疏。

一张图看清差距

图片

图片

对于同一段长对话,传统RAG需要抓取20个信息块才能覆盖答案,而xMemory仅需5块;简单剪枝虽然Token用少了,却可能把关键细节一起剪掉。

三个实战锦囊

首先,别再盲目调高 top-k 值。智能体记忆具有高度自相关性,k 值越大越冗余。正确的做法是先分层,再用贪心算法选取代表节点,效果立竿见影。

其次,剪枝需慎用。对话证据具有链式耦合性,剪“废话”时容易误剪“前提”。用不确定性阈值门控替代硬性剪枝,能在降低Token用量的同时提升准确率。

最后,结构要“活”。用户会随时更正事实,让主题节点可以动态分裂与合并,记忆才不会“僵化”。

让AI记住你,不再只是“金鱼脑”,也不会变成“话痨”——这正是后RAG时代记忆管理的开端。

论文:Beyond RAG for Agent Memory: Retrieval by Decoupling and Aggregation

热门专题

热门推荐

钉钉文档官网 在探讨企业级协同办公解决方案时,钉钉文档无疑是备受瞩目的核心工具之一。作为阿里巴巴钉钉官方推出的旗舰级应用套件,它深度融合了在线文档编辑、智能表格、思维导图等多种高效创作工具。其核心优势在于与钉钉平台生态的无缝衔接,能够直接同步企业内部组织架构与通讯录,实现团队成员间的即时协作与信息流

在数字化转型浪潮中,高效、易用的数据分析工具已成为企业提升决策效率的关键。商汤科技推出的“办公小浣熊”智能助手,正是基于自研大语言模型打造的一款创新产品,旨在彻底降低数据分析的技术门槛。用户无需掌握编程知识或复杂操作,即可通过自然对话完成从数据查询、处理到可视化洞察的全流程,让数据价值触手可及。 办

在人工智能技术快速发展的今天,MiniMax作为一家专注于全栈自研的AI公司,正以其独特的技术路径和前瞻性的布局,在业界脱颖而出。公司致力于构建覆盖文本、图像、语音和视频的新一代多模态智能模型矩阵,这不仅体现了对核心底层技术自主权的深度掌控,也展现了对未来人机交互与内容生成形态的前瞻思考。 那么,M

ApolloCreditFund(ACRED)作为连接传统信贷与DeFi的桥梁,其价格受市场情绪、协议基本面及宏观环境影响。其价值逻辑根植于现实世界资产(RWA)的收益捕获与链上流动性释放。短期价格波动难以预测,但长期发展取决于信贷资产质量、协议安全性和市场采用度。投资者需关注其底层资产表现、代币经济模型及整个RWA赛道的发展趋势。

在数字化转型浪潮中,一套能够深度适配业务、彰显品牌特色的智能客服系统,已成为企业提升服务效率与用户体验的关键工具。然而,市场上许多解决方案往往模式固化,难以满足个性化需求。如何让AI客服不仅具备基础的自动化应答能力,更能承载独特的品牌文化与服务哲学?其核心在于系统是否支持深度的自定义与持续的AI训练