今天,我们不罗列清单、也不讲大道理,直接复盘一个真实场景:一个50MB的大Key,是如何在几秒钟内完成一场“完美谋杀”的。

在后端圈子里,有个冷知识:击垮一个千万级并发系统的,往往不是黑客的蓄意攻击,而是某个程序员随手塞进Redis的一个大Key。

很多人觉得Redis是内存操作,速度快得飞起,多存点数据怎么了?这种想法,无异于在顶级赛车的油箱里灌胶水。今天,我们不罗列清单、也不讲大道理,直接复盘一个真实场景:一个50MB的大Key,是如何在几秒钟内完成一场“完美谋杀”的。

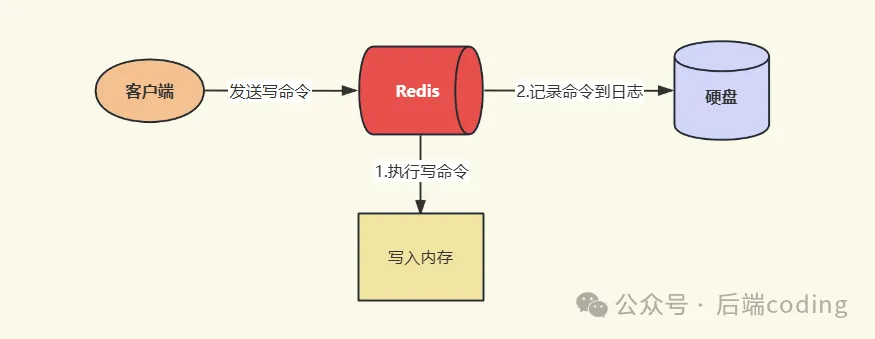

一、AOF写回:那道被“卡住”的后门

想象一下,你正在经营一家生意火爆的奶茶店,Redis就是那个手速极快的点餐员。

为了怕账本丢失,你要求点餐员每下一单都要实时把账单写进硬盘(AOF Always策略)。平时每单就几个字,点餐员写得飞快。突然,来了一个“巨无霸大单”——一个50MB的大Key。

点餐员(主线程)拿着笔开始在账本上狂写。由于硬盘的写入速度远慢于内存,点餐员必须全神贯注写完这50MB,才能抬头接下一单。结果就是:外面的顾客排起了百米长队,所有人都在疯狂大喊“怎么还不下单?”。

在Redis里,这就叫主线程阻塞,对外表现就是:全线超时,系统假死。关于Redis持久化核心知识,感兴趣的可以翻阅前面分享的文章深入阅读。

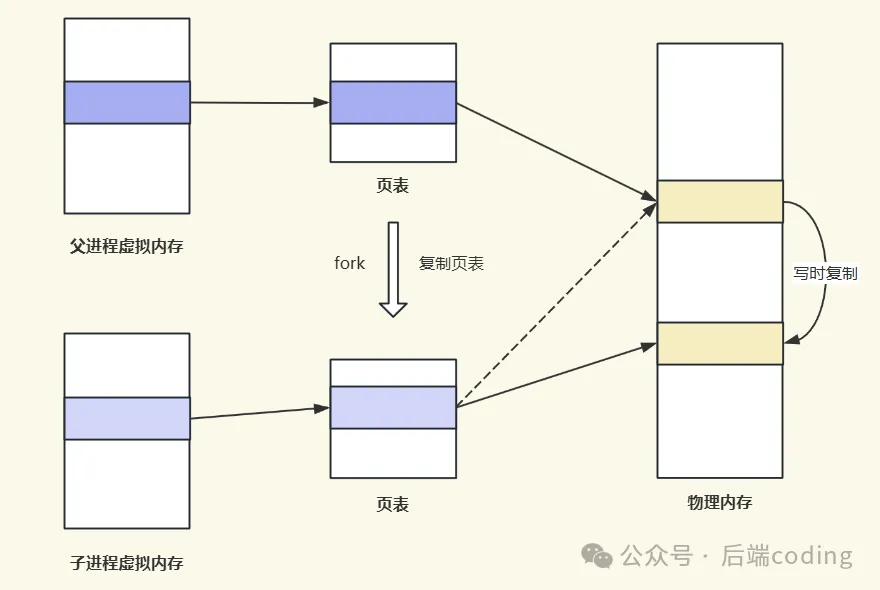

二、Fork子进程:那一瞬间“灵魂冻结”

这时候你可能会说:“我不用Always策略,我用后台快照(RDB)或者AOF重写,不是有子进程吗?”

天真了。即便有子进程,在它诞生的那一刻,Redis主线程也得全身心投入去复制一份“内存地图”(页表)。内存占用越大,这份地图就越厚。如果你存了大量大Key,导致内存飙升,那么fork的一瞬间,Redis就像被按下了暂停键。虽然只有几百毫秒,但在高并发场景下,这几百毫秒足以让几千个请求瞬间堆积、直至雪崩。

更扎心的是接下来的“写时复制”:如果子进程正在备份,主线程又去修改那个50MB的大Key,Redis必须在内存里硬生生再抠出50MB空间来做副本。这就引发两个常见问题:CPU毛刺:内存拷贝极度消耗CPU。内存溢出:运气不好,内存直接翻倍,触发OOM导致进程被杀。

这就是大Key的“阴险”之处:它不直接杀你,它在后台慢慢耗尽你的生命值。

三、它是如何让你网卡“塞车”的

即便你的Redis性能扛住了,网卡也扛不住。

假设一个大Key是5MB,QPS也就200。算一下:5MB × 200 = 1GB/s。普通的千兆网卡瞬间就吃饱了,直接“报废”。

这时候,Redis节点就像一座孤岛,明明自己还能跑,但数据就是传不出去,请求也进不来。随之而来的就是网络雪崩:客户端以为Redis挂了,疯狂重试,进一步挤爆带宽,彻底陷入死循环。

四、避坑:优雅后端的不成文准则

既然大Key这么坑,我们该怎么办?其实就三句话,刻在骨子里:

第一,学会“化整为零”

不要把用户的所有订单、所有配置都塞进一个String里。学会拆分,50MB的JSON拆成50个1MB的Key。用的时候 MGET 一下,虽然多了几次寻址,但保住了系统的命。

第二,哪怕是删除,也要“温柔”

记住,如果你发现线上有个大Key已经成了祸害,千万别手抖点个DEL。

在Redis单线程里,DEL是同步操作。删一个百万级的集合,Redis会当场“圆寂”。

正确姿势是使用 UNLINK。它会先把Key标记为已删,然后把释放内存的苦力活交给后台线程。这才是优雅的“异步销毁”。

第三,防患于未然

别等报警了再去扫Key。平时多看看监控看板,或者在测试环境用 redis-cli --bigkeys 扫一扫。

五、核心总结

所谓架构优化,本质上就是对每一个字节的敬畏。在大Key面前,没有侥幸。Redis大Key的危害,本质上是“单线程模型”和“数据量大”的矛盾——Redis的单线程特性,决定了它无法并行处理耗时操作,而大Key的每一次操作,都会成为单线程的“负担”,进而引发一系列连锁反应。

对后端开发者来说,避免大Key不仅是Redis运维的基础,更是保障业务高可用的关键。记住核心原则:设计时拆分、运维时检查、删除时用unlink,就能轻松避开大Key的所有“坑”,让Redis真正发挥高性能的优势。