字节Seed大模型:未来推理新抓手,为何优先押注下一代令牌

henry 发自 凹非寺

量子位 | 公众号 QbitAI

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

LLM的下一个推理单位,何必是Token?

刚刚,字节Seed团队发布最新研究——

DLCM(Dynamic Large Concept Models)将大模型的推理单位从token(词) 动态且自适应地推到了concept(概念)层级。

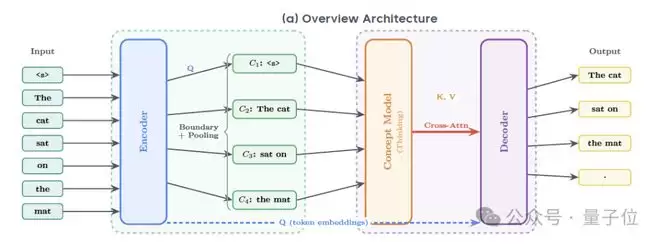

DLCM通过端到端地方式学习语义边界,动态地将Token序列分割成概念,在压缩后的概念空间中进行深度推理,并借助因果交叉注意力将概念级推理结果重构为Token级预测

由此,传统LLM中基于均匀、冗余Token信息密度的计算分配,被转化为面向概念的动态推理与自适应算力分配。

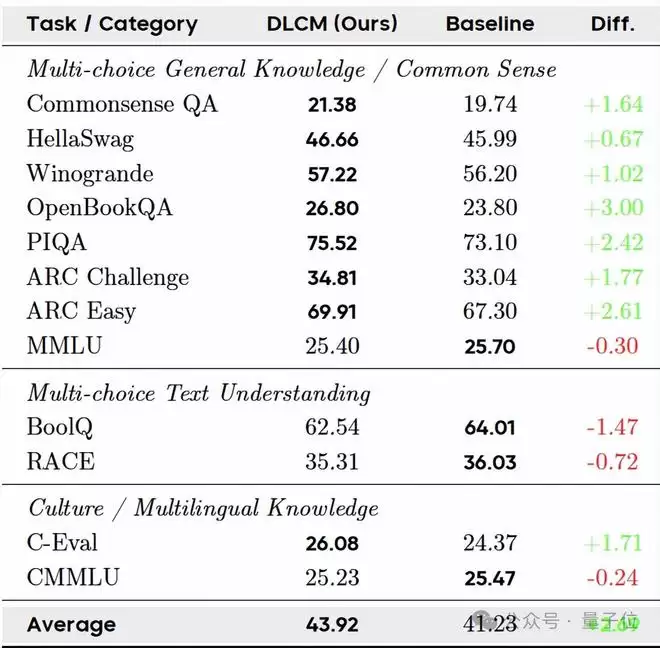

在以推理为主的基准任务上,DLCM在将推理阶段FLOPs降低34%的同时,还将平均准确率提升了2.69%

这也意味着,大模型的推理效率并不必然依赖更密集的Token级计算,而可以通过更高层级的语义组织来获得。

接下来,我们具体来看。

分层的下一token预测框架

如上所说,DLCM的核心在于学习动态的Token-概念映射,实现了计算资源的自适应分配。

之所以这样做主要有两方面原因:

一方面,在自然语言中,信息的分布并不是均匀的,而是集中在集中在少数语义转换的节点上。

然而,在当前的LLM中,所有token被统一处理,信息密度不均匀的自然语言消耗了同样的计算量,造成了大量的冗余与模型容量的错配。

另一方面,此前基于潜在推理的框架,如大型概念模型(Large Concept Model, LCM)等,不仅需要单独训练编码器和解码器,还依赖人为划分的固定的、句子级别的粒度,缺乏拓展性与自适应性。

针对这些问题,DLCM通过一种分层的下一token预测框架,将计算重心转移到压缩后的语义空间,实现了更高效的深度推理。

具体来说,这一框架包含四个阶段:

首先,在编码阶段,DLCM通过一个编码器,提取细粒度的Token级表示,捕获局部上下文信息,作为边界检测和最终Token级解码的基础。

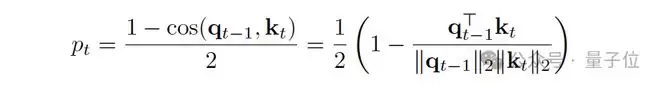

接下来,在动态分割阶段,模型基于Token级表示,计算相邻Token之间在潜在空间中的局部不相似性(使用余弦距离),当不相似度超过阈值时,模型判断为一个语义断点(概念边界)。

与固定句子长度不同,DLCM端到端地学习这些边界,实现内容自适应的分割。

它将同一片段内(即同一概念内)的所有Token表示进行均值池化(Mean Pooling),然后投影到更高维度的概念维度上,最终形成一个长度大大压缩的概念序列 。

然后,在概念级推理阶段,模型将上面得到的概念序列在压缩空间中进行深度的、高容量的推理,得到经过深度推理和信息整合后的概念表示。

最后,在Token级解码阶段,DLCM利用经过推理的概念表示,重构并预测下一个token。

由此,DLCM通过以上四个步骤,成功地将计算分配从低效的Token-Token交互,转移到高效的Token-概念-Token 交互,实现了计算资源的自适应、结构化利用。

关键技术突破与优化

虽然DLCM架构在设计上实现了Token级和概念级模块的异构,但同时也引入了新的工程和训练挑战。

全局解析器(Global Parser):内容自适应压缩

DLCM 的核心优势在于它能够根据信息密度动态地划分概念。

例如,对于信息冗余度高的代码或简单文本,可以激进地压缩;对于语义复杂的转折点,则保持较低压缩比。

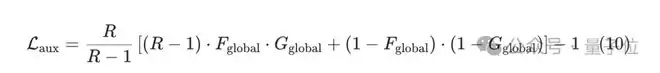

为实现这一点,研究引入了全局解析器(Global Parser)和辅助损失函数。

这个机制的关键在于:它不要求单个序列严格遵循目标压缩比 ,而是在整个Batch层面约束平均边界生成率。

这使得DLCM在共享全局压缩比例目标的前提下,实现了随领域变化、随内容波动的自适应分段,从而将计算资源精准地分配到语义最关键的区域。

针对Flash Attention的效率优化

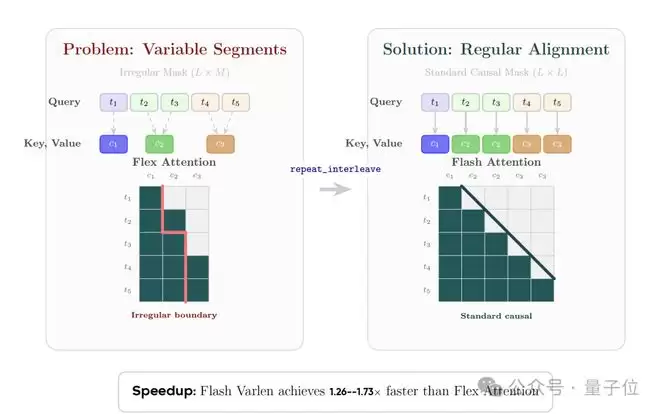

在解码阶段,Token需要通过因果交叉注意力关注其所属的概念。

由于每个概念包含的Token数量是变化的,如果直接实现,会严重依赖效率低下的动态掩码和不规则的内存访问。

针对这一问题,研究引入概念复制(Concept Replication)策略。它将概念特征沿着序列维度复制扩展,使其长度与原始Token序列对齐。

由此,研究将复杂的可变长交叉注意力问题转换为长度对齐、局部恒定的注意力问题,并使其能够利用高度优化的Flash Attention Varlen内核,获得了1.26倍到1.73倍的显著加速。

异构架构的稳定训练

由于DLCM 的Token级组件和概念级骨干网络的宽度不一致,通过上投影连接,无法共享单一有效学习率。

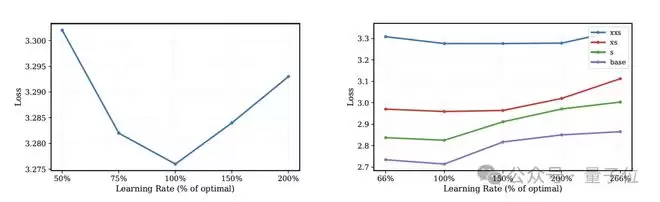

为解决这一问题,研究采用解耦的最大更新参数化,为Token模块和概念模块分配了独立的宽度缩放因子,并发现各组件的有效学习率应与其宽度的倒数成比例缩放。

由此,研究成功地稳定了这种不等宽架构的训练,并实现了零样本超参数迁移,即小型代理模型上找到的最佳学习率可以直接用于训练更大的DLCM模型。

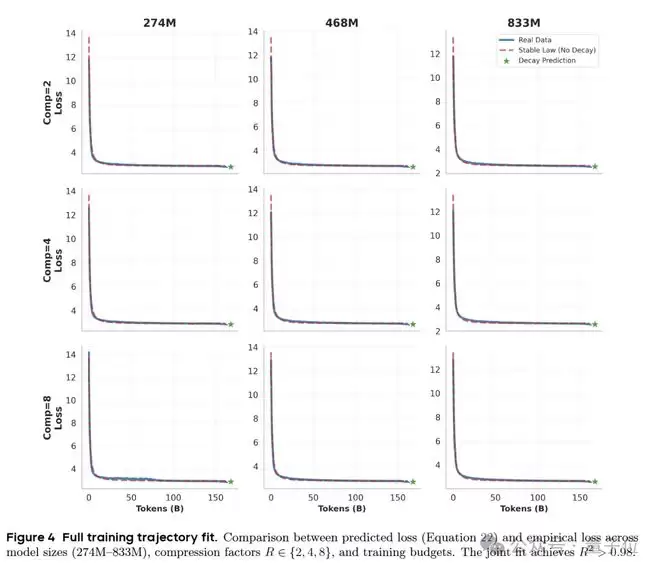

量化最优分配点

除上述优化外,研究还进一步基于scaling law探究了token级处理与概念级推理之间的最优分配。

研究发现,在固定压缩比下,架构效率在中等概念主干占比处达到峰值,而非随概念容量单调提升。

更重要的是,这一最优配置在规模增大时优势愈发明显:随着基线模型变大,在性能对齐的前提下,DLCM可实现越来越显著的FLOPs节省。

在实验阶段,研究采用了与LLaMA论文中报告的相同的全局批次大小、学习率和序列长度,让每个模型都在1T Token上进行训练。

其中,DLCM实现了43.92%的平均准确率,超过了基线模型41.23%的分数,提升了2.69%。

One more thing

这篇论文的一作来自英国曼彻斯特大学的在读博士生Qu Xingwei,师从Chenghua Lin教授。

他的研究方向聚焦于大语言模型(LLMs),主要包括预训练、微调、专家混合(Mixture of Experts)以及System-2大语言模型。

在教育背景方面,他本科毕业于北京航空航天大学,导师为段海滨教授;硕士就读于获慕尼黑工业大学,导师为Daniel Cremers教授。

在读博前,他曾在字节跳动和小鹏汽车担任研究工程师。

[1]https://x.com/GeZhang86038849

[2]https://arxiv.org/abs/2512.24617

相关攻略

一个学生忽视了一行代码,结果发现了一件很不对劲的事:在一个多模态医学AI项目中,这行代码原本负责让模型读取图像数据。但因为这次疏忽,模型实际上完全没有看到任何图片。按理说系统应该报错,或者至少拒绝回

雷递网 乐天 3月31日智谱CEO张鹏今日在智谱2025年年报沟通会上表示,智谱曾经历过质疑,经历过挫折,但无数事实反复验证了一个判断——智能上界的提升,是大模型AGI时代唯一的 "第一性 "。张鹏说,

快科技3月31日消息,近日,比利时布鲁塞尔自由大学(VUB)数据分析实验室发布重磅研究成果,证实商用大型语言模型已具备独立生成原创数学证明的能力。OpenAI旗下ChatGPT-5 2(Thinki

这项由谷歌智能范式团队联合芝加哥大学、圣塔菲研究所等多家机构完成的突破性研究发表于2026年3月,研究编号为arXiv:2603 20639v1。有兴趣深入了解的读者可以通过这个编号查询完整论文。这

这项由高通AI研究院领导的突破性研究发表于2026年3月的预印本论文,论文编号为arXiv:2603 08462v1。有兴趣深入了解的读者可以通过该编号查询完整论文。这项研究解决了一个让所有AI研究

热门专题

热门推荐

百度网盘个人版如何转企业版?完整切换步骤详细指南 当个人网盘难以满足团队文件共享与协作需求时,百度网盘提供的企业版无疑是高效解决方案。本文将为你详细解析如何直接在百度网盘App内,将个人账户一键切换至功能更强大的企业版,快速开启团队文件管理新模式。 第一步:进入个人中心页面 首先,请确保已安装并打开

“AI+eSIM”云智终端方案正式商用,首批合作项目5G AI CPE成功落地 在MWC 2026世界移动通信大会上,产业合作迎来重大进展。由全球移动通信系统协会(GSMA)与中国联通共同倡导的“‘AI+eSIM’云智终端合作联通方案”正式对外发布,并迅速完成首个商业化项目签约。中国联通联合通则康威

洛克王国世界水泡壳技能搭配完全指南:打造攻防一体的战术核心 世界水泡壳的技能池设计充满了战术深度,完美诠释了攻防一体的战斗哲学。无论是纯粹依靠威力压制对手的技能,还是具备控制、辅助等战略功能的技能,都能在其技能库中找到。掌握其技能搭配的核心思路,是让世界水泡壳在对战中发挥出全部潜力的关键,能够轻松取

现货比特币ETF单周吸金14 2亿美元,强势回归背后的市场信号 加密货币市场正迎来关键转折点。近期数据显示,现货比特币ETF资金流入呈现爆发式增长,成为近期最受关注的市场风向标。这不仅反映了机构资金的重新布局,更可能预示着市场供需结构的深层变化。 数据解读:创纪录的资金流入意味着什么? 根据专业追踪

河西竹篮打水奇遇触发地点指南 想要成功触发《燕云十六声》中颇具趣味的“竹篮打水”奇遇,玩家需要首先前往河西地图的特定区域进行探索。该触发点位置较为隐蔽,建议在河西沿岸的村落与水边场景多番巡视。当你接近正确位置时,可以留意游戏内的环境暗示,例如独特的视觉标识、背景音效的变化或氛围的微妙转变,这些都是系