田渊栋:2025年终总结核心方法与思考(一)

新智元报道

编辑:桃子

【新智元导读】从救火Llama 4反被裁,再到如今下场自创业,AI大佬田渊栋回顾了2025年一些重要时刻。

最近太忙,只能把年终总结放到1月1日之后再写了,不管怎样,能开始动笔就是好事。

关于被裁

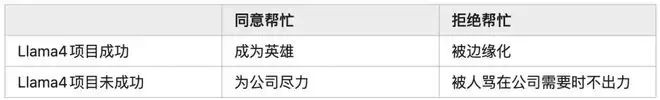

在2025年1月底被要求加入Llama4救火的时候,作为一直以来做强化学习的人,我事先画了一个2x2的回报矩阵(reward matrix),计算了一下以下四种可能(虽然在那时,因为来自上面的巨大压力,不同意是几乎不可能的):

当时想的是我们去帮忙的话,即便最后项目未能成功,也至少尽力而为,问心无愧。不过遗憾的是,最后发生的是没在计算之内的第五种可能,这也让我对这社会的复杂性有了更为深刻的认识。

尽管如此,在这几个月的努力过程中,我们还是在强化学习训练的核心问题上有一些探索,比如说训练稳定性,训推互动,模型架构设计,和预训练/中期训练的互动,长思维链的算法,数据生成的方式,后训练框架的设计等等。

这个经验本身是很重要的,对我的研究思路也带来了不小的转变。

另外其实我也想过在公司十年多了,总有一天要离开,总不见得老死在公司里吧,但总是因为各种经济上和家庭上的原因还是要待下去。

最近一两年的说话和做事方式,都是抱着一种「公司快把我开了吧」的心态,反而越来越放开。

2024年年末我休第一个长假的时候,其实几乎差点要走了,但最后没签字还是选择待在公司继续,所以说真要做出离开的决定也不容易。现在Meta帮我做了也挺好。

这次波折和今年一年的起起落落,也为接下来的小说创作提供了非常多的新素材。

所谓「仕途不幸诗家幸,赋到沧桑句便工」,生活太平淡,人生就不一定有乐趣了。还记得2024年年头上的时候,因为在年末工作总结里面写了几句关于「为啥paper都没中」的反思,喜提Meet Most,有一种突然不及格的懵逼感。

但想了想与其到处抱怨世道不公,不如就在大家面前装成自己刚刚升职吧,结果半年后果然升了职,而那篇21年头上无人问津的工作,在21年7月份中了ICML Best paper honorable mention,成为一篇表征学习中还比较有名的文章。

10月22号之后的一段时间,基本上我的各种通信方式都处于挤爆的状态,每天无数的消息和邮件,还有各种远程会议或者见面的邀请,实在是忙不过来了。

一直到几周之后才渐渐恢复正常。这两个月非常感谢大家的关心和热情。如果那时有什么消息我没有及时回复,请见谅。

虽然最后有不少offer,大家能想到的知名公司也都联系过我,但最后还是决定乘自己还年轻,去当一家新初创公司的联合创始人,细节暂时不公开,先安静地忙活一阵吧。

一些研究的方向

2025年的主要方向,一个是大模型推理,另一个是打开模型的黑箱。

自从2024年末我们的连续隐空间推理(coconut,COLM’25)工作公开之后,25年在这个研究方向上掀起了一股热潮。大家探索如何在强化学习和预训练中使用这个想法,如何提高它的训练和计算的效率,等等。

虽然我们组随后就被拉去llama干活,没能再继续花很大力气往下挖,但这个让我觉得非常欣慰。

尽管如此,我们还是在上半年发了一篇理论分析(Reasoning by Superposition,NeurIPS‘25)的文章,展示连续隐空间推理有优势的地方究竟在哪里,获得了不少关注。

另外是如何提高大模型的推理效率。我们的Token Assorted(ICLR’25)的工作,先通过VQVAE学出隐空间的离散token,再将所得的离散token和text token混在一起进行后训练,减少了推理代价的同时提高了性能。

我们的DeepConf通过检测每个生成token的自信程度,来决定某条推理路径是否要被提前终止,这样推理所用的token减少了很多,但在majority vote的场景下性能反而更好。

ThreadWeaver则是通过制造并行推理的思维链,并在其上做后训练,来加快推理速度。另外我们也在dLLM上用RL训练推理模型(Sandwiched Policy Gradient),也有在小模型上学习推理的尝试(MobileLLM-R1)。

在可解释性方面,Grokking(顿悟)这个方向我大概两年前就在关注了。因为之前我做表征学习(representation learning)的分析,虽然能分析出学习的动力学过程,看到模型出现表征塌缩的原因,但究竟学出什么样的表征,它们和输入数据的结构有什么关系,能达到什么样的泛化能力,还是个谜团,而通过分析Grokking这个特征涌现的现象,从记忆到泛化的突变过程,正好能解开这个谜团。

一开始确实非常难做没有头绪,2024年先做了一篇COGS(NeurIPS‘25,见求道之人,不问寒暑(十)),但只能在特例上进行分析,我不是很满意。

在一年多的迷茫之后,在和GPT5大量互动之后,最近的这篇Provable Scaling Laws的文章应该说有比较大的突破,能分析出之前的线性结构(NTK)看不到的东西,并把特征涌现的训练动力学大概讲清楚了。虽然说分析的样例还是比较特殊,但至少打开了一扇新的窗口。详细解释请看田渊栋 的想法。

年末的这篇The path not taken我很喜欢,对于RL和SFT的行为为何会如此不一致,在权重的层面给出了一个初步的答案。

SFT造成过拟合和灾难性遗忘(catastrophic forgetting),其表层原因是训练数据不够on-policy,而深层原因是权重的主分量直接被外来数据大幅修改,导致「根基」不稳,模型效果大降。

而RL则因为用on-policy的数据进行训练,权重的主分量不变,改变的只是次要分量,反而能避免灾难性遗忘的问题,而改变的权重其分布也会较为稀疏(特别在bf16的量化下)。

关于可解释性的信念

很多人觉得可解释性,或者「AI如何工作得那么好」这个问题不重要,但我却觉得很重要。试想之后的两种场景:

场景一:如果我们仅仅通过Scaling就达到了AGI乃至ASI,全体人类的劳动价值都降为零,AI作为一个巨大的黑盒子帮我们解决了所有问题,那如何让AI作为一个超级智能,一直行善,不欺骗不以隐秘的方式作恶,就是当务之急,要解决这个问题就要做可解释性。

场景二:如果Scaling这条路最终失效,人类在指数增长的资源需求面前败下阵来,必须得要寻求其它的方案,那我们就不得不去思考「模型为什么有效,什么东西会让它失效」,在这样的思考链条之下,我们就必须回归研究,可解释性就是目所能及的另一条路了。

在这两种情况下,最终都需要可解释性来救场。就算最终AI是个全知全能全善的神,以人类好奇和探索的天性,必然还是会去研究AI为什么能做得好。

毕竟「黑盒」就意味着猜疑链的诞生,在大模型技术爆炸,开始达到甚至超过人类平均水平的今天,《三体》中「黑暗森林」的规则,也许会以另一种方式呈现出来。

目前打开训练好模型的黑箱,去找到电路(circuit),还是处于比较初步的阶段。

可解释性真正的难点,在于从第一性原理,即从模型架构、梯度下降及数据本身的固有结构出发,解释为什么模型会收敛出这些解耦、稀疏、低秩、模块化、可组合的特征与回路,为什么会有大量不同的解释,这些涌现出来的结构和模型训练的哪些超参数相关,如何相关,等等。

等到我们能从梯度下降的方程里,直接推导出大模型特征涌现的必然性,可解释性才算真正从生物式的证据收集走向物理式的原理推导,最终反过来指导实践,为下一代人工智能的模型设计开辟道路。

对比四百年前的物理学,我们现在有很多AI版的第谷(收集数据),一些AI版的开普勒(提出假说),但还没有AI版的牛顿(发现原理)。

等到那一天来临的时候,我相信,世界一定会天翻地覆。

参考资料:

https://zhuanlan.zhihu.com/p/1990809161458540818

注:本文授权转载,若二次转载请联系原作者。

秒追ASI

⭐点赞、转发、在看一键三连⭐

点亮星标,锁定新智元极速推送!

相关攻略

Matrix 是一种开放且去中心化的即时通讯协议,允许用户自主部署私有服务器并接入全球 Matrix 联邦网络。OpenClaw 网关通过集成 Matrix 的 Client-Server API,实现与这一分布式通信生态的无缝对接。 前置准备 在配置 OpenClaw 连接 Matrix 之前,请

周二晚间,AI领域迎来了一则重磅消息。在权威AI评测平台Artificial Analysis的榜单上,一个名为「HappyHorse-1 0」的神秘模型异军突起,一举登顶视频生成能力排行榜,引发了业界的广泛关注与热议。 这一成绩极具含金量。无论是文本生成视频,还是图像生成视频,HappyHorse

当AI开始学会“脑补”物理世界的运行规律,并尝试模拟一个动态变化的真实环境时,我们距离那个传说中的通用人工智能(AGI)究竟还有多远? 进入2026年以来,“世界模型”毫无悬念地成为了科技圈最炙手可热的核心议题。它标志着一个关键的范式转变:人工智能正从被动地“感知当下”,迈向主动地对时空与动态变化进

上周三关于“世界模型”的线上沙龙反响空前热烈,这充分表明,从被动感知迈向主动推演,这条被视为实现通用人工智能(AGI)的核心技术路径,正深度吸引着整个AI行业的关注。鉴于持续高涨的讨论热度,我们决定加开一场深度分享会。 那么,这条充满潜力却又极具挑战性的前沿赛道,目前进展到了何种阶段?顶尖的研究者们

数字逻辑与物质建构的深度对话 ——评许哲诚“境域·生成”计算性设计展演 □ 丁雅力(江苏省美术馆策展人) 当代设计与造物的核心范式,正经历着由计算性设计带来的深刻变革。2026年3月20日,南京艺术学院教师许哲诚于南京莫玄空间呈现的“境域·生成”个人专场展演,正是这一前沿趋势的集中体现。本次展览超越

热门专题

热门推荐

英特尔下一代TitanLake处理器全系支持LPDDR6内存。面向主流笔记本的U、P及高能效PX系列还将兼容LPDDR5X与DDR5,为设备设计提供灵活性。U、P、PX系列采用Intel18A工艺的新CPU模块,而B、BX系列沿用旧架构。高端PX系列集成GPU采用台积电N2P工艺,配备16个Xe核心,旨在提升图形性能。

一只鲸鱼做空比特币 4 96 亿美元,触发市场公信讨论 最近,链上数据捕捉到的一笔大额交易,瞬间吸引了所有市场参与者的目光:一只比特币巨鲸,悄然开立了价值近5亿美元的空单。这笔操作如同一块投入平静湖面的巨石,不仅激起了短线的价格波澜,更将市场深层的公信机制与交易透明度问题,再次推到了讨论的中心。 鲸

解锁《四海兄弟》“故乡没那么快”成就需耐心探索:深入隐秘角落,留意环境细节;积极与居民互动,收集对话线索;完成相关支线任务,关注伏笔;并注意特定时段触发的事件。成就进度可累积,坚持全面探索方能最终达成。

鬼谷子是战术型辅助,核心在于技能运用与合理出装。二技能是关键控制,配合大招的群体伪装可发起突袭。出装以冷却缩减和生存能力为主,如冷静之靴、极寒风暴和魔女斗篷。实战中需把握进场时机,从侧翼切入控制敌方核心,并注意与队友配合衔接伤害。

在游戏开发、动画制作、视频创作等数字内容领域,专业音效设计是提升作品沉浸感与专业度的关键。然而,传统音效制作流程往往依赖昂贵的专业设备与庞大的素材库,对独立开发者、小型团队及个人创作者构成了较高的技术门槛与成本压力。近期,一款名为OptimizerAI的人工智能音效生成平台备受关注,它致力于通过AI