英伟达GB200价格翻倍却抢购一空,AMD能否抓住机会?

新智元报道

编辑:桃子

【新智元导读】AI推理游戏规则,正悄然改变。一份最新报告揭示了关键转折:如今决定胜负的,不再是单纯的芯片性能或GPU数量,而是 「每一美元能输出多少智能」。

AI推理,现已不只看算力硬指标了!

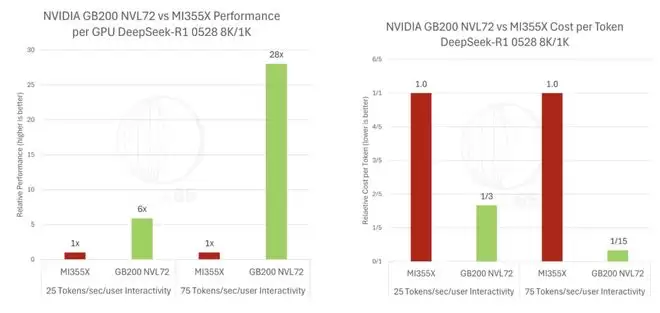

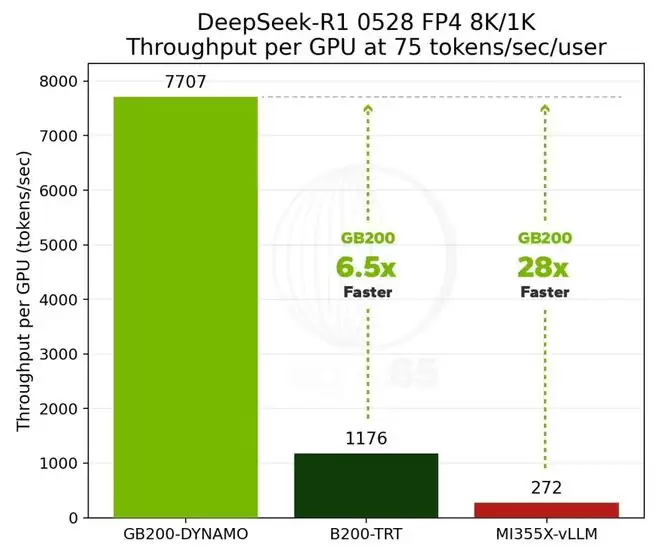

Signal65一份最新报告中,英伟达GB200 NVL72是AMD MI350X吞吐量28倍。

而且,在高交互场景在,DeepSeek R1每Token成本还能低到15倍。

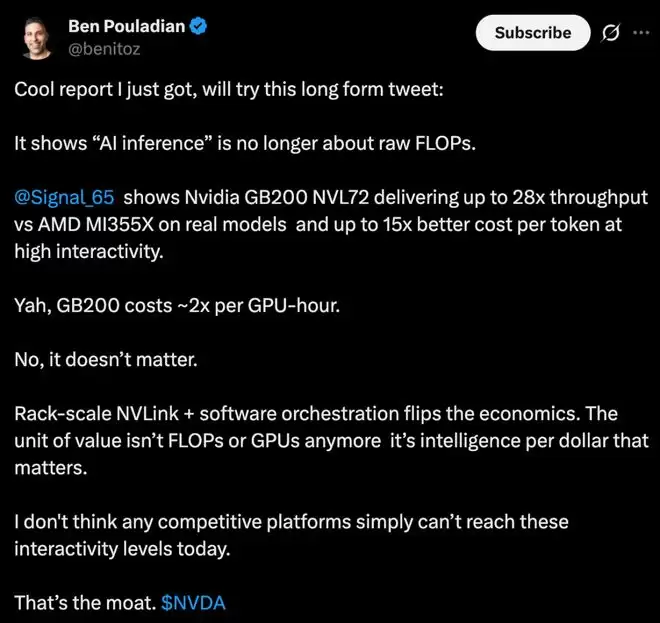

GB200每小时单价大概是贵一倍左右,但这根本不重要。因为机柜级NVLink互联+软件调度能力,彻底改变了成本结构。

顶级投资人Ben Pouladian称,「目前的关键不再是算力或GPU数量,而是每一美元能买到多少智能输出」。

如今,英伟达仍是王者。其他竞争对手根本做不到这种交互水平,这就是护城河。

最关键的是,这还没有集成200亿刀买入Groq的推理能力。

这里,再mark下老黄至理名言——The more you buy, the more you save!

AI推理重心:一美元输出多少智能?

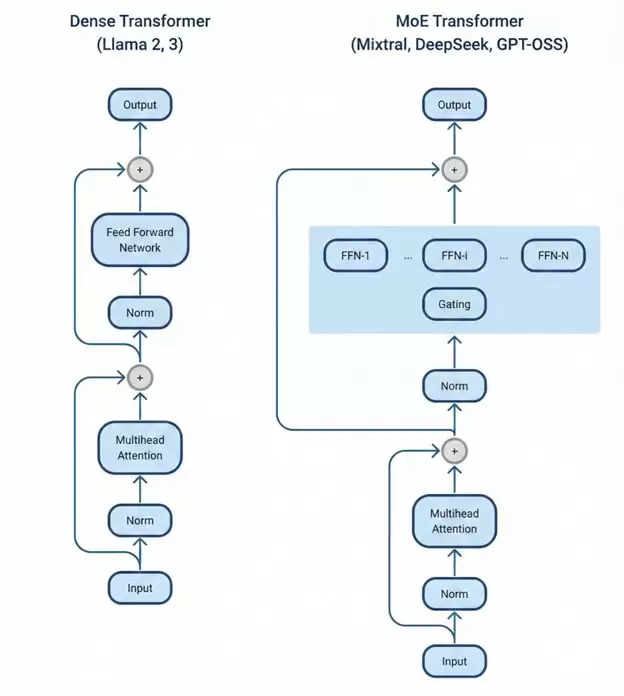

这篇万字报告,探索了从稠密模型(Dense)到混合专家模型(MoE)推理背后的一些本质现象。

传统的「稠密模型」架构要求:在生成每个Token时都激活模型里的全部参数。

这就意味着:模型越大,运行越慢、成本越高,同时还会带来相应的内存需求增长等问题。

MoE架构,正是为了释放更高水平的智能而生——在每个Token上只激活最相关的「专家」。

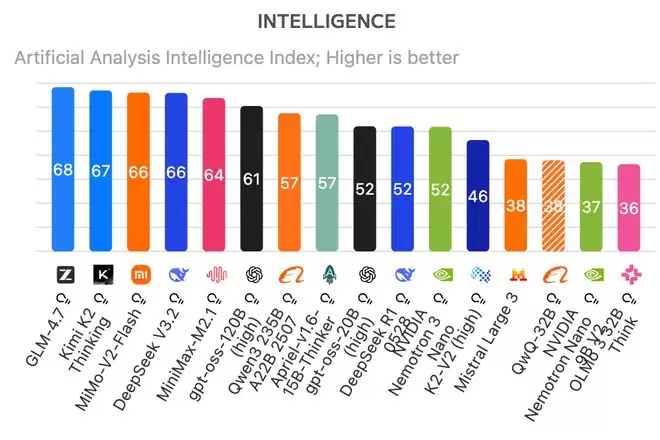

搂一眼Artificial Analysis排行榜即可发现,全球TOP 10开源LLM,全部都是MoE推理模型。

它们会在推理阶段额外「加算力」来提高准确性:

LLM不会立刻吐出答案,而是先生成中间的推理Token,再输出,相当于先把请求和解法「想一遍」。

前16名里有12个是MoE模型

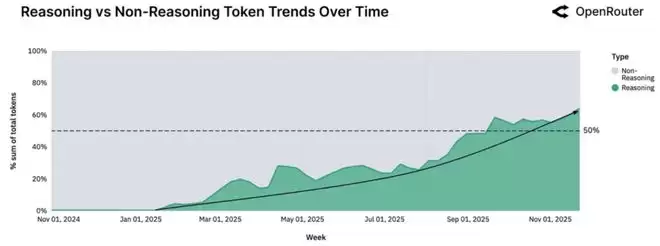

这些推理Token往往远多于最终回复,而且可能完全不会展示出来。能否既快又便宜地生成Token,对推理部署来说就变得至关重要。

那么,MoE方法的主要约束在哪里?

一个核心限制在于「通信瓶颈」。

当不同专家分布在多块GPU上时,任何GPU之间通信的延迟,都会让GPU空闲等待数据。

OpenRouter一份近期报告,超50%的Token会被路由到推理模型上

这些「空转时间」(idle time)代表着被浪费的、低效的算力,并且会直接体现在服务提供商的成本底线上。

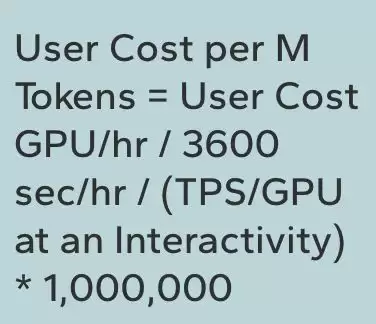

当评估AI基础设施的「经济性」时,一般会聚焦在三个方面:

性能(吞吐量与交互性)

能效(在既定功耗预算下,可生成的Token数)

总体拥有成本(通常以Token/每百万的成本衡量)

基于公开可用的基准测试数据,Signal65对不同LLM架构下AI基础设施方案进行了对比分析。

分析中,团队采用第三方基准测试所提供的性能数据,来估算相对的Token经济性。

具体来说,他们选取了B200、GB200 NVL72,以及AMD MI355X部分结果,用以对比它们在不同模型场景下的真实性能表现及相应的TCO估算。

结果显示,在稠密架构以及较小规模的MoE中,B200性能优于AMD MI355X。

当模型扩展到像DeepSeek-R1这样需跨越单节点的前沿级规模时,GB200 NVL72性能最高可达到MI355X的28倍。

在高交互性的推理工作负载中,NVL72的单位Token成本最低,可降至其他方案的约1/15。

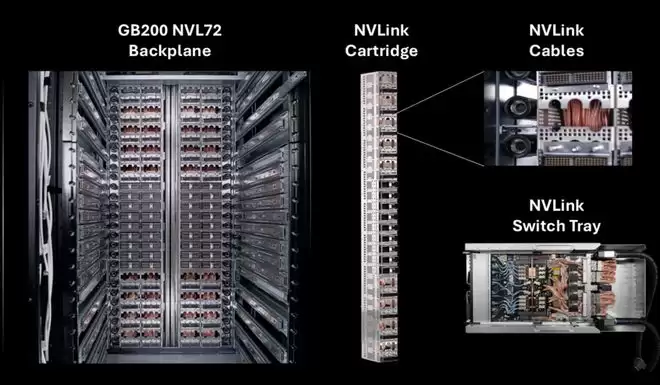

尽管GB200 NVL72的单GPU小时价格几乎是这些竞争平台的2倍,但其机架级能力——从NVLink高速互连,到覆盖72块GPU的软件编排——共同推动了这种显著更优的单位经济性。

价值评估的重心,正在从单纯的原始FLOPs,转向「每一美元所获得的总体智能」。

这一结论非常明确:

随着MoE模型和推理工作负载带来的复杂性与规模持续上升,行业已无法仅依赖芯片层面的性能提升。

能够在系统层面实现峰值性能的端到端平台设计,已经成为实现低成本、高响应AI服务的关键杠杆。

「稠密模型」推理,英伟达领先

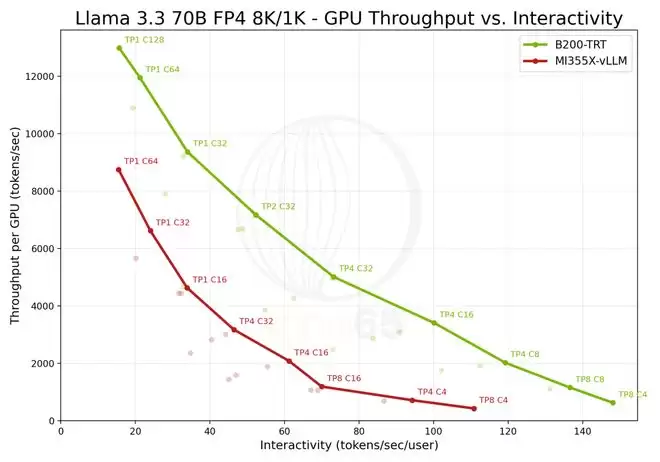

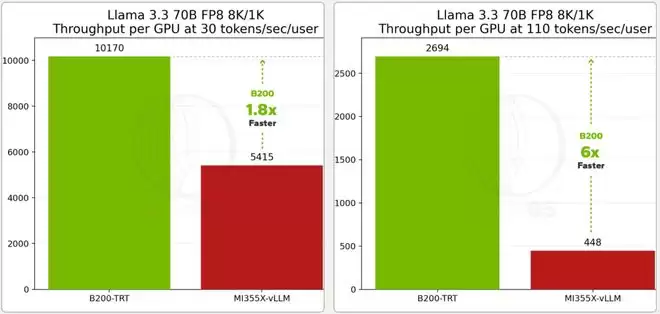

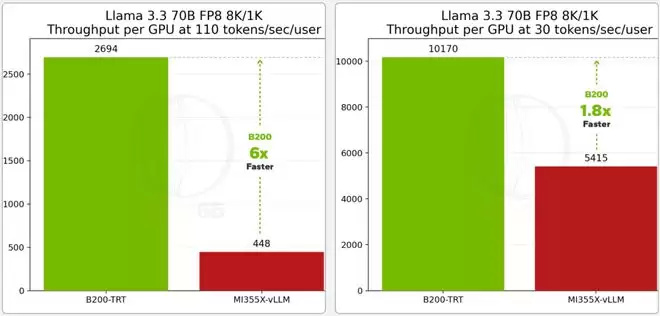

Signal65选择了Llama 3.3 70B作为稠密模型的性能基准,结果如下所示:

帕累托曲线清晰显示出,HGX B200-TRT方案在整个吞吐量与交互性区间内,都具备持续的性能优势。

具体到基线交互性水平,B200的性能大约是MI355X的1.8倍,这为交互式应用部署,以及更高的单GPU并发密度提供了显著余量。

再来看,当交互性提升至110 tokens/sec/user时,这一优势进一步被放大:B200吞吐量超过MI355X的6倍。

整体上,在Llama 3.3 70B测试中,AMD MI355X在单位成本性能方面确实具备一定吸引力。

但这种优势并不能代表更现代的推理技术栈,尤其是以MoE架构和高强度推理工作负载构建的系统。

MoE推理,英伟达领先

那么,在MoE架构上,英伟达和AMD表现又如何?

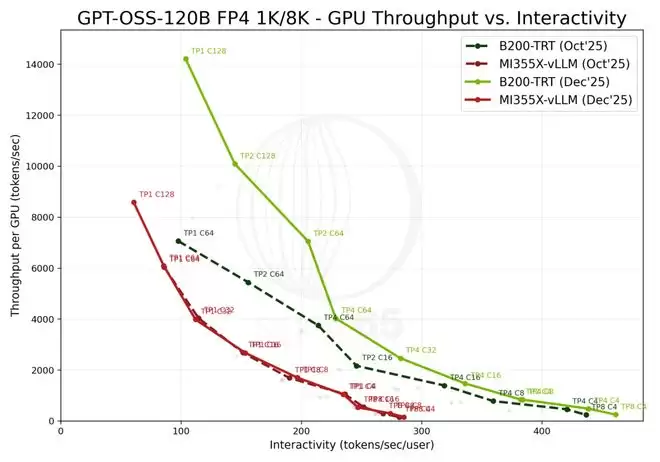

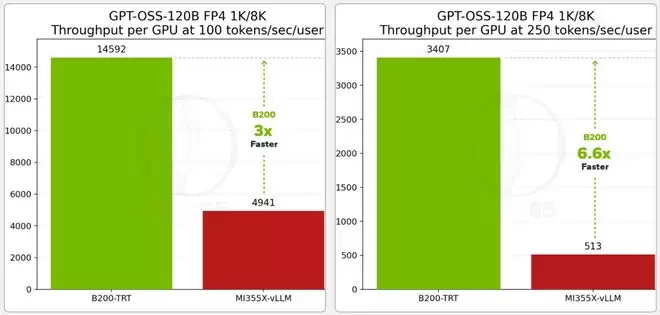

中等规模推理:gpt-oss-120B

Signal65认为,OpenAI gpt-oss-120B是理解MoE部署特性的一个理想「桥梁案例」。

它足够大,可以把MoE的复杂性暴露出来;

但规模又没有大到离谱,仍然是很多团队能现实部署并调优的范围。

它处在一个很有用的中间地带:介于稠密的70B级模型,与市场正在快速转向的、更前沿的推理型MoE架构之间。

在10月下旬数据里,当目标是100 tokens/sec/user时,B200大约比MI355X快1.4倍;

但当目标提高到250 tokens/sec/user时,差距会扩大到约3.5倍,说明越追求「更快的交互」,平台差异越容易被放大。

不过,12月上旬的数据则呈现出不同局面。

得益于软件优化,两边平台的绝对性能都明显提升:英伟达单GPU峰值吞吐从大约7,000 tokens/sec提升到超过14,000;AMD也从约6,000提升到大约8,500。

前沿推理:DeepSeek-R1

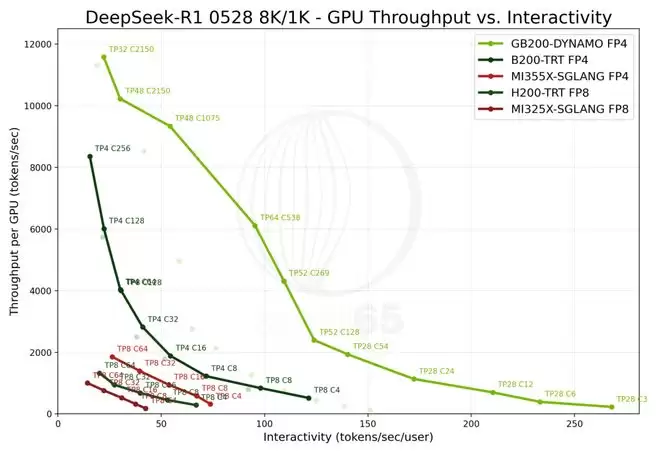

在DeepSeek-R1推理上,测试结果正如开篇所介绍那样,英伟达GB200 NVL72大幅领先。

更多数据如下图所示:

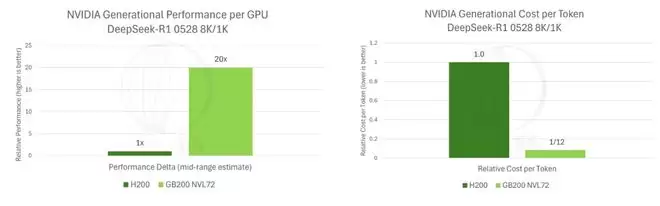

基准测试数据展示了一个被重塑的格局:

GB200 NVL72让「超过8块GPU的张量并行配置」也能进入帕累托前沿,达到单节点平台根本无法匹敌的性能。

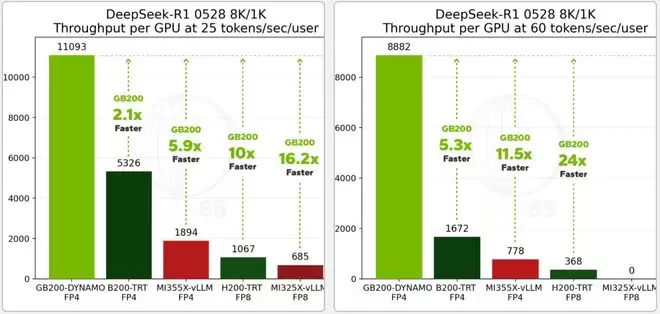

在25 tokens/sec/user交互性目标下,GB200 NVL72单GPU性能大约是H200的10倍,并且超过MI325X单GPU性能的16倍。

这类性能差距,正是能为AI服务提供商带来「断崖式」TCO改善的那种差距。

当交互性目标提高到60 tokens/sec/user时,GB200 NVL72相比H200带来了超24倍的代际提升,同时也接近MI355X的11.5倍性能。

在同样25 tokens/sec/user下,GB200 NVL72单GPU性能大约是B200的2倍、是MI355X的5.9倍;

而到60 tokens/sec/user时,这些优势进一步扩大:相对单节点B200达到5.3倍、相对MI355X达到11.5倍。

GPU越贵,token成本越低

英伟达从Hopper过渡到Blackwell,并推出GB200 NVL72时,不仅提升了每GPU算力、内存带宽以及NVLink互连带宽,还对底层系统架构做了重新设计。

从8-GPU风冷HGX服务器转向全液冷的机架级系统,并把72块GPU连接在同一个域内,系统成本和复杂度显然都上升了。

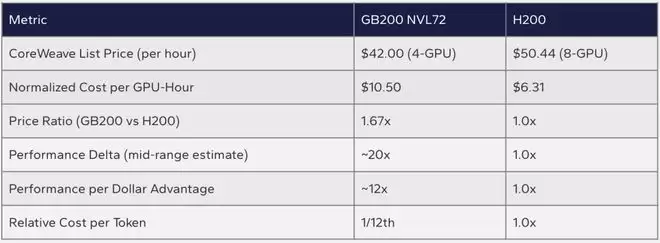

据CoreWeave公布的目录价,按单GPU口径,GB200 NVL72价格大约比H200贵1.7倍。

不过,每一代新技术的目标之一,就是压低「每Token成本」。

对推理而言,具体就是:实际交付的Token吞吐提升幅度,要超过底层基础设施成本的提升幅度。

而从公开的性能数据来看,这正是GB200 NVL72相比Hopper所呈现出的结果。

Signal65把本次的tokenomics(Token经济学)分析,锚定在前文建立的DeepSeek-R1性能差距上:

在25 tokens/sec/user时,GB200 NVL72单GPU性能大约是H200的10倍;

在更高的交互点位上,这个差距会更大(24倍)。

下表总结了成本归一化,以及由此得到的「每美元性能」计算:

这些结果一开始可能有点反直觉:更「贵」的GPU反而更省钱——因为它带来的性能提升远大于价格差异,使得它能以更低成本生成Token。

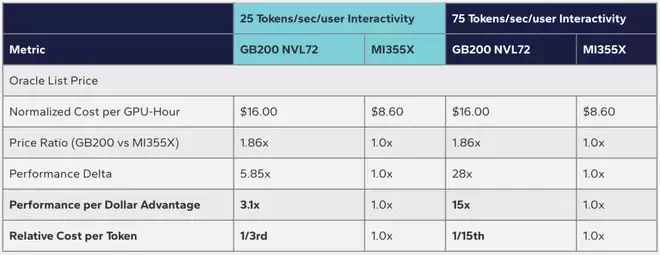

与AMD相比,英伟达系统在推理token成本上的一些数据对比:

按单GPU口径,MI355X价格大约只有GB200 NVL72配置的一半;

但由于GB200 NVL72单GPU性能优势从低端接近6倍,到高交互性时高达28倍不等,英伟达仍然能提供最高15倍的每美元性能优势。

换句话说,英伟达能实现相对每Token成本仅为竞争对手的1/15。

结论

前沿AI模型的未来,会是更大、更复杂的MoE。

随着模型更深地走向MoE与推理架构,最终效果将不再只取决于原始GPU性能或内存容量。

平台级设计会成为决定性因素——包括互连与通信效率、多节点扩展特性、软件栈成熟度、生态支持与编排能力,以及在并发与混合负载下维持高利用率的能力。

从当前趋势看,来自OpenAI、Meta、Anthropic等前沿公司的旗舰模型,很可能会继续沿着MoE与推理方向演进。

如果这一轨迹成立,英伟达将维持关键的性能与经济性优势。

谷歌TPU这类架构也提供机架级方案,但它们对非自家模型的适用性与性能表现仍不明确。

相关攻略

自去年下半年启动的内存涨价趋势,在今年第一季度达到新高,给下游的手机、电脑等制造企业带来显著压力,连苹果也不得不暂时下架部分Mac机型。核心零部件成本上升,已成为行业必须面对的严峻挑战。 进入第二季度,内存市场的紧张态势并未缓解。最新行业分析显示,存储芯片价格仍在持续攀升,且上涨幅度较上一季度更为明

2026年的全球半导体市场,正被一场深刻的结构性失衡所定义。高带宽内存、DRAM及NAND闪存等关键存储组件的价格一路飙升,其根源在于数据中心正以前所未有的胃口,吞噬着全球近七成的内存产能。这场由上游引发的风暴,如同精准传导的多米诺骨&牌,迅速波及PC、智能手机、新能源汽车等下游产业,最终让每一位普

ROG发布幻刃DDR5RGB20周年版内存条,采用24GBx2的DDR5-6000规格,时序CL26-36-36-76,搭载海力士M-DIE颗粒,提供终身质保。产品定位高端,首发价5999元,计划6月下旬上市。

CPU-Z发布2 20版本,显著扩展了对新一代处理器的识别支持,包括AMD锐龙PRO9000、锐龙AI400G系列及代号“GorgonHalo”的多款高端型号,以及英特尔相关平台。同时,新版本新增了对HUDIMM和HSODIMM等前沿内存模组的识别能力。

据外媒报道,近期发生了一件可能是最离谱的“捡漏”故事,不过这种运气可不是人人都有。 最近在Reddit上,一位用户的经历让整个硬件圈都直呼“离谱”。他在一家本地的清仓店里,只花了6 99美元,就成功拿下了一套64GB的DDR5笔记本内存(2×32GB)。 价格错误的“捡漏”故事之前也听过不少,比如半

热门专题

热门推荐

微信群里的接龙,方便是真方便,但整理起来,那叫一个头疼。手动复制粘贴,不仅耗时费力,还容易出错、遗漏,最后导出的表格格式五花八门,看着就心累。 有没有一种方法,能让这个过程自动化,让数据自己“跑”进表格里?答案是肯定的。借助一些工具,我们可以实现群内接龙数据的自动识别、解析和归档。下面,就来拆解一下

VineCoin(VINE币):重塑创作者经济的区块链新星 在数字资产的浪潮中,VineCoin(VINE币)正作为一个新兴项目崭露头角。它并非又一种简单的代币,其野心在于利用区块链技术,从根本上重塑内容创作与社交互动的经济规则。可以说,它致力于成为一个去中心化生态系统的核心引擎,目标是为全球的内容

ToClaw文件整理术:一键清理桌面杂乱文件的秘籍 | AI智能文件管理教程 利用AI智能助手整理电脑桌面文件,愿景虽好,但在实际应用中,你是否也遇到过分类不准确、指令执行失败,甚至文件被误移的困扰?请放心,这些问题往往源于几个关键的设置步骤尚未完善。掌握以下这套经过验证的ToClaw文件整理优化方

三星电子工会确认原定罢工计划未取消,但将遵守法院禁令,确保罢工不影响正常生产流程。劳资博弈进入微妙阶段,工会需在法律框架内施压,公司生产秩序暂获法律庇护,后续发展取决于双方谈判。

千问AI赋能社群自动化运营:一、关键词触发智能回复;二、定时任务精准推送;三、敏感词实时过滤预警;四、成员标签化智能分组。 社群运营工作繁杂,常常需要处理大量重复性任务,如解答常见问题、发布定时通知、监控群内动态等,这让运营者倍感压力。如何实现高效、智能的社群管理,解放人力?利用千问AI的强大功能,