TRAE年度更新200次,字节如何吸引全球600万开发者?

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

2025 年末的 AI 编程圈,分别来自中美 AI IDE 第一玩家的两条最新消息,为本就热闹的市场再添一把新柴。

12 月 26 日,字节跳动旗下 AI 编码工具 TRAE 发布了首份年度报告,并在其中披露:发布不到一年,TRAE 共计为全球用户生成近 1000 亿行代码,处理了 5 亿条开发查询。其全球累计用户数量已经突破 600 万,覆盖近 200 个国家和地区,月活攀升至 160 万。

这是什么概念呢?开源项目分析机构 OpenDigger 做过一个统计,全球 GitHub 活跃开发者总量为 7700 万。基于这个数据,换算一下的话,全球每 13 个开发者中,就有 1 个正在使用 TRAE

更关键的是增长势能与用户粘性,近半年 TRAE Token 消耗量暴涨 700%,6000 名核心用户全年使用天数超 200 天,国际版付费用户更是实现自然周全勤。

几乎在同一时间,同赛道的另一匹黑马 Cursor 传来融资捷报:11 月 14 日,Cursor 母公司 Anysphere 完成 23 亿美元融资,估值飙升至 293 亿美金,这一数字超过了国内大模型六小虎的估值总和

然而,就在一年前,行业对 AI IDE 的评价还充满鄙夷:魔改 VS Code+套壳大模型、只能哄骗没开发经验的小白、生产环境没法用……类似的嘲讽在技术社区随处可见。

短短一年,口碑两级逆转背后,行业到底发生了什么?

通过复盘 TRAE 2025 年累计超 200 次的迭代细节,我们发现,这场质变的答案,就藏在性能、全能、智能,这三个行业关键词中。

01

性能:AI Coding 落地生产的基石

2025 年,当整个大模型产业的主题,从前一年的百模大战快进到AI IDE 井喷,市场的关注重点,也从是否具备某种能力的选择题,升级成为了用户体验如何的应用题。

性能正是 AI IDE 逆袭的核心逻辑之一。

TRAE 年度报告中的数据给出了佐证:6 月至今,TRAE 的补全延迟降低 60%+,客户端首 Token 耗时降幅达 86%;9 月以来,TRAE 首次构建耗时减少 70%+,非首次构建耗时减少 80%;稳定性层面,TRAE 的 MacOS 崩溃闪退率降至 0.43%,Windows 系统降至 0.71%,补全成功率和会话成功率均提升至 99%+,面板进入成功率更是高达 99.93%。

当然,这些工程层面的优化,往往不是各种榜单测评中的重点,但对开发者的实际体验却至关重要:

这意味着他们可以不再因等待补全中断思路,也无需因工具闪退重复劳动;也同时意味着,AI 编程工具的可用性与稳定性,已经跨过了从 demo 到生产环境的关键一步

字节内部的实战正是最好的证明:据了解,字节内部 92% 的工程师在都使用 TRAE 加速开发进度;其中,抖音生活服务在 DevOps 全链路中接入 TRAE 后,AI 的代码贡献总量占比达 43%,约等于提升近一倍的人效比。

但性能的提升只是落地生产的第一步,如何打造完整的开发体验,才是今年下半年以来行业的关键赛点。

02

全能:全流程开发的全链路打通

性能达标后,今年下半年起,AI 编程工具的竞争就从代码补全、检索等单点任务,升级至全流程覆盖的完整解决方案。

这场竞赛中,Cursor 和 TRAE 的迭代路径极具代表性。

2025 年 10 月,Cursor 正式发布 2.0 版本,宣布支持多模型并行执行、内置浏览器代码测试及语音转码功能,目标直指全流程开发。

而 TRAE 的布局更早:7 月从 1.0 阶段(插件+IDE)升级到 2.0 阶段(SOLO Beta),集成编辑器、终端、浏览器等多工具视图,打通从需求构思到代码落地的完整链路;11 月再推 3.0 阶段 SOLO 正式版,主打「The Responsive Coding Agent」,完成从工具集成到智能协同的升级。

体现在产品设计上,截止如今,TRAE 的 IDE 模式,其核心支撑体系包含智能体、MCP(模型上下文协议)、上下文管理、Cue 四大模块,SOLO 模式在此基础上又进一步强化了对话流、工具面板和上下文管理能力。

其中,值得一提的是,SOLO 模式中的 SOLO Builder 可直接处理 PRD、技术架构文档,并集成了 Figma、Supabase、Stripe、Vercel 等主流工具。而这也意味着,AI 编程软件有了覆盖完整开发的全流程,在连续、多轮、更复杂的项目中承担了更多实质性工作的能力。

支撑这种全能性的,则是行业在上下文管理和工具调用能力上的突破,这也是企业级用户选择专业 AI IDE 而非原始大模型的核心原因。

先看超长上下文管理能力。企业级项目对历史代码的调用、复用程度极高,部分大型项目复用率甚至超过 80%,但海量代码的处理的是大模型的天然短板。

以 Google Chrome 浏览器为例,其代码量达数百万行,按每行代码 5-10 个 Token 计算,完整加载需上千万 Token,远超当前大模型 20 万 Token 左右的普遍上下文窗口。

专业的 AI IDE 则能够针对这一问题,通过引入向量数据库构建 RAG,或者对历史内容进行修剪、分类、优化、压缩等操作,进行上下文管理,从而保证海量代码搜得到的同时,也不会产生过长的上下文,撑爆大模型。

比如 TRAE SOLO 的解决方案就是同时引入以上两种模式,既支持一次检索 10 万个代码文件,通过索引构建实现全仓库的上下文覆盖,让庞大项目的开发不再受限于模型上下文窗口的局限;同时也推出了智能压缩机制,当上下文超过窗口限制时,可以自动压缩,也允许用户手动触发压缩,释放上下文资源,提升模型输出效果。

除此之外,考虑到实践中的上下文类型的多样化,TRAE 还支持 10 余种上下文类型的添加,包括#file(文件)、#folder(文件夹)、#doc(文档)、#code(代码)、#figma(设计稿)、#image(图片)等。

如果说更强的上下文检索与更强的大模型,让模型可以深入大型、企业级项目的开发;那么工具使用能力的进化则带来了更好的四肢,支撑起 AI c 编程软件在企业级项目中的全流程覆盖。

TRAE 目前支持的 MCP,涵盖浏览器自动化(Chrome DevTools、Playwright)、AI 辅助推理(Sequential Thinking)、系统工具(文件管理、命令执行)、专业工具(IDA Pro 反汇编、Supabase 数据库操作)等多个品类,总数量达 1.1 万个。

借助以上海量工具的接入,企业真正实现了项目不同开发环节在同一流水线上的高效、无损对接:比如,集成 Figma 实现了设计稿直接转代码,解决了前端开发中设计与开发的衔接痛点;集成 Supabase 打通了数据库操作链路,无需切换工具即可完成数据层开发;Stripe 的集成则让支付功能开发无需重复对接第三方接口;Vercel 的接入则实现了代码编写与部署的即时联动。

体现在实际项目中,就是过去开发一个带支付功能的 H5,企业要在设计工具、编辑器、数据库工具、部署平台间反复切换,现在用 TRAE SOLO 模式,一个界面就能完成所有操作。

但问题是,专业项目中,AI 产出的代码,我们真的能相信它吗?

03

智能:如何实现 AI 自主能力与可控的平衡

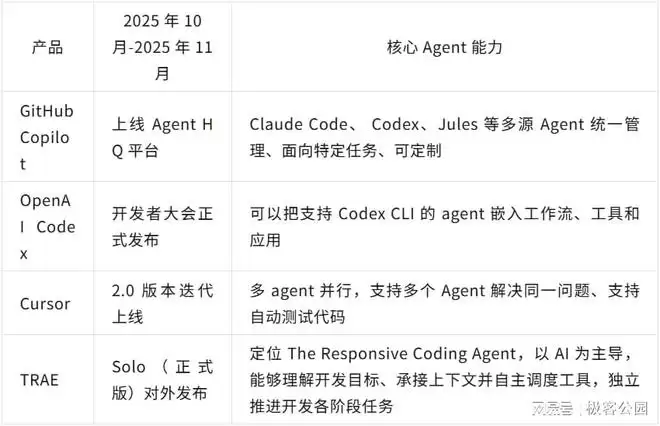

一组有趣的对比是:进入今年十月以来,AI 编程赛道掀起了一股 Agent 热:从开源代码平台 GitHub,到大模型玩家 OpenAI,再到主流 AI IDE 产品 Cursor 、TRAE 全数下场,试图让 AI 能够自主理解开发目标、承接上下文并自主调度工具,独立推进开发各阶段任务。

TRAE SOLO 正式版,无疑是其中增长最为迅速的一个:数据显示其国际版 SOLO 模式从 Beta 到正式版,用户累计渗透率达 44%,问答规模暴涨 1300%。中国版 SOLO 上线后,每 10 位 TRAE 开发者中就有 3 位采用 SOLO,问答规模增长 7300%,用户交互深度提升 74%。

但供给侧的狂热,与需求侧的警惕形成对比:近期多家大厂陆续出台 AI 编码限制政策,泄密之外,AI 生成项目 BUG 过多成为核心顾虑。在实际生产中,AI 花两分钟生成的代码,常常需要程序员用 20 分钟 review,然后再花两小时改 Bug。

对比背后,是 AI 编程的致命两难:要如何在提升 AI 自主性的同时,保证代码的可控性和可追溯性?

TRAE 的解法是将「结对编程」理念融入 AI 工具设计。

这一诞生于 XP 敏捷开发的概念,核心是两个角色协同:驾驶员负责敲代码、关注细节,导航员负责把握方向、发现问题。

TRAE SOLO 将这种模式升级:当用户使用 SOLO Coder 智能体时,可以勾选「Plan」模式,AI 收到任务后不会直接写代码,而是先输出详细的开发计划,开发者可以与 AI 反复沟通方案,明确开发阶段、任务拆分和技术选型,直到达成共识再推进开发。

此外,在大型项目中,牵一发而动全身,如果 AI 生成的代码不规范、黑盒过多,短期看似高效,实则将项目风险后置,形成技术债务雪球越滚越大,且难以修复。

因此,Reddit 上一度流行一个段子:本来代码写出来只有作者和上帝能看懂,用了 AI coding 之后,就只剩上帝能看懂了。

针对大型项目这种对标准化的更高需求,TRAE 推出了自定义智能体功能。开发者可以根据项目的开发规范、流程要求,创建专属智能体,让 AI 生成的代码天然符合团队的编码习惯和质量标准。

数据显示,TRAE 中国版 57% 的用户会使用多于一种智能体,国际版 84% 的用户会使用多于一种智能体。TRAE 累计成功创建/编辑的自定义智能体达 36.5 万个。

04

结尾

过去一年多,关于 AI 编程,行业一直有一个疑问:当大模型的能力已经足够强大,甚至能直接通过对话生成代码时,我们为何还需要专门的 AI IDE 软件?

前 a16z 合伙人 Benedict Evans 在近期做客老东家播客时,给出了答案:当你与空白的原始聊天机器人对话时,你的提问不仅要说明想要什么,还要包含实现这件事的所有细节。

换而言之,好的产品是能力与经验的封装,最终交付给用户的是解决方案,大模型只是被封装的内容之一。而用户打磨实现细节、交付完整解决方案。

从这个角度来说,TRAE 本质上是字节的先进代码开发经验,以及大模型能力的深度封装。

而位列国产 AI IDE 第一的 TRAE,其本质,正是一个「伪装」成 AI IDE 形态的字节能力全家桶 RAR。

相关攻略

2026年开年,科技圈的情绪有些微妙。AI智能体能自主调用软件完成任务了,AI编程工具能把开发周期压缩到原来的几分之一了,连谷歌搜索的流量都在被AI对话分走。一种声音开始出现:传统软件会被AI替代吗

智东西作者|江宇编辑|漠影飞书把整套办公能力,直接开放给AI调用了。智东西4月1日报道,今日,飞书正式开源CLI工具lark-cli,覆盖即时通讯、云文档、多维表格、日历、会议、邮箱、任务、知识库等

克雷西 发自 凹非寺量子位 | 公众号 QbitAIOpenClaw火了之后,一个问题也自然浮现——如果你是一个管理者,想给整个公司人手配一只虾,该怎么办?听上去就是多开几个实例的事,但实际上,想要

“干活的Token,是简单问答的10倍,甚至100倍。”在几天前中关村论坛的一场开源主题圆桌上,当杨植麟把“为什么涨价”的问题直接抛给智谱CEO张鹏时,收到了这样的回答。张鹏选择用模型市场眼下正在发

3月31日,Anthropic因npm包打包失误,导致Claude Code约51 2万行源代码泄露,含4756个源文件、40余个工具模块及多项未发布功能,就此被动向全球开发者“开源”。该代码由研究

热门专题

热门推荐

《和平精英》战斗军犬全方位使用指南:从特性解析到实战精通 在《和平精英》中选用战斗军犬作为战术伙伴,首先需要深入理解其核心特性与定位。军犬堪称战场的“生物侦察系统”,其卓越的追踪与索敌能力,能为你精准捕捉敌人的足迹与动向。自跳伞开始,你的战术规划就应将军犬纳入其中——预先评估落点周边的地形与建筑布局

《无限轮回》主线第三章红妆阁全攻略:地图、怪物与关键线索全解析 各位探索者,你是否正因《无限轮回》主线第三章“红妆阁”的复杂谜题与强敌而止步不前?无需焦虑,这份详尽的全流程通关攻略将为你层层剖析。从精细地图解析到怪物机制拆解,再到核心藏品与剧情线索的位置说明,所有关键信息一网打尽。阅读本文后,你将获

死亡搁浅2发明家岛屿前往方法路线全攻略 在《死亡搁浅2》的宏大世界中,发明家岛屿是一个充满机遇与秘密的重要地点。它如同地图上的一颗明珠,吸引着玩家前往探索。然而抵达之路并非一帆风顺,需要策略与准备。这份指南将为你详细解析前往发明家岛屿的完整流程与要点。 推进主线剧情,解锁关键任务节点 前往发明家岛屿

远光84梅歇尔高手进阶:全面玩法技巧与实战教学 许多《远光84》的玩家都想知道,游戏中的强力角色梅歇尔究竟该如何驾驭?本篇攻略将为你深度解析她的核心玩法与实战技巧,助你从入门到精通,充分发挥这位角色的战场统治力。 远光84梅歇尔深度技巧攻略: 技能释放的精髓 梅歇尔的技能组合兼具灵活性与高额伤害,掌

如何在《明日方舟:终末地》中为洛茜搭配武器:提升输出循环与技能收益的关键攻略 各位博士,大家好。在《明日方舟:终末地》中,六星近卫干员洛茜凭借独特的物火混伤与破防叠加机制,成为了战场上的关键角色。她的武器选择,不仅直接影响输出手感的流畅度,更决定了技能加成的最终上限。本文将为您提供一套详尽的洛茜武器