AI驱动Agent协作:文本终局中复制思维,Token效率飙升

机器之心报道

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

编辑:陈陈

在 Agentic AI 时代,模型不再是独来独往的学霸,而是开始学会组队、一起想问题。多智能体系统(MAS,multi-agent systems)的发展让 AI 世界从一个人苦想变成了多人头脑风暴。尤其是基于大语言模型的 MAS,如今已经被用在各种任务中。

不过,在这个组合里,AI 基本靠文本交流,最近有人开始思考:LLM 在大脑里(也就是潜在空间)想事情时,其实比说出来要丰富得多。

于是一些研究开始尝试让模型直接用隐藏层来表示想法,比如 (i) 用 Transformer 的隐藏表示来实现单模型的潜在链式思考推理, (ii) 使用 KV 缓存或层级嵌入在两个模型之间交换信息。

然而,一个能够同时统一潜在推理与潜在通信的全面模型协作框架仍未被探索出来。

为进一步推进这一方向,来自普林斯顿大学等机构的研究者提出:MAS 能否实现真正的纯潜在空间协作?

为回答这一问题,他们提出一种多智能体推理框架 LatentMAS,其将智能体之间的协作从传统的 token 空间转移到了模型的潜在空间。核心创新是:让所有智能体不再通过文本交流,而是在潜在空间中直接协作。

一直以来,传统 MAS 依赖自然语言沟通,各个 LLM 之间用文本交流思路。这种方法虽然可解释,但冗长、低效、信息易丢失。LatentMAS 则让智能体直接交换内部的隐藏层表示与 KV-cache 工作记忆,做到了:

高效的多步推理:在大幅减少 token 的情况下,实现更复杂的思考过程;无需训练的潜在空间对齐机制,确保生成过程稳定可靠;通用性强:可兼容任意 HuggingFace 模型,并可选择性地支持 vLLM 后端。

总体而言,LatentMAS 在多智能体系统中实现了更高的性能、更低的 token 使用量,以及显著的实际运行速度提升。

为了实证评估 LatentMAS 的有效性,本文在九个基准任务上进行了全面实验,这些任务涵盖数学与科学推理、常识理解和代码生成。

结果显示 LatentMAS 始终优于强大的单模型和基于文本的 MAS 基线:(i) 准确率最高提升 14.6%,(ii) 输出 token 使用量减少 70.8%-83.7%,(iii) 端到端推理速度加快 4×-4.3×。这些结果表明,潜在协作不仅提升了系统级推理质量,还在无需额外训练的情况下带来了显著的效率收益。

论文标题:Latent Collaboration in Multi-Agent Systems论文地址:https://arxiv.org/pdf/2511.20639GitHub 地址:https://github.com/Gen-Verse/LatentMAS

这篇文章也得到了很多人转发评论,可供大家参考。比如这位网友的观点很好的概括论文:

「在传统的多智能体系统中,我们通常让智能体 A 生成文本,再由智能体 B 读取并处理。这种文本瓶颈既浪费算力,又严重稀释语义信息。LatentMAS 带来了一种近乎心灵感应式的替代方案:智能体通过交换潜在思维来协作。

智能体 A 不再把推理结果解码成文本,而是将它的工作记忆,也就是注意力层中的 KV 缓存直接传给智能体 B。于是智能体 B 在启动时,仿佛已经加载了 A 的全部推理过程。

通过将第一个智能体生成的 KV 对直接注入第二个智能体的注意力机制中,第二个智能体会把前者的内部状态当作自己的提示,从而完全绕过离散的 token 化层。这种方法比基于文本的协作快 4.3 倍,并减少 80% 以上的 token 使用量。更重要的是,它无需昂贵的训练,只用简单的线性对齐就能让嵌入空间兼容。

智能体 A 的潜在思维被直接复制进智能体 B 的记忆之中。」

还有人认为这会终结基于文本的 AI:

方法介绍

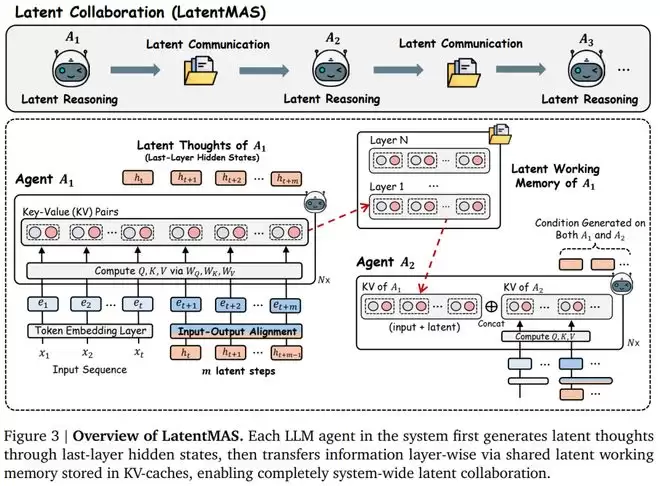

LatentMAS 是一个端到端的潜在协作框架:当给定一个输入问题时,所有智能体的推理与交流都完全在潜在空间中进行,只有最终答案才会被解码为文本输出。其核心设计结合了智能体的内部潜在思维生成与跨智能体潜在工作记忆传递。

在每个智能体内部,推理通过自回归地生成最后一层隐藏表示来展开,从而无需显式解码即可捕捉模型持续进行的内部思考;在智能体之间,信息通过存储在各层 KV 缓存中的共享潜在工作记忆进行交换,其中包含输入上下文以及新生成的潜在思维内容。

基于这些设计,LatentMAS 建立在三个基本原则之上,这些原则也通过全面的理论与实验分析得到了验证:

推理表达能力:隐藏表示天然地编码模型的连续思维,使得每一步潜在推理都能传递远比离散 token 更丰富的信息。通信保真度:潜在工作记忆完整保留了每个模型的输入表示与潜在思维,从而实现跨智能体的无损信息传递。协作复杂度:与 TextMAS 相比,LatentMAS 在协作表达能力更强的同时,其推理复杂度却显著更低。

前两个原则共同强调了 LatentMAS 的核心优势:它能够支持更丰富的潜在推理,并实现无损的潜在交流。第三个原则则从整体复杂度角度进一步说明:LatentMAS 在保持高表达能力的前提下,其计算复杂度远低于基于文本的 MAS。

该方法使系统中的 LLM 智能体能够:

(i)在潜在空间中生成具有超强表达能力的潜在思维;

(ii)在智能体交互过程中,以无损的方式保留并传递各自的潜在工作记忆;

(iii)在保持与传统 TextMAS 相同表达能力的同时,实现显著更低的计算复杂度。

实验

相关攻略

OpenClaw的爆火,让众多AI应用开发者第一次直面了高昂的Token账单——一个用户请求可能触发多轮工具调用,每次调用都携带超长上下文,实际的API成本远超预期,甚至可能达到订阅费用的数十倍。如何有效控制Token成本,正成为AI Agent开发者面临的核心挑战与增长瓶颈。 这显然不是可持续的商

这项由瑞士洛桑联邦理工学院(EPFL)、意大利卢加诺大学(USI)、韦斯利安大学、巴黎脑研究所(ICM)以及宾夕法尼亚州立大学联合开展的研究,以预印本形式发布于2026年4月,论文编号为arXiv:2604 03480。对这一交叉领域感兴趣的读者,可以通过该编号在arXiv平台上查阅完整原文。 一、

北京商报讯(记者 陶凤 王天逸) 人工智能领域又传来一条振奋人心的消息。4月8日,摩尔线程正式宣布,其旗舰级AI训推一体全功能GPU——MTT S5000,已经成功完成了对智谱新一代旗舰模型GLM-5 1的Day-0极速适配。这意味着,推理部署与训练复现的全部流程,现在都能在这条国产算力路径上获得支

如何用SQL求解逻辑推理题:经典楼层分配谜题实战 今天我们来探讨一个非常有趣的技术应用:使用SQL来求解逻辑推理题。这听起来或许有些大材小用,但正是这种跨界应用,充分展现了SQL语言的强大灵活性以及开发者分析问题的思维能力。我们将以一个经典的五人楼层分配谜题作为案例,逐步拆解如何用纯粹的SQL找到答

一个学生忽视了一行代码,结果发现了一件很不对劲的事:在一个多模态医学AI项目中,这行代码原本负责让模型读取图像数据。但因为这次疏忽,模型实际上完全没有看到任何图片。按理说系统应该报错,或者至少拒绝回

热门专题

热门推荐

领克首款GT概念跑车亮相北京车展,由中欧团队联合打造。新车采用经典GT比例与低趴宽体设计,配备液态金属蓝涂装与2+2座舱,设有高性能模式按键可激活空气动力学套件。车辆采用后驱布局与AI智能运动控制系统,百公里加速约2秒,设计融合瑞典极简美学并参考全球用户反馈。

英伟达推出12GB显存版RTX5070移动GPU,与8GB版同步上市。两者均基于Blackwell架构,核心规格相同,仅显存容量不同。此举旨在缓解GDDR7芯片供应压力,为OEM提供灵活配置,加速笔记本产品布局,更大显存可更好满足游戏与AI应用需求。

微星将于5月15日推出两款26 5英寸雾面WOLED显示器MAG276QRY28和276QRDY54,售价分别为2499元和6299元。均采用第四代WOLED面板,具备QHD分辨率、VESADisplayHDRTrueBlack500认证、1500尼特峰值亮度及99 5%DCI-P3色域覆盖。276QRY28刷新率为280Hz,高阶款276QRDY54支持4

中芯国际2026年第一季度营收176 17亿元,同比增长8 1%;净利润13 61亿元,同比增长0 4%。公司预计第二季度收入环比增长14%至16%,毛利率指引上调至20%至22%。这反映出公司在行业复苏中展现出财务韧性,并通过运营优化增强了短期增长势头。

手机修图、相机降噪、视频去雾……这些我们日常使用的图像处理功能,其背后都离不开人工智能(AI)技术的驱动。通常,AI模型的训练逻辑是:向模型展示大量“低质图像”与“优质图像”的配对数据,让它学习如何将前者转化为后者。然而,天津大学计算机视觉团队近期发表的一项研究(arXiv:2604 08172)揭