基于Paddle2.0的样式校正卷积网络SRM

本项目复现2019年论文提出的SRM网络,首次用Paddle2.0实现含风格校正的SRM,在10分类动物数据集(按8:2划分)上实验。对比SRM、GE、SE模块及ResNet50,SRM验证准确率0.8736,优于其他,表明风格校正机制提升分类效果。

项目背景

SRM是2019年arxiv上的一篇论文SRM : A Style-based Recalibration Module for Convolutional Neural Networks中提出的基于风格迁移机制的通用卷积网络模型。本项目即对其进行复现。

风格迁移需要用到卷积神经网络。可否充分利用卷积神经网络中产生风格迁移的机制,并将其用于一般的计算机视觉任务呢?本项目复现SRM网络并用其来完成动物图像分类的实验。项目简介

本项目首次使用paddle2.0复现了含有基于风格校正的网络SRM,并在动物数据集上进行了训练和验证。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

动物数据集的划分是按8:2的的划分方法进行训练集与验证集划分的。

模型简介

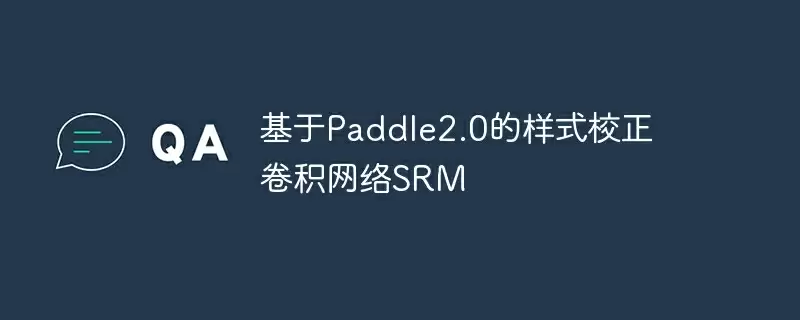

SRM网络的核心思想是提出了SRM模块。该模块首先通过风格池化从每个通道的特征图中提取风格信息,然后通过风格集成来评估每个通道的校正权重。其中,风格池化是在空间维度上操作,风格集成是在通道维度上操作。这种将特征图和风格权重相结合的方式本质上是一种注意力机制,只不过这种注意力关注的是特征图中的风格信息。SRM示意图如图1所示。

图1 SRM模块示意图

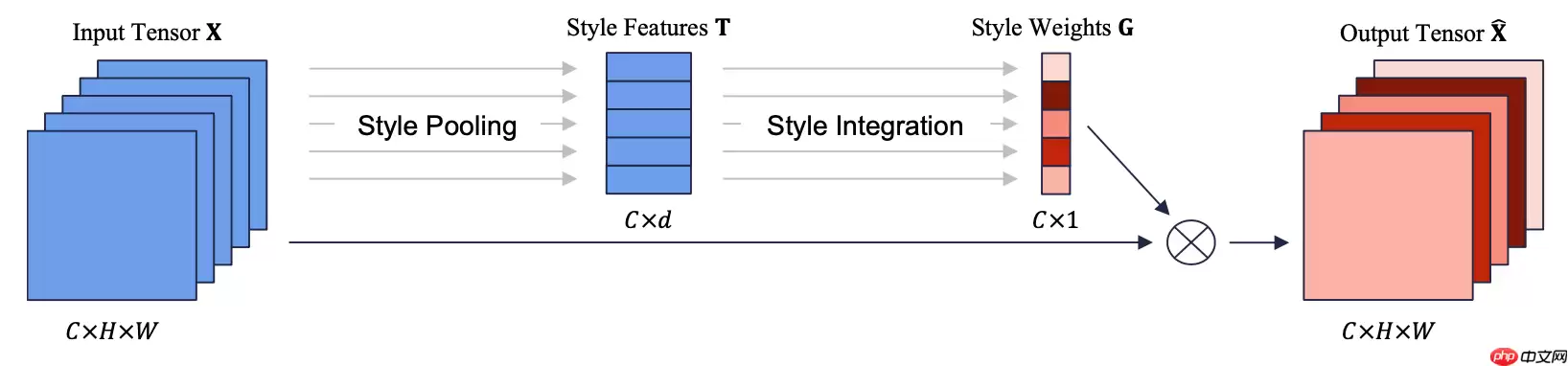

SRM实现细节如图2所示。

图2 SRM模块实现细节示意图

具体实现可以fork后见代码细节。

论文原文:SRM : A Style-based Recalibration Module for Convolutional Neural Networks

参考代码:

PyTorch的实现

数据集介绍

本项目使用10分类的动物数据集进行训练和测试.

该十分类动物数据集,包含dog,horse,elephant,butterfly,chicken,cat,cow,sheep,spider和squirrel。每一分类的图片数量为2k-5k。

文件结构

解压数据集

In [2]!unzip -q data/data70196/animals.zip -d work/dataset登录后复制

查看图片

In [ ]import osimport randomfrom matplotlib import pyplot as pltfrom PIL import Imageimgs = []paths = os.listdir('work/dataset')for path in paths: img_path = os.path.join('work/dataset', path) if os.path.isdir(img_path): img_paths = os.listdir(img_path) img = Image.open(os.path.join(img_path, random.choice(img_paths))) imgs.append((img, path))f, ax = plt.subplots(3, 3, figsize=(12,12))for i, img in enumerate(imgs[:9]): ax[i//3, i%3].imshow(img[0]) ax[i//3, i%3].axis('off') ax[i//3, i%3].set_title('label: %s' % img[1])plt.show()登录后复制登录后复制

划分训练集和验证集

In [3]!python code/train_val_split.py登录后复制

finished train val split!登录后复制

使用SRM-ResNet50网络进行动物分类的训练并验证

训练

In [1]!python code/train.py --net 'attention_resnet' --recalibration_type 'srm'登录后复制

验证

In [2]!python code/eval.py --net 'attention_resnet' --recalibration_type 'srm'登录后复制

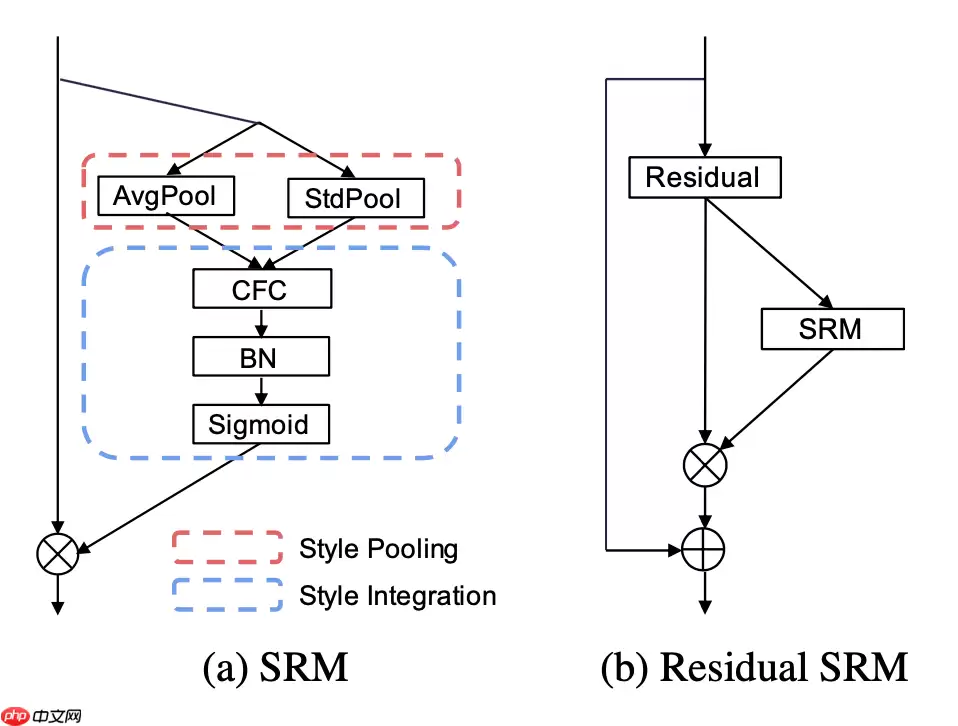

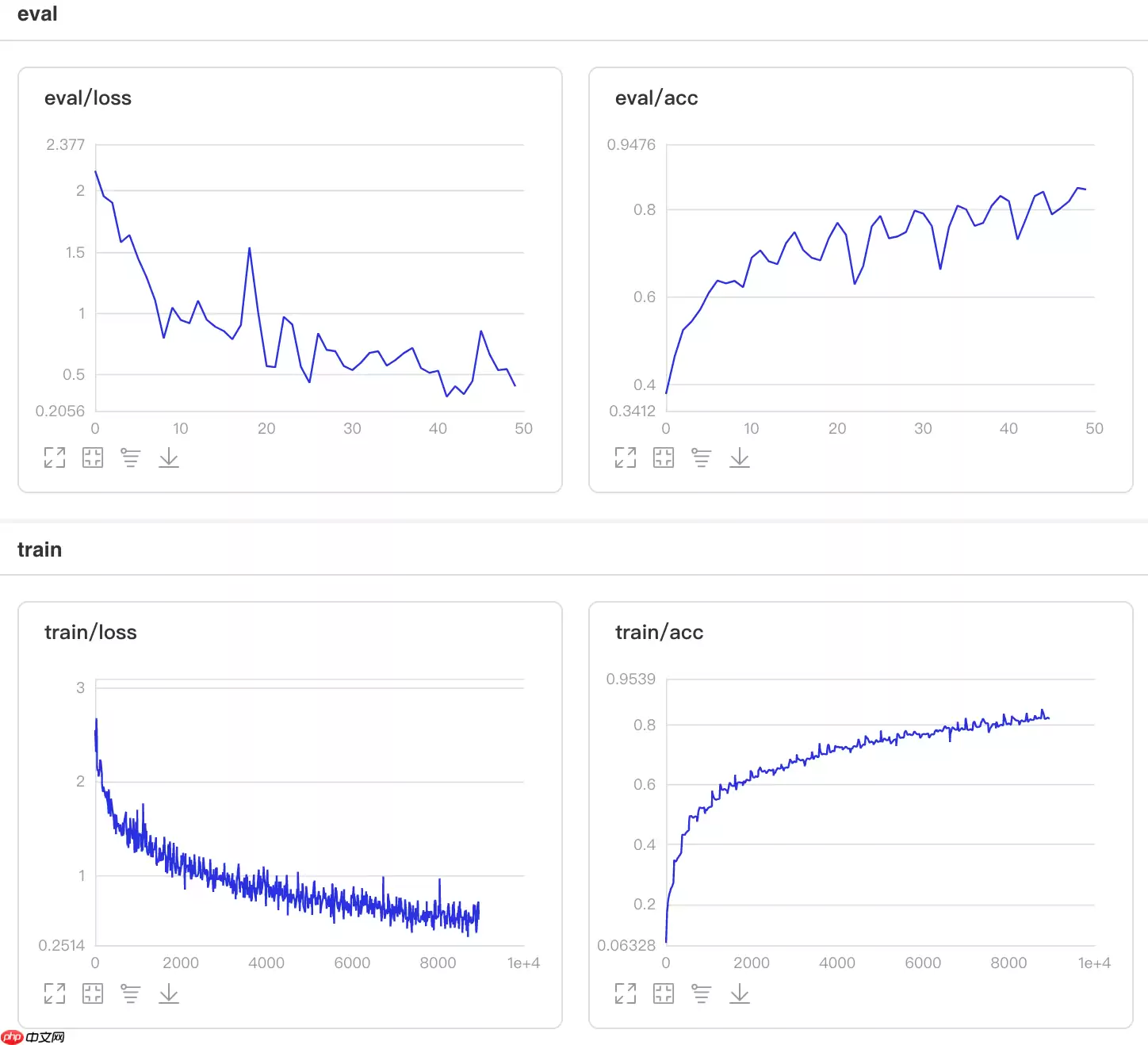

Eval begin...The loss value printed in the log is the current batch, and the metric is the average value of previous step.step 3276/3276 [==============================] - loss: 7.0645e-04 - acc: 0.8736 - 297ms/step Eval samples: 3276{'loss': [0.0007064453], 'acc': 0.8736263736263736}登录后复制图示SRM训练验证过程

图3. 使用SRM的训练验证比较图示

使用GE-ResNet50网络进行动物分类的训练并验证

In [3]!python code/train.py --net 'attention_resnet' --recalibration_type 'ge'登录后复制

验证

In [3]!python code/eval.py --net 'attention_resnet' --recalibration_type 'ge'登录后复制

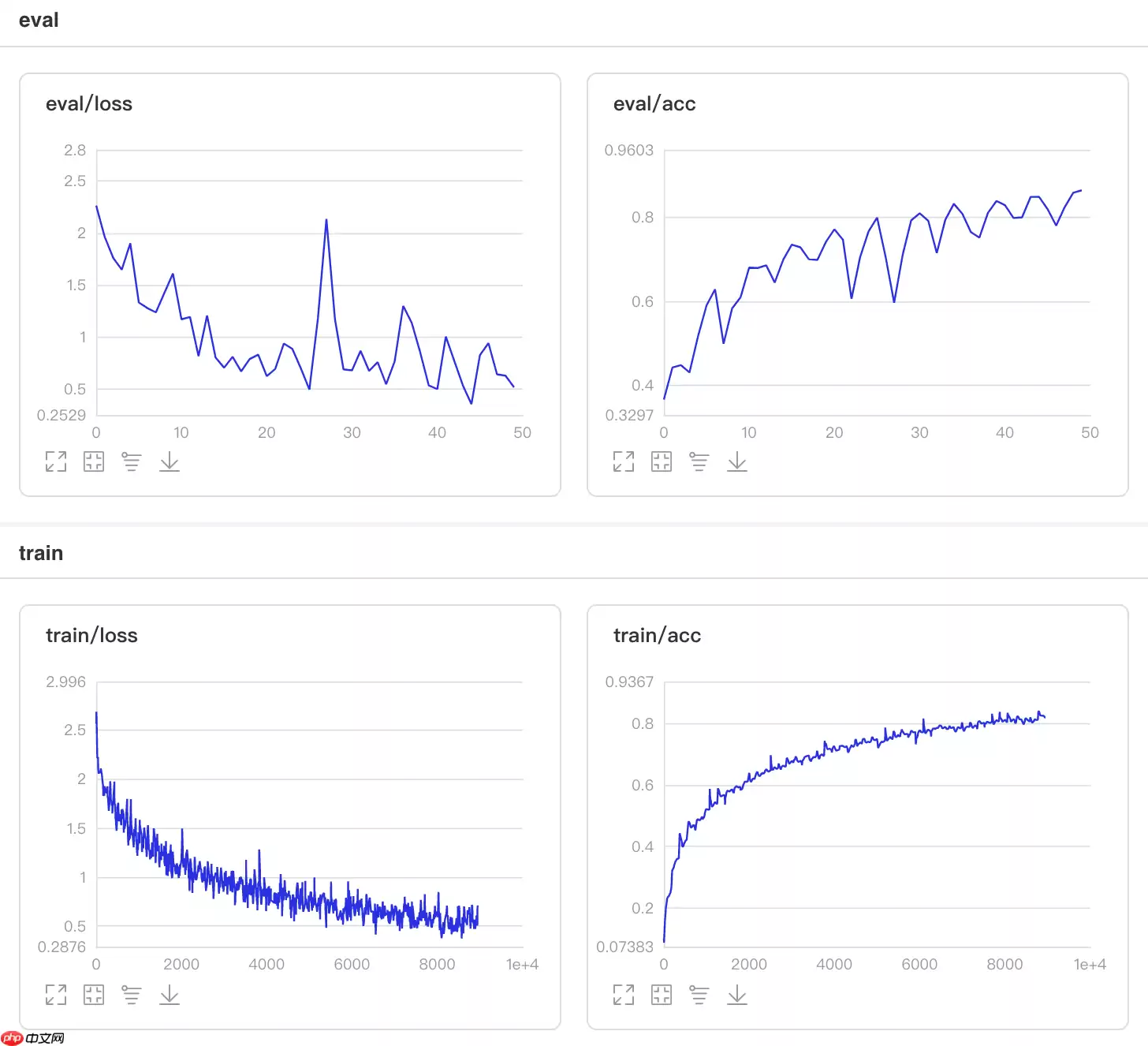

Eval begin...The loss value printed in the log is the current batch, and the metric is the average value of previous step.step 3276/3276 [==============================] - loss: 0.6899 - acc: 0.8614 - 228ms/step Eval samples: 3276{'loss': [0.6899206], 'acc': 0.8614163614163615}登录后复制图示GE训练验证过程

图4. 使用GE的训练验证比较图示

使用SE-ResNet50网络进行动物分类的训练并验证

In [4]!python code/train.py --net 'attention_resnet' --recalibration_type 'se'登录后复制

验证

In [3]!python code/eval.py --net 'attention_resnet' --recalibration_type 'se'登录后复制

W0222 10:36:03.112169 9128 device_context.cc:362] Please NOTE: device: 0, GPU Compute Capability: 7.0, Driver API Version: 10.1, Runtime API Version: 10.1W0222 10:36:03.116613 9128 device_context.cc:372] device: 0, cuDNN Version: 7.6.Eval begin...The loss value printed in the log is the current batch, and the metric is the average value of previous step.step 103/103 [==============================] - loss: 0.6246 - acc: 0.8730 - 175ms/step Eval samples: 3276{'loss': [0.6245543], 'acc': 0.873015873015873}登录后复制图示SE训练验证过程

图5. 使用SE的训练验证比较图示

使用ResNet50网络进行动物分类的训练并验证

训练

In [5]!python code/train.py --net 'resnet'登录后复制

验证

In [ ]!python code/eval.py --net 'resnet'登录后复制

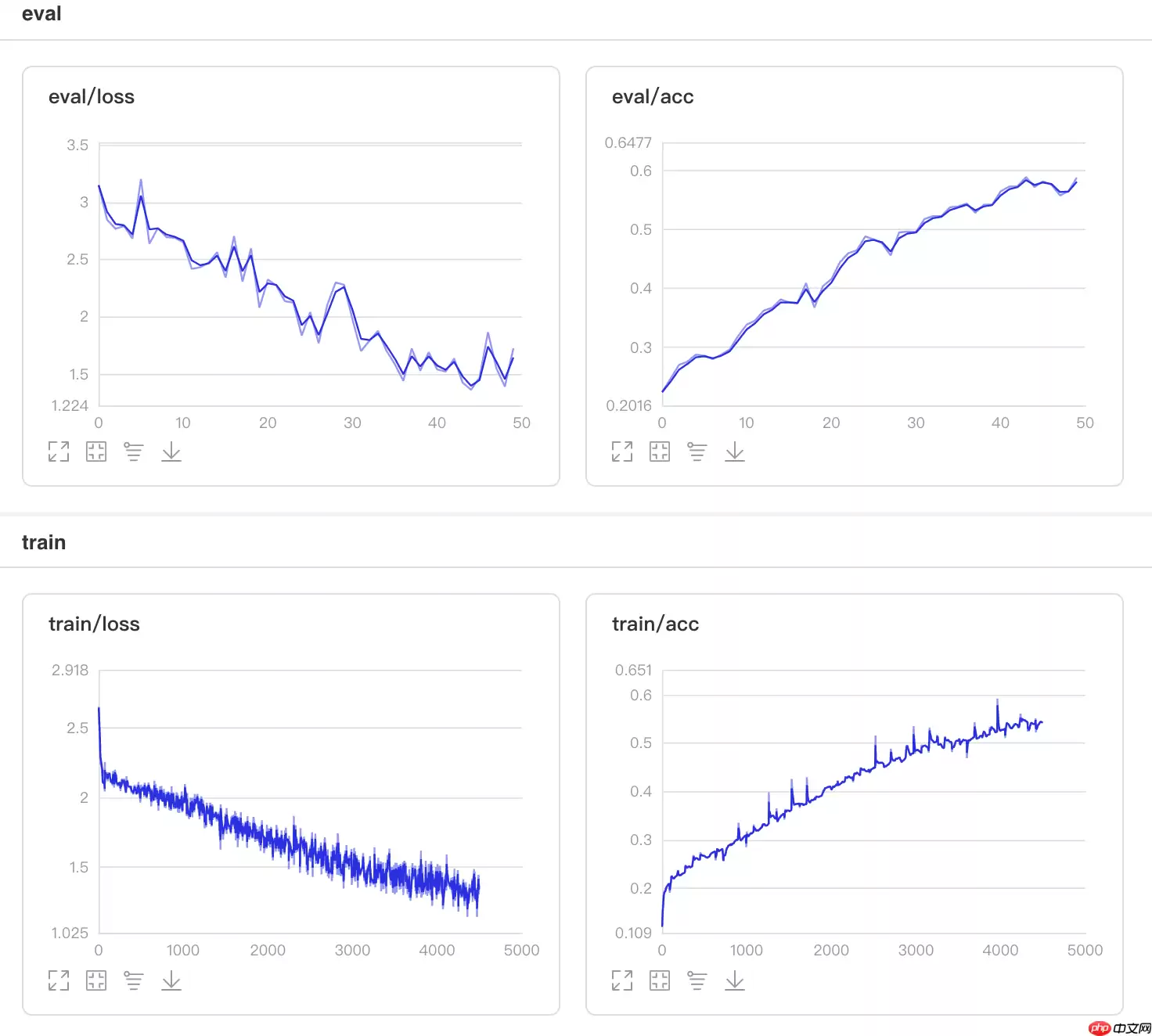

W0213 21:34:50.038996 12684 device_context.cc:362] Please NOTE: device: 0, GPU Compute Capability: 7.0, Driver API Version: 10.1, Runtime API Version: 10.1W0213 21:34:50.043457 12684 device_context.cc:372] device: 0, cuDNN Version: 7.6.Eval begin...The loss value printed in the log is the current batch, and the metric is the average value of previous step.step 103/103 [==============================] - loss: 1.4232 - acc: 0.5888 - 191ms/step Eval samples: 3276{'loss': [1.4232028], 'acc': 0.5888278388278388}登录后复制图示ResNet50训练验证过程

图6. 使用ResNet的训练验证图示

比较

图7. 使用SRM,GE,SE和ResNet的验证比较图示

相关攻略

Pywinrm 通过Windows远程管理(WinRM)协议,让Python能够像操作本地一样执行远程Windows命令,真正打通了跨平台管理的最后一公里。 在混合IT环境中,Linux机器管理Wi

早些时候,聊过 Python 领域那场惊心动魄的供应链攻击。当时我就感叹,虽然我们 JavaScript 开发者对这类套路烂熟于心,但亲眼目睹这种规模的“投毒”还是头一次。 早些时候,聊过 Pyth

Toga 是 BeeWare 家族的核心成员,号称“写一次,跑遍所有平台”,而且用的是系统原生控件,不是那种一看就是网页套壳的界面 。 写了这么多年 Python,你是不是也想过:要是能一套代码跑

异常处理的核心:让错误在正确的地方被有效处理。正确的地方,就是别在底层就把异常吞了,也别在顶层还抛裸奔的 Exception。 异常处理写得好,半夜不用起来改 bug。1 你是不是也这么干过?tr

1 Skills机制概述 提起OpenClaw的Skills机制,不少人可能会把它想象成传统意义上的可执行插件。其实,它的内涵要更精妙一些。 简单说,Skills本质上是一套基于提示驱动的能力扩展机制。它并不是一个可以独立“跑”起来的程序模块,而是通过一份结构化描述文件(核心就是那个SKILL m

热门专题

热门推荐

加密货币行业翘首以盼的监管里程碑,终于有了实质性进展。美国证券交易委员会(SEC)主席保罗·阿特金斯(Paul Atkins)近日证实,那份允许加密项目在早期获得注册豁免权的“安全港”框架提案,已经正式送抵白宫,进入了最终审查阶段。 在范德堡大学与区块链协会联合举办的数字资产峰会上,阿特金斯透露了这

微策略Strategy报告:第一季录得144 6亿美元浮亏 再斥资约3 3亿美元买进4871枚比特币 市场震荡的威力有多大?看看Strategy的最新季报就明白了。根据其最新向美国证管会(SEC)提交的8-K报告,受市场剧烈波动影响,这家公司所持的比特币在第一季度录得了一笔惊人的数字——144 6亿

稳定币巨头Tether的动向,向来是加密世界的风向标。这不,它向Web3基础设施的版图扩张,又迈出了关键一步。公司执行长Paolo Ardoino在社交平台X上透露,其工程团队正在全力“烹制”一个新项目——去中心化搜索引擎 “Hypersearch”。这个消息一出,立刻引发了行业的广泛猜想。 采用D

基地位于Coinbase旗下以太坊Layer2网络Base的Seamless Protocol,日前正式宣告了服务的终结。这个曾经吸引了超过20万用户的原生DeFi借贷协议,在运营不到三年后,终究没能跑赢时间。它主打的核心产品是Integrated Leverage Markets(ILMs)——一

PAAL代币揭秘:深度解析Web3社区治理的核心钥匙 在去中心化自治组织的浪潮中,谁真正掌握了项目的话语权?PAAL代币提供了一套系统化的答案。它不仅是生态内流转的价值媒介,更是开启链上治理大门的核心凭证。通过持有并质押PAAL代币,用户能够对协议升级、资金分配乃至战略方向等关键事务投出决定性的一票