【车道线+自动驾驶】用Paddle高层API实现车道线转角回归模型+部署

用Paddle2.2高层API实现车道线打角回归预测模型+Paddle inference边缘设备GPU部署

应该是全网第一个用paddle2.0+高层api实现小车车道线预测回归模型的搭建、训练和部署全流程的项目啦,希望能帮助做小车和机器人的小伙伴快速实现小车的无人驾驶功能~

车道线打角回归预测模型也是每年的全国大学生智能汽车竞赛都会包含的基础任务之一,希望能作为一个baseline让大家快速学习起来。

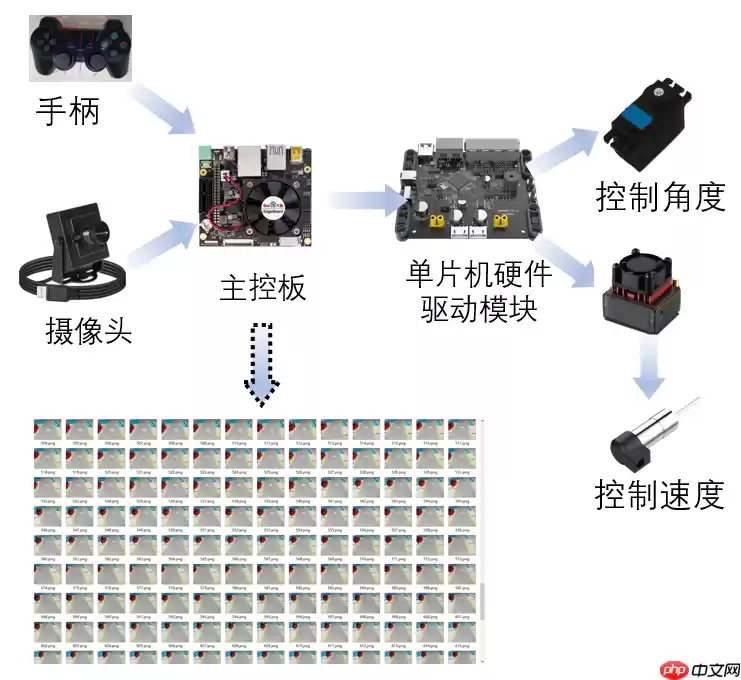

数据采集的整体架构如下图所示:

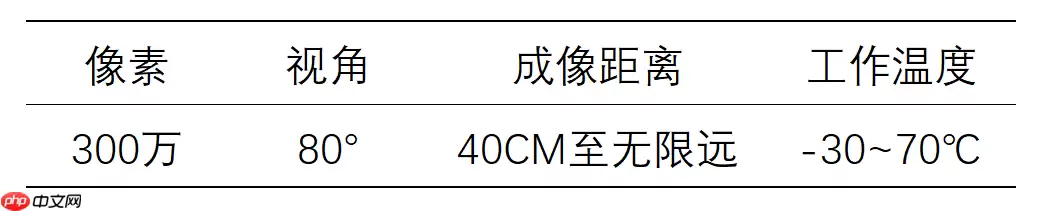

智能小车上使用标准的广角摄像头作为视觉传感器,其基本参数如下表所示:

采集的数据已上传至AI Studio:车道线检测回归数据集

1、导入必要库

In [4]import osimport cv2import iofrom tqdm import tqdmimport numpy as npimport matplotlib.pyplot as pltfrom PIL import Image as PilImageimport paddlefrom paddle.nn import functional as Fpaddle.__version__登录后复制

'2.2.0'登录后复制In [5]

!unzip -oq /home/aistudio/data/data46903/0728_carline.zip登录后复制

2、数据集制作+数据预处理

数据采集

通过手柄遥控小车,小车实时记录当前图片和手柄的打角数据,从而得到数据集。

数据集信息

本数据集共13448张图像和对应的打角数据。

数据具体格式

图像 >——> 打角数据

每一张图像都会对应一个打角数据。 图像和打角数据分别保存在img和data.txt下,在dataset的建立过程中,我们只需要将图像和打角数据一一对应进行封装即可。

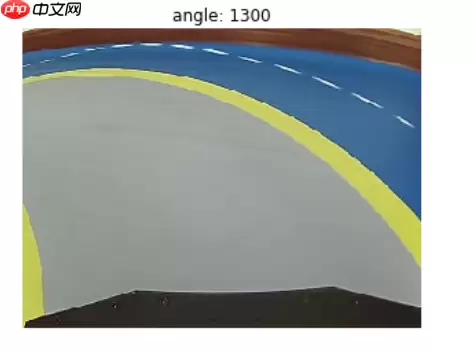

数据对应形式如图所示:

2.1、定义数据集处理变量

In [2]img_folder_path = "data/img"dataset_path = "data"txt_path = "data/data.txt"IMAGE_SIZE = (224, 224)登录后复制In [6]

# 检查数据集中图像和打角数据个数是否对应import os# 1、读取图像数据和角度数据angle_list = []f = open(txt_path)for txt in f.readlines(): txt.split("\n") angle_num = int(txt) angle_list.append(angle_num)img_list = []for img_path in tqdm(os.listdir(img_folder_path)): img_path = os.path.join(img_folder_path, img_path) img_list.append(img_path)# 2、数据归一化(如果过于发散,模型不容易收敛)# 这里我的打角数据大小为:900-2100,中间值为1500for i, angle in enumerate(angle_list): angle = (angle-1500)/600 angle_list[i] = angletry: os.remove(os.path.join(dataset_path, "train.txt")) os.remove(os.path.join(dataset_path, "eval.txt"))except: passtrain_txt = open(os.path.join(dataset_path, "train.txt"), "w")eval_txt = open(os.path.join(dataset_path, "eval.txt"), "w")n = 0for img_path, label in tqdm(zip(img_list, angle_list)): n += 1 if n % 10 != 0: train_txt.write(img_path+" "+str(label)) train_txt.write("\n") else: eval_txt.write(img_path+" "+str(label)) eval_txt.write("\n")train_txt.close()eval_txt.close()登录后复制2.3、定义数据集MyDataset

创建PaddlePaddle高层API—Dataloder可直接读入的数据集格式

In [7]import randomimport iofrom paddle.io import Datasetfrom paddle.vision.transforms import transforms as Tfrom PIL import Image as PilImageimport numpy as npclass MyDataset(Dataset): """ 数据集定义 """ def __init__(self, mode, dataset_path): """ 构造函数 """ self.image_size = IMAGE_SIZE self.mode = mode.lower() self.dataset_path = dataset_path assert self.mode in ['train', 'test', 'eval'], \ "mode should be 'train' or 'test' or 'eval', but got {}".format(self.mode) self.train_images = [] self.label_list = [] with open(os.path.join(self.dataset_path, ('{}.txt'.format(self.mode))), 'r') as f: for line in tqdm(f.readlines()): image, label = line.strip().split(' ') img = PilImage.open(image) self.train_images.append(image) self.label_list.append(label) def _load_img(self, path, color_mode='rgb', transforms=[]): """ 统一的图像处理接口封装,用于规整图像大小和通道 """ with open(path, 'rb') as f: img = PilImage.open(io.BytesIO(f.read())) if color_mode == 'grayscale': # if image is not already an 8-bit, 16-bit or 32-bit grayscale image # convert it to an 8-bit grayscale image. if img.mode not in ('L', 'I;16', 'I'): img = img.convert('L') elif color_mode == 'rgba': if img.mode != 'RGBA': img = img.convert('RGBA') elif color_mode == 'rgb': if img.mode != 'RGB': img = img.convert('RGB') else: raise ValueError('color_mode must be "grayscale", "rgb", or "rgba"') return T.Compose([ T.Resize(self.image_size) ] + transforms)(img) def __getitem__(self, idx): """ 返回 image, label """ train_image = self._load_img(self.train_images[idx], transforms=[ T.Transpose(), T.Normalize(mean=[127.5], std=[127.5]) # 归一化处理,将0~255归一化到-1~1 ]) # 加载原始图像 label = self.label_list[idx] # 加载Label # 返回image, label train_image = np.array(train_image, dtype='float32') label = np.array(label, dtype='float32') return train_image, label def __len__(self): """ 返回数据集总数 """ return len(self.train_images)# 定义训练集和验证集train_dataset = MyDataset(mode='train', dataset_path=dataset_path) # 训练数据集val_dataset = MyDataset(mode='eval', dataset_path=dataset_path) # 验证数据集登录后复制100%|██████████| 13448/13448 [00:01<00:00, 12012.05it/s]100%|██████████| 1494/1494 [00:00<00:00, 12004.41it/s]登录后复制

2.4、查看数据集的具体格式,并展示一张图像和label的对应关系

In [14]x, y = val_dataset.__getitem__(0)print(x, y)print(x.shape)print(train_dataset.__len__())with open(os.path.join(dataset_path, 'train.txt'), 'r') as f: i = 0 for line in f.readlines(): image_path, label = line.strip().split(' ') image = np.array(PilImage.open(image_path)) if i > 2: break # 进行图片的展示 plt.figure() plt.title(label) plt.imshow(image.astype('uint8')) plt.axis('off') plt.show() i = i + 1登录后复制3、基于高层API自定义模型结构

模型结构可自行修改以获得更好的效果。

In [86]import paddleimport paddle.nn as nnimport paddle.nn.functional as Fclass My_Model(nn.Layer): def __init__(self, num_classes): super(My_Model, self).__init__() self.conv1 = paddle.nn.Conv2D(in_channels=3, out_channels=32, kernel_size=(3, 3)) self.pool1 = paddle.nn.MaxPool2D(kernel_size=2, stride=2) self.conv2 = paddle.nn.Conv2D(in_channels=32, out_channels=64, kernel_size=(3,3)) self.pool2 = paddle.nn.MaxPool2D(kernel_size=2, stride=2) self.conv3 = paddle.nn.Conv2D(in_channels=64, out_channels=32, kernel_size=(3,3)) self.pool3 = paddle.nn.MaxPool2D(kernel_size=2, stride=2) self.conv4 = paddle.nn.Conv2D(in_channels=32, out_channels=16, kernel_size=(3,3)) self.flatten = paddle.nn.Flatten() self.linear1 = paddle.nn.Linear(in_features=9216, out_features=16) self.linear2 = paddle.nn.Linear(in_features=16, out_features=1) def forward(self, x): x = self.conv1(x) x = F.relu(x) x = self.pool1(x) x = self.conv2(x) x = F.relu(x) x = self.pool2(x) x = self.conv3(x) x = F.relu(x) x = self.pool3(x) x= self.conv4(x) x = F.relu(x) x = self.flatten(x) x = self.linear1(x) x = F.relu(x) x = self.linear2(x) return xpaddle.summary(My_Model(num_classes=1), input_size=(1,3, 224,224))登录后复制

4、模型训练

4.1、配置具体模型的优化器、损失函数及其他可选项

In [89]import paddleclass SaveBestModel(paddle.callbacks.Callback): def __init__(self, target=0.5, path='./best_model', verbose=0): self.target = target self.epoch = None self.path = path def on_epoch_end(self, epoch, logs=None): self.epoch = epoch def on_eval_end(self, logs=None): if logs.get('loss')[0] < self.target: self.target = logs.get('loss')[0] self.model.save(self.path) print('best model is loss {} at epoch {}'.format(self.target, self.epoch))callback_visualdl = paddle.callbacks.VisualDL(log_dir='./')callback_savebestmodel = SaveBestModel(target=1, path='./model')callbacks = [callback_visualdl, callback_savebestmodel]# 模型初始化model = paddle.Model(My_Model(num_classes=1)) # 线性回归模型# 优化器optim = paddle.optimizer.Momentum(learning_rate=0.0001, momentum=0.9, parameters=model.parameters())# 损失函数loss = paddle.nn.MSELoss()model.prepare(optimizer=optim, loss=loss) # 线性回归模型一定不能用交叉熵,因为这个自带softmax,需要指定输出类别# 用 DataLoader 实现数据加载train_loader = paddle.io.DataLoader(train_dataset, places=paddle.CUDAPlace(0), batch_size=64)eval_loader = paddle.io.DataLoader(val_dataset, places=paddle.CUDAPlace(0), batch_size= 64)登录后复制4.2、模型训练

In [9]model.fit(train_loader, eval_loader, epochs=5, callbacks=callbacks, verbose=1)登录后复制

4.3、保存模型

这里直接保存模型为可本地部署的形式。

In [10]# training=True时,只会保存优化器参数和模型参数# training=False时,会保存模型结构、参数和优化器结构model.save("./model_dir/model", training=False)登录后复制5、边缘端预测

这里的预测部分和本地预测代码相同,需要保证输入图像的预处理和训练时对齐。

In [90]import cv2import numpy as npfrom paddle.inference import Configfrom paddle.inference import create_predictor# ————————————————图像预处理函数————————————————def resize(img, target_size): """ resize """ percent = float(target_size) / min(img.shape[0], img.shape[1]) resized_width = int(round(img.shape[1] * percent)) resized_height = int(round(img.shape[0] * percent)) resized_short = cv2.resize(img, (resized_width, resized_height)) resized = cv2.resize(resized_short, (target_size, target_size)) return resizeddef preprocess(img, target_size): mean = [127.5, 127.5, 127.5] std = [127.5, 127.5, 127.5] # resize img = resize(img, target_size) # bgr-> rgb && hwc->chw img = img[:, :, ::-1].astype('float32').transpose((2, 0, 1)) img_mean = np.array(mean).reshape((3, 1, 1)) img_std = np.array(std).reshape((3, 1, 1)) img -= img_mean img /= img_std return img[np.newaxis, :]#——————————————————————模型配置、预测相关函数——————————————————————————def predict_config(model_file, params_file): # 根据预测部署的实际情况,设置Config config = Config() # 读取模型文件 config.set_prog_file(model_file) config.set_params_file(params_file) # Config默认是使用CPU预测,若要使用GPU预测,需要手动开启,设置运行的GPU卡号和分配的初始显存。 config.enable_use_gpu(500, 0) # 可以设置开启IR优化、开启内存优化。 config.switch_ir_optim() config.enable_memory_optim() predictor = create_predictor(config) return predictordef predict(image, predictor, target_size): img = preprocess(image, target_size) input_names = predictor.get_input_names() input_tensor = predictor.get_input_handle(input_names[0]) input_tensor.reshape(img.shape) input_tensor.copy_from_cpu(img.copy()) # 执行Predictor predictor.run() # 获取输出 output_names = predictor.get_output_names() output_tensor = predictor.get_output_handle(output_names[0]) output_data = output_tensor.copy_to_cpu() print("output_names", output_names) print("output_tensor", output_tensor) print("output_data", output_data) return output_dataif __name__ == '__main__': model_file = "model_dir/model.pdmodel" params_file = "model_dir/model.pdiparams" import random # image = cv2.imread("data/img/7419.webp") # image = cv2.imread("data/img/8891.webp") image = cv2.imread("data/img/{}.webp".format(random.randint(0,5000))) predictor = predict_config(model_file, params_file) res = predict(image, predictor, target_size=224) # 进行图片的展示 plt.figure() plt.title(res) image = cv2.cvtColor(image, cv2.COLOR_BGR2RGB) plt.imshow(image.astype('uint8')) plt.axis('on') plt.show()登录后复制output_names ['relu_0.tmp_0']output_tensor登录后复制output_data [[0.03796072]]

--- Running analysis [ir_graph_build_pass]--- Running analysis [ir_graph_clean_pass]--- Running analysis [ir_analysis_pass]--- Running IR pass [is_test_pass]--- Running IR pass [simplify_with_basic_ops_pass]--- Running IR pass [conv_affine_channel_fuse_pass]--- Running IR pass [conv_eltwiseadd_affine_channel_fuse_pass]--- Running IR pass [conv_bn_fuse_pass]--- Running IR pass [conv_eltwiseadd_bn_fuse_pass]--- Running IR pass [embedding_eltwise_layernorm_fuse_pass]--- Running IR pass [multihead_matmul_fuse_pass_v2]--- Running IR pass [squeeze2_matmul_fuse_pass]--- Running IR pass [reshape2_matmul_fuse_pass]--- Running IR pass [flatten2_matmul_fuse_pass]--- Running IR pass [map_matmul_v2_to_mul_pass]I1117 16:08:14.154837 128 fuse_pass_base.cc:57] --- detected 2 subgraphs--- Running IR pass [map_matmul_v2_to_matmul_pass]--- Running IR pass [map_matmul_to_mul_pass]--- Running IR pass [fc_fuse_pass]I1117 16:08:14.155347 128 fuse_pass_base.cc:57] --- detected 2 subgraphs--- Running IR pass [fc_elementwise_layernorm_fuse_pass]--- Running IR pass [conv_elementwise_add_act_fuse_pass]--- Running IR pass [conv_elementwise_add2_act_fuse_pass]--- Running IR pass [conv_elementwise_add_fuse_pass]--- Running IR pass [transpose_flatten_concat_fuse_pass]--- Running IR pass [runtime_context_cache_pass]--- Running analysis [ir_params_sync_among_devices_pass]I1117 16:08:14.158038 128 ir_params_sync_among_devices_pass.cc:45] Sync params from CPU to GPU--- Running analysis [adjust_cudnn_workspace_size_pass]--- Running analysis [inference_op_replace_pass]--- Running analysis [memory_optimize_pass]I1117 16:08:14.159536 128 memory_optimize_pass.cc:214] Cluster name : x size: 38535168I1117 16:08:14.159554 128 memory_optimize_pass.cc:214] Cluster name : relu_0.tmp_0 size: 403734528I1117 16:08:14.159556 128 memory_optimize_pass.cc:214] Cluster name : relu_3.tmp_0 size: 2359296I1117 16:08:14.159559 128 memory_optimize_pass.cc:214] Cluster name : pool2d_0.tmp_0 size: 100933632--- Running analysis [ir_graph_to_program_pass]I1117 16:08:14.166565 128 analysis_predictor.cc:717] ======= optimize end =======I1117 16:08:14.166777 128 naive_executor.cc:98] --- skip [feed], feed -> xI1117 16:08:14.167583 128 naive_executor.cc:98] --- skip [relu_0.tmp_0], fetch -> fetch登录后复制

登录后复制

6、车道线自动驾驶效果展示(第一人称视角)

相关攻略

FASTLAW AI律师是什么? 对于广大中小企业经营者来说,处理日常法律事务常常令人困扰——聘请专业律师费用高昂,自行处理又担心存在风险。是否存在一种更高效、更经济的解决方案?这正是FASTLAW AI智能法律咨询平台创立的初衷。 简而言之,FASTLAW是一款专为中小微企业量身打造的智能化法律助

使用灵珠AI高效生成标准产品需求文档需遵循结构化五步法:构建清晰指令提示词以明确文档框架;分模块注入结构化原始素材提供内容;通过多轮迭代校验修正细节与逻辑;调用模板引擎强制格式对齐;最后进行人工关键点复核,确保文档严谨可行。该方法能显著提升PRD产出效率与质量。

AI代码注释如何成为高效办公的秘密武器?大幅提升文档处理效率 在当今追求极致效率的办公环境中,一个潜力巨大却常被低估的工具正在重塑工作流程——它就是AI代码注释。这不仅是程序员的得力助手,更是所有知识工作者提升文档处理效率、实现高效办公的秘密武器。那么,它究竟是如何发挥作用的? AI代码注释如何直接

AI英文写作工具:应用场景、核心优势与面临的挑战 在数字化转型的浪潮中,人工智能技术已深度渗透至各个领域,英文写作也不例外。从强大的GPT模型到各类智能写作助手,AI似乎让英文写作变得前所未有的高效与便捷。然而,在享受技术红利的同时,我们也必须冷静审视其背后的局限性与潜在问题。本文将深入探讨AI在英

要让海螺AI的产品评测更专业真实,需融入真实使用场景与主观体验,结合行业术语与参数对照,将数据转化为可感知现象。采用非对称信息结构,核心处堆砌细节,过渡处适当留白。植入可验证的瑕疵描述,并混用多源数据交叉验证,区分一手实测与引用资料,构建可信信息网络。

热门专题

热门推荐

摘要由实在Agent通过智能技术生成。此内容由AI根据文章内容自动生成,并已由人工审核。 随着企业数字化转型进入智能体(Agent)驱动的新阶段,如何平衡AI创新与安全合规成为关键挑战。尤其在《网络安全等级保护基本要求》(等保2 0)的严格框架下,企业级智能体的部署必须同时满足效率提升与合规保障的双

使用情景 对于外贸从业者来说,年终总结绝非简单的例行汇报。它是一次至关重要的年度复盘与战略规划,既要系统梳理过去一年的业绩成果与经验得失,也要为来年的市场开拓与业务增长指明清晰路径。在全球贸易竞争白热化的今天,一份逻辑严谨、数据详实、洞察深刻的总结报告,不仅是个人专业能力的集中体现,更是赢得管理层支

使用情景 又到年末了,年度安全工作总结是每个团队都绕不开的环节。这份总结的价值,远不止于一份简单的回顾。它更像是一份“体检报告”,清晰地告诉你过去一年安全工作的“健康状况”——哪里做得好,哪里还有隐患,从而为来年的精准施策打下坚实的基础。 不过,说起写总结、做PPT,不少人就开始头疼了:内容怎么组织

Zcash (ZEC) 月度暴涨520%:深度解析后市行情与关键点位 近期,隐私币龙头Zcash (ZEC) 上演了一场令人瞩目的行情,月度涨幅高达520%,价格一度逼近300美元,创下自2021年12月以来的新高。在加密市场整体承压的背景下,ZEC的逆势狂飙吸引了全球投资者的目光。本文将结合技术分

在存量竞争的时代,电商售后数据早已超越了“成本中心”的单一角色,它正成为洞察产品质量、优化物流链路、提升用户忠诚度的核心战略资产。然而,现实往往骨感:多平台、多店铺、多套ERP系统并存,数据散落一地。靠人工手动汇总?不仅耗时费力,更关键的是,你永远无法实现真正的实时预警与敏捷响应。那么,电商售后数据