【图像去噪】第六期论文复现赛——DnCNN

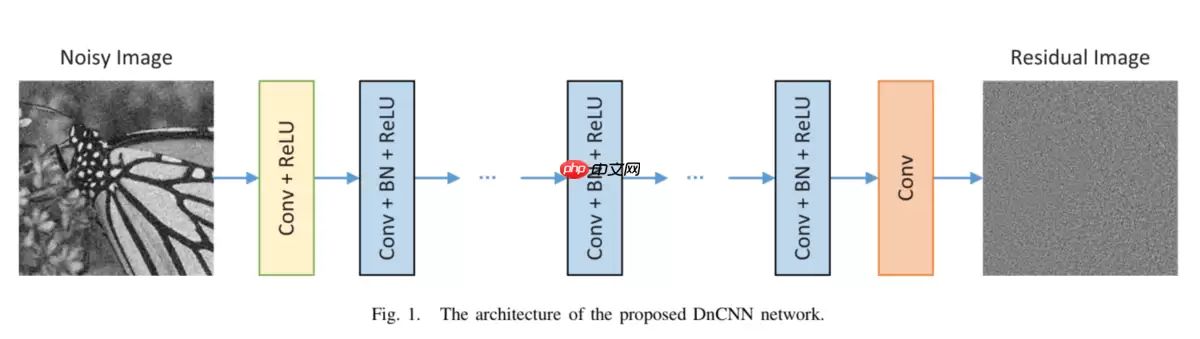

本文围绕DnCNN图像去噪算法展开复现研究。该算法基于残差学习和批量归一化,适用于图像复原。复现采用PaddlePaddle框架,在BSD68测试集、噪声15条件下,10次测试平均PSNR达31.73757,达标。文中还介绍了数据集、文件结构、环境依赖、核心代码及训练、评估等操作流程。

论文复现——图像去噪算法 DnCNN

DnCNN: Beyond a Gaussian Denoiser: Residual Learning of Deep CNN for Image Denoising

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

最新源码:https://github.com/cszn/DnCNN

最新Pytorch实现:https://github.com/SaoYan/DnCNN-PyTorch

复现地址:https://github.com/sldyns/DnCNN_paddle

1. 简介

由于深度学习的进步以及卷积神经网络在视觉方向取得的巨大成功,使得更多学者聚焦于此。作者注意到在残差网络之前,预测残差图像的策略已经被用于一些低水平视觉问题,如单幅图像超分辨率和彩色图像去噪。他认为在图像复原领域(尤其是在噪音程度较小的情况下),含噪图像与无噪图像的残差非常小,所以理论上残差学习非常适合运用到图像复原上。

而批量归一化操作通过一定的规范化手段,把每层神经网络任意神经元这个输入值的分布强行拉回到均值为0方差为1的标准正态分布,这减轻了内部协变量的移位,同时使梯度变大,避免了梯度消失的问题,而且梯度变大意味着学习收敛速度快,能大大加快训练速度。

这样的网络设计就是在隐层中将干净图像 x 从含噪图像 y 中消去。在超分领域,低分辨率图片就是高分辨率图片的双三次上采样操作形成的,故超分领域的残差图片和去高斯噪声领域的残差图片是等价的,同理还有JPEG解锁领域的残差图片。因而DnCNN网络同时具有良好的盲去噪能力.

2. 复现精度

在 BSD68 测试集上做了10次测试,达到验收指标:average PSNR, noise 15: 31.73

3. 数据集与文件结构

3.1 数据集

最新代码提供的训练数据集地址:https://github.com/SaoYan/DnCNN-PyTorch/tree/master/data/train

测试数据集地址:https://github.com/cszn/FFDNet/tree/master/testsets/BSD68

**注:**所有数据已经存放在 work/data/ 文件夹下了,可以无需下载.

3.2 文件结构

DnCNN_Paddle |-- data |-- BSD68 # 测试所用的BSD68数据集 |-- train # 训练所用的数据,包含400张图片 |-- logs |-- net.pdparams # 训练过程保存的模型参数文件 |-- vdlrecords.1649579479.log # 完整的训练日志 |-- test_tipc # TIPC: Linux GPU/CPU 基础训练推理测试 |-- dataset.py # 数据及预处理相关代码 |-- export_model.py # 预训练模型的导出代码 |-- LICENSE # LICENSE文件 |-- models.py # 模型定义代码 |-- README.md # README.md文件 |-- val.py # 模型评估代码 |-- predict.py # 模型预测代码 |-- train.py # 单机单卡训练文件 |-- train2.py # 单机多卡训练文件 |-- utils.py # 一些工具文件 |-- infer.py # 模型推理代码登录后复制

4. 环境依赖

PaddlePaddle >= 2.2.0

scikit-image == 0.19.2

In [ ]!pip install scikit-image登录后复制

5. 核心代码

DnCNN 的结构并不复杂,主要为多层 CNN 配合 BatchNorm 和 ReLU,实现的残差学习.

class DnCNN(nn.Layer): def __init__(self, channels, num_of_layers=17): super(DnCNN, self).__init__() kernel_size = 3 padding = 1 features = 64 layers = [] layers.append(nn.Conv2D(in_channels=channels, out_channels=features, kernel_size=kernel_size, padding=padding, bias_attr=False, weight_attr=nn.initializer.KaimingNormal())) layers.append(nn.ReLU()) for _ in range(num_of_layers-2): layers.append(nn.Conv2D(in_channels=features, out_channels=features, kernel_size=kernel_size, padding=padding, bias_attr=False, weight_attr=nn.initializer.KaimingNormal())) layers.append(nn.BatchNorm2D(features, weight_attr=ParamAttr(initializer=nn.initializer.Constant(value=1.)), bias_attr=ParamAttr(initializer=nn.initializer.Constant(value=0.)))) layers.append(nn.ReLU()) layers.append(nn.Conv2D(in_channels=features, out_channels=channels, kernel_size=kernel_size, padding=padding, bias_attr=False, weight_attr=nn.initializer.KaimingNormal())) self.dncnn = paddle.nn.Sequential(*layers) def forward(self, x): y = x out = self.dncnn(x) return y-out登录后复制

6. 快速开始

6.1 初次训练

In [ ]!cd work && python train.py --preprocess True --data_dir data/train --val_dir data/BSD68 --num_of_layers 17 --noiseL 15 --val_noiseL 15登录后复制

参数说明:

--preprocess True 表示需要作数据预处理--data_dir data/train 训练数据路径--val_dir data/BSD68 验证数据路径--num_of_layers 17 模型层数为17层--noiseL 15 训练的噪声水平为15--val_noiseL 15 验证的噪声水平为15初次训练指定 --preprocess True,则会生成 train.h5 和 val.h5 两个文件,再次训练则不需要指定改参数:

6.2 重新训练

In [3]!cd work && python train.py --num_of_layers 17 --noiseL 15 --val_noiseL 15登录后复制

hijack_call.c:658 cuInit error unknown error登录后复制

6.3 日志读取

训练过程会将日志记录和模型参数保存在 work/logs/ 文件夹下.

日志是用 VisualDL 工具记录,可以用 Ai Studio 自带的 数据模型可视化 功能查看

6.4 模型评估

在 BSD58 数据集上作了 10 次测试,噪声强度为 15

In [ ]!cd work && python val.py --log_dir logs --data_path data/BSD68/ --test_noiseL 15登录后复制

输出如下:

10 times test on test data, Averate PSNR: 31.73937683053843, Variance: 1.7706766908902732e-05

显著达到了验收精度.

6.5 模型预测

在 BSD58 数据集上作预测,噪声强度为 15,结果存放在 work/results/ 文件夹下.

In [ ]!cd work && python predict.py --log_dir logs --data_path data/BSD68/ --save_path results/ --test_noiseL 15 --save_images登录后复制

输出为:

PSNR on test data 31.739193登录后复制

work/results/couple 中的图片为 原始图像、带噪图像、去噪结果,3 张图片拼接得到的:

6.6 单张图像去噪测试

导入单张图像,测试去噪效果,首先需要在work/test_images里上传一张图片.

In [1]# 先上传一张图片,import os.path as ospfrom IPython.display import displayfrom PIL import Imageimg_path = 'butterfly.webp' # 改成自己上传的图片名称full_img_path = osp.join(osp.abspath('work/test_images/'), img_path)img = Image.open(full_img_path).convert('RGB')print('以下为上传的图片:')display(img)登录后复制 以下为上传的图片:登录后复制

登录后复制 In [7]

!cd work && python predict_single.py --clean_img $full_img_path --save_images --log_dir logs登录后复制

Loading model ...W0602 17:50:55.775449 2009 device_context.cc:447] Please NOTE: device: 0, GPU Compute Capability: 7.0, Driver API Version: 11.2, Runtime API Version: 10.1W0602 17:50:55.779913 2009 device_context.cc:465] device: 0, cuDNN Version: 7.6.only clean image provided, noise level is 15PSNR 33.144904登录后复制 In [8]

# 去噪效果查看import globfrom IPython.display import displayfrom PIL import Imageimgs = glob.glob('work/test_images/*')for path in imgs: print(path) img = Image.open(path) display(img)登录后复制 work/test_images/butterfly.webp登录后复制

登录后复制

work/test_images/butterfly_noised.webp登录后复制

登录后复制

work/test_images/butterfly_denoised.webp登录后复制

登录后复制

相关攻略

4月6日消息,诞生37年的Intel486处理器,即将彻底告别现代Linux系统。据科技媒体Phoronix报道,Linux内核开发者已启动对486处理器支持的移除工作,相关补丁确认将合入Linux

Win11 → WSL2 → Ubuntu → OpenClaw 的直接流程 想在 Windows 上顺畅地用上 OpenClaw?其实核心就一条:先在 WSL2 里搭好 Ubuntu 这个“标准环境”。下面这个流程,你按顺序一步步执行就行,能避开不少弯路。 第一步:安装 WSL2 与 Ubuntu

参考指南与学习资料 若您希望在本地快速搭建并部署一个个人智能助手,OpenClaw 框架是一个理想的入门选择。为了帮助开发者更高效地上手,社区中已有丰富的学习资源与讨论可供参考,主要包括:OpenClaw 新手入门教程、核心命令行工具使用指南(openclaw -h 查看帮助)、配置文件的参数详解,

1 openclaw 工具权限报错解决方案:无法使用 exec read write webfetch 等工具的修复方法 当您在配置 openclaw 时遇到工具权限报错,提示缺少 exec、read、write、webfetch 等关键工具的使用权限,通常无需深入排查复杂的系统环境。此问题在多数

本次部署指南的核心目标非常明确:在 Linux 环境中,无论是云服务器还是本地物理机,我们都需要完整地完成 OpenClaw 智能体框架的安装与部署,并通过基础的健康检查与功能验证,确保整个系统能够成功启动并稳定运行。 一、环境要求 在开始动手安装之前,我们首先需要确认系统满足所有的基础运行环境要求

热门专题

热门推荐

加密货币行业翘首以盼的监管里程碑,终于有了实质性进展。美国证券交易委员会(SEC)主席保罗·阿特金斯(Paul Atkins)近日证实,那份允许加密项目在早期获得注册豁免权的“安全港”框架提案,已经正式送抵白宫,进入了最终审查阶段。 在范德堡大学与区块链协会联合举办的数字资产峰会上,阿特金斯透露了这

微策略Strategy报告:第一季录得144 6亿美元浮亏 再斥资约3 3亿美元买进4871枚比特币 市场震荡的威力有多大?看看Strategy的最新季报就明白了。根据其最新向美国证管会(SEC)提交的8-K报告,受市场剧烈波动影响,这家公司所持的比特币在第一季度录得了一笔惊人的数字——144 6亿

稳定币巨头Tether的动向,向来是加密世界的风向标。这不,它向Web3基础设施的版图扩张,又迈出了关键一步。公司执行长Paolo Ardoino在社交平台X上透露,其工程团队正在全力“烹制”一个新项目——去中心化搜索引擎 “Hypersearch”。这个消息一出,立刻引发了行业的广泛猜想。 采用D

基地位于Coinbase旗下以太坊Layer2网络Base的Seamless Protocol,日前正式宣告了服务的终结。这个曾经吸引了超过20万用户的原生DeFi借贷协议,在运营不到三年后,终究没能跑赢时间。它主打的核心产品是Integrated Leverage Markets(ILMs)——一

PAAL代币揭秘:深度解析Web3社区治理的核心钥匙 在去中心化自治组织的浪潮中,谁真正掌握了项目的话语权?PAAL代币提供了一套系统化的答案。它不仅是生态内流转的价值媒介,更是开启链上治理大门的核心凭证。通过持有并质押PAAL代币,用户能够对协议升级、资金分配乃至战略方向等关键事务投出决定性的一票