DreamBooth:3步完成AIGC自由绘画创作

最近发飞桨更新了个比较好玩的模型DreamBooth,可以通过输入提示文本和图片实现自动切换主题背景,然后该模型也可以通过调整预训练模型来实现自定义的图片背景切换,类似一键切换背景,这个功能十分有趣,所以就想着可以自己导入图片让DreamBooth模型训练来生成一些相关有趣的新图片

1.项目介绍

1.1 项目简介

最近发飞桨更新了个比较好玩的模型DreamBooth,可以通过输入提示文本和图片实现自动切换主题背景,然后该模型也可以通过调整预训练模型来实现自定义的图片背景切换,类似一键切换背景,这个功能十分有趣,所以就想着可以自己导入图片让DreamBooth模型训练来生成一些相关有趣的新图片1.2 项目原理

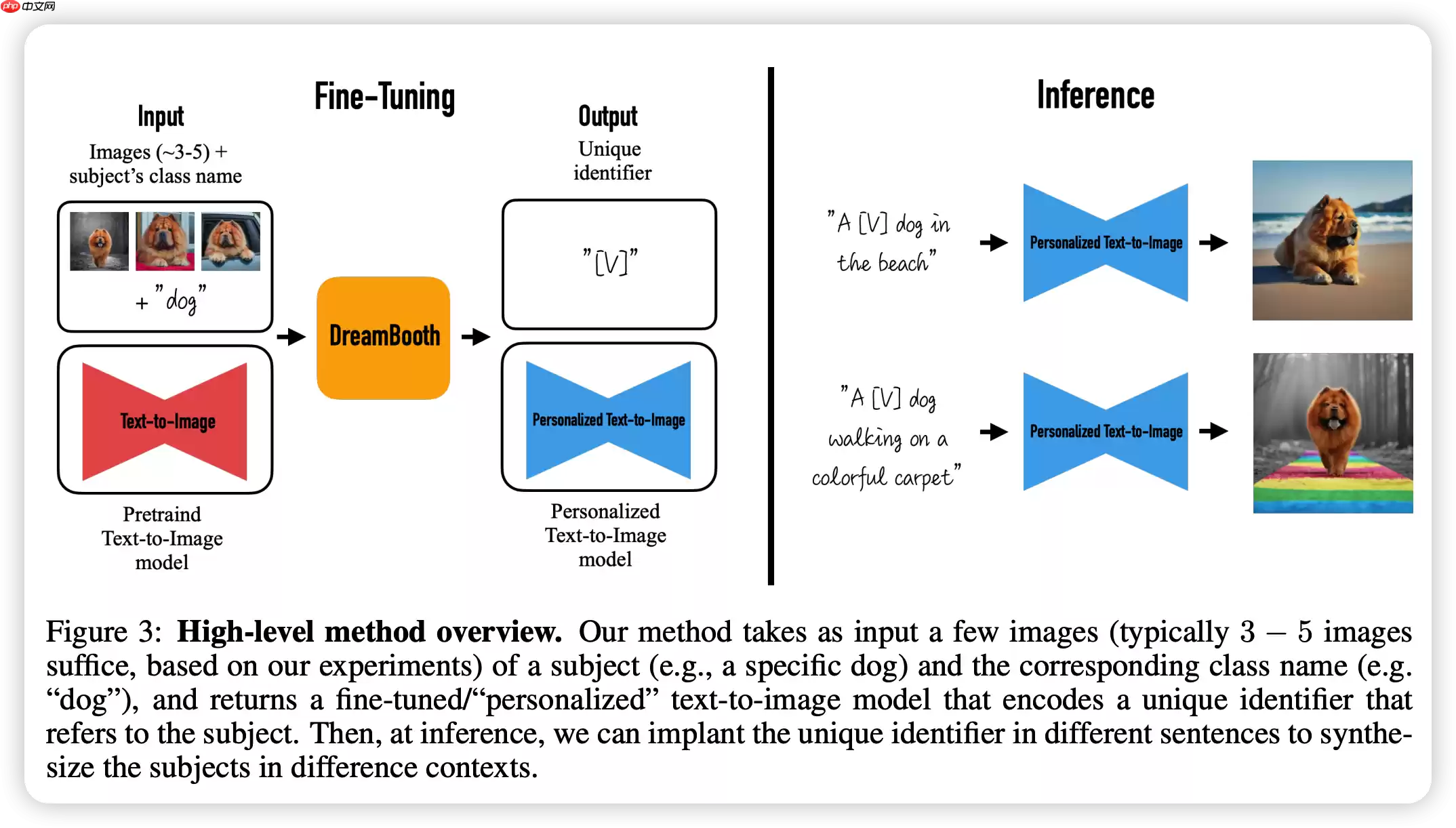

DreamBooth是一款基于人工智能技术的照片亭,可以使用文本提示快速生成多种不同上下文环境中的照片。该技术旨在个性化文本到图像的扩散模型,并扩大语言-视觉词典,使其能够将新单词与特定主题绑定,从而允许在不同环境中呈现主题的新版本,同时保留其关键的识别特征。该方法使用一些主题的图像,并微调预训练的文本到图像模型,以学习特定主题的唯一标识符。然后,可以使用该模型在不同场景、姿态、视角和光照条件下合成不同的主题实例。该技术使合成的图像可以评估主题和提示的准确性。该方法具有重新定位主题、文本引导的视图合成和艺术渲染的潜在应用。下面是模型原理图:

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

2.构建模型(3步构建)

只需要3步就可以构建1个自定义标签的DreamBooth模型,接下来会演示如何构建模型

2.1 安装依赖

首先需要安装模型所需的依赖库paddlenlp、pddiffusers、visuadl(这个库是用来可视化训练Loss的)

文件结构

├── train_dreambooth.py # 训练脚本├── train_dreambooth_lora.py # 训练脚本lora版├── export_model.py #导出Diffusion脚本├── dream_image_single #训练集图片-单卡├── dream_image_single #训练集图片-多卡├── dream_image_single #训练集图片-类别(用于做先验训练,不用可略过)├── dream_outputs_single # 单卡训练模型文件存储路径├── dream_outputs_mulyiply # 多卡训练模型文件存储路径├── dream_outputs_single_lora # 单卡+lora优化训练模型文件存储路径├── models #存放导出Diffusion训练模型的文件夹├── pics # 待训练图片存放文件夹 ├── pic_class # 存放用于先验知识学习的同类图片 ├── pic_train # 用于DreamBooth模型训练的训练图片登录后复制 In [2]

# 输出内容较多,需进行添加清理from IPython.display import clear_output登录后复制登录后复制 In [3]

!pip install --upgrade -U paddlenlp ppdiffusers visualdl --user#!mkdir /home/aistudio/external-libraries#!pip install --upgrade -U ppdiffusers visualdl -t /home/aistudio/external-librariesclear_output()print("依赖库安装成功")登录后复制 依赖库安装成功登录后复制 In [ ]

import sys sys.path.append('/home/aistudio/external-libraries')print(sys.path)登录后复制 In [2]# 创建实例(物体)保存文件夹!mkdir ./dream_image_single!mkdir ./dream_outputs_single!mkdir ./dream_image_class!mkdir ./dream_outputs_single_lora!mkdir ./dream_image_multiply!mkdir ./dream_outputs_multiply登录后复制 In [3]

# 将pics中的图片复制到实例文件夹中%cd /home/aistudio/pics/pic_train!cp * /home/aistudio/dream_image_single!cp * /home/aistudio/dream_image_multiply登录后复制

/home/aistudio/pics/pic_train登录后复制 In [4]

#将data中的先验图片复制到class文件夹中%cd /home/aistudio/pics/pic_class!cp * /home/aistudio/dream_image_class登录后复制

/home/aistudio/pics/pic_class登录后复制 In [5]

# 返回目录文件夹%cd登录后复制

/home/aistudio登录后复制

2.2 训练模型

安装好所需环境和将我们待训练图片放到训练文件夹后我们就可以准备训练,模型训练有一些参数可选择,以下是可选择的参数列表

参数列表

pretrained_model_name_or_path :预训练模型名称,其他可用的预训练模型可参考ppdiffusersinstance_data_dir :待训练图片保存路径output_dir :输出图片路径instance_prompt :图片文字提示(描述)信息,需给模型指定要学习的类别resolution=512 :输入给模型图片的分辨率,当高度或宽度为None时,我们将会使用resolution,默认值为512train_batch_size :每次喂入batch的数据量,显卡显存少需要低点,过高精度会下降gradient_accumulation_steps :梯度累积的步数learning_rate=5e-6 :训练网络的学习率lr_scheduler="constant" :要使用的学习率调度策略。默认为constantlr_warmup_steps=0 :用于从 0 到 learning_rate 的线性 warmup 的步数max_train_steps :最大训练次数为防止模型过拟合可加入下列参数:

with_prior_preservation: 是否将生成的同类图片(先验知识)一同加入训练,当为True的时候,class_prompt、class_data_dir、num_class_images、sample_batch_size和prior_loss_weight才生效。class_prompt:类别(class)提示词文本,该提示器要与训练图片是同一种类别,例如a photo of dog,主要作为先验知识class_data_dir:类别(class)图片文件夹地址,主要作为先验知识num_class_images:事先需要从class_prompt中生成多少张图片,主要作为先验知识sample_batch_size:生成class_prompt文本对应的图片所用的批次(batch size),注意,当GPU显卡显存较小的时候需要将这个默认值改成1prior_loss_weight: 先验loss占比权重In [1]# 输出内容较多,需进行添加清理from IPython.display import clear_output登录后复制登录后复制 In [2]

# 单卡训练!python -u train_dreambooth.py \--pretrained_model_name_or_path="CompVis/stable-diffusion-v1-4" \--instance_data_dir="dream_image_single" \--output_dir="dream_outputs_single" \--instance_prompt="a photo of kunkun" \--resolution=512 \--train_batch_size=1 \--gradient_accumulation_steps=1 \--learning_rate=5e-6 \--lr_scheduler="constant" \--lr_warmup_steps=0 \--max_train_steps=500# 先验知识参数(添加会增加训练时间)"""--with_prior_preservation \--class_prompt="a photo of kunkun" \--class_data_dir="dream_image_class" \--num_class_images=300 \--sample_batch_size=5 \--prior_loss_weight=1.0 \"""# 输出太长清理clear_output()# 添加提示print("训练结束")登录后复制 训练结束登录后复制登录后复制登录后复制 In [6]

# 使用多卡训练,参数与单卡类似,--gpus可调gpu使用数量,这个cell只能用V100来运行import paddle!python -u -m paddle.distributed.launch --gpus "0,1,2,3" train_dreambooth.py \--pretrained_model_name_or_path="CompVis/stable-diffusion-v1-4" \--instance_data_dir="dream_image_multiply" \--output_dir="dream_outputs_multiply" \--instance_prompt="a photo of kunkun" \--resolution=512 \--train_batch_size=1 \--gradient_accumulation_steps=1 \--learning_rate=5e-6 \--lr_scheduler="constant" \--lr_warmup_steps=0 \--max_train_steps=500# 先验知识参数(添加会增加训练时间)"""--with_prior_preservation \--class_prompt="a photo of kunkun" \--class_data_dir="dream_image_class" \--num_class_images=200 \--sample_batch_size=5 \--prior_loss_weight=1.0 \"""# 输出太长清理clear_output()# 添加提示print("训练结束")登录后复制 训练结束登录后复制登录后复制登录后复制

使用Lora进行优化

LoRA (Low-Rank Adaptation of Large Language Models) 是微软研究员引入的一项新技术,用于处理大模型微调的问题。当前拥有数十亿参数及强大性能的大型语言模型,如 GPT-3,通常需要巨大的开销来适应其下游任务的微调。为此,LoRA 建议冻结预训练模型的权重,并在每个 Transformer 块中注入可训练层(秩-分解矩阵)。由于不需要为大多数模型权重计算梯度,因此大大减少了需要训练的参数数量,并降低了 GPU 的内存要求。

通过聚焦大模型的 Transformer 注意力块,研究人员发现使用 LoRA 进行的微调质量与全模型微调相当,同时速度更快且需要更少的计算。这种技术可以帮助提升大型语言模型的微调效率,缩短微调时间,减小GPU内存需求和算力要求,对于加速自然语言处理应用的发展具有重要作用。

In [11]# 加入Lora进行模型优化!python train_dreambooth_lora.py \--pretrained_model_name_or_path="runwayml/stable-diffusion-v1-5" \--instance_data_dir="dream_image_single" \--output_dir="dream_outputs_single_lora" \--instance_prompt="a photo of kunkun" \--resolution=768 \--train_batch_size=1 \--gradient_accumulation_steps=1 \--learning_rate=1e-4 \--lr_scheduler="constant" \--lr_warmup_steps=0 \--max_train_steps=500 \--validation_prompt="A photo of kunkun in a state" \--validation_epochs=50 \--lora_rank=4 \--seed=0# 先验知识参数(添加会增加训练时间)"""--with_prior_preservation \--class_prompt="a photo of kunkun" \--class_data_dir="dream_image_class" \--num_class_images=300 \--sample_batch_size=5 \--prior_loss_weight=1.0 \"""# 输出太长清理clear_output()# 添加提示print("训练结束")登录后复制 训练结束登录后复制登录后复制登录后复制

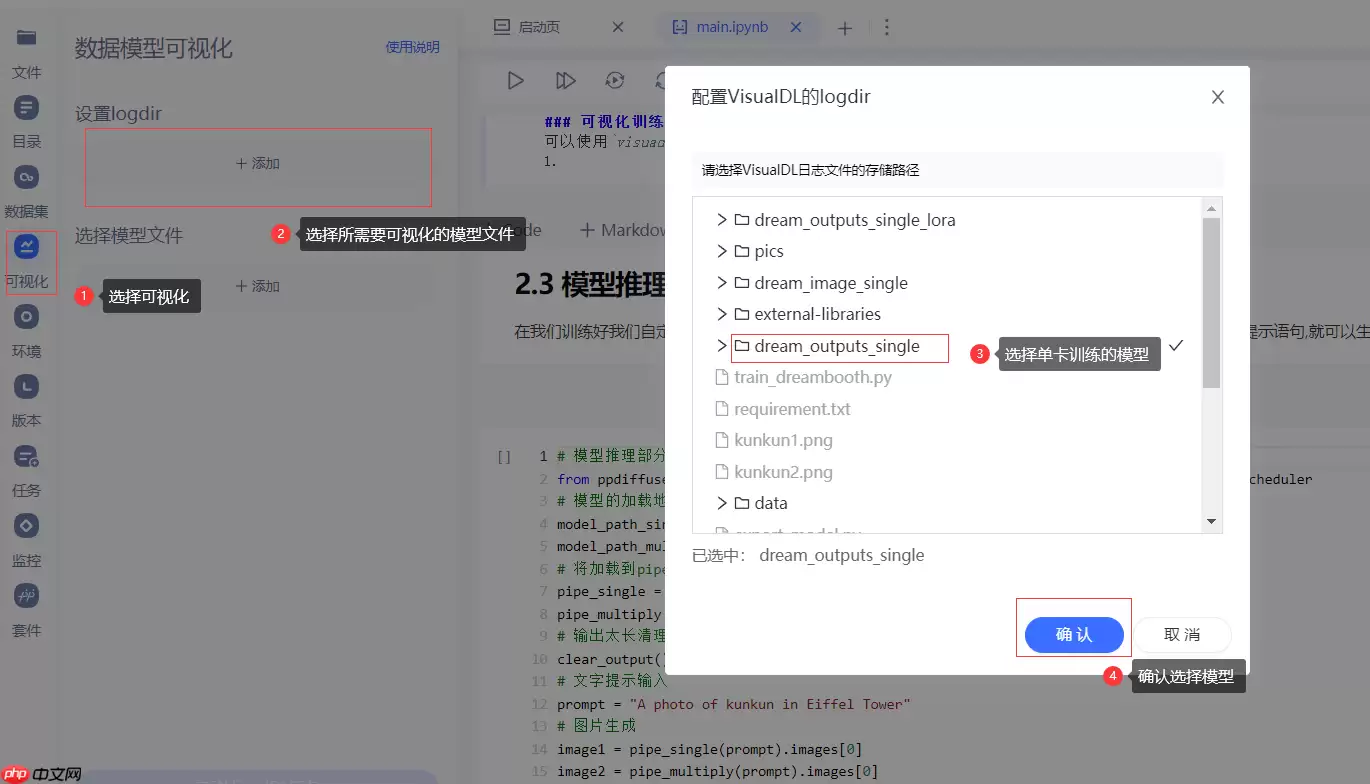

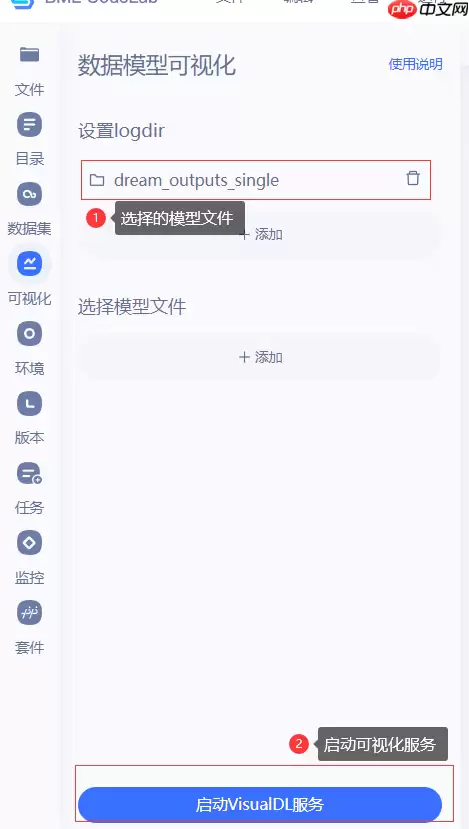

可视化训练Loss

可以使用visuadl观察网络训练的Loss情况,这里简单展示使用方法

1.选择模型

2.进入可视化界面

2.3 模型推理

在我们训练好我们自定义类模型后我们就可以来做模型的推理了,只需要加载我们训练好的模型和给模型的提示语句,就可以生成我们想要主题的图片了

In [ ]# 模型推理部分from ppdiffusers import StableDiffusionPipeline,DiffusionPipeline, DPMSolverMultistepScheduler# 模型的加载地址,这里我们输入了训练时候使用的 output_dir 地址model_path_single = "./dream_outputs_single"model_path_multiply="./dream_outputs_multiply"# 将加载到pipe中pipe_single = StableDiffusionPipeline.from_pretrained(model_path_single)pipe_multiply = StableDiffusionPipeline.from_pretrained(model_path_multiply)# 输出太长清理clear_output()# 文字提示输入prompt = "A photo of kunkun in Eiffel Tower" # 图片生成image1 = pipe_single(prompt).images[0]image2 = pipe_multiply(prompt).images[0]# 保存图片,我们可以查看imageimage1.save("kunkun1.webp")image2.save("kunkun2.webp")登录后复制 In [ ]# lora训练的模型# 模型的加载地址,这里我们输入了训练时候使用的 output_dir 地址model_path_lora="./dream_outputs_single_lora"# 将加载到pipe中pipe_lora = DiffusionPipeline.from_pretrained("runwayml/stable-diffusion-v1-5")pipe_lora.scheduler = DPMSolverMultistepScheduler.from_config(pipe_lora.scheduler.config)pipe_lora.unet.load_attn_procs("dream_outputs_single_lora", from_hf_hub=True)# 文字提示输入prompt = "A photo of kunkun in Eiffel Tower" # 图片生成image3 = pipe_lora(prompt, num_inference_steps=25).images[0]# 保存图片,我们可以查看imageimage3.save("kunkun3.webp")登录后复制 效果展示

In [16]#让我们来看下实例的效果image1登录后复制

登录后复制 In [15]

image2登录后复制

登录后复制 In [17]

image3登录后复制

登录后复制

这生成的图片好像有点抽象...,可能是因为我提供的图片的不够好的原因,不过对象的某些特征网络还是学习到了,应该可以调整输入图片质量和增加先验知识增强学习效果,有想自定义绘画可以修改pics里面的训练图片

相关攻略

Pywinrm 通过Windows远程管理(WinRM)协议,让Python能够像操作本地一样执行远程Windows命令,真正打通了跨平台管理的最后一公里。 在混合IT环境中,Linux机器管理Wi

早些时候,聊过 Python 领域那场惊心动魄的供应链攻击。当时我就感叹,虽然我们 JavaScript 开发者对这类套路烂熟于心,但亲眼目睹这种规模的“投毒”还是头一次。 早些时候,聊过 Pyth

Toga 是 BeeWare 家族的核心成员,号称“写一次,跑遍所有平台”,而且用的是系统原生控件,不是那种一看就是网页套壳的界面 。 写了这么多年 Python,你是不是也想过:要是能一套代码跑

异常处理的核心:让错误在正确的地方被有效处理。正确的地方,就是别在底层就把异常吞了,也别在顶层还抛裸奔的 Exception。 异常处理写得好,半夜不用起来改 bug。1 你是不是也这么干过?tr

1 Skills机制概述 提起OpenClaw的Skills机制,不少人可能会把它想象成传统意义上的可执行插件。其实,它的内涵要更精妙一些。 简单说,Skills本质上是一套基于提示驱动的能力扩展机制。它并不是一个可以独立“跑”起来的程序模块,而是通过一份结构化描述文件(核心就是那个SKILL m

热门专题

热门推荐

加密货币行业翘首以盼的监管里程碑,终于有了实质性进展。美国证券交易委员会(SEC)主席保罗·阿特金斯(Paul Atkins)近日证实,那份允许加密项目在早期获得注册豁免权的“安全港”框架提案,已经正式送抵白宫,进入了最终审查阶段。 在范德堡大学与区块链协会联合举办的数字资产峰会上,阿特金斯透露了这

微策略Strategy报告:第一季录得144 6亿美元浮亏 再斥资约3 3亿美元买进4871枚比特币 市场震荡的威力有多大?看看Strategy的最新季报就明白了。根据其最新向美国证管会(SEC)提交的8-K报告,受市场剧烈波动影响,这家公司所持的比特币在第一季度录得了一笔惊人的数字——144 6亿

稳定币巨头Tether的动向,向来是加密世界的风向标。这不,它向Web3基础设施的版图扩张,又迈出了关键一步。公司执行长Paolo Ardoino在社交平台X上透露,其工程团队正在全力“烹制”一个新项目——去中心化搜索引擎 “Hypersearch”。这个消息一出,立刻引发了行业的广泛猜想。 采用D

基地位于Coinbase旗下以太坊Layer2网络Base的Seamless Protocol,日前正式宣告了服务的终结。这个曾经吸引了超过20万用户的原生DeFi借贷协议,在运营不到三年后,终究没能跑赢时间。它主打的核心产品是Integrated Leverage Markets(ILMs)——一

PAAL代币揭秘:深度解析Web3社区治理的核心钥匙 在去中心化自治组织的浪潮中,谁真正掌握了项目的话语权?PAAL代币提供了一套系统化的答案。它不仅是生态内流转的价值媒介,更是开启链上治理大门的核心凭证。通过持有并质押PAAL代币,用户能够对协议升级、资金分配乃至战略方向等关键事务投出决定性的一票