极简MuZero算法实践——Paddle2.0版本

DeepMind的MuZero算法继AlphaFold后走红,无需人类知识和规则,能通过分析环境与未知条件博弈。其极简实现含三个模型,通过强化学习训练。在CartPole-v0环境测试,经2000轮训练,模型可完美掌握游戏,展现出超越前代的潜力,未来计划在更多环境复现。

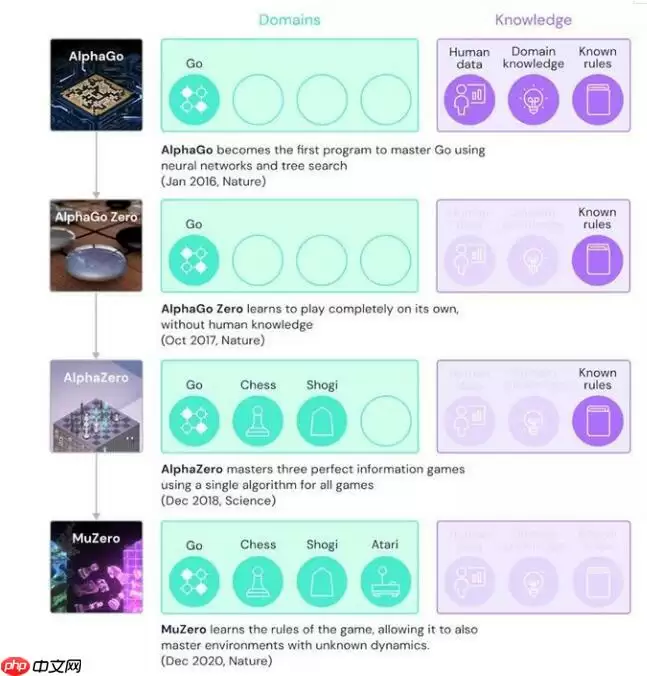

继AlphaFold 大火之后,DeepMind 又一款算法蹿红。12 月 23 日,DeepMind 在正式发表博文 MuZero: Mastering Go, chess, shogi and Atari without rules,并详细介绍了这款名为 MuZero 的 AI 算法。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

本项目是一个极简的MuZero的实现,没有使用MCTS方法,模型由Representation_model、Dynamics_Model、Prediction_Model构成:

Representation_model将一组观察值映射到神经网络的隐藏状态s;动态Dynamics_Model根据动作a_(t + 1)将状态s_t映射到下一个状态s_(t + 1),同时估算在此过程的回报r_t,这样模型就能够不断向前扩展;预测Prediction_Model 根据状态s_t对策略p_t和值v_t进行估计;In [1]import gymimport numpy as npimport paddleimport paddle.nn as nn import paddle.optimizer as optimimport paddle.nn.functional as Fimport copyimport randomfrom tqdm import tqdmfrom collections import dequeenv = gym.make('CartPole-v0')hidden_dims = 128o_dim = env.observation_space.shape[0]act_dim = env.action_space.nRepresentation_model= paddle.nn.Sequential( paddle.nn.Linear( o_dim, 128), paddle.nn.ELU(), paddle.nn.Linear(128, hidden_dims), )# paddle.summary(h, (50,4))class Dynamics_Model(paddle.nn.Layer): # action encoding - one hot def __init__(self, num_hidden, num_actions): super().__init__() self.num_hidden = num_hidden self.num_actions = num_actions network = [ nn.Linear(self.num_hidden+self.num_actions, self.num_hidden), nn.ELU(), nn.Linear(self.num_hidden,128), ] self.network = nn.Sequential(*network) self.hs = nn.Linear(128,self.num_hidden) self.r = nn.Linear(128,1) def forward(self, hs,a): out = paddle.concat(x=[hs, a], axis=-1) out = self.network(out) hidden =self.hs(out) reward = self.r(out) return hidden, reward# D = Dynamics_Model(hidden_dims,act_dim)# paddle.summary(D, [(2,hidden_dims),(2,2)])class Prediction_Model(paddle.nn.Layer): def __init__(self, num_hidden, num_actions): super().__init__() self.num_actions = num_actions self.num_hidden = num_hidden network = [ nn.Linear(num_hidden, 128), nn.ELU(), nn.Linear(128, 128), nn.ELU(), ] self.network = nn.Sequential(*network) self.pi = nn.Linear(128,self.num_actions) self.soft = nn.Softmax() self.v = nn.Linear(128,1) def forward(self, x): out = self.network(x) p = self.pi(out) p =self.soft(p) v = self.v(out) return v, p # P= Prediction_Model(hidden_dims,act_dim)# paddle.summary(P, [(32,hidden_dims)])class MuZero_Agent(paddle.nn.Layer): def __init__(self,num_hidden ,num_actions): super().__init__() self.num_actions = num_actions self.num_hidden = num_hidden self.representation_model = Representation_model self.dynamics_model = Dynamics_Model(self.num_hidden,self.num_actions) self.prediction_model = Prediction_Model(self.num_hidden,self.num_actions) def forward(self, s,a): s_0 = self.representation_model(s) s_1 ,r_1 = self.dynamics_model(s_0 , a) value , p = self.prediction_model(s_1) return r_1, value ,pmu = MuZero_Agent(128,2)mu.train()登录后复制In [2]buffer = deque(maxlen=500)def choose_action(env, evaluate=False): values = [] # mu.eval() for a in range(env.action_space.n): e = copy.deepcopy(env) o, r, d, _ = e.step(a) act = np.zeros(env.action_space.n); act[a] = 1 state = paddle.to_tensor(list(e.state), dtype='float32') action = paddle.to_tensor(act, dtype='float32') # print(state,action) rew, v, pi = mu(state, action) v = v.numpy()[0] values.append(v) # mu.train() if evaluate: return np.argmax(values) else: for i in range(len(values)): if values[i] < 0: values[i] = 0 s = sum(values) if s == 0: return np.random.choice(values) for i in range(len(values)): values[i] /= s # print(values) return np.random.choice(range(env.action_space.n), p=values)gamma = 0.997batch_size = 64 ##64evaluate = Falsescores = []avg_scores = []epochs = 2_000optim = paddle.optimizer.Adam(learning_rate=1e-3,parameters=mu.parameters())mse_loss = nn.MSELoss()for episode in tqdm(range(epochs)): obs = env.reset() done = False score = 0 while not done: a = choose_action(env, evaluate=evaluate) a_pi = np.zeros((env.action_space.n)); a_pi[a] = 1 obs_, r, done, _ = env.step(a) score += r buffer.append([obs, None, a_pi, r/200]) obs = obs_ #print(f'score: {score}') scores.append(score) if len(scores) >= 100: avg_scores.append(np.mean(scores[-100:])) else: avg_scores.append(np.mean(scores)) cnt = score for i in range(len(buffer)): if buffer[i][1] == None: buffer[i][1] = cnt / 200 cnt -= 1 assert(cnt == 0) if len(buffer) >= batch_size: batch = [] indexes = np.random.choice(len(buffer), batch_size, replace=False) for i in range(batch_size): batch.append(buffer[indexes[i]]) states = paddle.to_tensor([transition[0] for transition in batch], dtype='float32') values = paddle.to_tensor([transition[1] for transition in batch], dtype='float32') values = paddle.reshape(values,[batch_size,-1]) policies = paddle.to_tensor([transition[2] for transition in batch], dtype='float32') rewards = paddle.to_tensor([transition[3] for transition in batch], dtype='float32') rewards = paddle.reshape(rewards,[batch_size,-1]) for _ in range(2): # mu.train_on_batch([states, policies], [rewards, values, policies]) rew, v, pi = mu(states, policies) # print("----rew---{}----v---{}----------pi---{}".format(rew, v, pi)) # print("----rewards---{}----values---{}----------policies---{}".format(rewards, values, policies)) policy_loss = -paddle.mean(paddle.sum(policies*paddle.log(pi), axis=1)) mse1 = mse_loss(rew, rewards) mse2 =mse_loss(v,values) # print(mse1,mse2 ,policy_loss) loss = paddle.add_n([policy_loss,mse1,mse2]) # print(loss) loss.backward() optim.step() optim.clear_grad()登录后复制100%|██████████| 2000/2000 [07:18<00:00, 4.56it/s]登录后复制In [ ]

# 模型保存model_state_dict = mu.state_dict()paddle.save(model_state_dict, "mu.pdparams")登录后复制In [4]

import matplotlib.pyplot as pltplt.plot(scores)plt.plot(avg_scores)plt.xlabel('episode')plt.legend(['scores', 'avg scores'])plt.title('scores')plt.ylim(0, 200)plt.show()登录后复制登录后复制登录后复制In [5]

# 模型测试 ,可以看到testing scores在100次测试中均为200,说明模型已经完全掌握了这个简单的游戏# 模型读取# model_state_dict = paddle.load("mu.pdparams")# mu.set_state_dict(model_state_dict)import matplotlib.pyplot as plttests = 100scores = []mu.eval()for episode in range(tests): obs = env.reset() done = False score = 0 while not done: a = choose_action(env, evaluate=True) obs_, r, done, _ = env.step(a) score += r obs = obs_ scores.append(score)plt.plot(scores)plt.title('testing scores')plt.show()登录后复制登录后复制登录后复制

写在最后:

MuZero 能够对规则、环境进行建模, 与此同时它还能学会规则,这就是它的最大创新。也是因为这个,MuZero的搜索空间变得更大,所以计算量会大大增加,但理论上仍旧是强化学习。人类世界中的规则随时在变化,那么显然 Muzero 相比二代 AlphaZero 具有更好的生存能力。可以看到的是,Muzero 有潜力成为广泛使用的强化学习算法。后续有计划在Atari、Gomoku、Tic-tac-toe 等环境下复现Muzero算法相关攻略

Cardano (ADA) 2026年价格预测:AI深度解析与增长路径 在瞬息万变的加密市场,人工智能分析正成为洞察未来趋势的关键工具。近期,由Grok AI模型发布的Cardano(ADA)2026年价格预测引发了广泛关注,其大胆展望ADA或有望触及两位数美元价格。这不仅彰显了AI数据分析的潜力,

京东“全民养虾计划”:开启AI助手体验新纪元 科技领域近期迎来一场别开生面的创新活动:京东正式推出“全民养虾计划”。表面看,它与美食相关,实际上是一场针对AI智能体技术普及的宏大实验。该计划通过“购买AI硬件、赠送专业安装服务与趣味小龙虾”的组合策略,为当前热门的开源AI智能体——OpenClaw,

![一波资本从以太坊(ETH)流出,进入TRON [TRX]](https://static.youleyou.com//uploadfile/2026/0402/04efc42957db48dcec46c19e60baa121.webp)

以太坊资本外溢:TRON为何成为15 2亿美元稳定币新枢纽? 区块链世界的地壳运动从未停止,资本的流向便是其中最敏锐的震感。近期,一场规模惊人的资本迁徙正在上演:大量资金正从以太坊网络流出,涌入TRON生态。这不仅是简单的资产转移,更是一次深刻的行业风向标,揭示了用户对交易成本、网络效率与应用场景的

自研第一个SKILL:手把手教你开发openclaw自定义技能 当你成功构建好openclaw之后,如何让它真正“智能”起来?关键在于为其开发SKILL——这些技能是openclaw的“内功心法”,决定了它能帮你做什么、做多好。 本文将带你亲自动手,从零开始开发你的第一个openclaw自定义技能,

国产 TOP5 手机厂商被曝联手豆包 打造全新 AI 手机 手机行业再迎重磅 AI 合作!今日,知名数码爆料博主 @数码闲聊站 抛出了“豆包 AI 手机”的议题,并透露其已从内部渠道确认:一家位列国产前五的头部手机厂商,已与字节跳动旗下 AI 产品“豆包”达成深度合作协议。这标志着,AI 手机助理的

热门专题

热门推荐

索拉拉是什么币?未来能涨多少?索拉拉币的详细信息介绍 最近,圈内有个热议的话题:知名公链Solana正式确定了它的中文名——“索拉拉”。这个名字并非来自项目方的单方面决定,而是由社区发起、最终获得官方认可的集体智慧结晶。它取代了大家此前更耳熟能详的“索拉纳”。那么,这个新名字背后的索拉拉币究竟是什么

流动性是加密市场的静默引擎 想象一下,当市场的脉搏变弱,交易不再活跃,会发生什么?流动性,这个常常被忽视的指标,恰恰是维持价格稳定的关键。一旦它开始减弱,市场的脆弱性便会暴露无遗。交易量大幅下滑,买卖资产就像在狭窄的通道中穿行,一个不小心,就可能引发剧烈的价格波动。 这种情形并不罕见,通常在年末清淡

你是否在寻找安全便捷的云端文件存储方案? 坚果云很可能就是你需要的答案。作为一款高效的云存储服务,它让数据同步与文件管理变得异常轻松。本文将详细介绍坚果云的多种文件上传方法,帮助你快速掌握核心操作流程。 注册与登录坚果云 首先,访问坚果云的官方网站,完成账户的注册步骤。随后使用账号密码登录,系统将呈

OPPO K15 Pro系列4月1日发布:存储配置引热议 OPPO官方已正式宣布,K15 Pro系列新品将于4月1日正式发布。值得注意的是,尽管尚未正式亮相,该系列的两款新机目前已在OPPO官方商城开放预约。然而,官网配置信息揭示了一个值得关注的现象:全系列目前仅提供12GB运行内存(RAM)版本,

击败《红色沙漠》采石场的马罗尼采石机械后,BOSS战并未真正结束。游戏的深度探索,实际上始于一处隐秘遗迹的触发。你需要寻找到那个特定的入口,然后纵身跃下,方能正式踏入这片鲜为人知的地下秘境。 落地之后,挑战即刻开始。这片地下遗迹并非安宁之地,首先迎接你的往往是那些极具攻击性的球形守卫者,它们行动迅捷